Character Mixing for Video Generation

作者: Tingting Liao, Chongjian Ge, Guangyi Liu, Hao Li, Yi Zhou

分类: cs.CV

发布日期: 2025-10-06

🔗 代码/项目: PROJECT_PAGE

💡 一句话要点

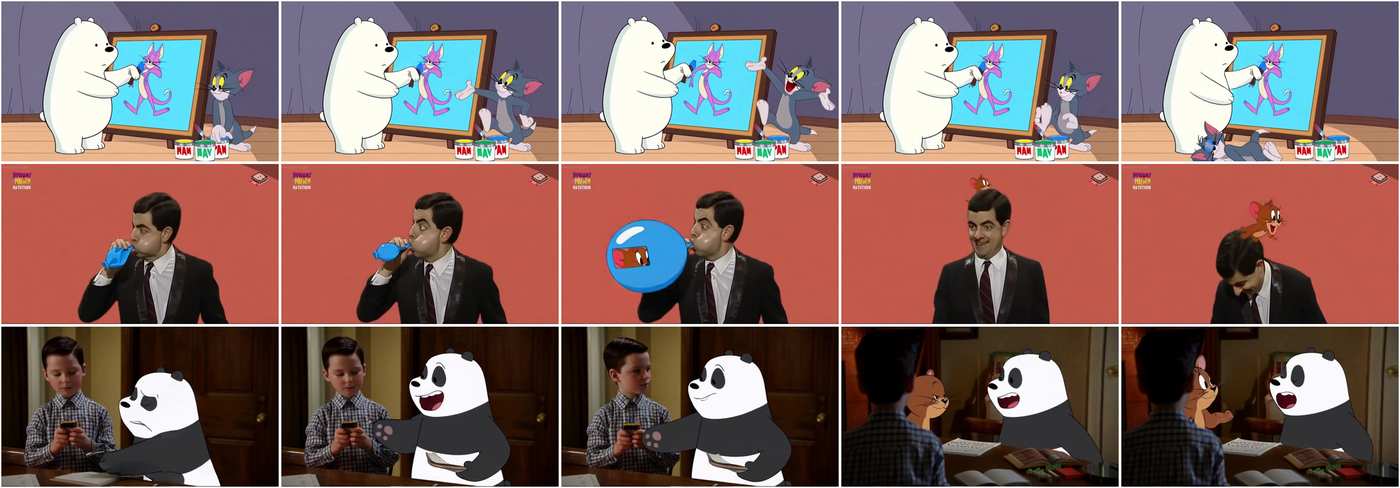

提出CCE和CCA框架,实现跨世界观角色自然交互的视频生成。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 视频生成 跨角色交互 风格迁移 角色嵌入 数据增强

📋 核心要点

- 现有文本到视频生成方法难以保证跨世界观角色交互的自然性和风格一致性,容易出现风格错乱。

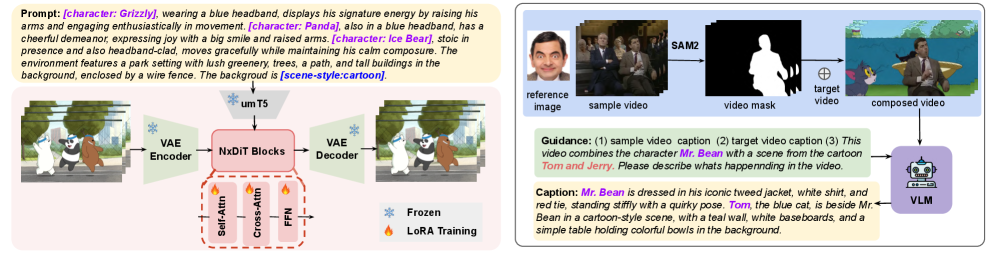

- 论文提出跨角色嵌入(CCE)和跨角色增强(CCA)框架,分别用于学习角色身份行为逻辑和扩充混合风格训练数据。

- 实验结果表明,该方法在身份保持、交互质量和风格鲁棒性方面均有提升,能够生成更自然的跨世界观角色交互视频。

📝 摘要(中文)

本文研究了文本到视频生成中角色间的交互问题,主要挑战在于保持每个角色的身份和行为特征,同时实现跨语境的连贯交互。由于角色可能从未共存过,并且混合风格容易导致风格错乱,使写实角色卡通化或反之,这使得问题更具挑战性。为此,我们提出了一个框架,该框架通过跨角色嵌入(CCE)学习跨多模态来源的身份和行为逻辑,并通过跨角色增强(CCA)利用合成的共存和混合风格数据来丰富训练。这些技术共同实现了先前不共存角色之间的自然交互,而不会损失风格保真度。在包含10个角色的卡通和真人剧集数据集上的实验表明,在身份保持、交互质量和风格错乱的鲁棒性方面有明显的改进,从而实现了新的生成式叙事形式。

🔬 方法详解

问题定义:本文旨在解决文本到视频生成中,不同风格(例如卡通和真人)的角色进行自然交互的问题。现有方法难以在保持每个角色自身风格的同时,生成合理的交互行为,容易出现风格混淆,导致生成质量下降。

核心思路:核心思路是通过学习跨模态的角色嵌入,捕捉角色在不同风格下的身份和行为特征,并利用数据增强技术,扩充混合风格的训练数据,从而提高模型的泛化能力和风格一致性。

技术框架:整体框架包含两个主要模块:跨角色嵌入(CCE)和跨角色增强(CCA)。CCE模块负责学习角色在不同模态(例如文本描述、图像、视频)下的嵌入表示,捕捉角色的身份和行为特征。CCA模块则通过合成共存和混合风格的数据,扩充训练集,提高模型对不同风格角色的适应能力。生成模型基于学习到的角色嵌入和增强后的数据进行训练,最终生成包含自然交互的视频。

关键创新:关键创新在于同时考虑了角色身份的保持和跨风格交互的合理性,并提出了相应的CCE和CCA模块。CCE模块通过学习跨模态的角色嵌入,实现了对角色身份的有效表示。CCA模块则通过数据增强,提高了模型对混合风格数据的鲁棒性。

关键设计:CCE模块的具体实现细节未知,但推测可能使用了对比学习等方法,学习角色在不同模态下的相似性。CCA模块的具体增强策略也未知,但可能包括风格迁移、角色合成等技术。损失函数的设计可能包括身份保持损失、交互合理性损失和风格一致性损失等。

🖼️ 关键图片

📊 实验亮点

论文在自建的包含卡通和真人剧集的数据集上进行了实验,结果表明,提出的方法在身份保持、交互质量和风格鲁棒性方面均优于现有方法。具体性能数据未知,但论文强调了在生成跨风格角色交互视频方面的显著提升。

🎯 应用场景

该研究成果可应用于电影制作、游戏开发、虚拟现实等领域,例如,可以用于生成不同动画角色或真人角色在同一场景下互动的视频,创造更具创意和趣味性的内容。此外,该技术还可以用于教育领域,例如生成历史人物在现代场景中互动的视频,提高学生的学习兴趣。

📄 摘要(原文)

Imagine Mr. Bean stepping into Tom and Jerry--can we generate videos where characters interact naturally across different worlds? We study inter-character interaction in text-to-video generation, where the key challenge is to preserve each character's identity and behaviors while enabling coherent cross-context interaction. This is difficult because characters may never have coexisted and because mixing styles often causes style delusion, where realistic characters appear cartoonish or vice versa. We introduce a framework that tackles these issues with Cross-Character Embedding (CCE), which learns identity and behavioral logic across multimodal sources, and Cross-Character Augmentation (CCA), which enriches training with synthetic co-existence and mixed-style data. Together, these techniques allow natural interactions between previously uncoexistent characters without losing stylistic fidelity. Experiments on a curated benchmark of cartoons and live-action series with 10 characters show clear improvements in identity preservation, interaction quality, and robustness to style delusion, enabling new forms of generative storytelling.Additional results and videos are available on our project page: https://tingtingliao.github.io/mimix/.