Progressive Gaussian Transformer with Anisotropy-aware Sampling for Open Vocabulary Occupancy Prediction

作者: Chi Yan, Dan Xu

分类: cs.CV, cs.AI

发布日期: 2025-10-06 (更新: 2025-10-08)

备注: Project Page: https://yanchi-3dv.github.io/PG-Occ

🔗 代码/项目: PROJECT_PAGE

💡 一句话要点

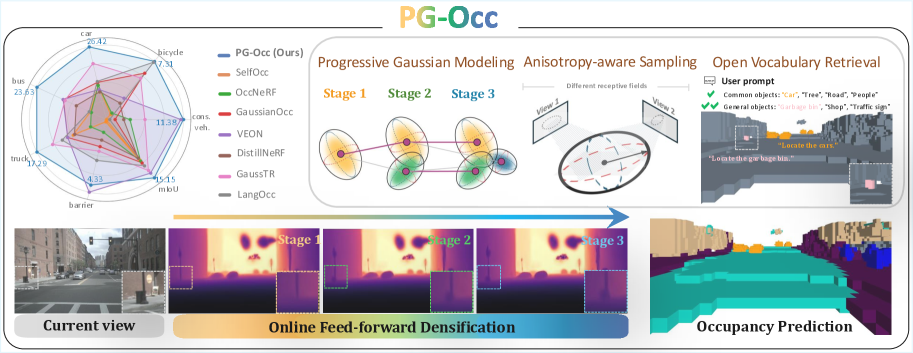

提出PG-Occ框架,通过渐进式高斯Transformer实现开放词汇三维 occupancy 预测。

🎯 匹配领域: 支柱三:空间感知与语义 (Perception & Semantics)

关键词: 三维 occupancy 预测 开放词汇 高斯表示 Transformer 自动驾驶

📋 核心要点

- 现有三维 occupancy 预测方法在开放词汇场景中,难以兼顾小物体捕捉和计算效率。

- PG-Occ框架通过渐进式在线稠密化策略,逐步增强高斯表示,从而捕捉细粒度的场景细节。

- PG-Occ引入各向异性感知采样策略,自适应地分配感受野,提升特征聚合效果,mIoU相对提升14.3%。

📝 摘要(中文)

近年来,三维 occupancy 预测任务取得了显著进展,在基于视觉的自动驾驶系统中发挥着关键作用。传统方法仅限于固定的语义类别,而最近的方法则转向预测文本对齐的特征,以支持真实场景中的开放词汇文本查询。然而,文本对齐的场景建模存在一个权衡:稀疏高斯表示难以捕捉场景中的小物体,而密集表示会产生巨大的计算开销。为了解决这些限制,我们提出了PG-Occ,一种创新的渐进式高斯Transformer框架,用于实现开放词汇三维 occupancy 预测。我们的框架采用渐进式在线稠密化,这是一种前馈策略,逐步增强三维高斯表示,以捕捉细粒度的场景细节。通过迭代增强表示,该框架实现了越来越精确和详细的场景理解。另一个关键贡献是引入了具有时空融合的各向异性感知采样策略,该策略自适应地为不同尺度和阶段的高斯分配感受野,从而实现更有效的特征聚合和更丰富的场景信息捕获。通过广泛的评估,我们证明了PG-Occ实现了最先进的性能,相对于之前表现最佳的方法,mIoU相对提高了14.3%。代码和预训练模型将在我们的项目页面上发布。

🔬 方法详解

问题定义:论文旨在解决开放词汇三维 occupancy 预测问题,即在没有预定义语义类别的情况下,根据文本查询预测场景中物体的 occupancy 状态。现有方法的痛点在于,稀疏高斯表示难以捕捉小物体,而密集表示计算成本过高,难以在实际场景中应用。

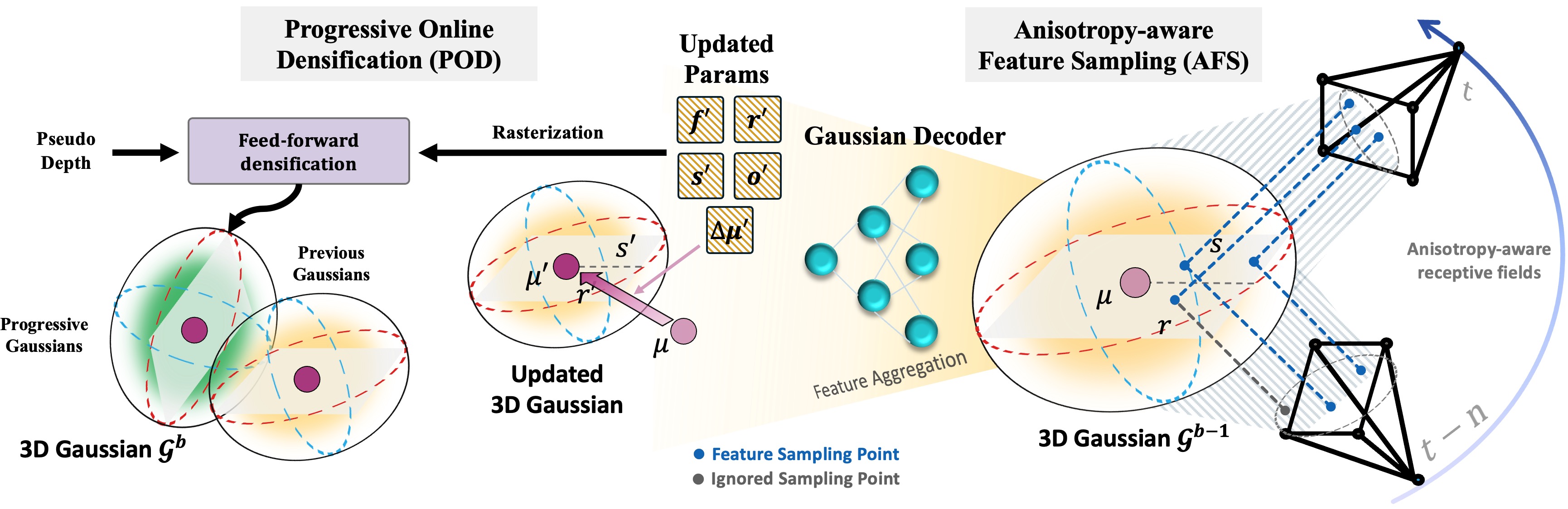

核心思路:论文的核心思路是采用渐进式高斯表示,通过逐步稠密化高斯分布,在计算效率和细节捕捉之间取得平衡。同时,引入各向异性感知采样,根据高斯分布的形状和尺度自适应地调整感受野,从而更有效地聚合特征。

技术框架:PG-Occ框架包含以下主要模块:1) 渐进式在线稠密化模块,用于逐步增加高斯分布的数量,提高场景表示的细节程度;2) 各向异性感知采样模块,根据高斯分布的形状和尺度,自适应地选择采样点,聚合特征;3) 时空融合模块,融合不同时间和空间的信息,提高预测的准确性。整体流程是,首先使用稀疏高斯分布表示场景,然后通过渐进式在线稠密化模块逐步增加高斯分布的数量,并使用各向异性感知采样模块聚合特征,最后通过时空融合模块提高预测的准确性。

关键创新:论文的关键创新在于:1) 提出了一种渐进式在线稠密化策略,可以在计算效率和细节捕捉之间取得平衡;2) 引入了一种各向异性感知采样策略,可以根据高斯分布的形状和尺度自适应地调整感受野,从而更有效地聚合特征。与现有方法的本质区别在于,PG-Occ框架可以自适应地调整高斯分布的数量和形状,从而更好地适应不同场景的需求。

关键设计:各向异性感知采样策略中,感受野的大小和形状由高斯分布的协方差矩阵决定。损失函数包括 occupancy 预测损失和稠密化损失,用于优化高斯分布的参数和数量。网络结构采用 Transformer 架构,用于建模高斯分布之间的关系。

🖼️ 关键图片

📊 实验亮点

PG-Occ在开放词汇三维 occupancy 预测任务上取得了state-of-the-art的性能,相对于之前表现最佳的方法,mIoU相对提高了14.3%。实验结果表明,渐进式高斯表示和各向异性感知采样策略可以有效地提高场景表示的细节程度和特征聚合效率。

🎯 应用场景

该研究成果可应用于自动驾驶、机器人导航、虚拟现实等领域。在自动驾驶中,可以利用该方法预测周围环境的 occupancy 状态,提高车辆的安全性。在机器人导航中,可以利用该方法构建环境地图,帮助机器人进行路径规划。在虚拟现实中,可以利用该方法生成逼真的三维场景。

📄 摘要(原文)

The 3D occupancy prediction task has witnessed remarkable progress in recent years, playing a crucial role in vision-based autonomous driving systems. While traditional methods are limited to fixed semantic categories, recent approaches have moved towards predicting text-aligned features to enable open-vocabulary text queries in real-world scenes. However, there exists a trade-off in text-aligned scene modeling: sparse Gaussian representation struggles to capture small objects in the scene, while dense representation incurs significant computational overhead. To address these limitations, we present PG-Occ, an innovative Progressive Gaussian Transformer Framework that enables open-vocabulary 3D occupancy prediction. Our framework employs progressive online densification, a feed-forward strategy that gradually enhances the 3D Gaussian representation to capture fine-grained scene details. By iteratively enhancing the representation, the framework achieves increasingly precise and detailed scene understanding. Another key contribution is the introduction of an anisotropy-aware sampling strategy with spatio-temporal fusion, which adaptively assigns receptive fields to Gaussians at different scales and stages, enabling more effective feature aggregation and richer scene information capture. Through extensive evaluations, we demonstrate that PG-Occ achieves state-of-the-art performance with a relative 14.3% mIoU improvement over the previous best performing method. Code and pretrained models will be released upon publication on our project page: https://yanchi-3dv.github.io/PG-Occ