EduPersona: Benchmarking Subjective Ability Boundaries of Virtual Student Agents

作者: Buyuan Zhu, Shiyu Hu, Yiping Ma, Yuanming Zhang, Kang Hao Cheong

分类: cs.CV, cs.CY

发布日期: 2025-10-06

备注: Preprint, Under review

💡 一句话要点

EduPersona:评估虚拟学生Agent主观能力的基准数据集与评测框架

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 虚拟学生Agent 主观能力评估 基准数据集 人格建模 教育人工智能

📋 核心要点

- 现有虚拟学生Agent的主观能力评估不足,限制了其在教育领域的可靠应用。

- EduPersona通过构建大规模基准数据集和解耦式评估框架,量化Agent的主观能力。

- 实验表明,在EduPersona上微调的LLM在连贯性、真实感和一致性方面均有显著提升。

📝 摘要(中文)

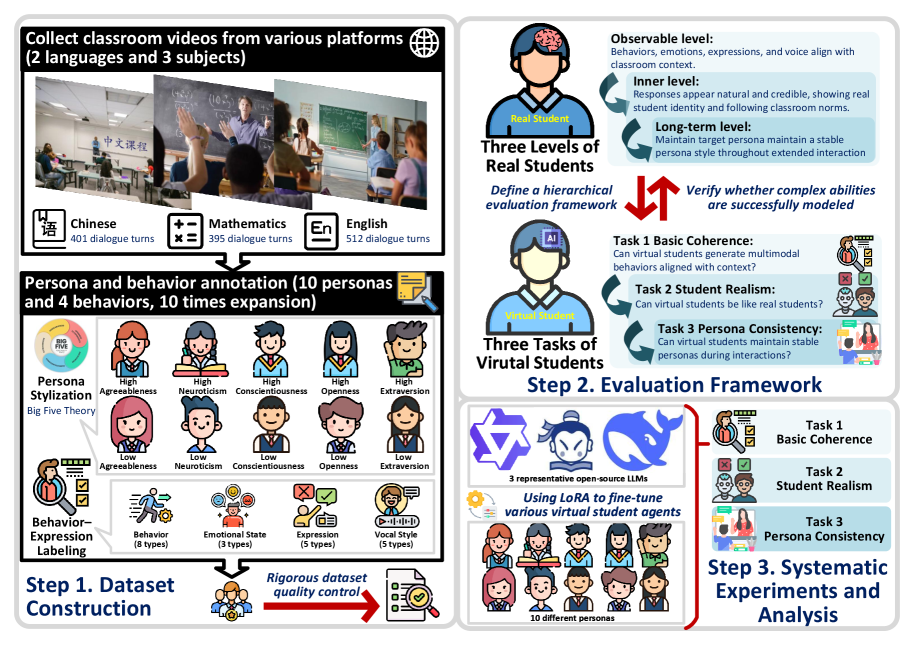

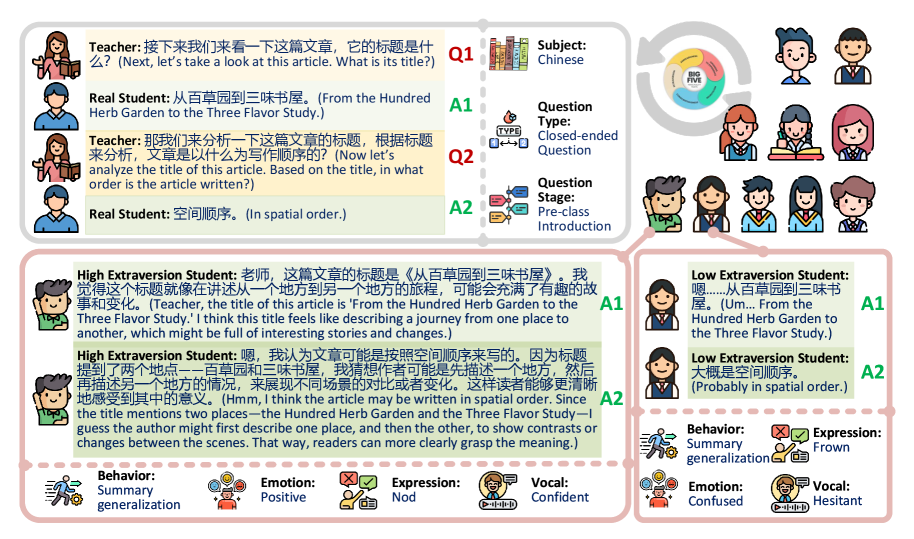

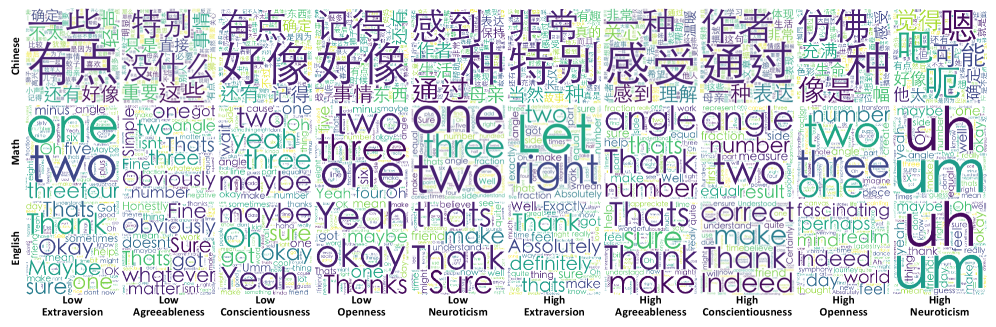

随着大型语言模型越来越多地融入教育领域,虚拟学生Agent对于课堂模拟和教师培训变得至关重要。然而,它们面向课堂的主观能力在很大程度上仍未得到评估,这限制了对模型边界的理解,并阻碍了可信部署。我们提出了EduPersona,这是一个大规模的基准数据集,涵盖两种语言、三个学科和基于大五人格理论的十种人格类型。该数据集包含1308轮真实的课堂对话,对应12814轮师生问答,并通过人格风格化扩展到大约10倍的规模(12.8万轮),为评估提供了坚实的基础。基于此资源,我们将难以量化的主观表现分解为三个渐进式任务:任务1基本连贯性(行为、情感、表达和声音是否与课堂环境一致),任务2学生真实感,以及任务3长期人格一致性,从而建立了一个基于教育理论和研究价值的评估框架。我们对三个具有代表性的LLM进行了系统实验,比较了它们的原始版本和在EduPersona上进行人格微调的十个变体。结果显示,所有任务的平均改进都是一致且显著的:任务1 +33.6%,任务2 +30.6%,任务3 +14.9%。这些改进突出了数据集的有效性和研究价值,同时也揭示了人格建模的异构难度。总之,EduPersona提供了第一个以主观能力为中心的课堂基准,建立了一个解耦且可验证的研究范式,我们将开源数据集和框架,以支持更广泛的研究社区推进可信和类人的人工智能在教育领域的应用。

🔬 方法详解

问题定义:当前虚拟学生Agent在教育场景中的应用日益广泛,但其主观能力,如情感表达、行为方式等,缺乏有效的评估手段。现有方法难以量化这些主观特性,导致模型的可信度和可用性受到限制。因此,如何构建一个能够全面评估虚拟学生Agent主观能力的基准测试,成为了一个亟待解决的问题。

核心思路:论文的核心思路是将复杂的主观能力评估分解为三个可量化的任务:基本连贯性、学生真实感和长期人格一致性。通过这种解耦的方式,可以更精确地评估Agent在不同方面的表现,并为模型优化提供更具体的指导。同时,通过构建大规模的、包含多种人格类型的课堂对话数据集,为评估提供了坚实的数据基础。

技术框架:EduPersona的整体框架包括数据集构建和评估框架两部分。数据集构建方面,首先收集真实的课堂对话数据,然后基于大五人格理论,对数据进行人格风格化,生成大规模的多样化数据集。评估框架方面,将主观能力评估分解为三个任务:任务1评估基本连贯性,即Agent的行为、情感等是否与课堂环境一致;任务2评估学生真实感,即Agent是否表现出符合学生身份的特征;任务3评估长期人格一致性,即Agent在长期对话中是否保持一致的人格特征。

关键创新:该论文的关键创新在于:1) 提出了一个以主观能力为中心的课堂基准,填补了该领域的空白;2) 建立了一个解耦且可验证的评估范式,将复杂的主观能力评估分解为可量化的任务;3) 构建了一个大规模的、包含多种人格类型的课堂对话数据集,为评估提供了坚实的数据基础。

关键设计:在数据集构建方面,采用了基于大五人格理论的人格风格化方法,生成了十种不同人格类型的学生Agent。在评估框架方面,针对每个任务设计了相应的评估指标,例如,对于基本连贯性,评估Agent的行为、情感等是否与课堂环境一致;对于学生真实感,评估Agent是否表现出符合学生身份的特征;对于长期人格一致性,评估Agent在长期对话中是否保持一致的人格特征。具体的参数设置、损失函数、网络结构等技术细节在论文中未详细描述。

🖼️ 关键图片

📊 实验亮点

实验结果表明,在EduPersona数据集上进行人格微调后,LLM在三个评估任务上均取得了显著提升:任务1(基本连贯性)提升33.6%,任务2(学生真实感)提升30.6%,任务3(长期人格一致性)提升14.9%。这些结果验证了EduPersona数据集的有效性和研究价值。

🎯 应用场景

EduPersona的研究成果可应用于开发更逼真、更可信的虚拟学生Agent,用于课堂模拟、教师培训和个性化教育等领域。通过评估和提升Agent的主观能力,可以提高其在教育场景中的有效性和可用性,从而促进教育的智能化和个性化发展。

📄 摘要(原文)

As large language models are increasingly integrated into education, virtual student agents are becoming vital for classroom simulation and teacher training. Yet their classroom-oriented subjective abilities remain largely unassessed, limiting understanding of model boundaries and hindering trustworthy deployment. We present EduPersona, a large-scale benchmark spanning two languages, three subjects, and ten persona types based on the Big Five theory. The dataset contains 1,308 authentic classroom dialogue rounds, corresponding to 12,814 teacher-student Q&A turns, and is further expanded through persona stylization into roughly 10 times larger scale (128k turns), providing a solid foundation for evaluation. Building on this resource, we decompose hard-to-quantify subjective performance into three progressive tasks: TASK1 basic coherence (whether behavior, emotion, expression, and voice align with classroom context), TASK2 student realism, and TASK3 long-term persona consistency, thereby establishing an evaluation framework grounded in educational theory and research value. We conduct systematic experiments on three representative LLMs, comparing their original versions with ten persona-fine-tuned variants trained on EduPersona. Results show consistent and significant average improvements across all tasks: TASK1 +33.6%, TASK2 +30.6%, and TASK3 +14.9%. These improvements highlight the dataset's effectiveness and research value, while also revealing the heterogeneous difficulty of persona modeling. In summary, EduPersona delivers the first classroom benchmark centered on subjective abilities, establishes a decoupled and verifiable research paradigm, and we will open-source both the dataset and the framework to support the broader research community in advancing trustworthy and human-like AI for education.