A Spatial-Spectral-Frequency Interactive Network for Multimodal Remote Sensing Classification

作者: Hao Liu, Yunhao Gao, Wei Li, Mingyang Zhang, Maoguo Gong, Lorenzo Bruzzone

分类: cs.CV

发布日期: 2025-10-06

🔗 代码/项目: GITHUB

💡 一句话要点

提出空间-光谱-频率交互网络(S²Fin),用于提升多模态遥感图像分类精度。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 多模态遥感 图像分类 频域分析 空间-光谱特征 注意力机制

📋 核心要点

- 现有方法难以从异构冗余的多模态遥感图像中提取结构和细节特征。

- S²Fin通过空间-光谱-频率交互,利用频域信息建模关键和稀疏的细节特征。

- 实验表明,S²Fin在多模态遥感数据集上优于现有方法,提升了分类精度。

📝 摘要(中文)

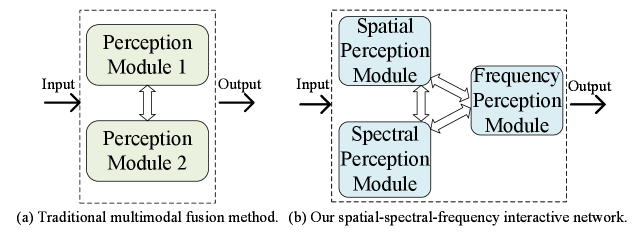

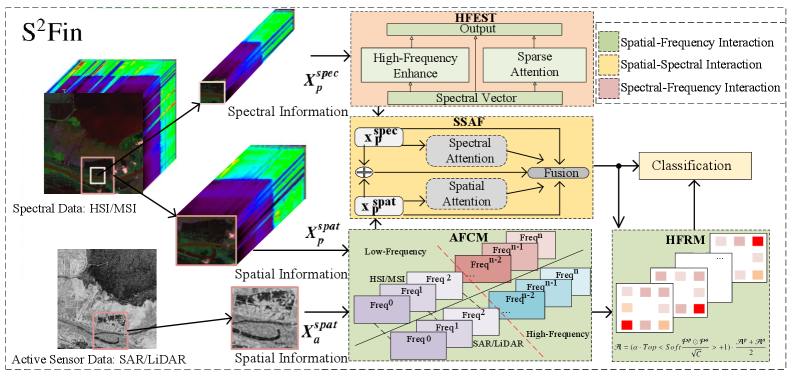

本文提出了一种空间-光谱-频率交互网络(S²Fin),旨在解决多模态遥感图像分类中结构和细节特征提取困难的问题。该网络通过在空间、光谱和频率域上集成成对融合模块,引入频域学习来建模关键和稀疏的细节特征。具体而言,提出了一个高频稀疏增强Transformer,利用稀疏空间-光谱注意力来优化高频滤波器的参数。随后,引入了两级空间-频率融合策略,包括一个自适应频率通道模块,将低频结构与增强的高频细节融合,以及一个高频共振掩码,通过相位相似性来强调锐利边缘。此外,空间-光谱注意力融合模块进一步增强了网络中间层的特征提取。在四个基准多模态数据集上的实验表明,S²Fin表现出卓越的分类性能,优于现有最先进的方法。

🔬 方法详解

问题定义:多模态遥感图像分类旨在融合来自不同传感器的数据,以提高地物分类的准确性。然而,现有方法通常难以有效提取异构多模态数据中的结构和细节特征,尤其是在数据存在冗余的情况下。这限制了分类性能的进一步提升。

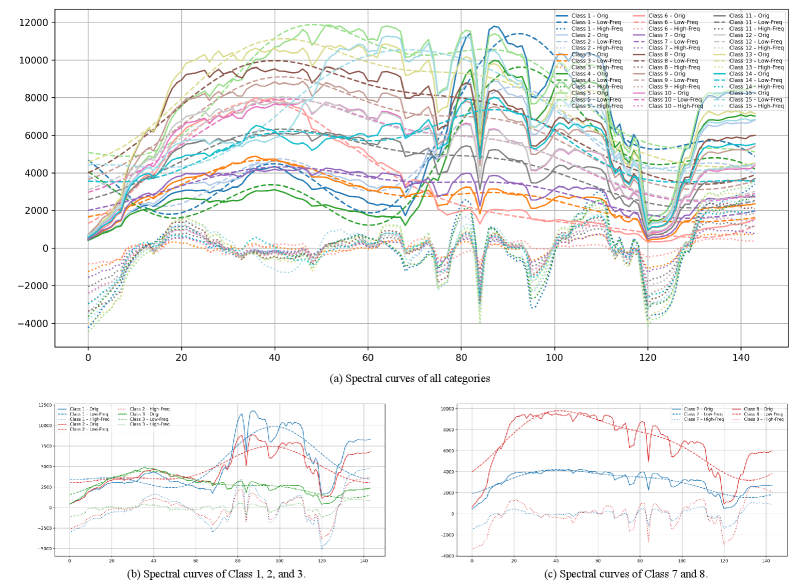

核心思路:本文的核心思路是将频域信息引入到多模态遥感图像分类中。通过频域分析,可以更好地捕捉图像的细节和边缘信息,从而弥补空间和光谱域特征提取的不足。同时,利用注意力机制来增强关键特征,抑制冗余信息,提高特征的表达能力。

技术框架:S²Fin网络主要包含以下几个模块:1) 高频稀疏增强Transformer:用于优化高频滤波器参数,增强高频细节特征。2) 自适应频率通道模块:将低频结构信息与增强的高频细节信息融合。3) 高频共振掩码:通过相位相似性强调图像的锐利边缘。4) 空间-光谱注意力融合模块:在网络中间层增强特征提取。整体流程是先通过高频稀疏增强Transformer提取高频特征,然后通过两级空间-频率融合策略融合不同频率的特征,最后利用空间-光谱注意力融合模块进一步增强特征表达。

关键创新:该论文的关键创新在于将频域信息引入到多模态遥感图像分类中,并设计了专门的模块来提取和融合不同频率的特征。高频稀疏增强Transformer和高频共振掩码是两个关键的创新模块,它们能够有效地提取图像的细节和边缘信息,从而提高分类精度。与现有方法相比,S²Fin能够更好地利用多模态数据中的互补信息,并抑制冗余信息。

关键设计:高频稀疏增强Transformer中,稀疏空间-光谱注意力的具体实现方式未知。自适应频率通道模块和高频共振掩码的具体参数设置未知。损失函数的设计也未知。网络结构的具体层数和参数量未知。

🖼️ 关键图片

📊 实验亮点

实验结果表明,S²Fin在四个基准多模态数据集上均取得了优于现有最先进方法的分类精度。具体提升幅度未知,论文中没有给出具体的数值对比。但总体而言,S²Fin证明了频域信息在多模态遥感图像分类中的有效性,并为未来的研究提供了新的思路。

🎯 应用场景

该研究成果可应用于精准农业、城市规划、灾害监测、环境评估等领域。通过提高遥感图像分类的精度,可以更准确地识别地物类型,为相关决策提供更可靠的依据。例如,在精准农业中,可以利用该技术更准确地识别作物类型和生长状况,从而实现精细化管理。在灾害监测中,可以快速准确地识别受灾区域,为救援工作提供支持。未来,该技术有望与其他人工智能技术相结合,实现更智能化的遥感应用。

📄 摘要(原文)

Deep learning-based methods have achieved significant success in remote sensing Earth observation data analysis. Numerous feature fusion techniques address multimodal remote sensing image classification by integrating global and local features. However, these techniques often struggle to extract structural and detail features from heterogeneous and redundant multimodal images. With the goal of introducing frequency domain learning to model key and sparse detail features, this paper introduces the spatial-spectral-frequency interaction network (S$^2$Fin), which integrates pairwise fusion modules across the spatial, spectral, and frequency domains. Specifically, we propose a high-frequency sparse enhancement transformer that employs sparse spatial-spectral attention to optimize the parameters of the high-frequency filter. Subsequently, a two-level spatial-frequency fusion strategy is introduced, comprising an adaptive frequency channel module that fuses low-frequency structures with enhanced high-frequency details, and a high-frequency resonance mask that emphasizes sharp edges via phase similarity. In addition, a spatial-spectral attention fusion module further enhances feature extraction at intermediate layers of the network. Experiments on four benchmark multimodal datasets with limited labeled data demonstrate that S$^2$Fin performs superior classification, outperforming state-of-the-art methods. The code is available at https://github.com/HaoLiu-XDU/SSFin.