Pathology-CoT: Learning Visual Chain-of-Thought Agent from Expert Whole Slide Image Diagnosis Behavior

作者: Sheng Wang, Ruiming Wu, Charles Herndon, Yihang Liu, Shunsuke Koga, Jeanne Shen, Zhi Huang

分类: cs.CV

发布日期: 2025-10-06 (更新: 2025-10-13)

💡 一句话要点

提出Pathology-CoT框架,从专家WSI诊断行为中学习视觉链式推理Agent

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 病理学 全切片图像 链式推理 智能体 辅助诊断

📋 核心要点

- 现有病理学AI系统缺乏模拟专家诊断过程的交互性和可解释性,主要瓶颈在于缺乏专家观察行为的标注数据。

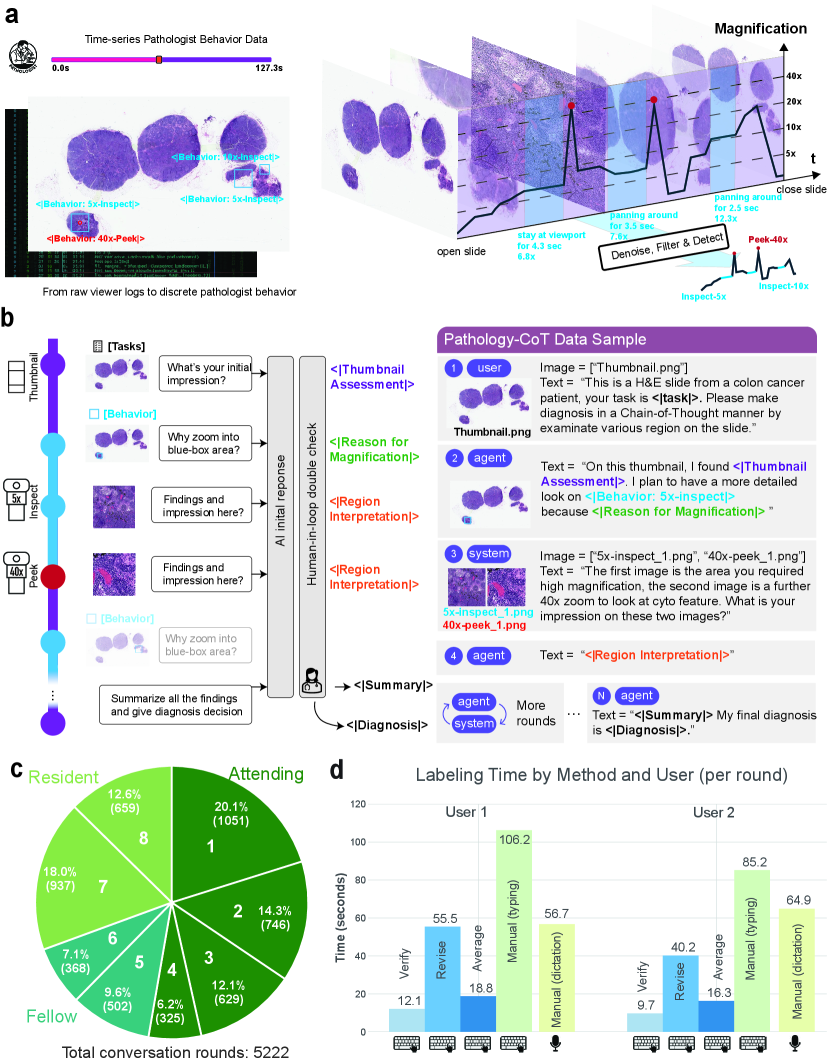

- Pathology-CoT框架通过AI会话记录器和人机协作,高效构建包含专家“在哪里看”和“为什么重要”信息的链式推理数据集。

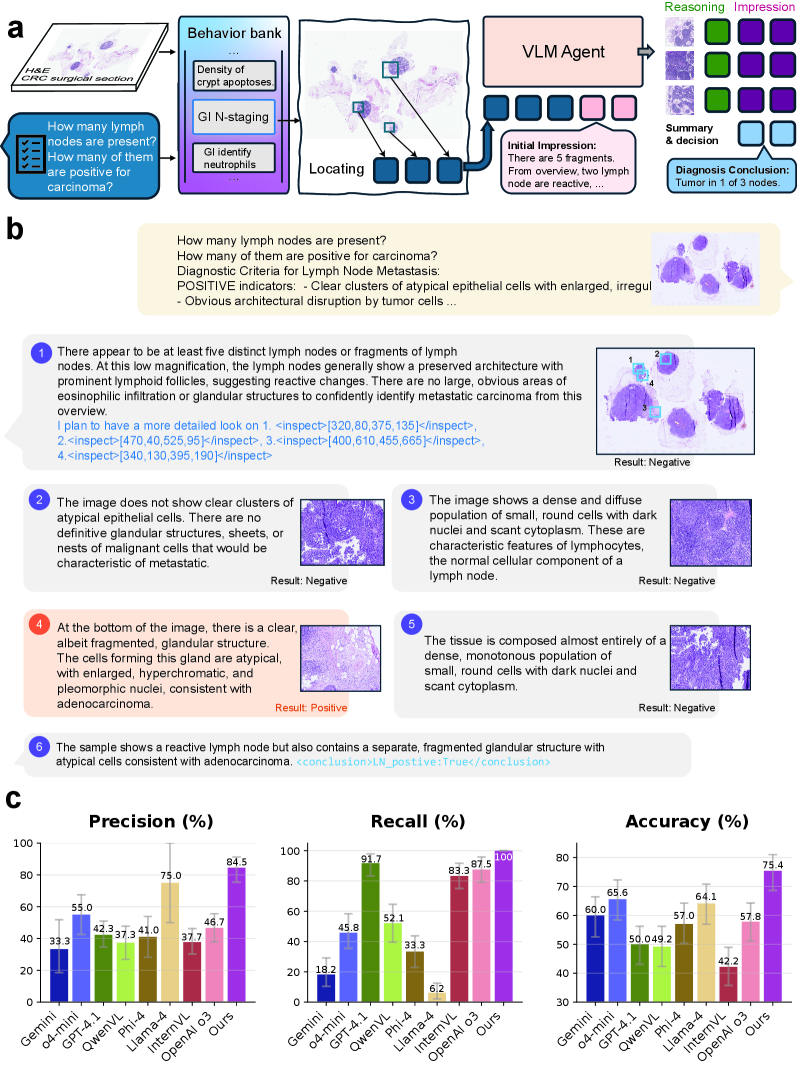

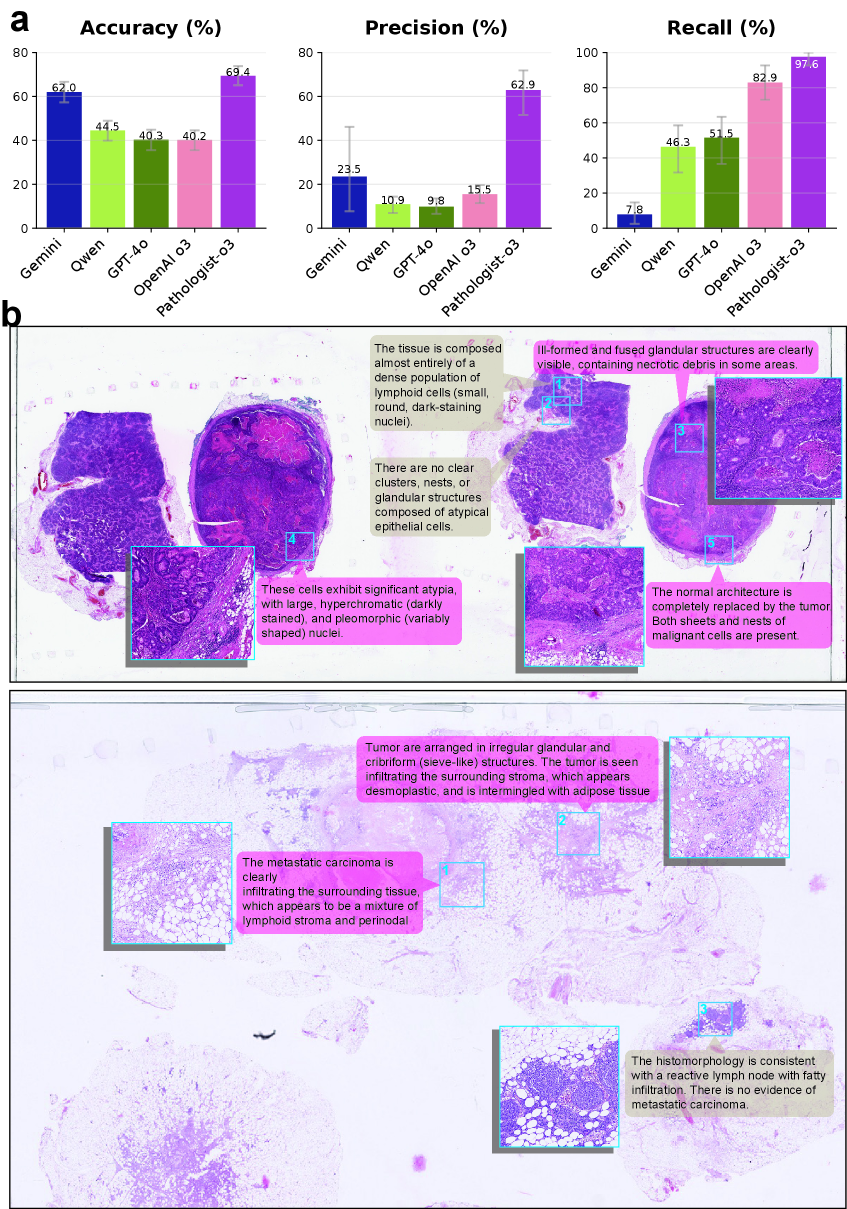

- Pathology-o3智能体利用该数据集,分两阶段进行ROI选择和行为引导推理,在淋巴结转移检测任务中超越现有SOTA模型。

📝 摘要(中文)

诊断全切片图像(WSI)是一个交互式的多阶段过程,涉及改变放大倍数并在视野之间移动。尽管最近的病理学基础模型表现出卓越的性能,但仍然缺乏能够决定下一步检查哪个视野、调整放大倍数并提供可解释诊断的实用智能体系统。这种限制主要受限于数据:缺乏对专家观察行为的可扩展、临床对齐的监督,这些行为是隐性的、基于经验的,没有记录在教科书或互联网上,因此也未包含在LLM训练中。本文介绍了一个旨在通过三个关键突破来应对这一挑战的框架。首先,AI会话记录器与标准WSI查看器无缝集成,以不引人注意地记录常规导航,并将查看器日志转换为标准化行为命令和边界框。其次,轻量级的人工参与审查将AI起草的行为命令理由转化为Pathology-CoT数据集,这是一种配对的“在哪里看”和“为什么重要”的形式,与手动构建此类链式思考数据集相比,标签速度提高了六倍。使用这种行为数据,我们构建了Pathology-o3,这是一个两阶段的智能体,首先提出重要的ROI,然后执行行为引导的推理。在胃肠道淋巴结转移检测任务中,我们的方法在斯坦福医学的内部验证中实现了100%的召回率,在瑞典的独立外部验证中实现了97.6%的召回率,超过了最先进的OpenAI o3模型,并且可以跨骨干网络泛化。据我们所知,Pathology-CoT是病理学中首批基于行为的智能体系统之一。通过将日常查看器日志转化为可扩展的、经过专家验证的监督,我们的框架使智能病理学成为可能,并为与人类对齐的可升级临床AI奠定了基础。

🔬 方法详解

问题定义:现有病理学AI模型,特别是基于深度学习的模型,在全切片图像(WSI)诊断中表现出色,但缺乏像病理学家一样进行交互式、多阶段诊断的能力。病理学家在诊断过程中会不断调整放大倍数,并在不同视野间移动,而现有模型通常是“一次性”处理整个图像。此外,现有模型缺乏可解释性,难以理解其诊断逻辑。主要痛点在于缺乏大规模、高质量的专家诊断行为数据,用于训练能够模拟专家诊断过程的智能体。

核心思路:论文的核心思路是利用专家在日常使用WSI查看器时的操作日志,将其转化为可用于训练智能体的监督信号。通过AI辅助标注和人工审核,将这些操作日志转化为包含“在哪里看”和“为什么重要”信息的链式推理(Chain-of-Thought, CoT)数据集。这样可以有效地学习专家的诊断策略,并提高模型的可解释性。

技术框架:Pathology-CoT框架包含以下几个主要模块: 1. AI会话记录器:无缝集成到WSI查看器中,记录专家的导航行为,包括视野位置、放大倍数等。 2. AI辅助标注:利用AI自动生成行为命令的理由草案。 3. 人工审核:专家对AI生成的理由进行审核和修改,生成最终的Pathology-CoT数据集。 4. Pathology-o3智能体:一个两阶段的智能体,首先提出重要的ROI,然后执行行为引导的推理。

关键创新:最重要的技术创新点在于利用专家日常操作日志构建Pathology-CoT数据集。与传统的手动标注CoT数据集相比,该方法大大提高了标注效率(六倍),并且能够捕捉到专家在实际诊断过程中的隐性知识。此外,Pathology-o3智能体通过模仿专家的行为,实现了更强的交互性和可解释性。

关键设计: * AI会话记录器:需要保证对专家操作的无侵入性,避免影响其正常工作流程。 * AI辅助标注:利用预训练模型生成理由草案,减少人工标注负担。 * Pathology-o3智能体:两阶段设计,首先关注重要的ROI,然后进行细致的推理。具体的网络结构和损失函数细节未知。

🖼️ 关键图片

📊 实验亮点

Pathology-o3智能体在胃肠道淋巴结转移检测任务中取得了显著成果。在斯坦福医学的内部验证中,实现了100%的召回率。在瑞典的独立外部验证中,实现了97.6%的召回率。这些结果超过了最先进的OpenAI o3模型,并且证明了该方法具有良好的泛化能力,可以跨骨干网络使用。

🎯 应用场景

该研究成果可应用于病理学辅助诊断,帮助病理学家提高诊断效率和准确性,尤其是在缺乏经验的病理学家或资源有限的地区。此外,该框架还可以推广到其他需要专家经验的医疗影像诊断领域,例如放射学和眼科。未来,该研究有望推动临床AI向更智能、更可解释的方向发展。

📄 摘要(原文)

Diagnosing a whole-slide image is an interactive, multi-stage process of changing magnification and moving between fields. Although recent pathology foundation models demonstrated superior performances, practical agentic systems that decide what field to examine next, adjust magnification, and deliver explainable diagnoses are still lacking. Such limitation is largely bottlenecked by data: scalable, clinically aligned supervision of expert viewing behavior that is tacit and experience-based, not documented in textbooks or internet, and therefore absent from LLM training. Here we introduce a framework designed to address this challenge through three key breakthroughs. First, the AI Session Recorder seamlessly integrates with standard whole-slide image viewers to unobtrusively record routine navigation and convert the viewer logs into standardized behavioral commands and bounding boxes. Second, a lightweight human-in-the-loop review turns AI-drafted rationales for behavioral commands into the Pathology-CoT dataset, a form of paired "where to look" and "why it matters", enabling six-fold faster labeling compared to manual constructing such Chain-of-Thought dataset. Using this behavioral data, we build Pathology-o3, a two-stage agent that first proposes important ROIs and then performs behavior-guided reasoning. On the gastrointestinal lymph-node metastasis detection task, our method achieved 100 recall on the internal validation from Stanford Medicine and 97.6 recall on an independent external validation from Sweden, exceeding the state-of-the-art OpenAI o3 model and generalizing across backbones. To our knowledge, Pathology-CoT constitutes one of the first behavior-grounded agentic systems in pathology. Turning everyday viewer logs into scalable, expert-validated supervision, our framework makes agentic pathology practical and establishes a path to human-aligned, upgradeable clinical AI.