SketchPlan: Diffusion Based Drone Planning From Human Sketches

作者: Sixten Norelius, Aaron O. Feldman, Mac Schwager

分类: cs.CV, cs.RO

发布日期: 2025-10-03

备注: Code available at https://github.com/sixnor/SketchPlan

💡 一句话要点

SketchPlan:基于扩散模型的无人机规划,从人类草图生成飞行路径

🎯 匹配领域: 支柱一:机器人控制 (Robot Control) 支柱三:空间感知与语义 (Perception & Semantics) 支柱六:视频提取与匹配 (Video Extraction)

关键词: 无人机规划 扩散模型 草图理解 人机交互 深度学习 路径规划 sim-to-real

📋 核心要点

- 现有无人机规划方法难以有效利用人类直观的草图指令,导致人机交互效率低下,且难以适应复杂环境。

- SketchPlan通过SketchAdapter和DiffPath两个模块,分别学习草图到2D路径的映射和2D路径到3D轨迹的推断,实现从草图到3D飞行路径的生成。

- 实验表明,SketchPlan在模拟和真实环境中均表现出色,尤其是在低/中等杂乱环境中实现了100%的成功率,显著优于其他方法。

📝 摘要(中文)

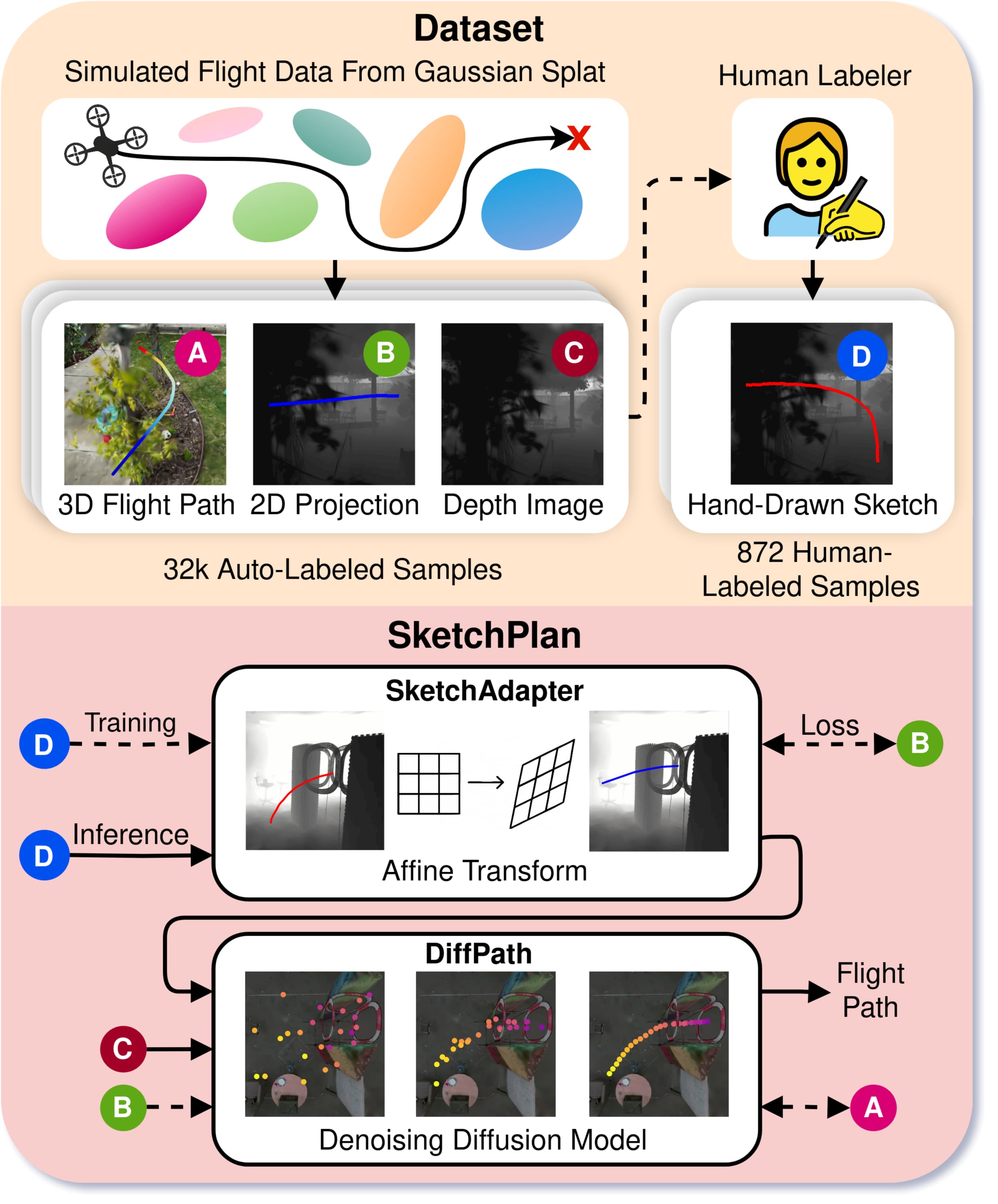

本文提出SketchPlan,一种基于扩散模型的规划器,它能够解析深度图像上的2D手绘草图,从而为无人机导航生成3D飞行路径。SketchPlan包含两个组件:SketchAdapter,学习将人类草图映射到投影的2D路径;DiffPath,一个扩散模型,从2D投影和第一人称视角的深度图像推断3D轨迹。我们的模型实现了零样本的sim-to-real迁移,在以前未见过的真实环境中生成准确且安全的飞行路径。为了训练模型,我们使用各种逼真的3D高斯溅射场景构建了一个包含32k飞行路径的合成数据集。我们通过计算3D飞行路径在相机平面上的2D投影来自动标记数据,并使用它来训练DiffPath扩散模型。然而,由于真实的人类2D草图与理想的2D投影差异很大,我们还用真实的人类草图标记了872个3D飞行路径,并使用它来训练SketchAdapter,以从人类草图推断2D投影。我们在模拟和真实世界的实验中证明了SketchPlan的有效性,并通过消融实验表明,在人工标记和自动标记的混合数据上进行训练,以及模块化设计,显著提高了其正确解释人类意图和推断3D路径的能力。在真实世界的无人机测试中,SketchPlan在低/中等杂乱环境中实现了100%的成功率,在未见过的高杂乱环境中实现了40%的成功率,在任务完成方面优于关键消融实验20-60%。

🔬 方法详解

问题定义:论文旨在解决无人机如何理解人类手绘草图并生成相应的3D飞行路径的问题。现有方法通常难以直接将2D草图转化为可执行的3D轨迹,尤其是在复杂环境中,导致人机交互效率低下,且难以保证飞行安全。现有方法的痛点在于草图的抽象性和环境感知的局限性。

核心思路:论文的核心思路是将问题分解为两个子问题:首先,将人类草图转化为一个更精确的2D路径表示;然后,基于该2D路径和环境深度信息,推断出可行的3D飞行轨迹。这种分解使得模型能够分别学习草图的语义信息和环境的几何约束。

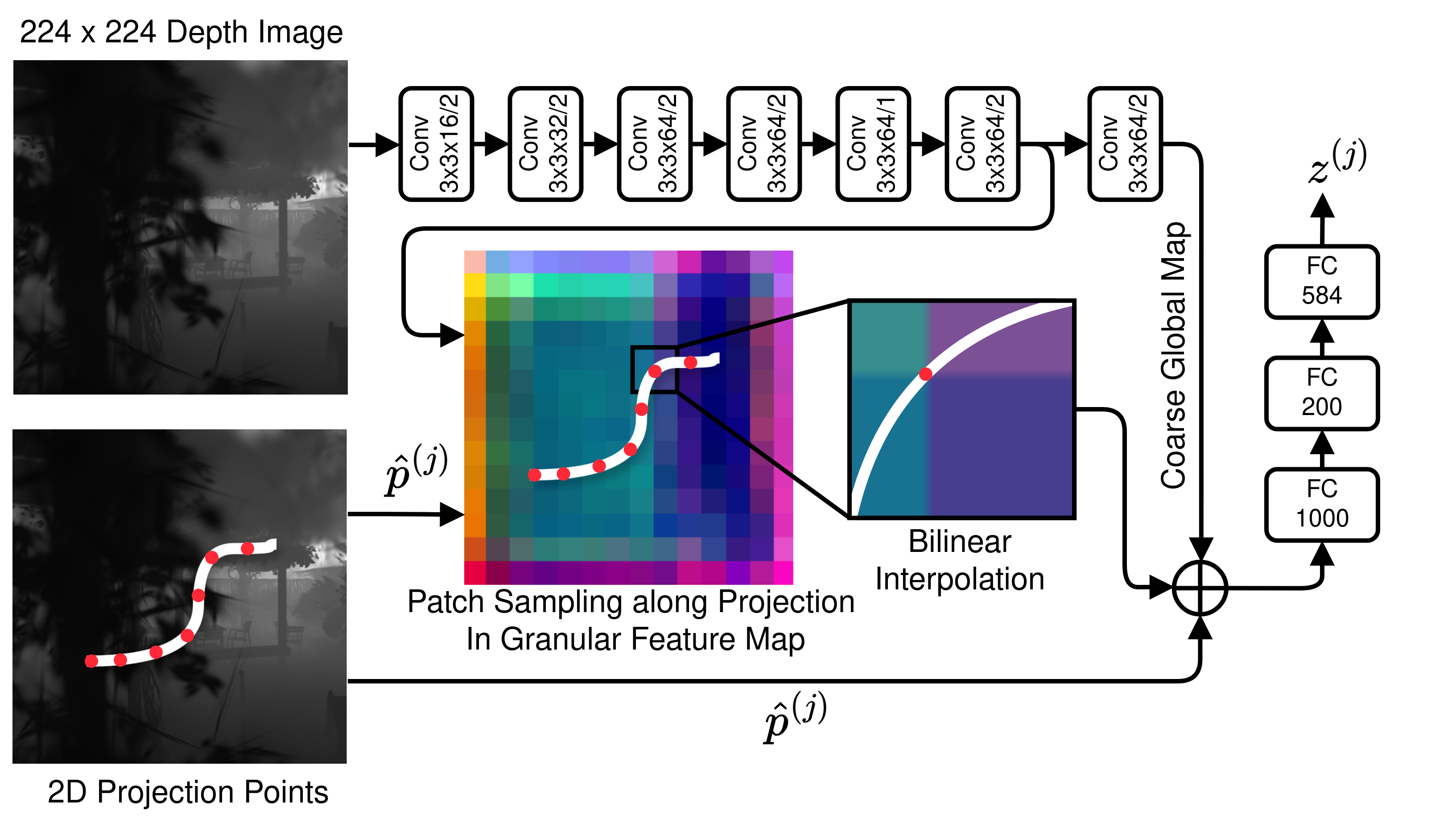

技术框架:SketchPlan包含两个主要模块:SketchAdapter和DiffPath。SketchAdapter负责将人类手绘草图映射到相机平面上的2D路径投影。DiffPath是一个基于扩散模型的模块,它以2D路径投影和第一人称视角的深度图像作为输入,生成3D飞行轨迹。整个流程是:用户绘制2D草图 -> SketchAdapter生成2D路径投影 -> DiffPath结合深度图像生成3D轨迹。

关键创新:该方法最重要的创新点在于结合了草图理解和扩散模型,实现了一种从抽象草图到具体3D轨迹的端到端学习框架。SketchAdapter能够学习人类草图的特征,弥补了草图与理想投影之间的差距。DiffPath利用扩散模型强大的生成能力,能够根据2D投影和深度信息生成合理的3D轨迹,并保证轨迹的安全性。与现有方法相比,该方法更有效地利用了人类的先验知识和环境信息。

关键设计:SketchAdapter使用一个卷积神经网络来学习草图到2D路径投影的映射。DiffPath使用一个条件扩散模型,以2D路径投影和深度图像作为条件,逐步生成3D轨迹。训练数据包括自动生成的合成数据和人工标注的真实数据。损失函数包括轨迹的平滑性损失、碰撞损失和与2D投影一致性损失。具体参数设置和网络结构细节未在摘要中详细说明,属于未知信息。

🖼️ 关键图片

📊 实验亮点

SketchPlan在真实世界的无人机测试中表现出色,在低/中等杂乱环境中实现了100%的成功率,在未见过的高杂乱环境中实现了40%的成功率。消融实验表明,在人工标记和自动标记的混合数据上进行训练,以及模块化设计,显著提高了模型的性能,在任务完成方面优于关键消融实验20-60%。这些结果表明SketchPlan具有很强的泛化能力和实用价值。

🎯 应用场景

SketchPlan具有广泛的应用前景,例如在灾难救援中,救援人员可以通过简单的手绘草图引导无人机进行搜索和侦察。在物流配送领域,用户可以通过草图指定无人机的配送路线。此外,该技术还可以应用于农业、建筑等领域,提高无人机作业的效率和安全性。该研究有望推动人机交互技术的发展,使无人机更加智能化和易于使用。

📄 摘要(原文)

We propose SketchPlan, a diffusion-based planner that interprets 2D hand-drawn sketches over depth images to generate 3D flight paths for drone navigation. SketchPlan comprises two components: a SketchAdapter that learns to map the human sketches to projected 2D paths, and DiffPath, a diffusion model that infers 3D trajectories from 2D projections and a first person view depth image. Our model achieves zero-shot sim-to-real transfer, generating accurate and safe flight paths in previously unseen real-world environments. To train the model, we build a synthetic dataset of 32k flight paths using a diverse set of photorealistic 3D Gaussian Splatting scenes. We automatically label the data by computing 2D projections of the 3D flight paths onto the camera plane, and use this to train the DiffPath diffusion model. However, since real human 2D sketches differ significantly from ideal 2D projections, we additionally label 872 of the 3D flight paths with real human sketches and use this to train the SketchAdapter to infer the 2D projection from the human sketch. We demonstrate SketchPlan's effectiveness in both simulated and real-world experiments, and show through ablations that training on a mix of human labeled and auto-labeled data together with a modular design significantly boosts its capabilities to correctly interpret human intent and infer 3D paths. In real-world drone tests, SketchPlan achieved 100\% success in low/medium clutter and 40\% in unseen high-clutter environments, outperforming key ablations by 20-60\% in task completion.