Towards Reliable and Holistic Visual In-Context Learning Prompt Selection

作者: Wenxiao Wu, Jing-Hao Xue, Chengming Xu, Chen Liu, Xinwei Sun, Changxin Gao, Nong Sang, Yanwei Fu

分类: cs.CV

发布日期: 2025-09-30 (更新: 2025-10-17)

备注: Accepted by NeurIPS 2025

💡 一句话要点

提出RH-Partial2Global,提升视觉上下文学习中prompt选择的可靠性和全面性

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 视觉上下文学习 上下文示例选择 共形预测 覆盖设计 全局排序

📋 核心要点

- 现有VICL方法依赖相似性假设,但缺乏理论支撑,且Partial2Global的随机采样导致覆盖不全和冗余。

- RH-Partial2Global利用jackknife共形预测构建可靠替代集,并采用覆盖设计采样确保偏好对的全面覆盖。

- 实验结果表明,RH-Partial2Global在多种视觉任务上显著优于Partial2Global,验证了其有效性。

📝 摘要(中文)

视觉上下文学习(VICL)已成为一种将视觉基础模型适应于新任务的重要方法,它通过有效利用上下文中嵌入的上下文信息来实现,这可以被形式化为潜在候选者的全局排序问题。现有的VICL方法,如Partial2Global和VPR,都基于相似性优先假设,即与查询图像视觉上更相似的图像可以作为更好的上下文示例。然而,这种基本假设缺乏足够的理由来证明其在选择最佳上下文示例方面的有效性。此外,Partial2Global通过一系列随机采样的成对偏好预测来构建其全局排序。这种对随机采样的依赖可能导致比较的不完全覆盖和冗余采样,从而进一步对最终的全局排序产生不利影响。为了解决这些问题,本文提出了一种增强型的Partial2Global变体,旨在可靠和全面地选择VICL中的上下文示例。我们提出的方法,称为RH-Partial2Global,利用jackknife共形预测引导策略来构建可靠的替代集,并采用基于覆盖设计的采样方法来确保成对偏好的全面和均匀覆盖。大量的实验表明,RH-Partial2Global取得了优异的性能,并在各种视觉任务中优于Partial2Global。

🔬 方法详解

问题定义:论文旨在解决视觉上下文学习(VICL)中,如何更可靠、更全面地选择合适的上下文示例(in-context examples)的问题。现有方法,如Partial2Global,依赖于“相似性优先”的假设,即与查询图像更相似的图像是更好的上下文示例。然而,这种假设缺乏充分的理论依据。此外,Partial2Global通过随机采样的方式进行成对偏好预测,构建全局排序,这可能导致采样不完整和冗余,影响最终的排序结果。

核心思路:RH-Partial2Global的核心思路是通过更可靠的替代集构建和更全面的偏好对采样,来提升上下文示例选择的质量。具体来说,它使用jackknife共形预测来构建可靠的替代集,并采用覆盖设计(covering design)的采样方法,确保对所有可能的成对偏好进行充分且均匀的覆盖。

技术框架:RH-Partial2Global是Partial2Global的改进版本,整体框架沿用了Partial2Global的思路,但关键在于替代集构建和偏好对采样两个阶段的改进。首先,使用jackknife共形预测方法,为每个候选上下文示例构建一个更可靠的替代集。然后,采用覆盖设计方法,从所有可能的成对偏好中选择一个具有代表性的子集进行采样,以确保对偏好关系的全面覆盖。最后,基于采样的偏好关系,构建全局排序,并选择最优的上下文示例。

关键创新:RH-Partial2Global的关键创新在于以下两点:一是使用jackknife共形预测来构建可靠的替代集,这使得替代集更加可信,从而提升了偏好预测的准确性。二是采用覆盖设计进行偏好对采样,这保证了对所有可能的偏好关系进行充分且均匀的覆盖,避免了随机采样带来的不完整性和冗余性。与Partial2Global相比,RH-Partial2Global在替代集构建和偏好对采样方面都进行了改进,从而提升了上下文示例选择的可靠性和全面性。

关键设计:在jackknife共形预测中,需要选择合适的置信水平(confidence level),以控制替代集的大小和可靠性。在覆盖设计中,需要选择合适的覆盖数组(covering array),以确保对所有可能的偏好关系进行充分覆盖。具体的参数设置需要根据具体的任务和数据集进行调整。论文中可能给出了实验中使用的具体参数值。

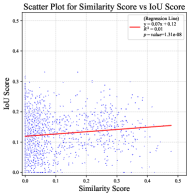

🖼️ 关键图片

📊 实验亮点

实验结果表明,RH-Partial2Global在多个视觉任务上显著优于Partial2Global。具体的性能提升幅度取决于具体的任务和数据集,但总体而言,RH-Partial2Global能够有效地提升视觉上下文学习的性能。论文中可能给出了具体的性能数据和对比结果。

🎯 应用场景

该研究成果可应用于各种视觉上下文学习任务,例如图像分类、目标检测、图像分割等。通过更可靠和全面的上下文示例选择,可以提升视觉基础模型在新任务上的适应能力和泛化性能。该方法在实际应用中具有重要价值,例如在医疗图像分析、自动驾驶、机器人视觉等领域。

📄 摘要(原文)

Visual In-Context Learning (VICL) has emerged as a prominent approach for adapting visual foundation models to novel tasks, by effectively exploiting contextual information embedded in in-context examples, which can be formulated as a global ranking problem of potential candidates. Current VICL methods, such as Partial2Global and VPR, are grounded in the similarity-priority assumption that images more visually similar to a query image serve as better in-context examples. This foundational assumption, while intuitive, lacks sufficient justification for its efficacy in selecting optimal in-context examples. Furthermore, Partial2Global constructs its global ranking from a series of randomly sampled pairwise preference predictions. Such a reliance on random sampling can lead to incomplete coverage and redundant samplings of comparisons, thus further adversely impacting the final global ranking. To address these issues, this paper introduces an enhanced variant of Partial2Global designed for reliable and holistic selection of in-context examples in VICL. Our proposed method, dubbed RH-Partial2Global, leverages a jackknife conformal prediction-guided strategy to construct reliable alternative sets and a covering design-based sampling approach to ensure comprehensive and uniform coverage of pairwise preferences. Extensive experiments demonstrate that RH-Partial2Global achieves excellent performance and outperforms Partial2Global across diverse visual tasks.