PinPoint3D: Fine-Grained 3D Part Segmentation from a Few Clicks

作者: Bojun Zhang, Hangjian Ye, Hao Zheng, Jianzheng Huang, Zhengyu Lin, Zhenhong Guo, Feng Zheng

分类: cs.CV

发布日期: 2025-09-30

备注: 15 pages, 12 figures, conference

💡 一句话要点

PinPoint3D:提出一种基于少量点击的精细3D部件分割交互式框架

🎯 匹配领域: 支柱一:机器人控制 (Robot Control) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 3D部件分割 交互式分割 点云处理 数据合成 具身智能

📋 核心要点

- 现有交互式3D分割方法局限于粗糙的实例级目标,非交互式方法难以处理真实场景稀疏点云,且缺乏标注数据。

- PinPoint3D通过少量用户点击实现精细、多粒度的3D部件分割,并提出新的3D数据合成流程生成大规模标注数据集。

- 实验表明,PinPoint3D显著优于现有方法,首次点击IoU达55.8%,少量额外点击超过71.3%,IoU和精度提升高达16%。

📝 摘要(中文)

精细的3D部件分割对于使具身智能系统执行复杂的操纵任务至关重要,例如与物体的特定功能组件交互。然而,现有的交互式分割方法主要局限于粗糙的实例级目标,而非交互式方法则难以处理稀疏的真实世界扫描,并且严重缺乏标注数据。为了解决这些限制,我们引入了PinPoint3D,这是一个新颖的交互式框架,用于精细的、多粒度的3D分割,能够仅通过几次用户点击生成精确的部件级掩码。我们工作的关键组成部分是一个新的3D数据合成流程,我们开发该流程是为了创建一个具有密集部件注释的大规模场景级数据集,从而克服了阻碍该领域进展的关键瓶颈。通过全面的实验和用户研究,我们证明了我们的方法显著优于现有方法,在首次点击设置下,每个对象部件的平均IoU约为55.8%,并且仅需几次额外的点击即可超过71.3%的IoU。与当前最先进的基线相比,PinPoint3D在IoU和精度方面提高了高达16%,突出了其在具有高效率的、具有挑战性的稀疏点云上的有效性。我们的工作代表了在复杂3D环境中实现更细致和精确的机器感知和交互的重要一步。

🔬 方法详解

问题定义:论文旨在解决精细3D部件分割问题,现有方法在交互式分割方面精度不足,非交互式分割则受限于数据稀疏和标注缺乏,难以应用于真实场景。因此,需要一种能够利用少量交互信息,在稀疏点云上实现高精度部件分割的方法。

核心思路:论文的核心思路是结合交互式分割的优势,通过少量用户点击引导分割过程,同时利用合成数据进行预训练,克服真实数据标注不足的问题。通过这种方式,模型能够学习到更鲁棒的部件特征,并根据用户交互进行精细调整。

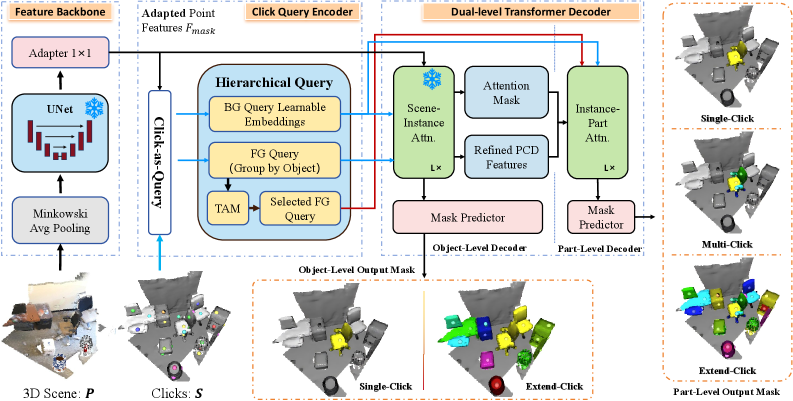

技术框架:PinPoint3D框架主要包含数据合成模块、特征提取模块和分割模块。数据合成模块负责生成大规模的带有精细部件标注的3D场景数据。特征提取模块用于提取点云的几何特征和语义特征。分割模块则根据提取的特征和用户点击信息,预测每个点的部件标签。整体流程是:首先利用合成数据预训练模型,然后在真实数据上进行微调,最后通过用户交互进行分割优化。

关键创新:论文的关键创新在于提出了一个端到端的交互式精细部件分割框架,并设计了一个新的3D数据合成流程,有效解决了真实数据标注不足的问题。此外,该方法能够利用少量用户点击实现高精度的部件分割,显著提高了分割效率。

关键设计:数据合成流程中,论文采用了程序化建模和随机参数调整的方法,生成了多样化的3D场景数据。在特征提取模块中,使用了PointNet++等网络结构提取点云特征。分割模块采用了基于图神经网络的方法,利用点之间的关系进行分割优化。损失函数包括交叉熵损失和对比损失,用于提高分割精度和鲁棒性。

🖼️ 关键图片

📊 实验亮点

PinPoint3D在精细3D部件分割任务上取得了显著成果。在首次点击设置下,每个对象部件的平均IoU达到55.8%,仅需几次额外点击即可超过71.3%。与当前最先进的基线相比,PinPoint3D在IoU和精度方面提高了高达16%,证明了其在处理稀疏点云时的有效性和高效性。

🎯 应用场景

PinPoint3D可应用于机器人操作、虚拟现实、增强现实、3D内容创作等领域。例如,机器人可以利用该技术识别并操作物体的特定部件,从而完成更复杂的任务。在VR/AR中,用户可以交互式地分割和编辑3D模型,提高用户体验。该研究有助于推动具身智能的发展,实现更智能、更自然的3D交互。

📄 摘要(原文)

Fine-grained 3D part segmentation is crucial for enabling embodied AI systems to perform complex manipulation tasks, such as interacting with specific functional components of an object. However, existing interactive segmentation methods are largely confined to coarse, instance-level targets, while non-interactive approaches struggle with sparse, real-world scans and suffer from a severe lack of annotated data. To address these limitations, we introduce PinPoint3D, a novel interactive framework for fine-grained, multi-granularity 3D segmentation, capable of generating precise part-level masks from only a few user point clicks. A key component of our work is a new 3D data synthesis pipeline that we developed to create a large-scale, scene-level dataset with dense part annotations, overcoming a critical bottleneck that has hindered progress in this field. Through comprehensive experiments and user studies, we demonstrate that our method significantly outperforms existing approaches, achieving an average IoU of around 55.8% on each object part under first-click settings and surpassing 71.3% IoU with only a few additional clicks. Compared to current state-of-the-art baselines, PinPoint3D yields up to a 16% improvement in IoU and precision, highlighting its effectiveness on challenging, sparse point clouds with high efficiency. Our work represents a significant step towards more nuanced and precise machine perception and interaction in complex 3D environments.