PatchEAD: Unifying Industrial Visual Prompting Frameworks for Patch-Exclusive Anomaly Detection

作者: Po-Han Huang, Jeng-Lin Li, Po-Hsuan Huang, Ming-Ching Chang, Wei-Chao Chen

分类: cs.CV

发布日期: 2025-09-30 (更新: 2026-01-22)

备注: 10 pages, 5 figures. WACV 2026 (Accepted)

💡 一句话要点

PatchEAD:统一的工业视觉提示框架,用于补丁互斥异常检测

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 工业异常检测 视觉提示学习 免训练学习 图像补丁 基础模型

📋 核心要点

- 现有工业异常检测方法依赖基础模型,但视觉提示部分缺乏统一框架,限制了模型泛化能力。

- PatchEAD框架通过对齐模块和前景掩蔽构建视觉提示,实现与多种基础模型兼容的免训练异常检测。

- 实验表明,PatchEAD在少量样本和批量零样本异常检测中优于现有方法,且无需文本特征。

📝 摘要(中文)

工业异常检测越来越多地依赖于基础模型,以期在实际部署中实现强大的分布外泛化和快速适应。然而,过去的研究主要集中在文本提示调优上,而内在的视觉对应部分则被分割成特定于每个基础模型的处理步骤。为了解决这一局限性,我们提出了一个统一的、以补丁为中心的框架,即补丁互斥异常检测(PatchEAD),从而实现与各种基础模型兼容的免训练异常检测。该框架构建了视觉提示技术,包括对齐模块和前景掩蔽。实验表明,与之前的工作相比,我们的方法在少量样本和批量零样本性能方面表现更优,尽管没有使用文本特征。我们的研究进一步考察了骨干网络结构和预训练特征如何影响补丁相似性的鲁棒性,为选择和配置用于实际视觉检测的基础模型提供了可操作的指导。这些结果证实,一个良好统一的纯补丁框架可以实现快速、轻量级的校准部署,而无需精心设计的文本提示。

🔬 方法详解

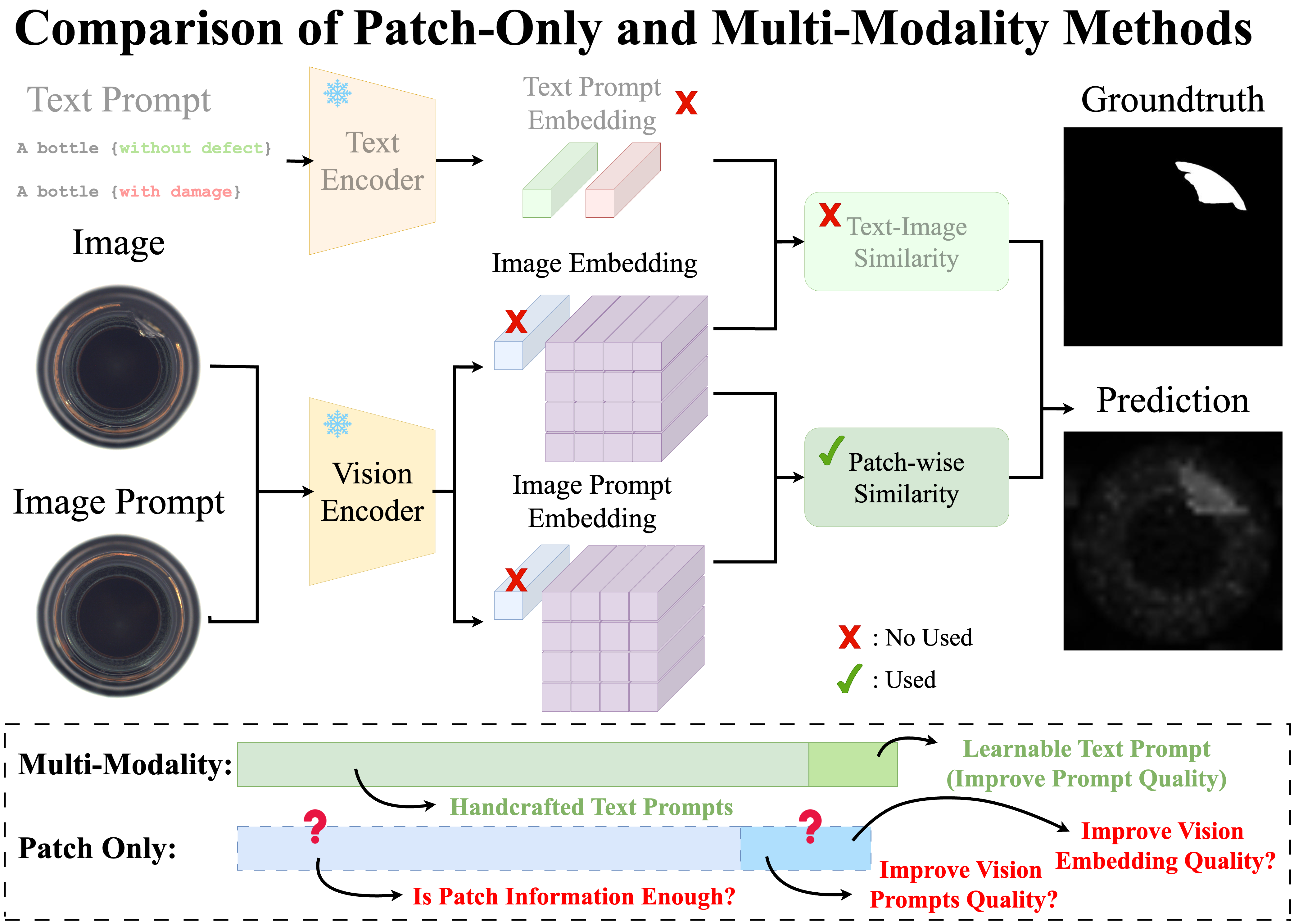

问题定义:现有工业异常检测方法依赖于预训练的基础模型,但针对不同模型,视觉提示的构建方式各不相同,缺乏统一的框架。这导致需要针对每个基础模型进行定制化的开发和调试,限制了模型的通用性和部署效率。此外,现有方法过度依赖文本提示,忽略了纯视觉信息在异常检测中的潜力。

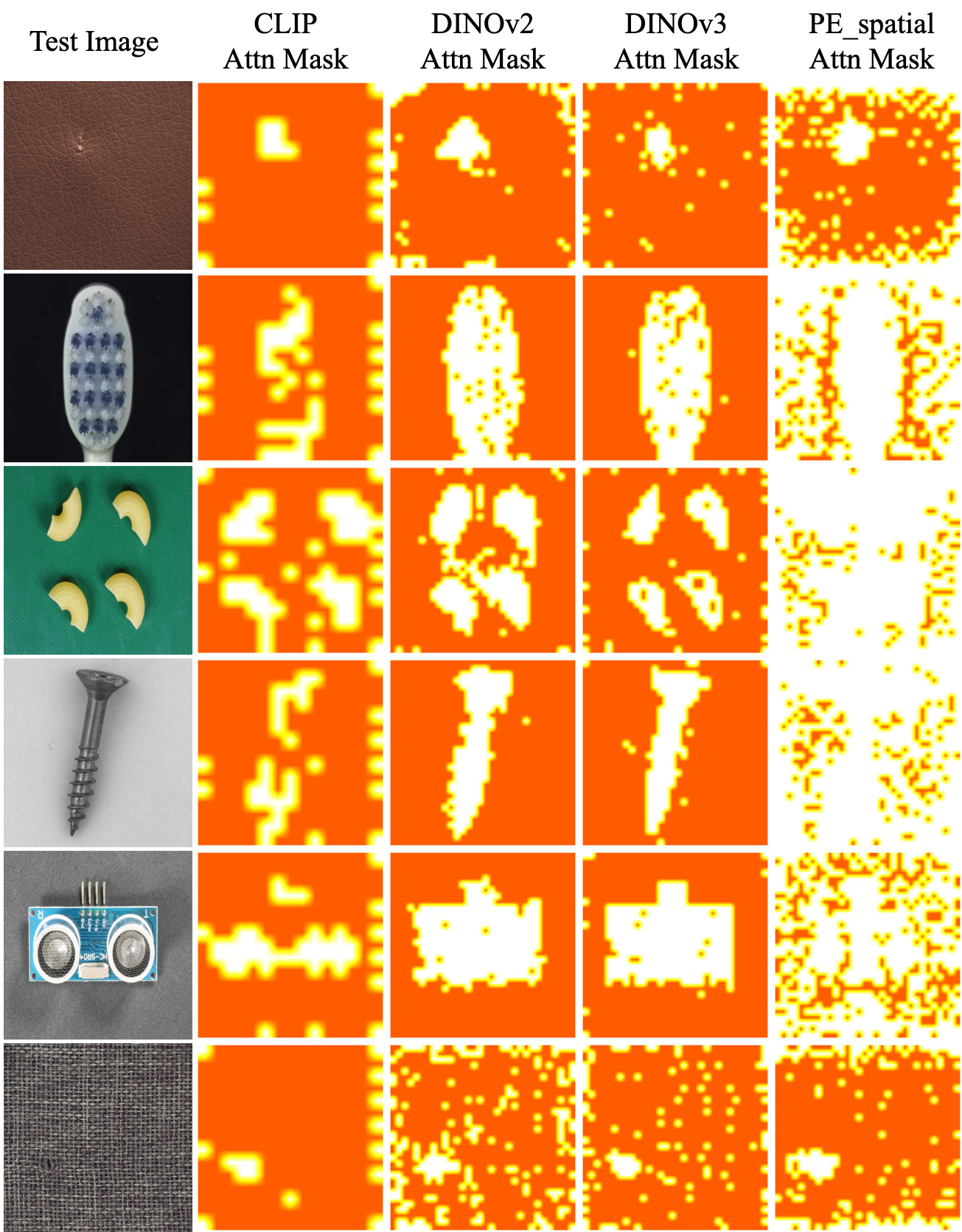

核心思路:PatchEAD的核心思路是构建一个统一的、基于图像补丁的视觉提示框架,该框架能够兼容不同的基础模型,并且无需文本提示即可实现高效的异常检测。通过对图像进行补丁划分,并利用预训练模型的特征提取能力,提取每个补丁的特征向量。然后,通过对齐模块和前景掩蔽等技术,增强正常样本的特征一致性,从而更容易区分异常样本。

技术框架:PatchEAD框架主要包含以下几个模块:1) 图像补丁划分:将输入图像划分为多个小的图像补丁。2) 特征提取:利用预训练的基础模型提取每个图像补丁的特征向量。3) 对齐模块:对齐不同图像补丁的特征向量,增强特征的一致性。4) 前景掩蔽:通过掩蔽图像的前景区域,减少前景信息对异常检测的影响。5) 异常评分:计算每个图像补丁的异常分数,并根据异常分数判断图像是否包含异常。

关键创新:PatchEAD的关键创新在于提出了一个统一的、基于图像补丁的视觉提示框架,该框架能够兼容不同的基础模型,并且无需文本提示即可实现高效的异常检测。与现有方法相比,PatchEAD更加通用、灵活,并且能够充分利用纯视觉信息进行异常检测。

关键设计:PatchEAD的关键设计包括:1) 对齐模块的设计:采用注意力机制对齐不同图像补丁的特征向量,增强特征的一致性。2) 前景掩蔽的设计:根据图像的语义信息,自动生成前景掩蔽,减少前景信息对异常检测的影响。3) 异常评分的设计:采用基于距离的异常评分方法,计算每个图像补丁的异常分数。

🖼️ 关键图片

📊 实验亮点

实验结果表明,PatchEAD在MVTec AD数据集上取得了优异的性能,在少量样本和批量零样本设置下均优于现有方法。例如,在MVTec AD数据集上,PatchEAD的平均AUROC达到了98%以上,相比于现有方法提升了2-3个百分点。此外,研究还分析了骨干网络结构和预训练特征对补丁相似性鲁棒性的影响,为实际应用中基础模型的选择提供了指导。

🎯 应用场景

PatchEAD可广泛应用于工业制造领域的缺陷检测、产品质量控制等场景。例如,可用于检测电路板上的缺陷、识别产品表面的划痕或污渍等。该框架能够降低对人工标注数据的依赖,实现快速部署和自动化检测,提高生产效率和产品质量,具有重要的实际应用价值和商业前景。

📄 摘要(原文)

Industrial anomaly detection is increasingly relying on foundation models, aiming for strong out-of-distribution generalization and rapid adaptation in real-world deployments. Notably, past studies have primarily focused on textual prompt tuning, leaving the intrinsic visual counterpart fragmented into processing steps specific to each foundation model. We aim to address this limitation by proposing a unified patch-focused framework, Patch-Exclusive Anomaly Detection (PatchEAD), enabling training-free anomaly detection that is compatible with diverse foundation models. The framework constructs visual prompting techniques, including an alignment module and foreground masking. Our experiments show superior few-shot and batch zero-shot performance compared to prior work, despite the absence of textual features. Our study further examines how backbone structure and pretrained characteristics affect patch-similarity robustness, providing actionable guidance for selecting and configuring foundation models for real-world visual inspection. These results confirm that a well-unified patch-only framework can enable quick, calibration-light deployment without the need for carefully engineered textual prompts.