Editable Noise Map Inversion: Encoding Target-image into Noise For High-Fidelity Image Manipulation

作者: Mingyu Kang, Yong Suk Choi

分类: cs.CV, cs.AI

发布日期: 2025-09-30 (更新: 2025-10-27)

备注: ICML 2025

💡 一句话要点

提出可编辑噪声图反演(ENM Inversion),提升扩散模型图像编辑的保真度和可编辑性。

🎯 匹配领域: 支柱一:机器人控制 (Robot Control)

关键词: 扩散模型 图像编辑 噪声图反演 文本引导 可编辑性

📋 核心要点

- 现有图像编辑反演方法难以在保持源图像内容的同时,保证编辑结果与目标文本提示的高度一致性。

- ENM Inversion通过搜索最优噪声图,并引入可编辑噪声细化模块,实现内容保持和编辑灵活性的平衡。

- 实验结果表明,ENM Inversion在图像和视频编辑任务中,显著提升了编辑结果的保真度和与目标提示的一致性。

📝 摘要(中文)

本文提出了一种名为可编辑噪声图反演(ENM Inversion)的新型反演技术,旨在解决文本到图像扩散模型在图像编辑中,现有反演方法难以同时兼顾内容保持和目标文本提示一致性的问题。现有方法虽然能够忠实地重建源图像,但反演得到的噪声图限制了编辑的灵活性。ENM Inversion通过搜索最优噪声图,确保内容保持和可编辑性。该方法分析了噪声图的属性以增强可编辑性,并引入可编辑噪声细化模块,通过最小化重建噪声图和编辑噪声图之间的差异,使噪声图与期望的编辑对齐。大量实验表明,ENM Inversion在各种图像编辑任务中,在保持源图像内容和编辑结果与目标提示的保真度方面,均优于现有方法。该方法还可轻松应用于视频编辑,实现跨帧的时间一致性和内容操作。

🔬 方法详解

问题定义:现有基于扩散模型的图像编辑方法,在将源图像反演为噪声图的过程中,往往难以兼顾源图像的内容保持和编辑后的目标文本提示一致性。反演得到的噪声图虽然能够忠实重建源图像,但同时也限制了后续编辑操作的灵活性,导致编辑结果与目标文本提示存在偏差。

核心思路:ENM Inversion的核心思路是寻找一个“最优”的噪声图,这个噪声图既能够较好地重建源图像,又能够为后续的编辑操作提供足够的灵活性,从而保证编辑结果与目标文本提示的高度一致性。通过优化噪声图,使得模型在编辑时能够更好地响应目标文本的引导。

技术框架:ENM Inversion主要包含两个阶段:噪声图初始化和可编辑噪声细化。首先,使用现有的反演方法初始化噪声图。然后,通过可编辑噪声细化模块,迭代地优化噪声图,使其既能够保持源图像的内容,又能够更好地适应目标文本提示。该模块通过最小化重建噪声图和编辑噪声图之间的差异来实现。

关键创新:ENM Inversion的关键创新在于提出了可编辑噪声细化模块,该模块能够根据目标文本提示,对噪声图进行精细的调整,从而提高编辑结果的保真度和与目标提示的一致性。与现有方法相比,ENM Inversion更加注重噪声图的可编辑性,而不是仅仅追求源图像的重建精度。

关键设计:可编辑噪声细化模块的关键设计在于损失函数的设计。该损失函数包含两部分:一部分用于保持源图像的内容,另一部分用于保证编辑结果与目标文本提示的一致性。具体来说,可以使用L1或L2损失来衡量重建噪声图和编辑噪声图之间的差异,并使用CLIP损失来衡量编辑结果与目标文本提示之间的语义相似度。此外,还可以使用一些正则化项来约束噪声图的平滑性,从而提高编辑结果的视觉质量。

🖼️ 关键图片

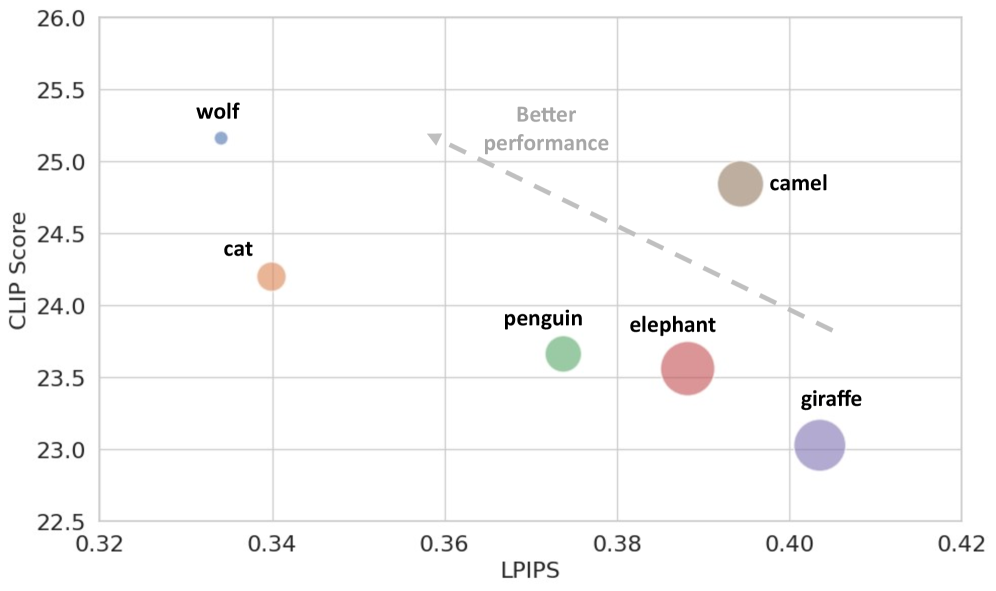

📊 实验亮点

实验结果表明,ENM Inversion在图像编辑任务中,显著优于现有的反演方法。在内容保持和编辑保真度方面,ENM Inversion均取得了更好的效果。例如,在文本引导的图像编辑任务中,ENM Inversion能够生成与目标文本提示更加一致的图像,同时保持源图像的结构和细节。此外,ENM Inversion在视频编辑任务中也表现出良好的时间一致性。

🎯 应用场景

ENM Inversion在图像编辑、视频编辑等领域具有广泛的应用前景。例如,可以用于生成具有特定风格或内容的图像,修复老旧照片,以及对视频内容进行修改和增强。该技术还可以应用于创意设计、广告制作、游戏开发等领域,为用户提供更加灵活和高效的图像编辑工具。

📄 摘要(原文)

Text-to-image diffusion models have achieved remarkable success in generating high-quality and diverse images. Building on these advancements, diffusion models have also demonstrated exceptional performance in text-guided image editing. A key strategy for effective image editing involves inverting the source image into editable noise maps associated with the target image. However, previous inversion methods face challenges in adhering closely to the target text prompt. The limitation arises because inverted noise maps, while enabling faithful reconstruction of the source image, restrict the flexibility needed for desired edits. To overcome this issue, we propose Editable Noise Map Inversion (ENM Inversion), a novel inversion technique that searches for optimal noise maps to ensure both content preservation and editability. We analyze the properties of noise maps for enhanced editability. Based on this analysis, our method introduces an editable noise refinement that aligns with the desired edits by minimizing the difference between the reconstructed and edited noise maps. Extensive experiments demonstrate that ENM Inversion outperforms existing approaches across a wide range of image editing tasks in both preservation and edit fidelity with target prompts. Our approach can also be easily applied to video editing, enabling temporal consistency and content manipulation across frames.