ProbMed: A Probabilistic Framework for Medical Multimodal Binding

作者: Yuan Gao, Sangwook Kim, Jianzhong You, Chris McIntosh

分类: cs.CV

发布日期: 2025-09-30

备注: ICCV 2025

💡 一句话要点

ProbMED:提出概率多模态医学绑定框架,提升医学决策支持。

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 多模态学习 医学影像 自然语言处理 概率模型 对比学习 医学诊断 预训练模型

📋 核心要点

- 现有医学视觉-语言预训练模型难以处理医学数据多模态间多对多的复杂关系。

- ProbMED通过概率对比学习建模模态嵌入分布,实现多模态医学信息的有效融合。

- 实验表明,ProbMED在跨模态检索、零样本和少样本分类等任务上显著优于现有模型。

📝 摘要(中文)

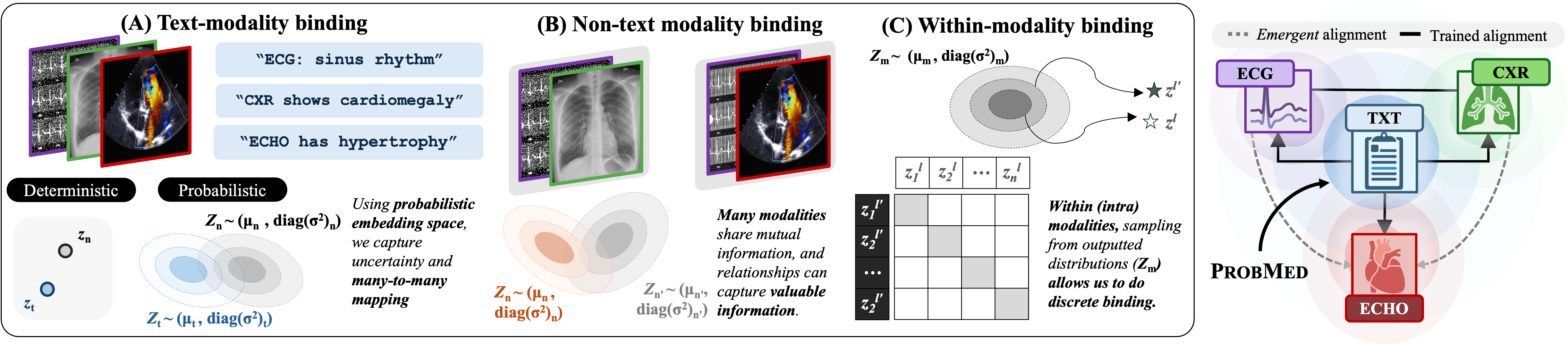

医学决策需要整合来自影像和临床叙述等多种医学信息,这些模态通常以多对多的方式获取。然而,现有的医学视觉-语言预训练模型(Med-VLPMs)未能直接在其模型训练和嵌入中考虑这种多对多映射。为了解决这个问题,我们提出了概率模态增强诊断(ProbMED),这是一种多模态Med-VLPM,它采用概率对比学习来对嵌入上的分布进行建模,而不是确定性估计。ProbMED将四种不同的模态——胸部X光片、心电图、超声心动图和临床文本——对齐到一个统一的概率嵌入空间中。我们使用带有Hellinger距离的InfoNCE损失来整合模态间分布。我们引入了一种概率合成采样损失,该损失捕获模态特定的均值和方差,以改善模态内绑定。在13个医学数据集上的大量实验表明,我们的模型在跨模态检索、零样本和少样本分类方面优于当前的Med-VLPM。我们还展示了多种模态的鲁棒集成用于预后,显示出改进的模态内和模态间医学绑定。

🔬 方法详解

问题定义:现有的医学视觉-语言预训练模型(Med-VLPMs)在处理多模态医学数据时,无法有效建模模态间多对多的复杂关系。这些模型通常采用确定性的嵌入方式,忽略了数据本身的不确定性和模态间的关联性,限制了模型在跨模态理解和推理方面的能力。

核心思路:ProbMED的核心思路是将医学模态的嵌入表示从确定性的向量转换为概率分布。通过对嵌入分布进行建模,可以更好地捕捉模态数据的不确定性和模态间的关联性。利用概率对比学习,ProbMED能够学习到更鲁棒、更具表达能力的模态表示,从而提升模型在多模态医学任务中的性能。

技术框架:ProbMED的整体框架包括以下几个主要模块:1) 多模态编码器:用于提取来自不同医学模态(如胸部X光片、心电图、超声心动图和临床文本)的特征表示。2) 概率嵌入层:将编码器的输出转换为概率分布,例如高斯分布,其中包含均值和方差信息。3) 概率对比学习:使用InfoNCE损失和Hellinger距离来对齐不同模态的概率分布,从而实现跨模态的知识迁移。4) 概率合成采样损失:通过合成新的样本来增强模态内的绑定,提高模型的泛化能力。

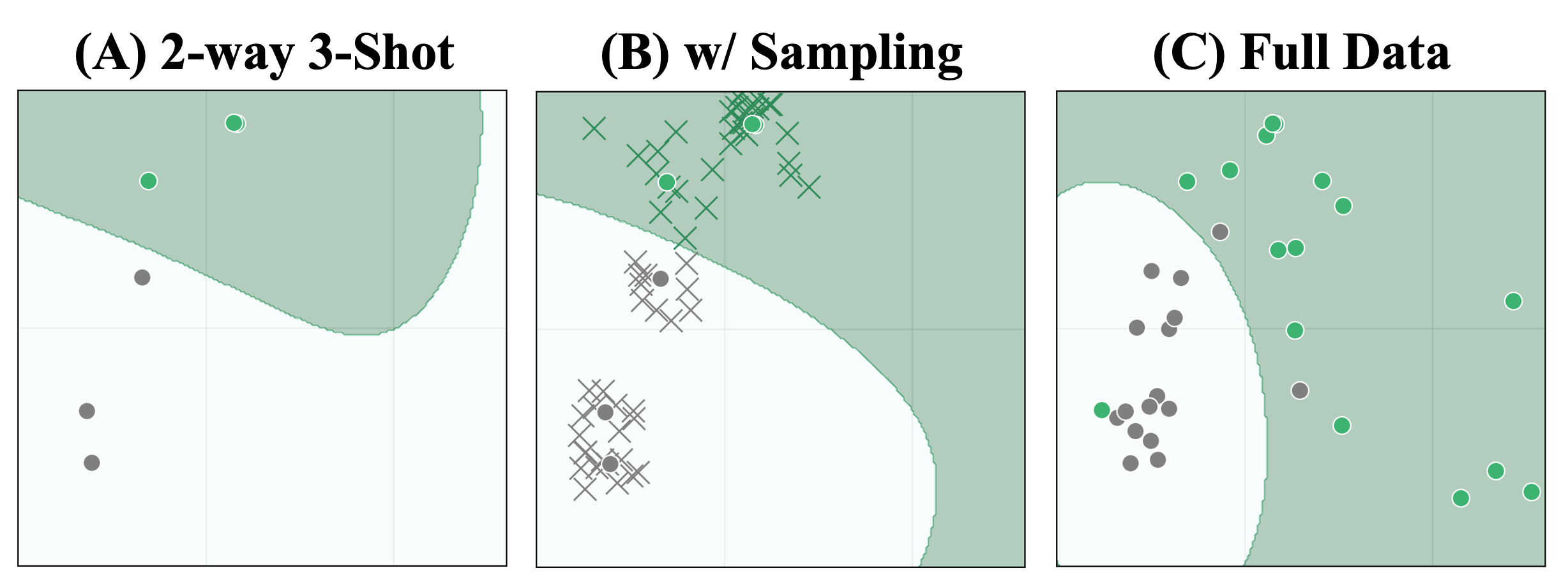

关键创新:ProbMED最重要的技术创新在于其概率建模方法。与传统的确定性嵌入方法不同,ProbMED将每个模态的表示建模为一个概率分布,从而能够更好地捕捉数据的不确定性和模态间的关联性。此外,ProbMED还引入了一种概率合成采样损失,通过合成新的样本来增强模态内的绑定,进一步提高了模型的性能。

关键设计:ProbMED的关键设计包括:1) 使用InfoNCE损失和Hellinger距离来衡量不同模态概率分布之间的相似性。Hellinger距离能够更好地度量概率分布之间的差异,从而提升对比学习的效果。2) 概率合成采样损失通过对模态特定的均值和方差进行采样,生成新的样本,从而增强模态内的绑定。3) 模型使用了预训练的医学语言模型和视觉模型作为初始化,加速了模型的训练过程。

🖼️ 关键图片

📊 实验亮点

ProbMED在13个医学数据集上进行了广泛的实验,结果表明,ProbMED在跨模态检索、零样本和少样本分类等任务上显著优于现有的Med-VLPMs。例如,在跨模态检索任务中,ProbMED的Recall@1指标平均提升了5%以上。此外,ProbMED在预后预测任务中也表现出优异的性能,证明了其在多模态医学数据集成方面的有效性。

🎯 应用场景

ProbMED在医学诊断、预后预测和个性化治疗方面具有广泛的应用前景。通过整合多种医学模态的信息,ProbMED可以为医生提供更全面、更准确的诊断依据,辅助医生进行决策。此外,ProbMED还可以用于预测患者的病情发展趋势,为患者制定个性化的治疗方案,提高治疗效果。

📄 摘要(原文)

Medical decision-making requires integrating diverse medical information, from imaging to clinical narratives. These medical modalities are often acquired in a many-to-many manner. However, current medical vision-language pretraining models (Med-VLPMs) fail to directly account for this many-to-many mapping in their model training and embeddings. To address this, we present Probabilistic Modality-Enhanced Diagnosis (ProbMED), a multimodal Med-VLPM that employs probabilistic contrastive learning to model distributions over embeddings rather than deterministic estimates. ProbMED aligns four distinct modalities -- chest X-rays, electrocardiograms, echocardiograms, and clinical text -- into a unified probabilistic embedding space. We use InfoNCE loss with Hellinger distance to integrate inter-modality distributions. We introduce a probabilistic synthetic sampling loss that captures modality-specific mean and variance to improve intra-modality binding. Extensive experiments across 13 medical datasets demonstrate that our model outperforms current Med-VLPMs in cross-modality retrieval, zero-shot, and few-shot classification. We also demonstrate the robust integration of multiple modalities for prognostication, showing improved intra- and inter-medical modality binding.