Rolling Forcing: Autoregressive Long Video Diffusion in Real Time

作者: Kunhao Liu, Wenbo Hu, Jiale Xu, Ying Shan, Shijian Lu

分类: cs.CV

发布日期: 2025-09-29

备注: Project page: https://kunhao-liu.github.io/Rolling_Forcing_Webpage/

💡 一句话要点

提出 Rolling Forcing,实现实时自回归长视频扩散生成,显著降低误差累积。

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture)

关键词: 流式视频生成 长视频生成 自回归模型 扩散模型 误差累积 注意力机制 实时生成 联合去噪

📋 核心要点

- 现有流式视频生成方法易产生误差累积,导致长视频质量下降,难以满足实时性需求。

- Rolling Forcing 通过联合去噪、注意力汇聚和高效训练,抑制误差累积,保持长期一致性。

- 实验表明,Rolling Forcing 能够在单 GPU 上实时生成多分钟视频,显著降低误差累积。

📝 摘要(中文)

流式视频生成是交互式世界模型和神经游戏引擎中的一个基本组成部分,旨在生成高质量、低延迟和时间上连贯的长视频流。然而,现有的大多数工作都存在严重的误差累积问题,这通常会显著降低生成视频流的质量。本文设计了一种名为 Rolling Forcing 的新型视频生成技术,该技术能够以最小的误差累积实现流式长视频生成。Rolling Forcing 包含三个新颖的设计:首先,我们设计了一种联合去噪方案,该方案同时对多个具有逐渐增加噪声水平的帧进行去噪,而不是迭代地对单个帧进行采样,从而加速误差传播。这种设计放宽了相邻帧之间的严格因果关系,有效地抑制了误差增长。其次,我们将注意力汇聚机制引入到长时程流视频生成任务中,这使得模型能够保持初始帧的关键值状态作为全局上下文锚点,从而增强长期全局一致性。第三,我们设计了一种高效的训练算法,该算法能够在很大程度上扩展去噪窗口上进行少步蒸馏。该算法在非重叠窗口上运行,并减轻了以自生成历史为条件的暴露偏差。大量的实验表明,Rolling Forcing 能够在单个 GPU 上实现多分钟视频的实时流式生成,并显著减少误差累积。

🔬 方法详解

问题定义:论文旨在解决流式视频生成中长期误差累积的问题。现有方法通常逐帧生成视频,导致误差随着时间累积,最终影响生成视频的质量和连贯性。此外,实时性也是一个挑战,需要高效的生成方法。

核心思路:Rolling Forcing 的核心思路是通过联合去噪多个帧来减少误差累积,并利用注意力机制保持长期一致性。通过同时处理多个帧,模型可以更好地理解帧之间的关系,从而减少误差传播。注意力机制则允许模型关注初始帧的信息,从而保持全局一致性。

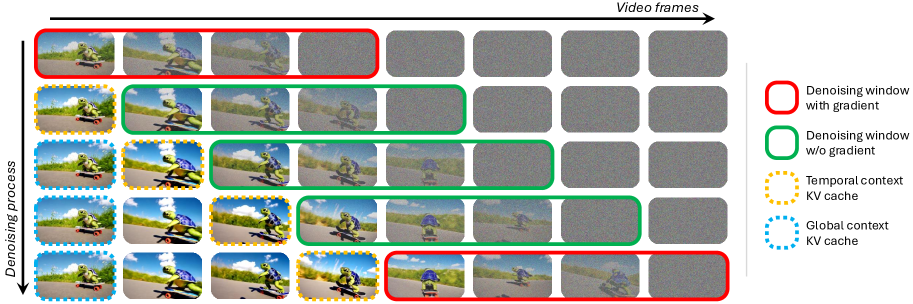

技术框架:Rolling Forcing 的整体框架包括以下几个主要模块:1) 联合去噪模块:同时对多个帧进行去噪,这些帧具有逐渐增加的噪声水平。2) 注意力汇聚模块:将初始帧的关键值状态作为全局上下文锚点,用于增强长期全局一致性。3) 训练算法:采用非重叠窗口上的少步蒸馏,以减轻暴露偏差。

关键创新:Rolling Forcing 的关键创新在于以下几点:1) 联合去噪方案:与逐帧生成相比,联合去噪可以减少误差累积。2) 注意力汇聚机制:通过关注初始帧的信息,可以保持长期一致性。3) 高效训练算法:少步蒸馏可以加速训练过程,并减轻暴露偏差。

关键设计:在联合去噪模块中,噪声水平逐渐增加,允许模型逐步恢复帧的细节。注意力汇聚模块使用标准的注意力机制,但关键在于将初始帧的信息作为全局上下文。训练算法采用非重叠窗口,以避免梯度消失或爆炸的问题。具体的损失函数和网络结构细节在论文中未明确说明,属于未知信息。

🖼️ 关键图片

📊 实验亮点

实验结果表明,Rolling Forcing 能够在单个 GPU 上实现多分钟视频的实时流式生成,并显著减少误差累积。具体的性能数据和对比基线在摘要中没有明确给出,属于未知信息。但强调了在实时性和误差累积方面的显著改进。

🎯 应用场景

Rolling Forcing 在交互式世界模型、神经游戏引擎、虚拟现实、视频会议等领域具有广泛的应用前景。它可以用于生成高质量、低延迟和时间上连贯的长视频流,从而提升用户体验。例如,在虚拟现实中,它可以用于生成逼真的虚拟环境;在视频会议中,它可以用于生成高质量的虚拟化身。

📄 摘要(原文)

Streaming video generation, as one fundamental component in interactive world models and neural game engines, aims to generate high-quality, low-latency, and temporally coherent long video streams. However, most existing work suffers from severe error accumulation that often significantly degrades the generated stream videos over long horizons. We design Rolling Forcing, a novel video generation technique that enables streaming long videos with minimal error accumulation. Rolling Forcing comes with three novel designs. First, instead of iteratively sampling individual frames, which accelerates error propagation, we design a joint denoising scheme that simultaneously denoises multiple frames with progressively increasing noise levels. This design relaxes the strict causality across adjacent frames, effectively suppressing error growth. Second, we introduce the attention sink mechanism into the long-horizon stream video generation task, which allows the model to keep key value states of initial frames as a global context anchor and thereby enhances long-term global consistency. Third, we design an efficient training algorithm that enables few-step distillation over largely extended denoising windows. This algorithm operates on non-overlapping windows and mitigates exposure bias conditioned on self-generated histories. Extensive experiments show that Rolling Forcing enables real-time streaming generation of multi-minute videos on a single GPU, with substantially reduced error accumulation.