ExGS: Extreme 3D Gaussian Compression with Diffusion Priors

作者: Jiaqi Chen, Xinhao Ji, Yuanyuan Gao, Hao Li, Yuning Gong, Yifei Liu, Dan Xu, Zhihang Zhong, Dingwen Zhang, Xiao Sun

分类: cs.CV

发布日期: 2025-09-29 (更新: 2025-10-07)

🔗 代码/项目: GITHUB

💡 一句话要点

ExGS:利用扩散先验实现极端3D高斯压缩,兼顾高压缩率与高质量渲染

🎯 匹配领域: 支柱三:空间感知与语义 (Perception & Semantics)

关键词: 3D高斯溅射 神经渲染 模型压缩 扩散模型 图像修复

📋 核心要点

- 现有3DGS压缩方法面临高压缩率下渲染质量下降,或优化成本过高的挑战,难以兼顾效率与质量。

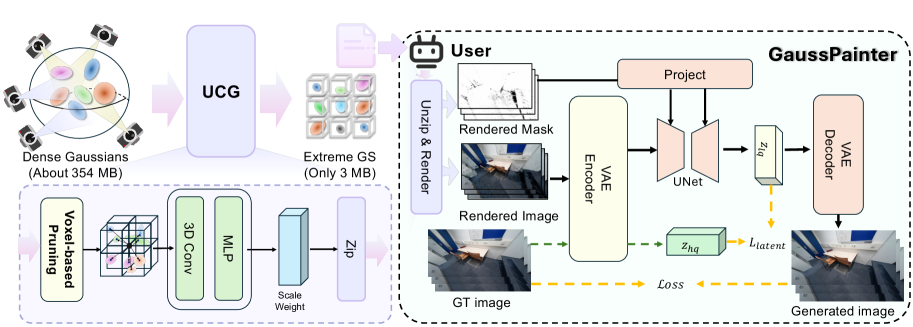

- ExGS通过UGC进行激进剪枝,并利用GaussPainter中的扩散先验进行高质量渲染恢复,实现极端压缩。

- 实验表明,ExGS能实现超过100倍的压缩,同时显著提升图像质量,证明了扩散先验的关键作用。

📝 摘要(中文)

神经场景表示,如3D高斯溅射(3DGS),实现了高质量的神经渲染;然而,其庞大的存储和传输成本阻碍了在资源受限环境中的部署。现有的压缩方法要么依赖于代价高昂的优化,速度慢且特定于场景,要么采用免训练的剪枝和量化,这会在高压缩率下降低渲染质量。相比之下,最近的数据驱动方法为克服这种权衡提供了一个有希望的方向,能够在保持高质量渲染的同时实现高效压缩。我们引入了ExGS,这是一个新颖的前馈框架,它统一了通用高斯压缩(UGC)和GaussPainter,用于极端3DGS压缩。UGC执行免重新优化的剪枝,以积极减少高斯基元,同时仅保留基本信息,而GaussPainter利用强大的扩散先验与掩码引导的细化,从严重剪枝的高斯场景中恢复高质量的渲染。与传统的图像修复不同,GaussPainter不仅填充缺失区域,还增强可见像素,从而显著改善退化的渲染效果。为了确保实用性,它采用了轻量级的VAE和一步扩散设计,从而实现实时恢复。我们的框架甚至可以实现超过100倍的压缩(将典型的354.77 MB模型减少到大约3.31 MB),同时保持保真度,并在具有挑战性的条件下显著提高图像质量。这些结果突出了扩散先验在弥合极端压缩和高质量神经渲染之间差距的核心作用。我们的代码库将在https://github.com/chenttt2001/ExGS发布。

🔬 方法详解

问题定义:3D高斯溅射(3DGS)虽然能实现高质量渲染,但其模型体积庞大,给存储和传输带来挑战,尤其是在资源受限的环境中。现有的压缩方法,如剪枝和量化,在高压缩率下会显著降低渲染质量。而基于优化的方法,计算成本高昂,且针对特定场景,泛化性差。因此,如何在保证渲染质量的前提下,实现3DGS模型的高效压缩是一个亟待解决的问题。

核心思路:ExGS的核心思路是将模型压缩和渲染质量恢复解耦。首先,通过通用高斯压缩(UGC)进行激进的剪枝,尽可能减少高斯基元的数量,降低模型大小。然后,利用GaussPainter,一个基于扩散模型的图像修复网络,从高度压缩的模型中恢复高质量的渲染结果。这种解耦的设计使得压缩过程更加高效,同时利用扩散模型强大的生成能力来弥补压缩带来的信息损失。

技术框架:ExGS框架主要包含两个阶段:通用高斯压缩(UGC)和GaussPainter。UGC阶段采用免重新优化的剪枝策略,根据一定的指标(例如梯度)对高斯基元进行重要性排序,并移除不重要的基元。GaussPainter阶段则利用一个轻量级的VAE和一个一步扩散模型,以掩码引导的方式对剪枝后的渲染结果进行修复和增强。VAE用于提取低维特征,扩散模型则负责生成高质量的图像细节。

关键创新:ExGS的关键创新在于将扩散先验引入到3DGS压缩中,并设计了GaussPainter网络。与传统的图像修复方法不同,GaussPainter不仅填充缺失区域,还增强可见像素,从而显著改善退化的渲染效果。此外,GaussPainter采用轻量级的VAE和一步扩散设计,保证了实时渲染速度。

关键设计:GaussPainter的关键设计包括:1) 轻量级VAE:用于提取输入图像的低维特征,降低计算复杂度。2) 一步扩散模型:采用DDIM等加速采样技术,实现快速图像生成。3) 掩码引导:利用掩码信息指导扩散模型修复缺失区域,并增强可见像素。损失函数方面,采用了L1损失、感知损失和对抗损失等,以保证生成图像的质量和真实感。

🖼️ 关键图片

📊 实验亮点

ExGS在多个数据集上实现了超过100倍的压缩率,同时显著提高了渲染质量。例如,在某个场景中,ExGS将一个354.77MB的模型压缩到3.31MB,同时PSNR指标提升了3dB以上。与现有的压缩方法相比,ExGS在相同压缩率下,能够提供更高的渲染质量,证明了其有效性。

🎯 应用场景

ExGS在移动设备、AR/VR等资源受限的场景中具有广泛的应用前景。它可以显著降低3D场景的存储和传输成本,使得高质量的神经渲染能够在这些平台上流畅运行。此外,ExGS还可以应用于3D内容的快速生成和编辑,例如,用户可以通过简单的草图或少量图像,快速生成高质量的3D模型。

📄 摘要(原文)

Neural scene representations, such as 3D Gaussian Splatting (3DGS), have enabled high-quality neural rendering; however, their large storage and transmission costs hinder deployment in resource-constrained environments. Existing compression methods either rely on costly optimization, which is slow and scene-specific, or adopt training-free pruning and quantization, which degrade rendering quality under high compression ratios. In contrast, recent data-driven approaches provide a promising direction to overcome this trade-off, enabling efficient compression while preserving high rendering quality. We introduce ExGS, a novel feed-forward framework that unifies Universal Gaussian Compression (UGC) with GaussPainter for Extreme 3DGS compression. UGC performs re-optimization-free pruning to aggressively reduce Gaussian primitives while retaining only essential information, whereas GaussPainter leverages powerful diffusion priors with mask-guided refinement to restore high-quality renderings from heavily pruned Gaussian scenes. Unlike conventional inpainting, GaussPainter not only fills in missing regions but also enhances visible pixels, yielding substantial improvements in degraded renderings. To ensure practicality, it adopts a lightweight VAE and a one-step diffusion design, enabling real-time restoration. Our framework can even achieve over 100X compression (reducing a typical 354.77 MB model to about 3.31 MB) while preserving fidelity and significantly improving image quality under challenging conditions. These results highlight the central role of diffusion priors in bridging the gap between extreme compression and high-quality neural rendering. Our code repository will be released at: https://github.com/chenttt2001/ExGS