Vid-LLM: A Compact Video-based 3D Multimodal LLM with Reconstruction-Reasoning Synergy

作者: Haijier Chen, Bo Xu, Shoujian Zhang, Haoze Liu, Jiaxuan Lin, Jingrong Wang

分类: cs.CV, cs.AI

发布日期: 2025-09-29

💡 一句话要点

Vid-LLM:提出一种基于视频的紧凑型3D多模态LLM,实现重建-推理协同

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture) 支柱三:空间感知与语义 (Perception & Semantics) 支柱七:动作重定向 (Motion Retargeting) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 3D场景理解 多模态大语言模型 视频输入 几何重建 跨任务适配器 度量深度模型 蒸馏训练

📋 核心要点

- 现有3D-MLLM依赖3D数据输入,限制了可扩展性和泛化能力,难以实际部署。

- Vid-LLM直接处理视频输入,无需外部3D数据,利用几何先验提升场景感知。

- 通过跨任务适配器(CTA)模块和度量深度模型,实现几何信息与视觉-语言表示的对齐与融合。

📝 摘要(中文)

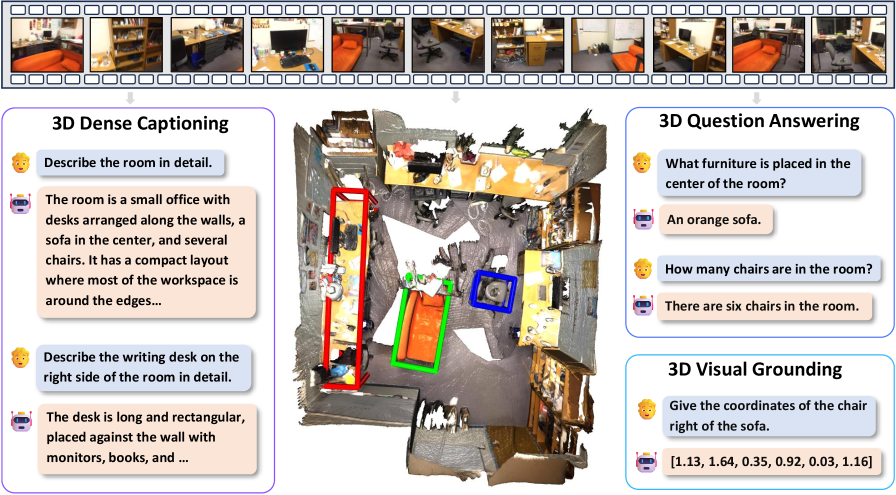

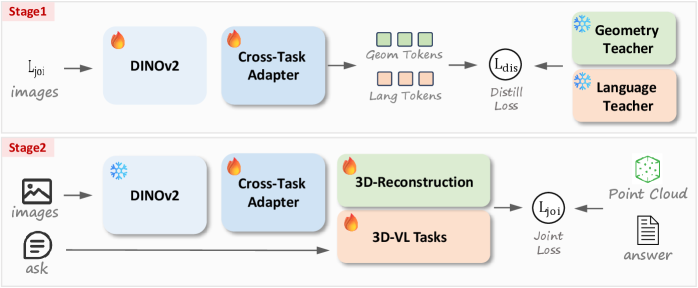

多模态大型语言模型(MLLM)的最新发展显著提高了2D领域的视觉-语言(VL)推理能力。然而,将这些能力扩展到3D场景理解仍然是一个主要的挑战。现有的3D多模态大型语言模型(3D-MLLM)通常依赖于3D数据输入,这限制了可扩展性和泛化能力。为了解决这个限制,我们提出了Vid-LLM,一种基于视频的3D-MLLM,可以直接处理视频输入,而不需要外部3D数据,使其适用于实际部署。在我们的方法中,几何先验被直接用于提高场景感知性能。为了将几何线索紧凑地集成到MLLM中,我们设计了一个跨任务适配器(CTA)模块,以将3D几何先验与视觉-语言表示对齐。为了确保几何一致性和完整性,我们引入了一个度量深度模型,从重建输出中恢复真实尺度的几何信息。最后,该模型采用两阶段蒸馏优化策略进行微调,实现快速收敛并稳定训练。在各种基准上的大量实验验证了我们的方法在3D问答、3D密集描述和3D视觉定位任务上的有效性,证明了其卓越的多任务能力。

🔬 方法详解

问题定义:现有3D多模态大语言模型依赖于3D数据输入,这限制了它们的可扩展性和泛化能力。在实际应用中,获取高质量的3D数据往往成本高昂且困难。因此,如何利用更易获取的视频数据进行3D场景理解是一个亟待解决的问题。

核心思路:Vid-LLM的核心思路是直接从视频输入中提取3D几何信息,并将其融入到多模态大语言模型中,从而实现无需额外3D数据的3D场景理解。通过引入几何先验,模型能够更好地理解场景的结构和空间关系,从而提高3D推理能力。

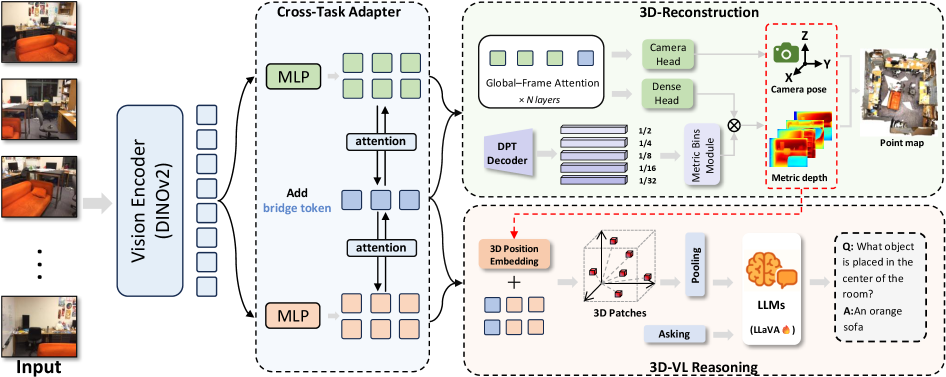

技术框架:Vid-LLM的整体框架包括以下几个主要模块:1) 视频编码器:用于提取视频帧的视觉特征。2) 几何重建模块:从视频中重建3D几何信息,例如深度图或点云。3) 跨任务适配器(CTA):将3D几何先验与视觉-语言表示对齐,实现多模态信息的融合。4) 度量深度模型:从重建输出中恢复真实尺度的几何信息,确保几何一致性和完整性。5) 多模态大语言模型:利用融合后的视觉和几何信息进行3D场景理解和推理。

关键创新:Vid-LLM的关键创新在于:1) 直接从视频输入中提取3D几何信息,避免了对额外3D数据的依赖。2) 提出了跨任务适配器(CTA)模块,有效地将3D几何先验与视觉-语言表示对齐。3) 引入了度量深度模型,确保重建几何信息的尺度一致性。

关键设计:CTA模块的设计是关键。它可能包含注意力机制或特征变换层,用于学习几何特征和视觉特征之间的对应关系。损失函数可能包括重建损失、对齐损失和语言模型损失,以确保模型能够准确地重建几何信息,并将几何信息有效地融入到语言模型中。两阶段蒸馏优化策略用于加速收敛和稳定训练,具体细节未知。

🖼️ 关键图片

📊 实验亮点

论文在3D问答、3D密集描述和3D视觉定位等多个3D场景理解任务上进行了实验,并取得了显著的性能提升。具体的数据和对比基线未知,但结果表明Vid-LLM能够有效地利用视频数据进行3D场景理解,并具有优越的多任务能力。

🎯 应用场景

Vid-LLM在机器人导航、自动驾驶、增强现实等领域具有广泛的应用前景。它可以帮助机器人更好地理解周围环境,从而实现更智能的导航和交互。在自动驾驶领域,Vid-LLM可以提高车辆对3D场景的感知能力,从而提高驾驶安全性。在增强现实领域,Vid-LLM可以实现更逼真的3D场景渲染和交互。

📄 摘要(原文)

Recent developments in Multimodal Large Language Models (MLLMs) have significantly improved Vision-Language (VL) reasoning in 2D domains. However, extending these capabilities to 3D scene understanding remains a major challenge. Existing 3D Multimodal Large Language Models (3D-MLLMs) often depend on 3D data inputs, which limits scalability and generalization. To address this limitation, we propose Vid-LLM, a video-based 3D-MLLM that directly processes video inputs without requiring external 3D data, making it practical for real-world deployment. In our method, the geometric prior are directly used to improve the performance of the sceen perception. To integrate the geometric cues into the MLLM compactly, we design a Cross-Task Adapter (CTA) module to align the 3D geometric priors with the vision-language representations. To ensure geometric consistency and integrity, we introduce a Metric Depth Model that recovers real-scale geometry from the reconstruction outputs. Finally, the model is fine-tuned with a two-stage distillation optimization strategy, realizing fast convergence and stabilizes training. Extensive experiments across diverse benchmarks verified the effectiveness of our method on 3D Question Answering, 3D Dense Captioning and 3D Visual Grounding tasks, demonstrating the superior multi-task capabilities.