UI-UG: A Unified MLLM for UI Understanding and Generation

作者: Hao Yang, Weijie Qiu, Ru Zhang, Zhou Fang, Ruichao Mao, Xiaoyu Lin, Maji Huang, Zhaosong Huang, Teng Guo, Shuoyang Liu, Hai Rao

分类: cs.CV, cs.AI, cs.HC

发布日期: 2025-09-29 (更新: 2025-09-30)

🔗 代码/项目: GITHUB

💡 一句话要点

UI-UG:统一的多模态大语言模型,用于用户界面理解与生成

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 多模态大语言模型 用户界面理解 用户界面生成 监督微调 策略优化 领域特定语言 直接偏好优化

📋 核心要点

- 现有多模态大语言模型在用户界面理解的准确性和用户界面生成质量方面面临挑战,尤其是在领域特定任务中。

- UI-UG通过结合监督微调与组相对策略优化增强UI理解,并利用直接偏好优化提升UI生成质量,实现统一的UI理解与生成。

- 实验结果表明,UI-UG在UI理解任务上达到SOTA,且在UI生成上以更低的计算成本与大型MLLM相当,并验证了联合训练的有效性。

📝 摘要(中文)

本文提出UI-UG,一个统一的多模态大语言模型(MLLM),旨在提升用户界面(UI)理解的准确性和UI生成的质量。针对UI理解任务,UI-UG采用监督微调(SFT)结合组相对策略优化(GRPO)的方法,增强对现代复杂UI数据的细粒度理解。对于UI生成任务,进一步使用直接偏好优化(DPO)使模型生成更符合人类偏好的UI。此外,本文还提出了一个工业界有效的workflow,包括LLM友好的领域特定语言(DSL)设计、训练策略、渲染流程和评估指标。实验结果表明,UI-UG在UI理解任务上取得了SOTA性能,超越了更大的通用MLLM和同等规模的UI专用模型。在UI生成性能上,UI-UG也与这些更大的MLLM相当,但计算成本更低。同时证明了整合理解和生成任务可以提高两者的准确性和质量。

🔬 方法详解

问题定义:论文旨在解决多模态大语言模型在用户界面(UI)理解的准确性和UI生成质量方面存在的不足。现有方法在处理复杂UI数据时,难以进行细粒度的理解,并且生成的UI可能不符合人类偏好。

核心思路:论文的核心思路是构建一个统一的多模态大语言模型(UI-UG),同时具备UI理解和UI生成能力。通过联合训练,使模型能够更好地理解UI的结构和语义,并生成更符合人类偏好的UI设计。

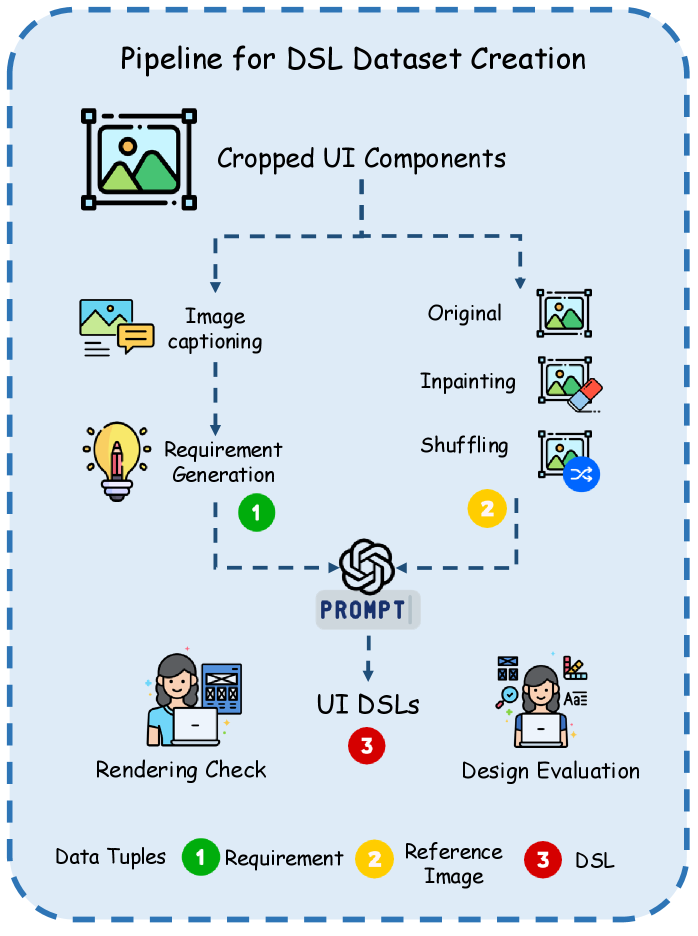

技术框架:UI-UG的技术框架主要包括以下几个部分:1) 领域特定语言(DSL)设计,用于描述UI元素和结构;2) 监督微调(SFT)结合组相对策略优化(GRPO),用于提升UI理解能力;3) 直接偏好优化(DPO),用于提升UI生成质量;4) 渲染流程,用于将生成的UI描述转换为可视化的UI界面;5) 评估指标,用于评估UI理解和生成的效果。

关键创新:论文的关键创新在于:1) 提出了一个统一的MLLM框架,同时支持UI理解和生成;2) 结合GRPO和DPO,提升了模型在UI理解和生成方面的性能;3) 设计了一个工业界有效的workflow,包括DSL、训练策略、渲染流程和评估指标。

关键设计:在训练策略方面,论文采用了SFT+GRPO用于UI理解,DPO用于UI生成。具体而言,GRPO通过对多个候选答案进行排序,并根据排序结果调整策略,从而提升模型的细粒度理解能力。DPO则通过直接优化模型的偏好,使其生成的UI更符合人类的审美和使用习惯。DSL的设计需要保证LLM的友好性,方便模型进行理解和生成。

🖼️ 关键图片

📊 实验亮点

UI-UG在UI理解任务上取得了SOTA性能,超越了更大的通用MLLM和同等规模的UI专用模型。在UI生成性能上,UI-UG也与这些更大的MLLM相当,但计算成本更低。实验结果还表明,整合理解和生成任务可以提高两者的准确性和质量。具体性能数据在论文中给出,但摘要中未明确量化提升幅度。

🎯 应用场景

该研究成果可应用于自动化UI设计、UI测试、UI辅助生成等领域。通过UI-UG,可以显著降低UI设计和开发的成本,提高效率,并生成更符合用户需求的UI界面。未来,该技术有望应用于智能家居、车载系统、移动应用等各种场景,提升用户体验。

📄 摘要(原文)

Although Multimodal Large Language Models (MLLMs) have been widely applied across domains, they are still facing challenges in domain-specific tasks, such as User Interface (UI) understanding accuracy and UI generation quality. In this paper, we introduce UI-UG (a unified MLLM for UI Understanding and Generation), integrating both capabilities. For understanding tasks, we employ Supervised Fine-tuning (SFT) combined with Group Relative Policy Optimization (GRPO) to enhance fine-grained understanding on the modern complex UI data. For generation tasks, we further use Direct Preference Optimization (DPO) to make our model generate human-preferred UIs. In addition, we propose an industrially effective workflow, including the design of an LLM-friendly domain-specific language (DSL), training strategies, rendering processes, and evaluation metrics. In experiments, our model achieves state-of-the-art (SOTA) performance on understanding tasks, outperforming both larger general-purpose MLLMs and similarly-sized UI-specialized models. Our model is also on par with these larger MLLMs in UI generation performance at a fraction of the computational cost. We also demonstrate that integrating understanding and generation tasks can improve accuracy and quality for both tasks. Code and Model: https://github.com/neovateai/UI-UG