RPG360: Robust 360 Depth Estimation with Perspective Foundation Models and Graph Optimization

作者: Dongki Jung, Jaehoon Choi, Yonghan Lee, Dinesh Manocha

分类: cs.CV

发布日期: 2025-09-28

💡 一句话要点

RPG360:利用透视基础模型和图优化的鲁棒360度深度估计

🎯 匹配领域: 支柱三:空间感知与语义 (Perception & Semantics) 支柱六:视频提取与匹配 (Video Extraction) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 360度深度估计 单目深度估计 图优化 透视基础模型 免训练 深度尺度对齐 立方图 零样本学习

📋 核心要点

- 360度图像深度估计缺乏大规模标注数据集,限制了有监督方法的性能。

- RPG360利用透视基础模型提取深度和法线,并通过图优化实现深度尺度对齐。

- 实验表明,该方法在多个数据集上表现出色,并在下游任务中带来显著提升。

📝 摘要(中文)

本文提出了一种名为RPG360的免训练鲁棒360度单目深度估计方法,该方法利用透视基础模型和图优化。由于缺乏大规模的360度深度估计标注数据集,该方法将360度图像转换为六面体立方图表示,并使用透视基础模型来估计深度和表面法线。为了解决立方图不同面之间的深度尺度不一致问题,我们引入了一种新的基于图优化的深度尺度对齐技术,该技术参数化了预测的深度和法线图,并结合了每个面的尺度参数。这种优化确保了六面体立方图的深度尺度一致性,同时保持了3D结构的完整性。此外,由于基础模型在零样本设置中表现出固有的鲁棒性,我们的方法在包括Matterport3D、Stanford2D3D和360Loc在内的各种数据集上实现了卓越的性能。我们还通过验证其在特征匹配(提升3.2% ~ 5.4%)和运动结构重建(AUC@5指标提升0.2% ~ 9.7%)等下游任务中的优势,证明了该深度估计方法的通用性。

🔬 方法详解

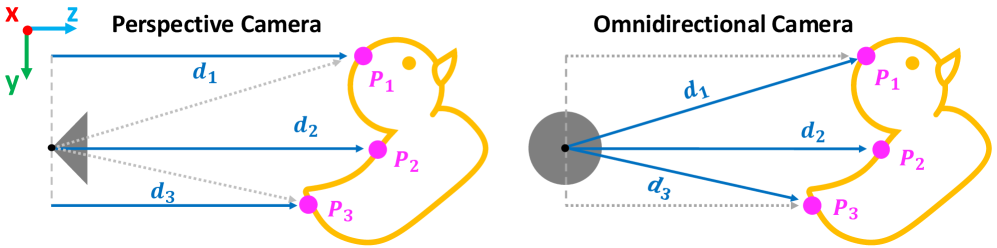

问题定义:现有的360度图像深度估计方法通常依赖于大规模标注数据集进行训练,但获取此类数据集成本高昂。此外,直接将透视图像的深度估计模型应用于360度图像时,由于图像畸变和视场差异,性能会显著下降。因此,如何在缺乏大规模标注的情况下,实现鲁棒且准确的360度深度估计是一个关键问题。

核心思路:RPG360的核心思路是利用预训练的透视基础模型(Perspective Foundation Models)的强大泛化能力,结合图优化方法来解决360度图像深度估计问题。通过将360度图像转换为六面体立方图,可以利用透视模型进行深度和法线估计。然后,通过图优化来校正不同面之间的深度尺度不一致性,从而保证整体3D结构的一致性。

技术框架:RPG360的整体流程如下:1) 将360度图像转换为六面体立方图表示。2) 使用透视基础模型(例如DPT、MiDaS)对每个面进行深度和表面法线估计。3) 构建图优化模型,其中节点表示每个面的深度和法线图,边表示相邻面之间的深度一致性约束。4) 通过优化图模型,求解每个面的尺度参数,从而实现深度尺度对齐。

关键创新:RPG360的关键创新在于:1) 提出了一种基于图优化的深度尺度对齐方法,能够有效解决六面体立方图不同面之间的深度尺度不一致问题。2) 利用预训练的透视基础模型,避免了对大规模360度标注数据的依赖,实现了免训练的深度估计。3) 将深度估计问题转化为图优化问题,从而能够有效地整合全局信息,保证3D结构的一致性。

关键设计:图优化模型的目标函数包含两部分:数据项和一致性项。数据项约束每个面的深度和法线图与透视基础模型的预测结果一致。一致性项约束相邻面之间的深度值在重叠区域保持一致。具体而言,一致性项通过最小化相邻面重叠区域的深度差异来实现。每个面的尺度参数通过优化算法(例如Levenberg-Marquardt算法)进行求解。

🖼️ 关键图片

📊 实验亮点

RPG360在Matterport3D、Stanford2D3D和360Loc等多个数据集上进行了评估,结果表明该方法在深度估计精度方面优于现有方法。此外,该方法在特征匹配和运动结构重建等下游任务中也取得了显著的性能提升,例如,在特征匹配任务中,性能提升了3.2% ~ 5.4%,在运动结构重建任务中,AUC@5指标提升了0.2% ~ 9.7%。这些实验结果验证了RPG360的有效性和通用性。

🎯 应用场景

RPG360可应用于室内导航、虚拟现实、增强现实、机器人视觉等领域。例如,在室内导航中,可以利用该方法估计环境的深度信息,从而帮助机器人进行路径规划和避障。在虚拟现实和增强现实中,可以利用该方法生成逼真的3D场景,提升用户体验。该研究的未来影响在于推动360度图像理解和应用的发展,为相关领域提供更准确、更鲁棒的深度感知能力。

📄 摘要(原文)

The increasing use of 360 images across various domains has emphasized the need for robust depth estimation techniques tailored for omnidirectional images. However, obtaining large-scale labeled datasets for 360 depth estimation remains a significant challenge. In this paper, we propose RPG360, a training-free robust 360 monocular depth estimation method that leverages perspective foundation models and graph optimization. Our approach converts 360 images into six-face cubemap representations, where a perspective foundation model is employed to estimate depth and surface normals. To address depth scale inconsistencies across different faces of the cubemap, we introduce a novel depth scale alignment technique using graph-based optimization, which parameterizes the predicted depth and normal maps while incorporating an additional per-face scale parameter. This optimization ensures depth scale consistency across the six-face cubemap while preserving 3D structural integrity. Furthermore, as foundation models exhibit inherent robustness in zero-shot settings, our method achieves superior performance across diverse datasets, including Matterport3D, Stanford2D3D, and 360Loc. We also demonstrate the versatility of our depth estimation approach by validating its benefits in downstream tasks such as feature matching 3.2 ~ 5.4% and Structure from Motion 0.2 ~ 9.7% in AUC@5.