ColLab: A Collaborative Spatial Progressive Data Engine for Referring Expression Comprehension and Generation

作者: Shilan Zhang, Jirui Huang, Ruilin Yao, Cong Wang, Yaxiong Chen, Peng Xu, Shengwu Xiong

分类: cs.CV

发布日期: 2025-09-28

💡 一句话要点

ColLab:一种用于指代表达式理解与生成的协同空间渐进式数据引擎

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 指代表达式理解 指代表达式生成 多模态学习 数据增强 自动标注

📋 核心要点

- 现有REC和REG数据集依赖人工标注,成本高且难以扩展,限制了模型的发展。

- ColLab通过协同多模态模型交互(CMMI)和空间渐进增强(SPA)实现全自动数据生成。

- 实验表明ColLab能显著加速标注过程,提升生成表达式的质量和区分度,并应用于ICCV 2025 MARS2挑战赛。

📝 摘要(中文)

指代表达式理解(REC)和指代表达式生成(REG)是多模态理解中的基础任务,通过自然语言支持精确的对象定位。然而,现有的REC和REG数据集严重依赖于人工标注,这既费力又难以扩展。本文提出了一种名为ColLab的协同空间渐进式数据引擎,它能够全自动地生成REC和REG数据,无需人工监督。具体来说,我们的方法引入了一种协同多模态模型交互(CMMI)策略,该策略利用多模态大型语言模型(MLLM)和大型语言模型(LLM)的语义理解来生成描述。此外,我们设计了一个名为空间渐进增强(SPA)的模块,以增强重复实例之间的空间表达能力。实验表明,ColLab显著加速了REC和REG的标注过程,同时提高了生成表达式的质量和可区分性。我们的框架被部分应用于ICCV 2025 MARS2多模态推理挑战赛的数据生成流程中,用多样化和具有挑战性的样本丰富了数据集,从而更好地反映了真实世界的推理需求。

🔬 方法详解

问题定义:论文旨在解决指代表达式理解(REC)和指代表达式生成(REG)任务中数据标注成本高昂且难以扩展的问题。现有方法依赖大量人工标注,效率低下,且难以覆盖真实世界的多样性场景。因此,需要一种自动化的数据生成方法,以降低成本并提高数据质量。

核心思路:论文的核心思路是利用多模态大型语言模型(MLLM)和大型语言模型(LLM)的强大语义理解能力,通过协同交互的方式自动生成高质量的指代表达式数据。同时,通过空间渐进增强(SPA)模块,提升生成数据中空间信息的表达能力,从而提高数据的区分度。

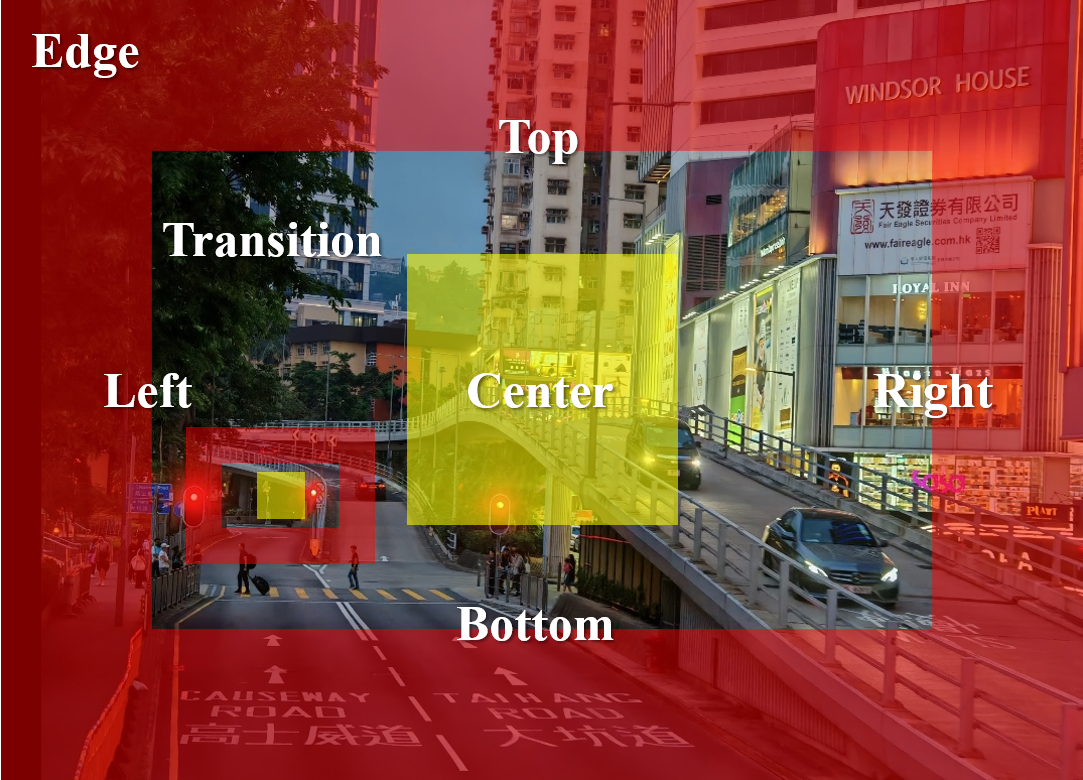

技术框架:ColLab框架主要包含两个核心模块:协同多模态模型交互(CMMI)和空间渐进增强(SPA)。CMMI模块利用MLLM生成初步的指代表达式,然后通过LLM进行润色和优化,确保表达的准确性和流畅性。SPA模块则针对场景中存在的重复实例,逐步增强其空间表达,例如从“左边的物体”到“左边第二个物体”,从而提高数据的区分度。整个流程无需人工干预,实现了全自动的数据生成。

关键创新:论文的关键创新在于提出了协同多模态模型交互(CMMI)策略和空间渐进增强(SPA)模块。CMMI策略充分利用了MLLM和LLM的优势,实现了高质量的指代表达式生成。SPA模块则有效解决了重复实例带来的歧义问题,提高了数据的区分度。与现有方法相比,ColLab无需人工标注,能够显著降低数据生成成本,并提高数据质量。

关键设计:CMMI模块中,MLLM负责生成初步的指代表达式,LLM则负责对表达式进行润色和优化,例如纠正语法错误、提高表达的流畅性等。SPA模块通过逐步增加空间信息的描述,例如“左边”、“右边”、“前面”、“后面”等,来区分场景中的重复实例。具体的参数设置和网络结构细节在论文中未详细描述,属于未知信息。

🖼️ 关键图片

📊 实验亮点

论文实验表明,ColLab能够显著加速REC和REG的标注过程,并提升生成表达式的质量和区分度。虽然论文中没有给出具体的性能数据和对比基线,但提到该框架被部分应用于ICCV 2025 MARS2多模态推理挑战赛的数据生成流程中,表明其生成的数据具有一定的实用价值和竞争力。

🎯 应用场景

ColLab可广泛应用于机器人导航、智能监控、图像搜索、视觉问答等领域。通过自动生成高质量的指代表达式数据,可以有效提升相关模型的性能和泛化能力,降低人工标注成本,加速相关技术的落地应用。该研究对于推动多模态理解和人机交互的发展具有重要意义。

📄 摘要(原文)

Referring Expression Comprehension (REC) and Referring Expression Generation (REG) are fundamental tasks in multimodal understanding, supporting precise object localization through natural language. However, existing REC and REG datasets rely heavily on manual annotation, which is labor-intensive and difficult to scale. In this paper, we propose ColLab, a collaborative spatial progressive data engine that enables fully automated REC and REG data generation without human supervision. Specifically, our method introduces a Collaborative Multimodal Model Interaction (CMMI) strategy, which leverages the semantic understanding of multimodal large language models (MLLMs) and large language models (LLMs) to generate descriptions. Furthermore, we design a module termed Spatial Progressive Augmentation (SPA) to enhance spatial expressiveness among duplicate instances. Experiments demonstrate that ColLab significantly accelerates the annotation process of REC and REG while improving the quality and discriminability of the generated expressions. In addition to the core methodological contribution, our framework was partially adopted in the data generation pipeline of the ICCV 2025 MARS2 Challenge on Multimodal Reasoning, enriching the dataset with diverse and challenging samples that better reflect real-world reasoning demands.