Color-Pair Guided Robust Zero-Shot 6D Pose Estimation and Tracking of Cluttered Objects on Edge Devices

作者: Xingjian Yang, Ashis G. Banerjee

分类: cs.CV, cs.RO

发布日期: 2025-09-28

💡 一句话要点

提出一种颜色对引导的鲁棒零样本6D位姿估计与跟踪方法,适用于边缘设备上杂乱物体的场景。

🎯 匹配领域: 支柱三:空间感知与语义 (Perception & Semantics)

关键词: 6D位姿估计 零样本学习 边缘设备 物体跟踪 颜色对特征

📋 核心要点

- 在复杂光照条件下,对新物体的鲁棒6D位姿估计仍然是一个挑战,需要在准确的初始位姿估计和高效的实时跟踪之间进行权衡。

- 本文提出了一种基于颜色对特征的统一框架,用于初始位姿估计和快速跟踪,该特征对光照变化具有不变性,并适用于边缘设备。

- 实验结果表明,该方法在基准数据集上具有竞争力的位姿估计精度,即使在剧烈的位姿变化下也能保持高保真度的跟踪效果。

📝 摘要(中文)

本文提出了一种统一的框架,专为在边缘设备上高效执行而设计,该框架将鲁棒的初始位姿估计模块与快速的基于运动的跟踪器相结合。该方法的关键在于共享的、光照不变的颜色对特征表示,它为两个阶段奠定了坚实的基础。对于初始估计,该特征有助于实时RGB-D视图与物体3D网格之间的鲁棒配准。对于跟踪,相同的特征逻辑验证时间对应关系,使轻量级模型能够可靠地回归物体的运动。在基准数据集上的大量实验表明,我们集成的方案是有效和鲁棒的,即使在突然的姿势变化中也能提供有竞争力的姿势估计精度,同时保持高保真度的跟踪。

🔬 方法详解

问题定义:论文旨在解决在复杂光照条件下,边缘设备上新物体的鲁棒6D位姿估计与跟踪问题。现有方法通常需要在初始位姿估计的准确性和实时跟踪的效率之间进行权衡,并且对光照变化敏感。

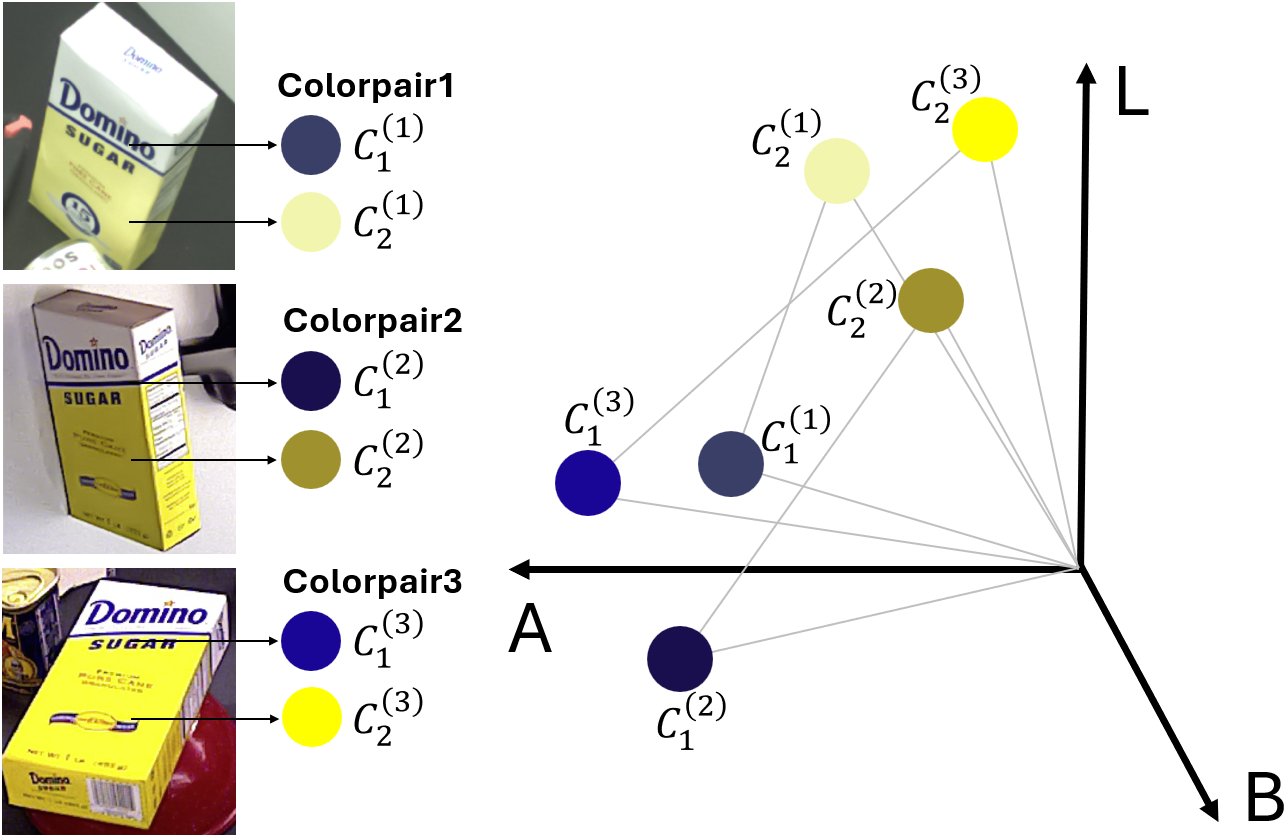

核心思路:论文的核心思路是利用光照不变的颜色对特征表示,作为初始位姿估计和跟踪的统一基础。通过共享特征,可以避免在不同阶段使用不同的特征提取方法,从而提高效率并保证一致性。颜色对特征对光照变化具有较强的鲁棒性,有助于在复杂光照条件下实现准确的位姿估计和跟踪。

技术框架:该框架包含两个主要模块:初始位姿估计模块和基于运动的跟踪模块。初始位姿估计模块使用颜色对特征进行RGB-D视图与物体3D网格之间的配准,从而获得初始位姿。跟踪模块利用相同的颜色对特征验证时间对应关系,并使用轻量级模型回归物体的运动。两个模块共享颜色对特征提取,实现高效的位姿估计和跟踪。

关键创新:最重要的技术创新点是颜色对特征表示在6D位姿估计与跟踪中的应用。与传统的基于点云或纹理的特征相比,颜色对特征对光照变化具有更强的鲁棒性,并且计算复杂度较低,适合在边缘设备上部署。此外,将颜色对特征应用于初始位姿估计和跟踪的统一框架也提高了整体的效率和准确性。

关键设计:颜色对特征的具体实现方式未知,论文可能使用了特定的颜色空间和距离度量来定义颜色对。跟踪模块可能采用了卡尔曼滤波或粒子滤波等方法来平滑位姿估计结果。轻量级模型的具体结构未知,但可能采用了卷积神经网络或循环神经网络等结构。

🖼️ 关键图片

📊 实验亮点

论文在基准数据集上进行了大量实验,验证了该方法的有效性和鲁棒性。具体性能数据未知,但摘要中提到该方法在提供有竞争力的位姿估计精度的同时,即使在突然的姿势变化中也能保持高保真度的跟踪效果。与现有方法相比,该方法在边缘设备上的效率更高,并且对光照变化具有更强的鲁棒性。

🎯 应用场景

该研究成果可应用于机器人导航、增强现实、工业自动化等领域。例如,机器人可以在复杂光照条件下识别和跟踪物体,从而实现自主抓取和操作。增强现实应用可以更准确地将虚拟物体叠加到真实场景中。工业自动化系统可以利用该技术进行产品质量检测和装配。

📄 摘要(原文)

Robust 6D pose estimation of novel objects under challenging illumination remains a significant challenge, often requiring a trade-off between accurate initial pose estimation and efficient real-time tracking. We present a unified framework explicitly designed for efficient execution on edge devices, which synergizes a robust initial estimation module with a fast motion-based tracker. The key to our approach is a shared, lighting-invariant color-pair feature representation that forms a consistent foundation for both stages. For initial estimation, this feature facilitates robust registration between the live RGB-D view and the object's 3D mesh. For tracking, the same feature logic validates temporal correspondences, enabling a lightweight model to reliably regress the object's motion. Extensive experiments on benchmark datasets demonstrate that our integrated approach is both effective and robust, providing competitive pose estimation accuracy while maintaining high-fidelity tracking even through abrupt pose changes.