Balanced Diffusion-Guided Fusion for Multimodal Remote Sensing Classification

作者: Hao Liu, Yongjie Zheng, Yuhan Kang, Mingyang Zhang, Maoguo Gong, Lorenzo Bruzzone

分类: cs.CV

发布日期: 2025-09-27 (更新: 2026-01-20)

🔗 代码/项目: GITHUB

💡 一句话要点

提出平衡扩散引导融合框架,解决多模态遥感分类中的模态不平衡问题。

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 多模态遥感 地物分类 扩散模型 模态平衡 特征融合 互学习 深度学习

📋 核心要点

- 现有基于深度学习的多模态遥感数据分析方法,在融合不同传感器提供的空间、光谱和结构信息时,面临模态间信息不平衡的挑战。

- 论文提出BDGF框架,利用多模态扩散特征引导多分支网络进行地物分类,核心在于平衡模态分布和有效利用扩散特征。

- 实验结果表明,该方法在四个多模态遥感数据集上均取得了优越的分类性能,验证了所提框架的有效性。

📝 摘要(中文)

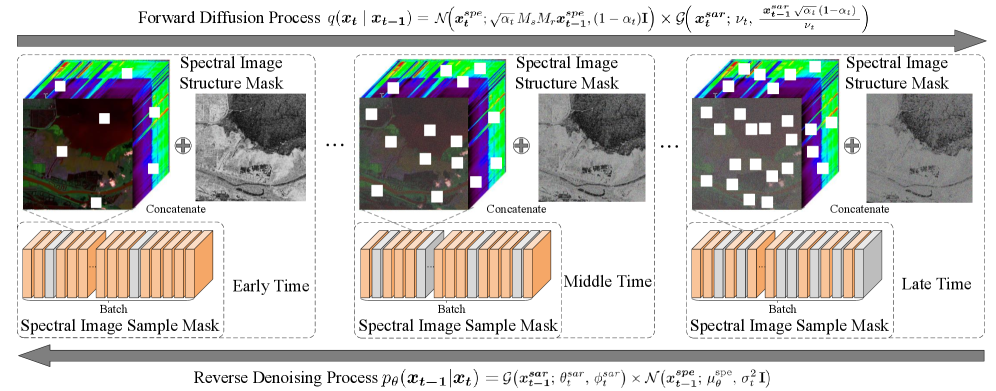

本文提出了一种平衡扩散引导融合(BDGF)框架,用于多模态遥感数据地物分类,旨在解决多模态扩散概率模型(DDPMs)预训练中可能出现的模态不平衡问题,并有效利用扩散特征引导互补多样性特征提取。该框架采用自适应模态掩蔽策略,鼓励DDPMs获得模态平衡的数据分布。随后,通过融合特征融合、分组通道注意力和交叉注意力机制,分层引导CNN、Mamba和Transformer网络进行特征提取。此外,开发了一种互学习策略,通过对齐各个子网络的概率熵和特征相似性来增强分支间的协作。在四个多模态遥感数据集上的大量实验表明,该方法取得了优越的分类性能。

🔬 方法详解

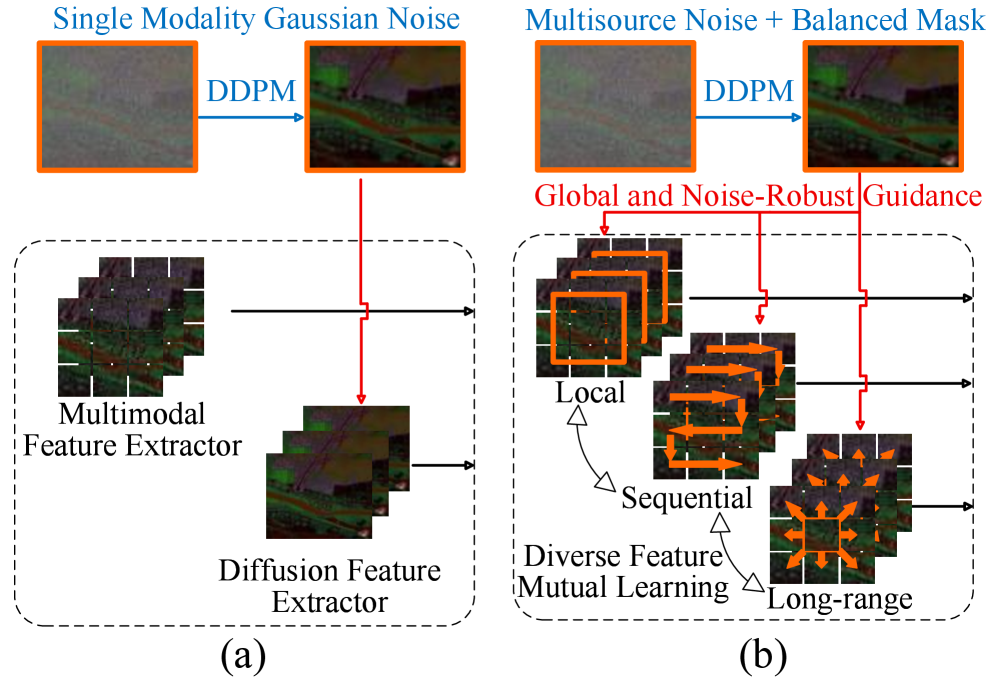

问题定义:多模态遥感分类旨在融合来自不同传感器的数据,以提高地物分类的准确性。然而,直接预训练多模态扩散模型可能导致模态不平衡,例如光谱图像信息可能占据主导地位,而其他模态的信息未能充分利用。此外,如何有效利用扩散模型提取的特征来引导互补多样性特征的提取也是一个挑战。

核心思路:论文的核心思路是利用扩散模型学习到的特征来指导多分支网络的特征提取,同时通过自适应模态掩蔽策略来平衡不同模态的贡献。通过这种方式,可以更好地融合不同模态的信息,并提高分类性能。

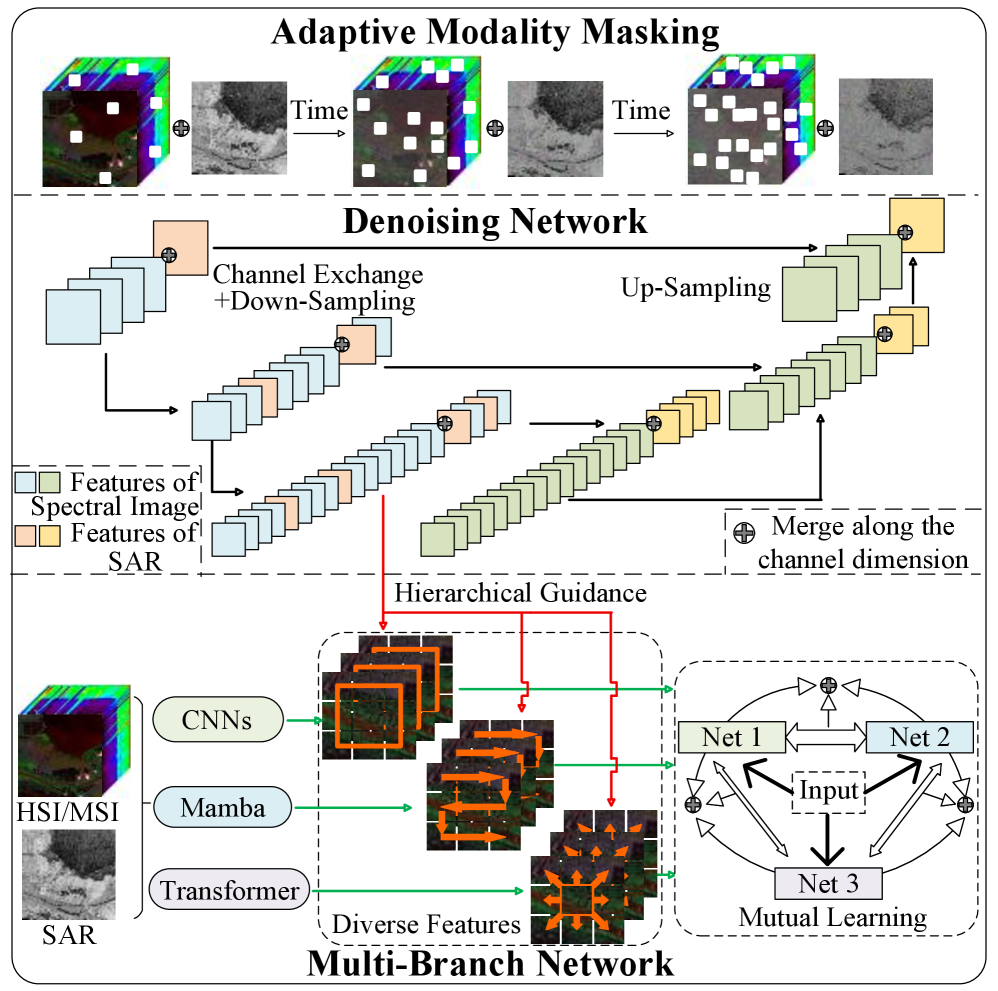

技术框架:BDGF框架主要包含三个部分:1) 自适应模态掩蔽的扩散模型预训练,用于学习模态平衡的扩散特征;2) 多分支特征提取网络,包含CNN、Mamba和Transformer三种网络结构,利用扩散特征进行分层引导;3) 互学习策略,通过对齐不同分支的概率熵和特征相似性来增强分支间的协作。

关键创新:该论文的关键创新在于:1) 提出了自适应模态掩蔽策略,有效平衡了多模态扩散模型预训练中的模态不平衡问题;2) 设计了一种分层引导机制,利用扩散特征指导不同网络结构的特征提取,充分利用了扩散模型的表达能力;3) 引入了互学习策略,增强了多分支网络之间的协作,提高了整体分类性能。

关键设计:自适应模态掩蔽策略根据不同模态的贡献程度动态调整掩蔽比例。特征融合模块采用特征拼接和卷积操作。分组通道注意力机制用于增强重要通道的特征。交叉注意力机制用于融合不同分支的特征。互学习策略采用KL散度损失和余弦相似度损失来对齐不同分支的输出概率和特征表示。

🖼️ 关键图片

📊 实验亮点

实验结果表明,所提出的BDGF框架在四个多模态遥感数据集上均取得了优越的分类性能。例如,在WHU-Hi数据集上,相比于基线方法,总体精度(OA)提升了2-3个百分点。消融实验验证了自适应模态掩蔽策略和互学习策略的有效性。可视化结果表明,BDGF框架能够更好地提取不同模态的互补信息。

🎯 应用场景

该研究成果可应用于精准农业、城市规划、灾害监测等领域。通过更准确的地物分类,可以为农作物长势监测、土地利用规划、洪涝灾害评估等提供更可靠的数据支持,具有重要的实际应用价值和社会经济效益。未来可进一步探索与其他遥感数据源的融合,提升模型的泛化能力。

📄 摘要(原文)

Deep learning-based techniques for the analysis of multimodal remote sensing data have become popular due to their ability to effectively integrate complementary spatial, spectral, and structural information from different sensors. Recently, denoising diffusion probabilistic models (DDPMs) have attracted attention in the remote sensing community due to their powerful ability to capture robust and complex spatial-spectral distributions. However, pre-training multimodal DDPMs may result in modality imbalance, and effectively leveraging diffusion features to guide complementary diversity feature extraction remains an open question. To address these issues, this paper proposes a balanced diffusion-guided fusion (BDGF) framework that leverages multimodal diffusion features to guide a multi-branch network for land-cover classification. Specifically, we propose an adaptive modality masking strategy to encourage the DDPMs to obtain a modality-balanced rather than spectral image-dominated data distribution. Subsequently, these diffusion features hierarchically guide feature extraction among CNN, Mamba, and transformer networks by integrating feature fusion, group channel attention, and cross-attention mechanisms. Finally, a mutual learning strategy is developed to enhance inter-branch collaboration by aligning the probability entropy and feature similarity of individual subnetworks. Extensive experiments on four multimodal remote sensing datasets demonstrate that the proposed method achieves superior classification performance. The code is available at https://github.com/HaoLiu-XDU/BDGF.