Introducing Multimodal Paradigm for Learning Sleep Staging PSG via General-Purpose Model

作者: Jianheng Zhou, Chenyu Liu, Jinan Zhou, Yi Ding, Yang Liu, Haoran Luo, Ziyu Jia, Xinliang Zhou

分类: eess.SP, cs.CV

发布日期: 2025-09-26

💡 一句话要点

提出基于多模态通用模型的睡眠分期新范式,提升PSG分析的准确性和鲁棒性

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 睡眠分期 多导睡眠图 多模态学习 通用模型 图像识别 迁移学习 生理信号处理

📋 核心要点

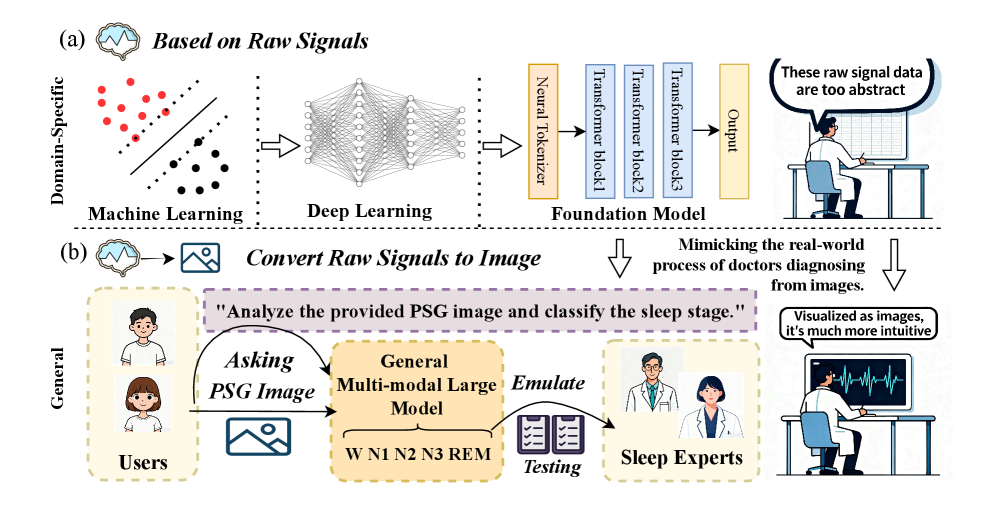

- 现有睡眠分期方法依赖领域特定模型,需要大量专业数据,且缺乏直观性,限制了其泛化能力。

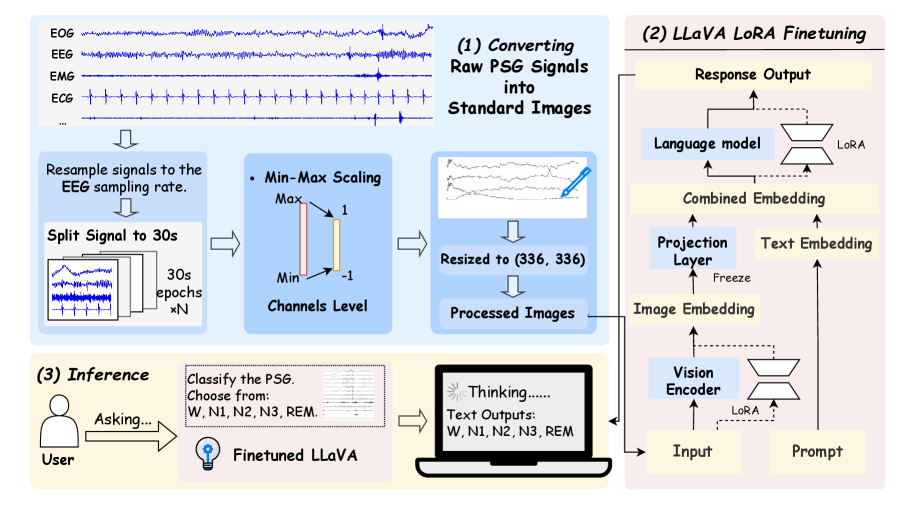

- 论文提出将一维PSG信号转换为二维波形图像,利用多模态通用模型进行学习,模拟临床诊断流程。

- 实验结果表明,该方法在多个数据集上超越了现有技术,展现了通用模型在睡眠分期任务中的潜力。

📝 摘要(中文)

睡眠分期对于诊断睡眠障碍和评估神经系统健康至关重要。现有的自动方法通常从复杂的多导睡眠图(PSG)信号中提取特征,并训练特定领域的模型,这些模型缺乏直观性,并且需要大型的专业数据集。为了克服这些限制,我们引入了一种新的睡眠分期范式,该范式利用大型多模态通用模型来模拟临床诊断实践。具体来说,我们将原始的一维PSG时间序列转换为直观的二维波形图像,然后微调多模态大型模型以从这些表示中学习。在三个公共数据集(ISRUC、MASS、SHHS)上的实验表明,我们的方法使通用模型(在没有事先接触睡眠数据的情况下)能够获得强大的分期能力。此外,解释分析表明,我们的模型学会了模仿人类专家通过PSG图像进行睡眠分期的视觉诊断工作流程。所提出的方法在准确性和鲁棒性方面始终优于最先进的基线,突出了其在医疗应用中的效率和实用价值。信号到图像的pipeline和PSG图像数据集将会开源。

🔬 方法详解

问题定义:现有的睡眠分期方法主要依赖于从多导睡眠图(PSG)信号中提取人工特征,并训练特定领域的深度学习模型。这些方法存在几个痛点:一是需要大量的标注数据进行训练;二是模型的可解释性较差,难以理解其决策过程;三是领域泛化能力不足,难以在不同的数据集上取得一致的性能。

核心思路:论文的核心思路是将一维的PSG信号转换为二维的波形图像,从而将睡眠分期问题转化为图像识别问题。这样做的目的是利用预训练的多模态通用模型,例如在图像和文本数据上训练的模型,来学习睡眠分期的知识。通过图像化的表示,模型可以更容易地捕捉到PSG信号中的视觉模式,并模拟人类专家进行睡眠分期的过程。

技术框架:整体框架包括两个主要阶段:1) 信号到图像的转换:将原始的一维PSG时间序列信号转换为二维波形图像。具体方法未知,但推测可能涉及时频分析或其他信号处理技术。2) 多模态模型微调:使用转换后的PSG图像作为输入,微调一个预训练的多模态通用模型。该模型可能包含图像编码器和文本编码器,但具体结构未知。模型的目标是预测每个睡眠阶段的标签。

关键创新:论文的关键创新在于将睡眠分期问题转化为图像识别问题,并利用多模态通用模型进行学习。这种方法避免了手动特征工程和领域特定模型的训练,从而提高了模型的泛化能力和可解释性。此外,通过可视化分析,论文还验证了模型学习到了类似于人类专家进行睡眠分期的视觉模式。

关键设计:论文中关于信号到图像转换的具体方法和多模态模型的具体结构信息不足,无法得知关键设计细节。损失函数和优化器的选择也未知。但是,论文强调了对预训练模型进行微调,这表明使用了迁移学习的思想。对模型进行解释性分析,验证了模型学习到了人类专家的视觉诊断流程。

🖼️ 关键图片

📊 实验亮点

实验结果表明,该方法在三个公共数据集(ISRUC、MASS、SHHS)上均取得了优于现有技术的性能。具体性能数据未知,但论文强调了在准确性和鲁棒性方面的一致性提升。此外,论文通过解释性分析验证了模型学习到了类似于人类专家进行睡眠分期的视觉模式,增强了模型的可信度。

🎯 应用场景

该研究成果可应用于自动睡眠分期系统,辅助医生进行睡眠障碍诊断,提高诊断效率和准确性。此外,该方法还可扩展到其他生理信号分析领域,例如心电图分析、脑电图分析等,具有广泛的应用前景。未来,结合可穿戴设备,有望实现居家睡眠监测和个性化健康管理。

📄 摘要(原文)

Sleep staging is essential for diagnosing sleep disorders and assessing neurological health. Existing automatic methods typically extract features from complex polysomnography (PSG) signals and train domain-specific models, which often lack intuitiveness and require large, specialized datasets. To overcome these limitations, we introduce a new paradigm for sleep staging that leverages large multimodal general-purpose models to emulate clinical diagnostic practices. Specifically, we convert raw one-dimensional PSG time-series into intuitive two-dimensional waveform images and then fine-tune a multimodal large model to learn from these representations. Experiments on three public datasets (ISRUC, MASS, SHHS) demonstrate that our approach enables general-purpose models, without prior exposure to sleep data, to acquire robust staging capabilities. Moreover, explanation analysis reveals our model learned to mimic the visual diagnostic workflow of human experts for sleep staging by PSG images. The proposed method consistently outperforms state-of-the-art baselines in accuracy and robustness, highlighting its efficiency and practical value for medical applications. The code for the signal-to-image pipeline and the PSG image dataset will be released.