GaussianVision: Vision-Language Alignment from Compressed Image Representations using 2D Gaussian Splatting

作者: Yasmine Omri, Connor Ding, Tsachy Weissman, Thierry Tambe

分类: cs.CV, cs.AI, cs.CL

发布日期: 2025-09-26 (更新: 2025-12-23)

💡 一句话要点

GaussianVision:利用2D高斯溅射从压缩图像表示中实现视觉-语言对齐

🎯 匹配领域: 支柱三:空间感知与语义 (Perception & Semantics) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 视觉语言模型 2D高斯溅射 图像压缩 零样本学习 边缘计算 多模态学习

📋 核心要点

- 现有视觉-语言模型依赖RGB图像,存在传输成本高、patch tokenization导致序列长度过长的问题。

- 提出使用2D高斯溅射(2DGS)作为视觉表示,它是一种紧凑且空间自适应的图像参数化方法。

- 通过优化2DGS流水线并适配CLIP模型,在压缩图像的同时实现了具有竞争力的零样本性能。

📝 摘要(中文)

现代视觉语言流水线依赖于在海量图像文本语料库上训练的RGB视觉编码器。虽然这些流水线实现了令人印象深刻的零样本能力和强大的跨任务迁移,但它们仍然继承了像素域的两个结构性低效问题:(i)从边缘设备向云端传输密集的RGB图像既耗能又昂贵,(ii)基于patch的tokenization会爆炸序列长度,给注意力预算和上下文限制带来压力。我们探索了2D高斯溅射(2DGS)作为对齐的替代视觉基底:一种紧凑的、空间自适应的表示,它通过一组彩色各向异性高斯函数来参数化图像。我们开发了一个可扩展的2DGS流水线,具有结构化初始化、亮度感知剪枝和批处理CUDA内核,与之前的实现相比,实现了超过90倍的拟合速度和约97%的GPU利用率。我们进一步通过重用一个冻结的基于RGB的transformer骨干网络,以及一个轻量级的splat感知输入stem和一个perceiver resampler,将对比语言-图像预训练(CLIP)适配到2DGS,仅训练总参数的9.7%到13.8%。在来自DataComp的1280万数据集上,GS编码器在CLIP基准测试的38个数据集上产生了具有竞争力的零样本性能,同时相对于像素压缩了3倍到23.5倍的输入。我们的结果表明,2DGS是一种可行的多模态基底,可以精确定位架构瓶颈,并为语义强大且传输高效的边缘-云学习表示开辟了一条道路。

🔬 方法详解

问题定义:现有视觉-语言模型依赖于RGB图像,这导致了两个主要问题:一是将密集的RGB图像从边缘设备传输到云端需要大量的能量和成本;二是基于patch的tokenization方法会显著增加序列长度,从而对模型的注意力和上下文处理能力造成压力。这些问题限制了视觉-语言模型在资源受限环境中的应用。

核心思路:论文的核心思路是使用2D高斯溅射(2DGS)作为视觉表示的替代方案。2DGS是一种紧凑且空间自适应的图像表示方法,它使用一组彩色各向异性高斯函数来参数化图像。通过使用2DGS,可以显著减少图像的数据量,从而降低传输成本和序列长度。

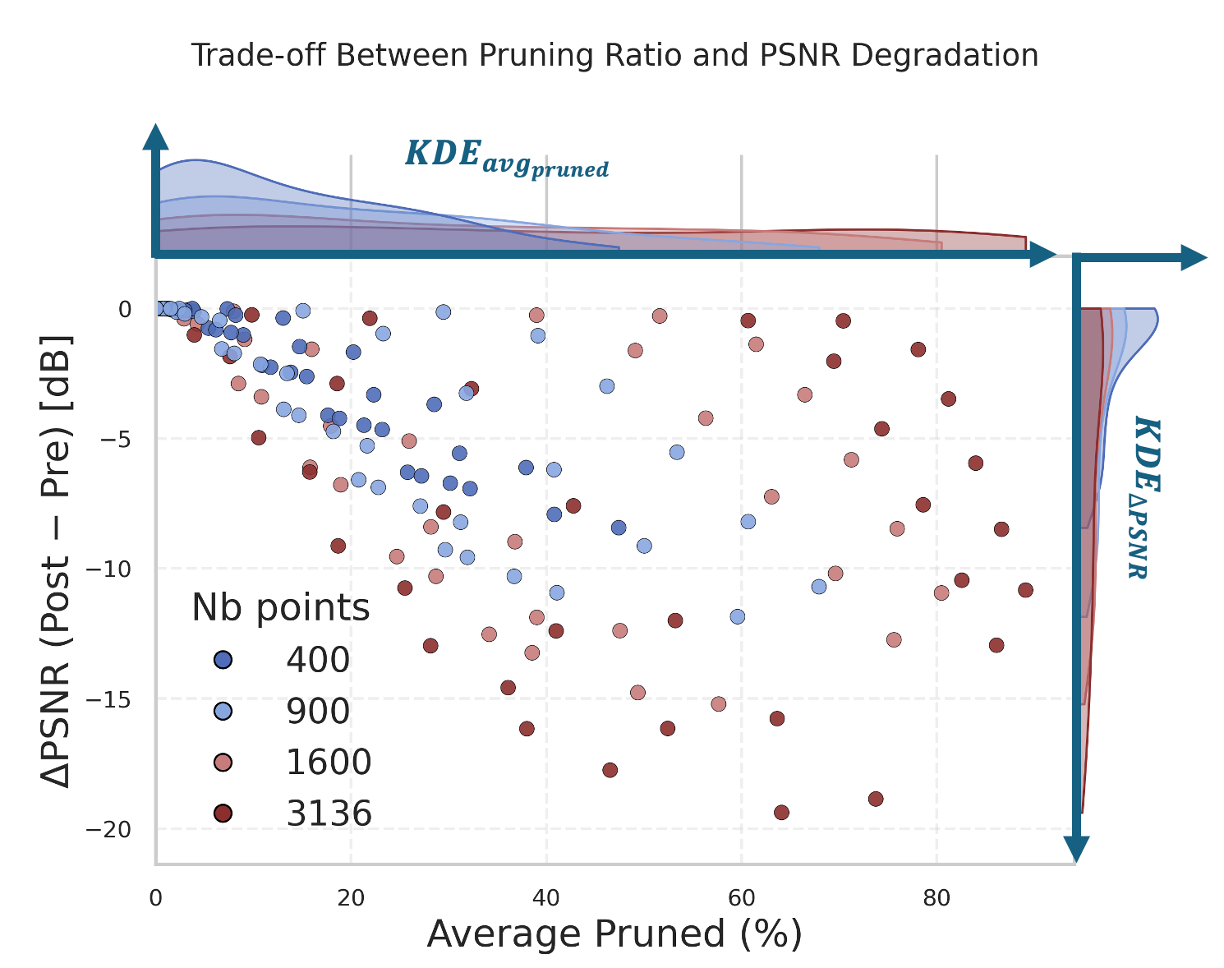

技术框架:该方法主要包含以下几个阶段:首先,使用结构化初始化方法初始化2DGS参数。然后,使用亮度感知剪枝方法来减少高斯函数的数量,从而进一步压缩图像。接着,使用优化的CUDA内核进行高效的2DGS拟合。最后,将2DGS表示输入到适配后的CLIP模型中进行视觉-语言对齐。CLIP模型通过一个轻量级的splat感知输入stem和一个perceiver resampler来处理2DGS表示。

关键创新:该论文的关键创新在于将2DGS引入到视觉-语言模型中,并证明了其作为一种可行的多模态基底的潜力。此外,论文还提出了优化的2DGS流水线,包括结构化初始化、亮度感知剪枝和CUDA内核,从而显著提高了2DGS的拟合速度和GPU利用率。

关键设计:在CLIP适配方面,论文重用了冻结的RGB-based transformer骨干网络,只训练了splat感知输入stem和perceiver resampler,从而减少了训练参数的数量(仅占总参数的9.7%到13.8%)。在2DGS拟合方面,使用了亮度感知剪枝方法,根据高斯函数的亮度值来决定是否保留该高斯函数,从而在保证图像质量的同时减少了高斯函数的数量。

🖼️ 关键图片

📊 实验亮点

实验结果表明,在DataComp的1280万数据集上,使用2DGS编码器的CLIP模型在38个CLIP基准数据集上取得了具有竞争力的零样本性能,同时相对于像素压缩了3倍到23.5倍的输入。此外,优化的2DGS流水线实现了超过90倍的拟合速度提升和约97%的GPU利用率。

🎯 应用场景

该研究成果可应用于边缘计算、移动设备等资源受限的场景,例如智能监控、自动驾驶、机器人等。通过使用2DGS压缩图像,可以降低数据传输成本和计算复杂度,从而提高系统的效率和响应速度。此外,该方法还可以促进视觉-语言模型在更多实际场景中的应用。

📄 摘要(原文)

Modern vision language pipelines are driven by RGB vision encoders trained on massive image text corpora. While these pipelines have enabled impressive zero-shot capabilities and strong transfer across tasks, they still inherit two structural inefficiencies from the pixel domain: (i) transmitting dense RGB images from edge devices to the cloud is energy-intensive and costly, and (ii) patch-based tokenization explodes sequence length, stressing attention budgets and context limits. We explore 2D Gaussian Splatting (2DGS) as an alternative visual substrate for alignment: a compact, spatially adaptive representation that parameterizes images by a set of colored anisotropic Gaussians. We develop a scalable 2DGS pipeline with structured initialization, luminance-aware pruning, and batched CUDA kernels, achieving over 90x faster fitting and about 97% GPU utilization compared to prior implementations. We further adapt contrastive language-image pre-training (CLIP) to 2DGS by reusing a frozen RGB-based transformer backbone with a lightweight splat-aware input stem and a perceiver resampler, training only 9.7% to 13.8% of the total parameters. On a 12.8M dataset from DataComp, GS encoders yield competitive zero-shot performance on 38 datasets from the CLIP benchmark while compressing inputs 3x to 23.5x relative to pixels. Our results establish 2DGS as a viable multimodal substrate, pinpoint architectural bottlenecks, and open a path toward representations that are both semantically powerful and transmission-efficient for edge-cloud learning.