NIFTY: a Non-Local Image Flow Matching for Texture Synthesis

作者: Pierrick Chatillon, Julien Rabin, David Tschumperlé

分类: cs.CV, cs.LG

发布日期: 2025-09-26

🔗 代码/项目: GITHUB

💡 一句话要点

NIFTY:一种用于纹理合成的非局部图像流匹配方法

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture)

关键词: 纹理合成 非局部匹配 图像流 非参数模型 图像处理

📋 核心要点

- 基于块的纹理合成方法易受初始化影响,且容易产生视觉伪影,限制了其应用。

- NIFTY利用非局部块匹配构建非参数流匹配模型,无需训练,并能有效避免传统块匹配方法的缺陷。

- 实验结果表明,NIFTY在纹理合成任务上优于现有代表性方法,验证了其有效性。

📝 摘要(中文)

本文研究了基于范例的纹理合成问题。我们提出了一种混合框架NIFTY,它结合了卷积神经网络训练的扩散模型和经典的基于块的纹理优化技术。NIFTY是一个建立在非局部块匹配上的非参数流匹配模型,它避免了神经网络训练的需要,同时缓解了基于块的方法的常见缺点,例如不良的初始化或视觉伪影。实验结果表明,与文献中的代表性方法相比,该方法是有效的。代码可在https://github.com/PierrickCh/Nifty.git获取。

🔬 方法详解

问题定义:本文旨在解决基于范例的纹理合成问题。现有的基于块的纹理合成方法通常面临两个主要痛点:一是初始化敏感,不良的初始化会导致合成结果质量下降;二是容易产生视觉伪影,影响合成纹理的真实感。

核心思路:NIFTY的核心思路是利用非局部图像流匹配来指导纹理合成。通过在源纹理图像中寻找与目标区域相似的块,并利用这些相似块之间的流信息来指导目标纹理的生成,从而避免了对初始化的高度依赖,并减少了视觉伪影的产生。

技术框架:NIFTY的整体框架可以概括为以下几个步骤:1) 对源纹理图像进行块划分;2) 对于目标纹理的每个区域,在源纹理中寻找最相似的块;3) 利用源纹理块之间的流信息,生成目标纹理区域的像素值;4) 对合成结果进行优化,以减少视觉不连续性。

关键创新:NIFTY的关键创新在于它将非局部块匹配与流匹配相结合,构建了一个非参数的纹理合成模型。与传统的基于块的方法相比,NIFTY不需要进行复杂的参数调整和优化,从而降低了算法的复杂度。与基于深度学习的方法相比,NIFTY不需要进行大量的训练,从而节省了计算资源。

关键设计:NIFTY的关键设计包括:1) 使用高效的非局部块匹配算法,快速找到相似的纹理块;2) 设计合理的流匹配策略,保证合成纹理的连续性和一致性;3) 采用后处理技术,进一步减少视觉伪影。

🖼️ 关键图片

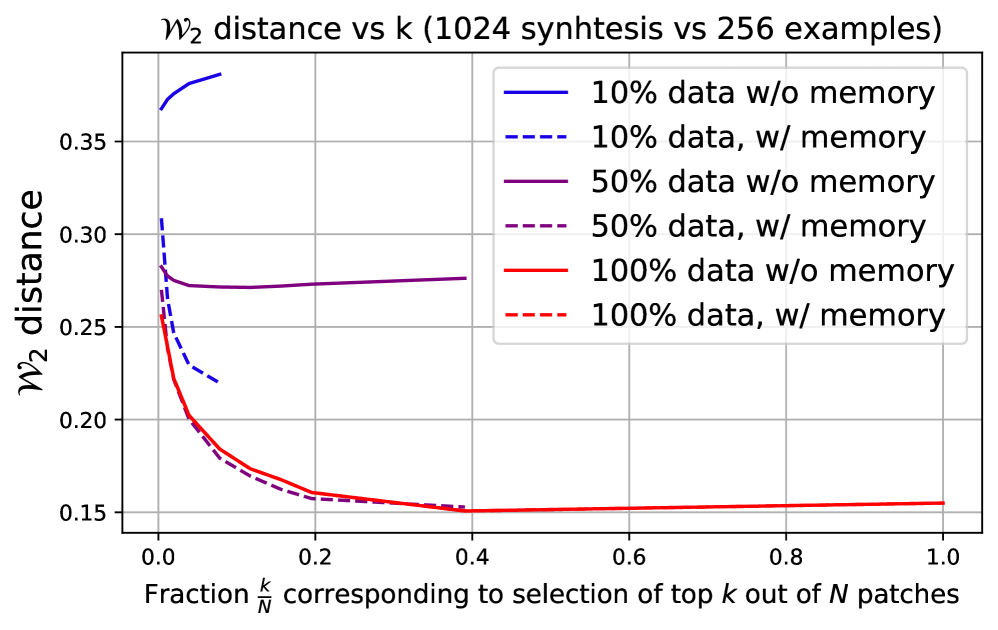

📊 实验亮点

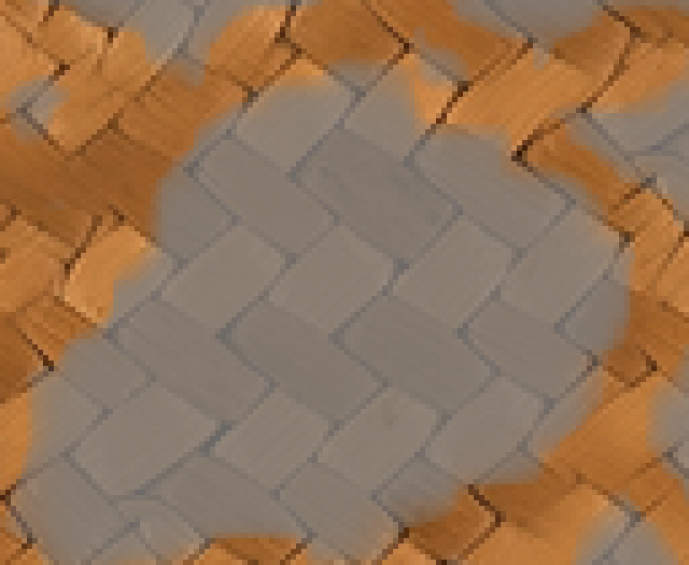

实验结果表明,NIFTY在纹理合成任务上取得了显著的性能提升。与现有的基于块的方法相比,NIFTY能够生成更加逼真和自然的纹理,并且能够有效地减少视觉伪影。与基于深度学习的方法相比,NIFTY在计算效率方面具有明显的优势,并且不需要进行大量的训练。

🎯 应用场景

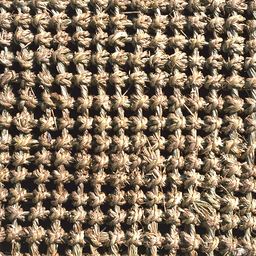

NIFTY具有广泛的应用前景,包括图像编辑、游戏开发、计算机辅助设计等领域。它可以用于生成各种逼真的纹理,例如木纹、石纹、布料纹理等。此外,NIFTY还可以用于图像修复和图像增强,提高图像的视觉质量。未来,NIFTY有望应用于虚拟现实和增强现实等新兴领域,为用户提供更加沉浸式的体验。

📄 摘要(原文)

This paper addresses the problem of exemplar-based texture synthesis. We introduce NIFTY, a hybrid framework that combines recent insights on diffusion models trained with convolutional neural networks, and classical patch-based texture optimization techniques. NIFTY is a non-parametric flow-matching model built on non-local patch matching, which avoids the need for neural network training while alleviating common shortcomings of patch-based methods, such as poor initialization or visual artifacts. Experimental results demonstrate the effectiveness of the proposed approach compared to representative methods from the literature. Code is available at https://github.com/PierrickCh/Nifty.git