DynaNav: Dynamic Feature and Layer Selection for Efficient Visual Navigation

作者: Jiahui Wang, Changhao Chen

分类: cs.CV, cs.RO

发布日期: 2025-09-26

备注: Accepted as a poster in NeurIPS 2025

💡 一句话要点

DynaNav:针对高效视觉导航的动态特征与层选择框架

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 视觉导航 动态特征选择 早退机制 贝叶斯优化 机器人 具身智能 Transformer 模型压缩

📋 核心要点

- 现有视觉导航模型,特别是基于Transformer解码器的模型,计算开销大且缺乏可解释性,难以在资源受限场景部署。

- DynaNav通过动态特征和层选择,根据场景复杂度自适应调整计算资源,提高效率和可解释性。

- 实验表明,DynaNav在降低FLOPs、推理时间和内存使用的同时,提升了导航性能。

📝 摘要(中文)

视觉导航对于机器人和具身智能至关重要。然而,现有的基础模型,特别是那些带有Transformer解码器的模型,存在计算开销高和缺乏可解释性的问题,限制了它们在资源受限场景中的部署。为了解决这个问题,我们提出了DynaNav,一个动态视觉导航框架,它基于场景复杂度自适应地进行特征和层选择。它采用可训练的硬特征选择器进行稀疏操作,从而提高效率和可解释性。此外,我们将特征选择集成到早退机制中,利用贝叶斯优化确定最佳退出阈值,以降低计算成本。在基于真实世界的数据集和模拟环境中的大量实验表明了DynaNav的有效性。与ViNT相比,DynaNav实现了2.26倍的FLOPs减少,42.3%的推理时间降低和32.8%的内存使用量降低,同时提高了四个公共数据集上的导航性能。

🔬 方法详解

问题定义:现有基于Transformer的视觉导航模型计算量大,难以在资源受限的机器人平台上部署。同时,模型内部的特征重要性难以解释,阻碍了进一步优化和改进。因此,需要一种既能降低计算成本,又能提高模型可解释性的视觉导航方法。

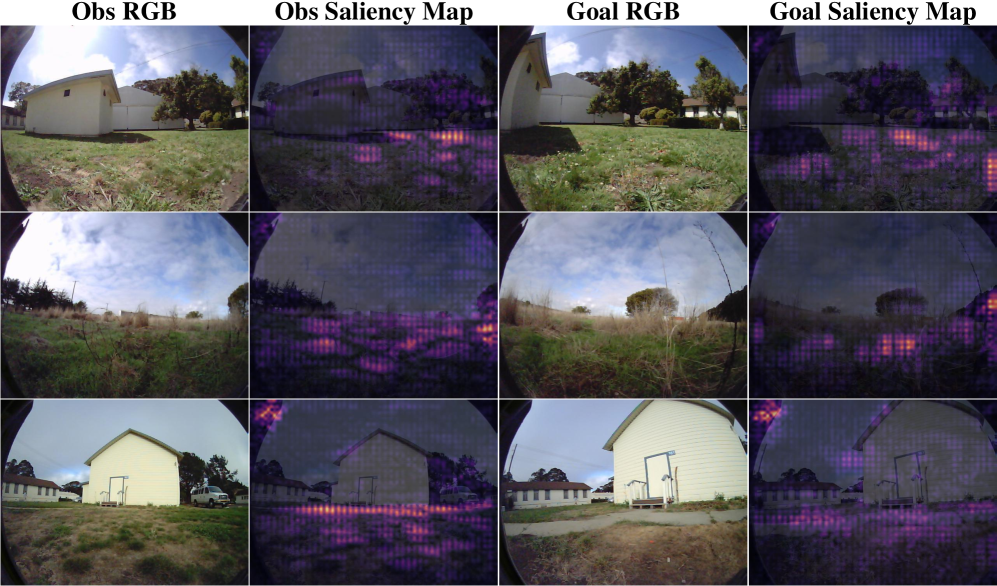

核心思路:DynaNav的核心思路是根据场景的复杂程度,动态地选择重要的特征和网络层进行计算,从而减少不必要的计算开销。通过可训练的硬特征选择器来稀疏化特征,并结合早退机制,在模型推理的早期阶段就可能做出决策,进一步降低计算量。

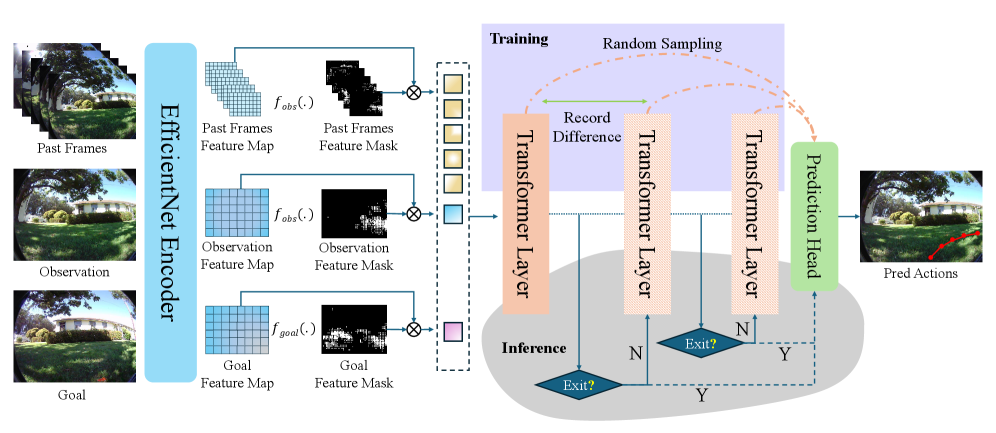

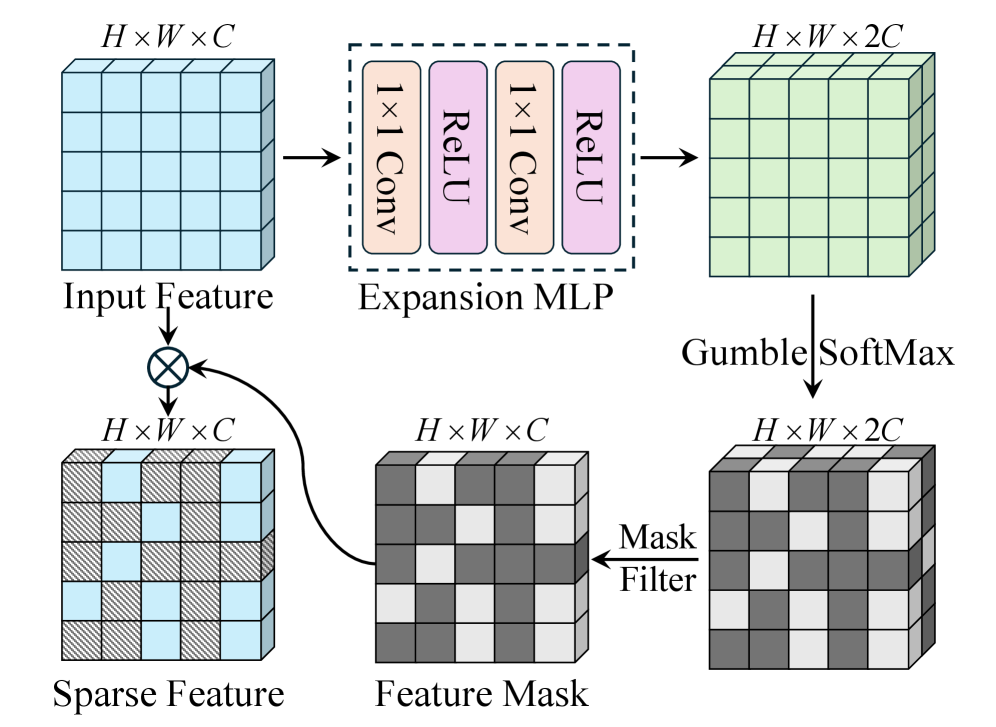

技术框架:DynaNav框架主要包含三个模块:特征提取模块、动态特征选择模块和早退机制模块。特征提取模块负责从输入图像中提取视觉特征。动态特征选择模块使用可训练的硬特征选择器,根据场景复杂度选择重要的特征子集。早退机制模块则在网络的不同层设置退出点,并使用贝叶斯优化来确定最佳的退出阈值。如果模型在某个退出点的置信度超过阈值,则提前终止推理。

关键创新:DynaNav的关键创新在于动态特征选择和早退机制的结合。动态特征选择通过可训练的硬特征选择器实现,能够有效地稀疏化特征,降低计算量。早退机制则允许模型在推理的早期阶段就做出决策,进一步减少计算开销。此外,使用贝叶斯优化来确定最佳的退出阈值,保证了在降低计算成本的同时,不会显著降低导航性能。

关键设计:硬特征选择器使用Gumbel-Softmax技巧进行训练,使其可微。贝叶斯优化用于搜索早退机制的最佳阈值,目标是在满足性能要求的前提下,最小化计算成本。损失函数包括导航损失、特征选择损失和早退损失,共同优化模型的导航性能、特征选择和早退策略。

🖼️ 关键图片

📊 实验亮点

DynaNav在四个公共数据集上进行了实验,结果表明,与ViNT相比,DynaNav实现了2.26倍的FLOPs减少,42.3%的推理时间降低和32.8%的内存使用量降低,同时提高了导航性能。这些结果表明,DynaNav能够有效地降低计算成本,并提高视觉导航的效率。

🎯 应用场景

DynaNav适用于资源受限的机器人和具身智能应用,例如无人机导航、移动机器人路径规划、智能家居等。通过降低计算成本和提高效率,DynaNav能够使这些应用在算力有限的设备上运行,并延长电池续航时间。此外,DynaNav的可解释性有助于理解模型的决策过程,从而提高系统的可靠性和安全性。

📄 摘要(原文)

Visual navigation is essential for robotics and embodied AI. However, existing foundation models, particularly those with transformer decoders, suffer from high computational overhead and lack interpretability, limiting their deployment in resource-tight scenarios. To address this, we propose DynaNav, a Dynamic Visual Navigation framework that adapts feature and layer selection based on scene complexity. It employs a trainable hard feature selector for sparse operations, enhancing efficiency and interpretability. Additionally, we integrate feature selection into an early-exit mechanism, with Bayesian Optimization determining optimal exit thresholds to reduce computational cost. Extensive experiments in real-world-based datasets and simulated environments demonstrate the effectiveness of DynaNav. Compared to ViNT, DynaNav achieves a 2.26x reduction in FLOPs, 42.3% lower inference time, and 32.8% lower memory usage, while improving navigation performance across four public datasets.