VIMD: Monocular Visual-Inertial Motion and Depth Estimation

作者: Saimouli Katragadda, Guoquan Huang

分类: cs.CV, cs.RO

发布日期: 2025-09-24 (更新: 2025-09-29)

💡 一句话要点

VIMD:单目视觉惯性运动与深度估计,提升机器人和XR的3D感知

🎯 匹配领域: 支柱三:空间感知与语义 (Perception & Semantics) 支柱八:物理动画 (Physics-based Animation)

关键词: 单目视觉惯性 深度估计 多视角几何 尺度细化 机器人 增强现实 视觉里程计

📋 核心要点

- 现有单目深度估计方法通常依赖全局仿射模型,精度受限,且难以处理稀疏深度信息。

- VIMD框架利用多视角信息迭代细化每个像素的尺度,从而更准确地估计稠密深度。

- 实验表明,VIMD在稀疏深度点情况下仍表现出色,并在多个数据集上具有良好的泛化能力。

📝 摘要(中文)

本文提出了一种单目视觉惯性运动和深度(VIMD)学习框架,旨在利用基于MSCKF的精确高效的单目视觉惯性运动跟踪来估计稠密度量深度。VIMD的核心在于利用多视角信息迭代地细化每个像素的尺度,而不是像先前的工作那样全局拟合不变的仿射模型。VIMD框架具有高度模块化,使其能够与各种现有的深度估计骨干网络兼容。我们在TartanAir和VOID数据集上进行了广泛的评估,并展示了其在AR Table数据集上的零样本泛化能力。结果表明,即使在每个图像只有10-20个度量深度点的极稀疏点情况下,VIMD也能实现出色的精度和鲁棒性。这使得所提出的VIMD成为在资源受限环境中部署的实用解决方案,同时其强大的性能和强大的泛化能力为各种场景提供了巨大的潜力。

🔬 方法详解

问题定义:论文旨在解决单目视觉惯性系统中精确且高效的稠密深度估计问题。现有方法,尤其是基于单目视觉的深度估计,通常依赖于全局仿射模型进行尺度恢复,这在复杂场景和稀疏深度信息下表现不佳。因此,如何利用视觉惯性信息,在资源受限的条件下实现鲁棒且精确的深度估计是本文要解决的核心问题。

核心思路:VIMD的核心思路是利用多视角几何约束,通过迭代优化每个像素的尺度信息来提升深度估计的精度。与全局拟合仿射模型不同,VIMD通过局部优化策略,能够更好地适应场景变化和稀疏深度信息,从而实现更准确的深度估计。这种逐像素尺度细化的方法能够有效利用视觉惯性里程计提供的运动信息,提高深度估计的鲁棒性。

技术框架:VIMD框架主要包含以下几个模块:1) 基于MSCKF的单目视觉惯性里程计,用于提供精确的相机位姿估计;2) 深度估计骨干网络,用于从单目图像中提取初始深度信息;3) 多视角尺度细化模块,该模块利用视觉惯性里程计提供的位姿信息,将不同视角的图像进行对齐,并通过迭代优化每个像素的尺度信息来提升深度估计的精度。整个框架是模块化的,可以灵活地替换不同的深度估计骨干网络。

关键创新:VIMD最重要的技术创新点在于其逐像素尺度细化的策略。与现有方法中全局拟合仿射模型不同,VIMD通过迭代优化每个像素的尺度信息,能够更好地适应场景变化和稀疏深度信息。这种局部优化策略能够有效利用视觉惯性里程计提供的运动信息,提高深度估计的鲁棒性和精度。此外,VIMD框架的模块化设计也使其能够灵活地与不同的深度估计骨干网络结合。

关键设计:VIMD的关键设计包括:1) 基于MSCKF的视觉惯性里程计,提供精确的相机位姿估计;2) 多视角尺度细化模块,该模块通过最小化重投影误差来优化每个像素的尺度信息。具体的损失函数设计包括光度一致性损失和几何一致性损失,用于约束不同视角下的图像一致性和深度一致性。网络结构方面,VIMD可以采用各种现有的深度估计骨干网络,如ResNet、DenseNet等。关键参数设置包括迭代优化次数、学习率等,这些参数需要根据具体数据集进行调整。

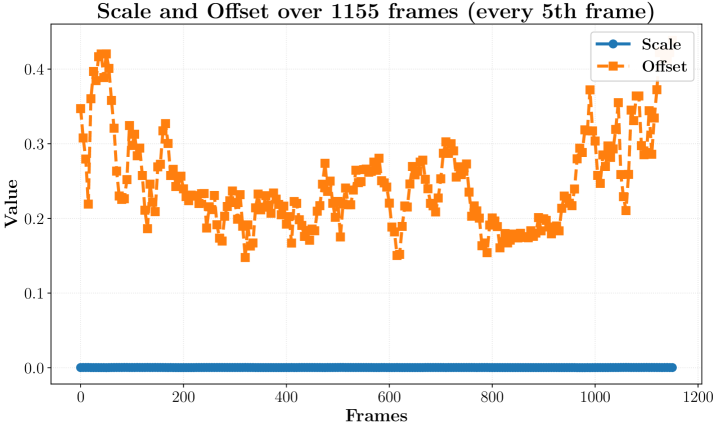

🖼️ 关键图片

📊 实验亮点

VIMD在TartanAir和VOID数据集上进行了广泛的评估,并在AR Table数据集上展示了其零样本泛化能力。实验结果表明,即使在每个图像只有10-20个度量深度点的极稀疏点情况下,VIMD也能实现出色的精度和鲁棒性。相较于现有方法,VIMD在深度估计精度方面取得了显著提升,并且具有更强的泛化能力。

🎯 应用场景

VIMD在机器人、增强现实(AR)和虚拟现实(VR)等领域具有广泛的应用前景。在机器人领域,VIMD可以用于提升机器人的环境感知能力,使其能够更好地进行导航、避障和目标识别。在AR/VR领域,VIMD可以用于构建更逼真的3D场景,提升用户的沉浸式体验。此外,VIMD在自动驾驶、三维重建等领域也具有潜在的应用价值。

📄 摘要(原文)

Accurate and efficient dense metric depth estimation is crucial for 3D visual perception in robotics and XR. In this paper, we develop a monocular visual-inertial motion and depth (VIMD) learning framework to estimate dense metric depth by leveraging accurate and efficient MSCKF-based monocular visual-inertial motion tracking. At the core the proposed VIMD is to exploit multi-view information to iteratively refine per-pixel scale, instead of globally fitting an invariant affine model as in the prior work. The VIMD framework is highly modular, making it compatible with a variety of existing depth estimation backbones. We conduct extensive evaluations on the TartanAir and VOID datasets and demonstrate its zero-shot generalization capabilities on the AR Table dataset. Our results show that VIMD achieves exceptional accuracy and robustness, even with extremely sparse points as few as 10-20 metric depth points per image. This makes the proposed VIMD a practical solution for deployment in resource constrained settings, while its robust performance and strong generalization capabilities offer significant potential across a wide range of scenarios.