Informative Text-Image Alignment for Visual Affordance Learning with Foundation Models

作者: Qian Zhang, Lin Zhang, Xing Fang, Mingxin Zhang, Zhiyuan Wei, Ran Song, Wei Zhang

分类: cs.CV, cs.AI

发布日期: 2025-09-21

备注: Submitted to the IEEE International Conference on Robotics and Automation (ICRA) 2026

💡 一句话要点

提出信息对齐框架,利用基础模型提升文本引导的视觉可供性学习。

🎯 匹配领域: 支柱三:空间感知与语义 (Perception & Semantics) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 视觉可供性学习 文本图像对齐 互信息最大化 基础模型 机器人操作

📋 核心要点

- 现有视觉可供性学习方法忽略了视觉图像和文本描述之间的特征对齐,导致性能瓶颈。

- 论文提出信息对齐框架,通过互信息最大化实现文本提示与视觉特征的对齐。

- 实验表明,该方法在AGD20K数据集上超越现有方法,实现单样本可供性学习的SOTA。

📝 摘要(中文)

视觉可供性学习对于机器人理解和与物理世界有效交互至关重要。近年来,该领域的研究尝试利用视觉-语言基础模型的预训练知识,以有限的训练数据学习可供性属性,为视觉可供性学习提供了一种新的范式。然而,这些方法忽略了在识别文本引导下的可供性区域时,保持视觉图像和语言描述之间特征对齐的重要性,从而可能导致次优结果。本文提出了一个用于文本引导可供性学习的信息框架,该框架涉及基于信息的约束,以在特征级别实现文本-图像对齐。具体来说,我们设计了一种可供性互信息约束,通过最大化输入图像中可供性区域的特征与相应文本提示之间的互信息,来帮助同时学习适当的文本提示和面向任务的视觉特征。此外,我们提出了一种对象级信息约束,该约束最大化给定对象的视觉特征与其所属类别的文本特征之间的互信息。这使得模型能够捕获对象的高质量表示,为识别可供性区域提供更可靠的语义先验。在AGD20K数据集上的实验结果表明,该方法优于现有方法,并在单样本可供性学习中实现了新的最先进水平。

🔬 方法详解

问题定义:现有基于视觉-语言基础模型的可供性学习方法,在利用文本信息引导可供性区域识别时,忽略了图像视觉特征和文本描述特征之间的对齐问题。这种不对齐会导致模型无法准确理解文本的意图,从而影响可供性预测的准确性。

核心思路:论文的核心思路是通过引入信息论中的互信息最大化原则,显式地约束图像视觉特征和文本描述特征之间的对齐。具体来说,分别在可供性区域和对象级别上,最大化视觉特征和文本特征之间的互信息,从而迫使模型学习到更具信息量的、对齐的特征表示。

技术框架:该框架包含两个主要的信息约束模块:可供性互信息约束和对象级信息约束。首先,输入图像和文本提示经过各自的编码器提取特征。然后,可供性互信息约束模块计算可供性区域的视觉特征和对应文本提示特征之间的互信息,并最大化该互信息。类似地,对象级信息约束模块计算图像中对象的视觉特征和对象类别文本描述特征之间的互信息,并最大化该互信息。最后,将这些约束作为损失函数的一部分,用于训练整个模型。

关键创新:该方法最重要的创新点在于,它显式地将信息论中的互信息最大化原则引入到视觉可供性学习中,从而有效地解决了图像视觉特征和文本描述特征之间的不对齐问题。与现有方法相比,该方法能够学习到更具信息量的、对齐的特征表示,从而提高了可供性预测的准确性。

关键设计:可供性互信息约束通过计算可供性区域的视觉特征和对应文本提示特征之间的互信息来实现。对象级信息约束通过计算图像中对象的视觉特征和对象类别文本描述特征之间的互信息来实现。互信息的计算可以使用各种方法,例如基于神经网络的互信息估计器。损失函数由可供性互信息损失、对象级信息损失和其他辅助损失(例如分割损失)组成。具体的网络结构和参数设置需要根据具体的任务和数据集进行调整。

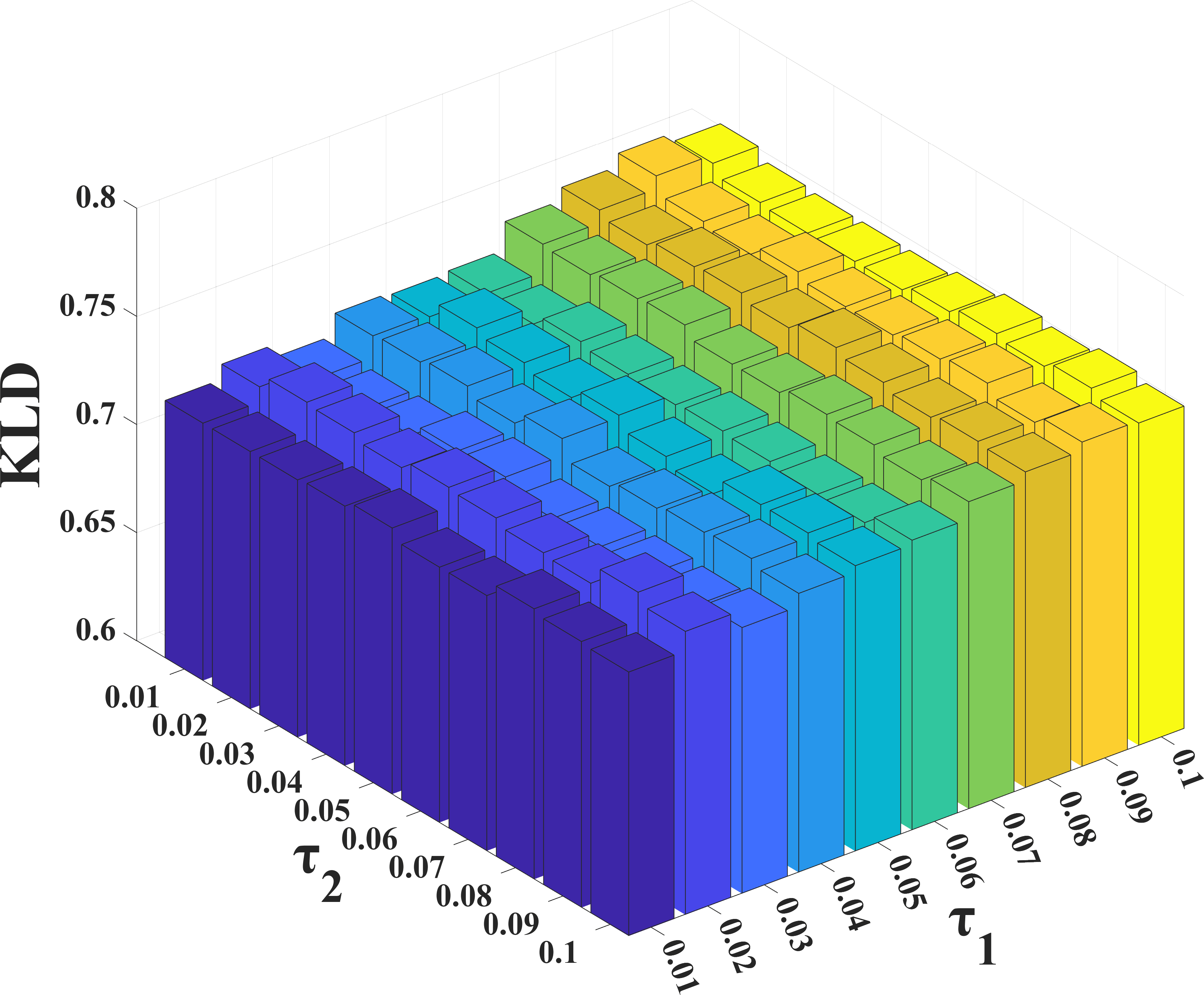

🖼️ 关键图片

📊 实验亮点

在AGD20K数据集上的实验结果表明,该方法在单样本可供性学习任务上取得了显著的性能提升,超越了现有的SOTA方法。具体来说,该方法在多个指标上都取得了显著的提升,证明了其有效性。

🎯 应用场景

该研究成果可应用于机器人操作、人机交互、自动驾驶等领域。例如,机器人可以利用该技术理解人类的指令,从而更安全、更有效地完成各种任务。在自动驾驶领域,该技术可以帮助车辆理解周围环境,从而做出更合理的决策。

📄 摘要(原文)

Visual affordance learning is crucial for robots to understand and interact effectively with the physical world. Recent advances in this field attempt to leverage pre-trained knowledge of vision-language foundation models to learn affordance properties with limited training data, providing a novel paradigm for visual affordance learning. However, these methods overlook the significance of maintaining feature alignment between visual images and language descriptions for identifying affordance areas with textual guidance, and thus may lead to suboptimal results. In this paper, we present an informative framework for text-guided affordance learning, which involves information-based constraints to achieve text-image alignment at feature level. Specifically, we design an affordance mutual information constraint that helps learn appropriate textual prompts and task-oriented visual features simultaneously by maximizing the mutual information between the features of the affordance areas in the input images and the corresponding textual prompts. In addition, we propose an object-level information constraint that maximizes the mutual information between the visual features of a given object and the text features of the category it belongs to. This enables the model to capture high-quality representations for the object, providing more reliable semantic priors for identifying affordance regions. Experimental results on the AGD20K dataset show that the proposed method outperforms existing approaches and achieves the new state-of-the-art in one-shot affordance learning.