AgriDoctor: A Multimodal Intelligent Assistant for Agriculture

作者: Mingqing Zhang, Zhuoning Xu, Peijie Wang, Rongji Li, Liang Wang, Qiang Liu, Jian Xu, Xuyao Zhang, Shu Wu, Liang Wang

分类: cs.CV

发布日期: 2025-09-21

💡 一句话要点

提出AgriDoctor多模态智能助手,解决农业领域作物病害诊断难题。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 多模态学习 农业智能 作物病害诊断 大型语言模型 视觉-语言模型

📋 核心要点

- 现有作物病害诊断方法依赖单模态模型,缺乏领域知识整合和交互式语言理解能力。

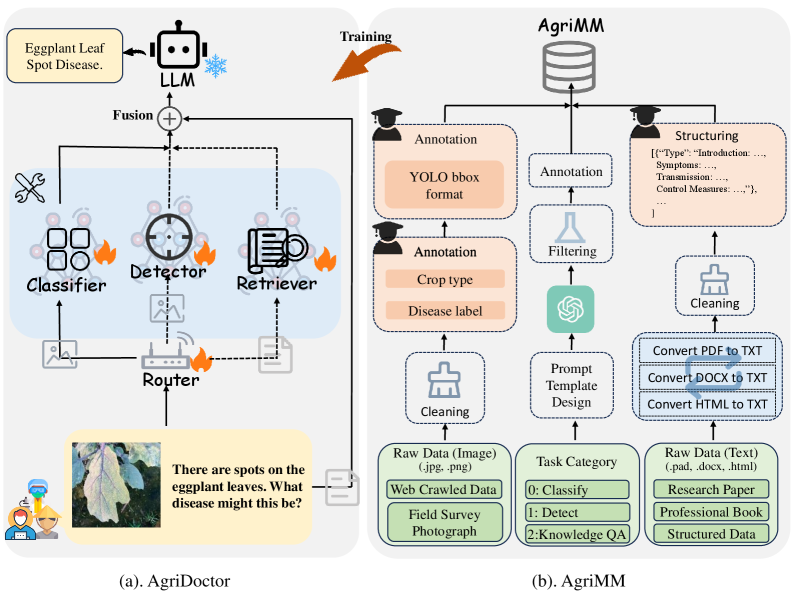

- AgriDoctor通过集成路由器、分类器、检测器、知识检索器和LLMs,实现多模态智能诊断。

- AgriDoctor在AgriMM数据集上训练,显著优于现有LVLMs,为农业应用提供新范例。

📝 摘要(中文)

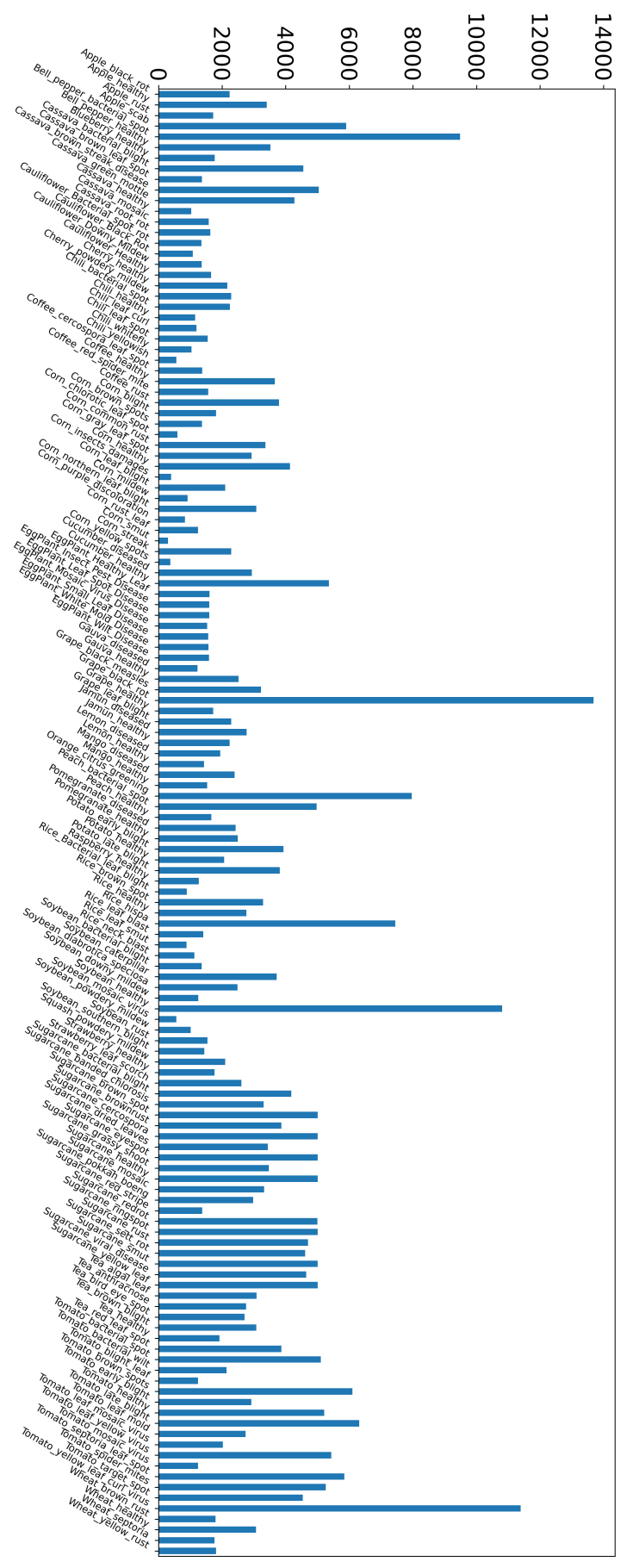

精准的作物病害诊断对于可持续农业和全球粮食安全至关重要。现有的方法主要依赖于单模态模型,如基于图像的分类器和目标检测器,它们在整合领域特定的农业知识方面存在局限性,并且缺乏对交互式、基于语言的理解的支持。大型语言模型(LLMs)和大型视觉-语言模型(LVLMs)的最新进展为多模态推理开辟了新的途径。然而,由于缺乏专门的数据集和领域适应不足,它们在农业环境中的性能仍然有限。本文提出了AgriDoctor,一个模块化和可扩展的多模态框架,专为智能作物病害诊断和农业知识交互而设计。作为将基于代理的多模态推理引入农业领域的开创性尝试,AgriDoctor为构建交互式和领域自适应的作物健康解决方案提供了一种新的范例。它集成了五个核心组件:路由器、分类器、检测器、知识检索器和LLMs。为了促进有效的训练和评估,我们构建了AgriMM,一个综合基准,包含400000张带注释的疾病图像,831条专家策划的知识条目,以及300000条用于意图驱动的工具选择的双语提示。大量的实验表明,在AgriMM上训练的AgriDoctor在细粒度的农业任务上显著优于最先进的LVLMs,为智能和可持续农业应用建立了一种新的范例。

🔬 方法详解

问题定义:现有作物病害诊断方法主要依赖于图像分类或目标检测等单模态方法,无法有效利用农业领域知识,且缺乏与用户的交互能力,难以满足实际应用需求。这些方法在细粒度病害识别和复杂场景下的诊断精度较低,难以应对多样化的农业环境。

核心思路:AgriDoctor的核心思路是构建一个模块化、可扩展的多模态框架,通过集成多种工具(分类器、检测器、知识检索器等)和大型语言模型,实现对作物病害的综合诊断和知识交互。该框架旨在模拟专家诊断过程,利用视觉信息、领域知识和用户提问,进行多轮推理和决策。

技术框架:AgriDoctor框架包含五个核心模块:1) 路由器:根据用户输入(图像、问题等)选择合适的工具;2) 分类器:对作物病害进行初步分类;3) 检测器:精确定位病害区域;4) 知识检索器:从农业知识库中检索相关信息;5) LLMs:整合各模块输出,生成诊断结果和建议。整个流程通过意图驱动的工具选择机制进行协调,实现多模态信息的融合和推理。

关键创新:AgriDoctor的关键创新在于将基于代理的多模态推理引入农业领域,构建了一个可交互、领域自适应的作物健康解决方案。与传统的单模态方法相比,AgriDoctor能够利用多种信息源进行综合诊断,并支持用户提问和知识交互。此外,AgriMM数据集的构建也为该领域的研究提供了重要的数据支撑。

关键设计:AgriDoctor框架的关键设计包括:1) 路由器采用意图识别模型,根据用户输入选择合适的工具;2) 分类器和检测器采用深度学习模型,如ResNet和YOLO,进行图像特征提取和病害识别;3) 知识检索器基于向量数据库,实现快速检索;4) LLMs采用预训练模型,如GPT系列,进行知识整合和文本生成。损失函数方面,可能采用了交叉熵损失、目标检测损失等,具体细节未知。

🖼️ 关键图片

📊 实验亮点

AgriDoctor在AgriMM数据集上进行了大量实验,结果表明其在细粒度的农业任务上显著优于最先进的LVLMs。具体性能数据未知,但论文强调了AgriDoctor在作物病害诊断和知识交互方面的优越性,为智能农业应用建立了一种新的范例。

🎯 应用场景

AgriDoctor可应用于智能农业、精准农业等领域,为农民提供作物病害的快速诊断和防治建议,降低农药使用,提高农作物产量和质量,促进农业可持续发展。该系统还可用于农业知识普及和技术培训,提升农民的专业技能。

📄 摘要(原文)

Accurate crop disease diagnosis is essential for sustainable agriculture and global food security. Existing methods, which primarily rely on unimodal models such as image-based classifiers and object detectors, are limited in their ability to incorporate domain-specific agricultural knowledge and lack support for interactive, language-based understanding. Recent advances in large language models (LLMs) and large vision-language models (LVLMs) have opened new avenues for multimodal reasoning. However, their performance in agricultural contexts remains limited due to the absence of specialized datasets and insufficient domain adaptation. In this work, we propose AgriDoctor, a modular and extensible multimodal framework designed for intelligent crop disease diagnosis and agricultural knowledge interaction. As a pioneering effort to introduce agent-based multimodal reasoning into the agricultural domain, AgriDoctor offers a novel paradigm for building interactive and domain-adaptive crop health solutions. It integrates five core components: a router, classifier, detector, knowledge retriever and LLMs. To facilitate effective training and evaluation, we construct AgriMM, a comprehensive benchmark comprising 400000 annotated disease images, 831 expert-curated knowledge entries, and 300000 bilingual prompts for intent-driven tool selection. Extensive experiments demonstrate that AgriDoctor, trained on AgriMM, significantly outperforms state-of-the-art LVLMs on fine-grained agricultural tasks, establishing a new paradigm for intelligent and sustainable farming applications.