ME-Mamba: Multi-Expert Mamba with Efficient Knowledge Capture and Fusion for Multimodal Survival Analysis

作者: Chengsheng Zhang, Linhao Qu, Xiaoyu Liu, Zhijian Song

分类: cs.CV, cs.AI

发布日期: 2025-09-21

💡 一句话要点

提出ME-Mamba,用于高效融合病理图像和基因组数据的多模态生存分析。

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 多模态生存分析 病理图像 基因组数据 Mamba架构 最优传输 最大均值差异 癌症预后

📋 核心要点

- 病理图像生存分析面临挑战,现有方法难以从仅有切片级别标签的千兆像素WSI中学习判别性表示。

- ME-Mamba通过病理专家、基因组专家和协同专家,分别提取单模态特征、融合多模态信息,实现高效的生存分析。

- 在五个TCGA数据集上的实验表明,ME-Mamba在生存分析任务上取得了优于现有技术水平的性能。

📝 摘要(中文)

本研究提出了一种多专家Mamba(ME-Mamba)系统,旨在捕获判别性的病理和基因组特征,并实现两种模态的高效整合,从而进行准确的癌症生存分析。该方法通过互补的信息融合,避免了关键信息的丢失。ME-Mamba包含病理专家和基因组专家,分别处理单模态数据,利用Mamba架构提取长序列中的判别性特征。同时,设计了协同专家,通过最优传输学习模态间的token级局部对应关系,并通过基于最大均值差异的全局跨模态融合损失增强分布一致性。融合后的特征表示被传递到Mamba骨干网络进行进一步整合。在多个TCGA数据集上的实验结果表明,该方法在计算复杂度相对较低的情况下,实现了最先进的性能。

🔬 方法详解

问题定义:论文旨在解决多模态生存分析中,如何有效融合病理图像和基因组数据,从而更准确地预测癌症患者生存时间的问题。现有方法难以从大规模病理图像中学习判别性特征,并且在多模态融合时可能丢失关键信息,导致生存分析的准确性受限。

核心思路:论文的核心思路是设计一个多专家系统,每个专家负责处理特定模态的数据或进行模态融合。通过这种分工合作的方式,可以更有效地提取各模态的特征,并实现互补的信息融合,从而提高生存分析的准确性。Mamba架构的应用旨在处理病理图像和基因组数据的长序列特性,提取判别性特征。

技术框架:ME-Mamba系统包含三个主要模块:病理专家、基因组专家和协同专家。病理专家和基因组专家分别使用Mamba架构处理病理图像和基因组数据,提取单模态特征。协同专家负责融合两种模态的信息,通过最优传输学习模态间的局部对应关系,并通过最大均值差异损失增强分布一致性。融合后的特征被传递到Mamba骨干网络进行进一步整合,最终用于生存分析。

关键创新:ME-Mamba的关键创新在于多专家架构的设计,它允许针对不同模态的数据和融合过程进行专门优化。协同专家利用最优传输和最大均值差异损失,显式地学习模态间的对应关系,并隐式地增强分布一致性,从而实现更有效的模态融合。Mamba架构在病理和基因组专家中的应用,使其能够处理长序列数据,提取判别性特征。

关键设计:病理专家和基因组专家中的Mamba架构采用了常规扫描和基于注意力的扫描机制,以提取长序列中的判别性特征。协同专家使用最优传输算法学习模态间的token级局部对应关系。全局跨模态融合损失基于最大均值差异,用于增强不同模态特征分布的一致性。最终的生存分析模型使用Cox比例风险模型进行训练和预测。

🖼️ 关键图片

📊 实验亮点

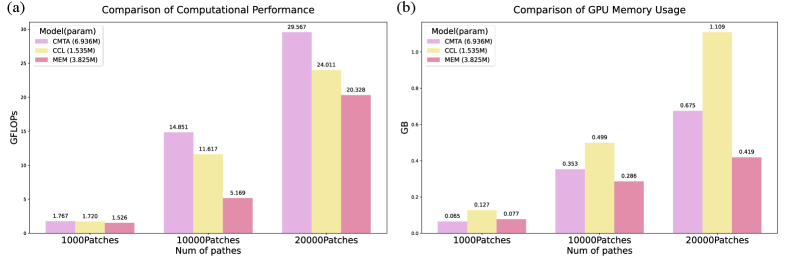

ME-Mamba在五个TCGA数据集上进行了广泛的实验,结果表明其性能优于现有的最先进方法。具体性能数据在论文中给出,表明ME-Mamba在生存分析任务上具有显著的优势,能够更准确地预测癌症患者的生存时间。

🎯 应用场景

ME-Mamba可应用于癌症诊断和预后预测,辅助医生制定更精准的治疗方案。通过整合病理图像和基因组数据,该方法能够更全面地评估患者的病情,预测生存风险,并为个性化治疗提供依据。未来,该研究可扩展到其他疾病的生存分析,并与其他临床数据相结合,构建更强大的预测模型。

📄 摘要(原文)

Survival analysis using whole-slide images (WSIs) is crucial in cancer research. Despite significant successes, pathology images typically only provide slide-level labels, which hinders the learning of discriminative representations from gigapixel WSIs. With the rapid advancement of high-throughput sequencing technologies, multimodal survival analysis integrating pathology images and genomics data has emerged as a promising approach. We propose a Multi-Expert Mamba (ME-Mamba) system that captures discriminative pathological and genomic features while enabling efficient integration of both modalities. This approach achieves complementary information fusion without losing critical information from individual modalities, thereby facilitating accurate cancer survival analysis. Specifically, we first introduce a Pathology Expert and a Genomics Expert to process unimodal data separately. Both experts are designed with Mamba architectures that incorporate conventional scanning and attention-based scanning mechanisms, allowing them to extract discriminative features from long instance sequences containing substantial redundant or irrelevant information. Second, we design a Synergistic Expert responsible for modality fusion. It explicitly learns token-level local correspondences between the two modalities via Optimal Transport, and implicitly enhances distribution consistency through a global cross-modal fusion loss based on Maximum Mean Discrepancy. The fused feature representations are then passed to a mamba backbone for further integration. Through the collaboration of the Pathology Expert, Genomics Expert, and Synergistic Expert, our method achieves stable and accurate survival analysis with relatively low computational complexity. Extensive experimental results on five datasets in The Cancer Genome Atlas (TCGA) demonstrate our state-of-the-art performance.