Person Identification from Egocentric Human-Object Interactions using 3D Hand Pose

作者: Muhammad Hamza, Danish Hamid, Muhammad Tahir Akram

分类: cs.CV, cs.ET, cs.HC, cs.LG

发布日期: 2025-09-20

备注: 21 pages, 8 figures, 7 tables. Preprint of a manuscript submitted to CCF Transactions on Pervasive Computing and Interaction (Springer), currently under review

💡 一句话要点

I2S框架:利用3D手部姿态进行人-物交互,实现增强现实中无感用户身份识别。

🎯 匹配领域: 支柱一:机器人控制 (Robot Control) 支柱五:交互与反应 (Interaction & Reaction) 支柱六:视频提取与匹配 (Video Extraction)

关键词: 人-物交互识别 3D手部姿态 用户身份识别 增强现实 手间空间包络 无感认证 轻量级模型

📋 核心要点

- 现有增强现实辅助技术在飞机驾驶舱等高风险环境中,缺乏有效且无感的身份识别方法。

- I2S框架通过分析3D手部姿态与物体交互,分阶段识别物体、HOI,最终实现用户身份验证。

- 实验表明,I2S在用户识别上达到97.52%的F1分数,模型轻量且推理速度快,适合实时应用。

📝 摘要(中文)

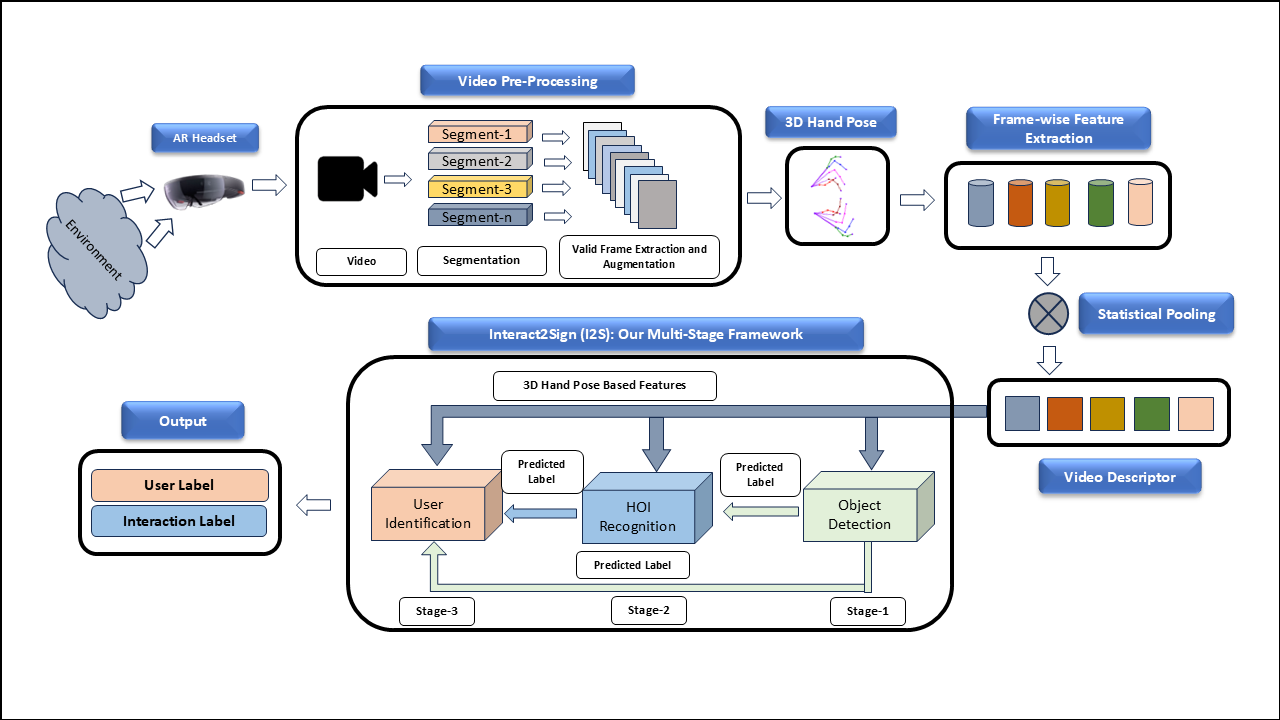

本研究提出I2S (Interact2Sign),一个多阶段框架,旨在通过人-物交互识别实现无感的用户身份识别,并利用以自我为中心的视频中的3D手部姿态分析。I2S利用从3D手部姿态中提取的手工特征,并执行顺序特征增强:首先识别物体类别,然后进行HOI识别,最后进行用户识别。对3D手部姿态进行了全面的特征提取和描述过程,将提取的特征组织成语义上有意义的类别:空间、频率、运动学、方向,以及本研究中引入的新型描述符,即手间空间包络(IHSE)。进行了广泛的消融研究,以确定最有效的特征组合。在从ARCTIC和H2O数据集衍生的双手物体操作数据集上评估,最佳配置在用户识别方面实现了97.52%的平均F1分数。I2S展示了最先进的性能,同时保持了小于4 MB的轻量级模型大小和0.1秒的快速推理时间。这些特性使所提出的框架非常适合在安全关键的、基于AR的系统中进行实时、设备上的身份验证。

🔬 方法详解

问题定义:论文旨在解决增强现实(AR)环境中,特别是高风险、以人为中心的环境(如飞机驾驶舱、航空航天维护和外科手术)中,如何实现无感且准确的用户身份识别问题。现有方法可能依赖于侵入式的生物特征识别或复杂的视觉分析,这些方法可能不适用于所有场景,并且可能对用户体验产生负面影响。因此,需要一种更自然、更不引人注意的身份验证方法。

核心思路:论文的核心思路是利用人与物体交互(HOI)过程中产生的3D手部姿态信息,通过分析手部运动、姿态和与物体的关系,推断出用户的身份。这种方法基于以下假设:不同的用户在与相同物体交互时,可能会表现出不同的手部姿态和运动模式,这些模式可以作为区分不同用户的特征。

技术框架:I2S框架是一个多阶段的顺序识别流程。首先,从以自我为中心的视频中提取3D手部姿态信息。然后,利用这些信息进行物体类别识别,确定用户正在操作的物体。接下来,进行HOI识别,分析手部与物体的交互方式。最后,基于物体类别和HOI识别的结果,进行用户身份识别。整个框架利用手工设计的特征和机器学习分类器来实现。

关键创新:论文的关键创新在于将3D手部姿态分析与HOI识别相结合,用于用户身份识别。此外,论文还提出了一个新的手部姿态描述符,即手间空间包络(IHSE),用于捕捉双手之间的空间关系。这种方法能够有效地利用手部姿态信息,提高用户身份识别的准确性。

关键设计:论文中,3D手部姿态特征被组织成五个语义类别:空间、频率、运动学、方向和IHSE。这些特征被用于训练机器学习分类器,例如支持向量机(SVM)或随机森林,以实现物体类别识别、HOI识别和用户身份识别。论文还进行了消融研究,以确定最有效的特征组合。模型大小被优化到小于4MB,推理时间保持在0.1秒以内,以满足实时应用的需求。

🖼️ 关键图片

📊 实验亮点

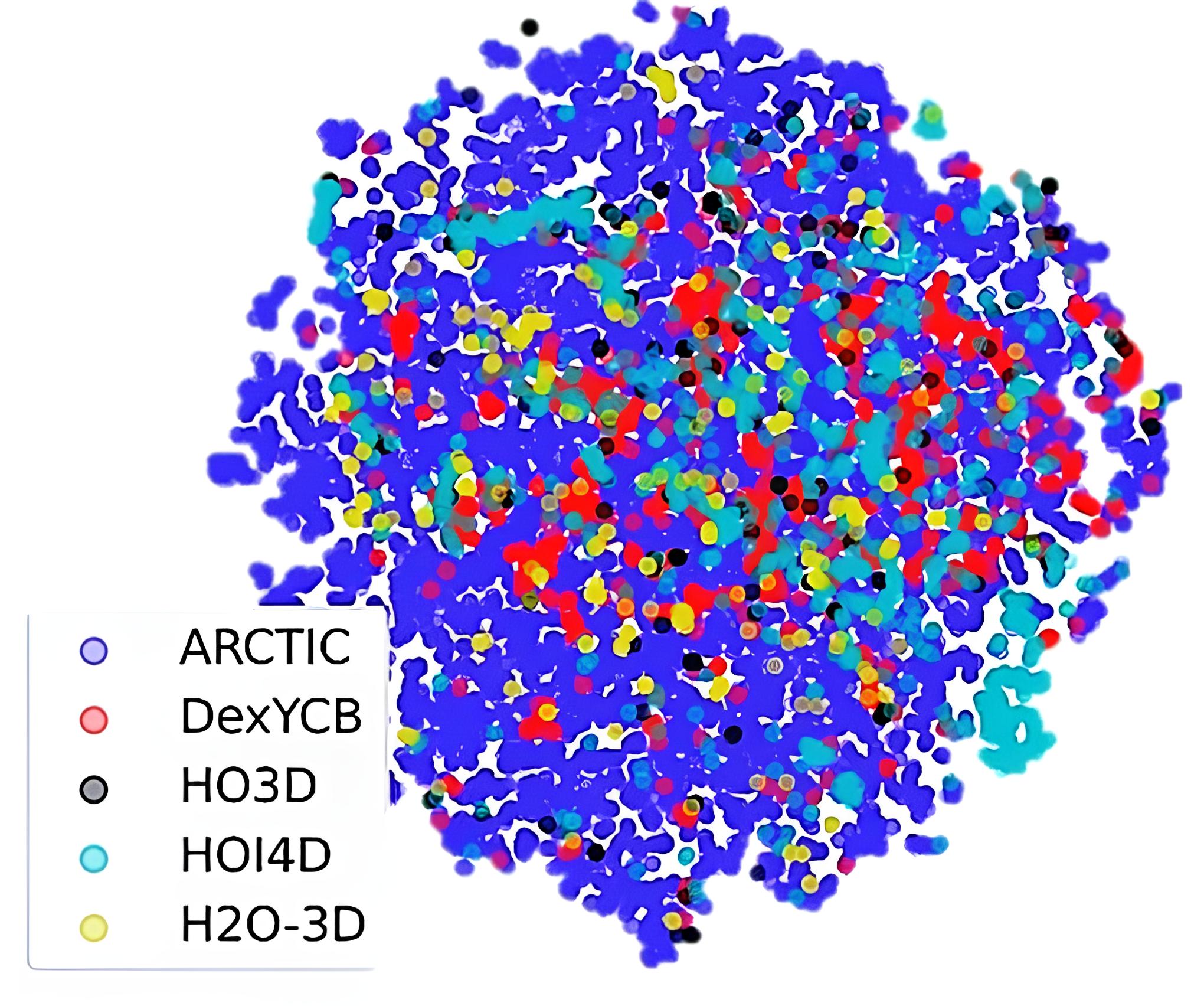

I2S框架在基于ARCTIC和H2O数据集的双手物体操作数据集上进行了评估,实现了97.52%的平均F1分数,显著优于现有方法。同时,该模型保持了小于4MB的轻量级大小和0.1秒的快速推理时间,使其非常适合在资源受限的设备上进行实时部署。消融实验验证了IHSE特征的有效性。

🎯 应用场景

该研究成果可应用于增强现实辅助系统,例如在飞机驾驶舱中,系统可以根据飞行员与控制面板的交互方式识别飞行员身份,并自动加载个性化设置。在外科手术中,系统可以通过识别医生与手术器械的交互来验证医生身份,并提供相应的辅助信息。此外,该技术还可用于其他需要安全认证的AR应用场景。

📄 摘要(原文)

Human-Object Interaction Recognition (HOIR) and user identification play a crucial role in advancing augmented reality (AR)-based personalized assistive technologies. These systems are increasingly being deployed in high-stakes, human-centric environments such as aircraft cockpits, aerospace maintenance, and surgical procedures. This research introduces I2S (Interact2Sign), a multi stage framework designed for unobtrusive user identification through human object interaction recognition, leveraging 3D hand pose analysis in egocentric videos. I2S utilizes handcrafted features extracted from 3D hand poses and per forms sequential feature augmentation: first identifying the object class, followed by HOI recognition, and ultimately, user identification. A comprehensive feature extraction and description process was carried out for 3D hand poses, organizing the extracted features into semantically meaningful categories: Spatial, Frequency, Kinematic, Orientation, and a novel descriptor introduced in this work, the Inter-Hand Spatial Envelope (IHSE). Extensive ablation studies were conducted to determine the most effective combination of features. The optimal configuration achieved an impressive average F1-score of 97.52% for user identification, evaluated on a bimanual object manipulation dataset derived from the ARCTIC and H2O datasets. I2S demonstrates state-of-the-art performance while maintaining a lightweight model size of under 4 MB and a fast inference time of 0.1 seconds. These characteristics make the proposed framework highly suitable for real-time, on-device authentication in security-critical, AR-based systems.