VC-Inspector: Advancing Reference-free Evaluation of Video Captions with Factual Analy

作者: Shubhashis Roy Dipta, Tz-Ying Wu, Subarna Tripathi

分类: cs.CV, cs.CL

发布日期: 2025-09-20 (更新: 2026-01-11)

💡 一句话要点

提出VC-Inspector,用于视频字幕的事实性无参考评价,提升准确性和可解释性。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 视频字幕评估 无参考评价 事实准确性 大型多模态模型 可控错误生成

📋 核心要点

- 现有视频字幕评价指标在上下文理解和事实性评估方面存在不足,且常依赖于闭源服务。

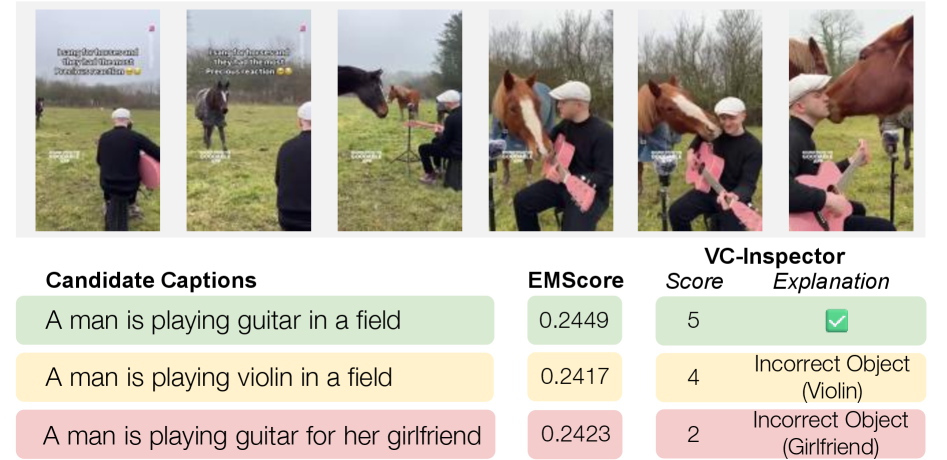

- VC-Inspector利用大型多模态模型,通过可控错误生成和分级标注,实现更准确的事实性评估。

- 实验表明,VC-Inspector在多个数据集上与人类判断的相关性达到SOTA,并具备提升字幕质量的潜力。

📝 摘要(中文)

本文提出VC-Inspector,一个轻量级的、开源的大型多模态模型(LMM),用于视频字幕的无参考评价,重点关注事实准确性。与现有指标在上下文处理、事实性评估或依赖专有服务方面存在局限不同,VC-Inspector提供了一种可复现的、具有事实感知能力的替代方案,与人类判断高度一致。为了实现稳健的训练和可解释的评估,我们系统性地生成带有可控错误的字幕,并配以分等级的质量分数和解释性注释。实验表明,VC-Inspector在VATEX-Eval、Flickr8K-Expert和Flickr8K-CF等不同领域的数据集上,与人类判断的相关性达到了最先进水平,并揭示了字幕改进的潜力。

🔬 方法详解

问题定义:现有视频字幕评估方法通常依赖于参考字幕,或者在评估事实准确性方面表现不佳。此外,许多方法依赖于专有服务,导致可复现性差。因此,需要一种无需参考字幕且能准确评估视频字幕事实性的方法,同时保证可复现性和可解释性。

核心思路:VC-Inspector的核心思路是利用大型多模态模型(LMM)的强大能力,直接从视频内容中提取信息,并与生成的字幕进行比较,从而判断字幕的事实准确性。通过系统性地生成带有可控错误的字幕,并进行分级标注,可以训练模型更好地理解和评估字幕的质量。

技术框架:VC-Inspector的整体框架包括以下几个主要阶段:1) 数据生成阶段:通过系统性的方法生成带有可控错误的字幕,并进行质量分级和解释性标注。2) 模型训练阶段:利用生成的数据训练大型多模态模型,使其能够评估字幕的事实准确性。3) 评估阶段:使用训练好的模型对新的视频字幕进行评估,并输出质量分数。

关键创新:VC-Inspector的关键创新在于其系统性的数据生成方法和对大型多模态模型的应用。通过可控错误生成和分级标注,可以有效地训练模型,使其能够更好地理解和评估字幕的事实准确性。此外,使用开源的大型多模态模型,保证了方法的可复现性和可扩展性。

关键设计:VC-Inspector的关键设计包括:1) 可控错误生成策略:设计多种类型的错误,例如对象替换、属性修改等,以模拟真实场景中的错误。2) 质量分级策略:根据错误类型和严重程度,对生成的字幕进行分级标注。3) 模型选择:选择合适的预训练大型多模态模型,并进行微调,以适应视频字幕评估任务。4) 损失函数:设计合适的损失函数,例如排序损失或回归损失,以优化模型的性能。

🖼️ 关键图片

📊 实验亮点

VC-Inspector在VATEX-Eval、Flickr8K-Expert和Flickr8K-CF等多个数据集上取得了最先进的性能,与人类判断的相关性显著高于现有方法。例如,在VATEX-Eval数据集上,VC-Inspector的相关性超过了现有最佳方法X-GPT-Eval 10%以上。实验结果表明,VC-Inspector能够有效地评估视频字幕的事实准确性,并具有良好的泛化能力。

🎯 应用场景

VC-Inspector可应用于视频内容理解、视频检索、视频生成等领域。它可以用于自动评估视频字幕的质量,从而提高视频内容的可访问性和用户体验。此外,还可以用于指导视频字幕的自动生成,提高生成字幕的准确性和流畅性。该研究的开源特性使其能够被广泛应用于学术研究和工业实践。

📄 摘要(原文)

We propose VC-Inspector, a lightweight, open-source large multimodal model (LMM) for reference-free evaluation of video captions, with a focus on factual accuracy. Unlike existing metrics that suffer from limited context handling, weak factuality assessment, or reliance on proprietary services, VC-Inspector offers a reproducible, fact-aware alternative that aligns closely with human judgments. To enable robust training and interpretable evaluation, we introduce a systematic approach for generating captions with controllable errors, paired with graded quality scores and explanatory annotations. Experiments show that VC-Inspector achieves state-of-the-art correlation with human judgments, generalizing across diverse domains (e.g., VATEX-Eval, Flickr8K-Expert, and Flickr8K-CF benchmarks) and revealing the potential for caption improvement.