3D Gaussian Flats: Hybrid 2D/3D Photometric Scene Reconstruction

作者: Maria Taktasheva, Lily Goli, Alessandro Fiorini, Zhen Li, Daniel Rebain, Andrea Tagliasacchi

分类: cs.CV

发布日期: 2025-09-19 (更新: 2025-09-23)

💡 一句话要点

提出混合2D/3D高斯平面表示,提升纹理缺失场景的三维重建质量。

🎯 匹配领域: 支柱三:空间感知与语义 (Perception & Semantics)

关键词: 三维重建 高斯表示 平面约束 新视角合成 深度估计

📋 核心要点

- 现有方法在处理纹理缺失的平面时,光度重建效果差,导致重建质量下降。

- 提出混合2D/3D高斯表示,利用平面高斯建模平面区域,自由形式3D高斯建模其他区域。

- 实验表明,该方法在ScanNet++和ScanNetv2数据集上实现了最先进的深度估计,并能有效提取高质量网格。

📝 摘要(中文)

近年来,辐射场和新视角合成技术的发展使得从照片中创建逼真的数字孪生体成为可能。然而,由于光度重建目标的不适定性,现有方法在处理平面、无纹理表面时表现不佳,导致重建结果不均匀且半透明。表面重建方法虽然可以解决这个问题,但会牺牲视觉质量。本文提出了一种新颖的混合2D/3D表示方法,该方法联合优化约束平面(2D)高斯来建模平面表面,并使用自由形式(3D)高斯来建模场景的其余部分。我们的端到端方法动态地检测和细化平面区域,从而提高视觉保真度和几何精度。该方法在ScanNet++和ScanNetv2上实现了最先进的深度估计,并且擅长网格提取,而不会过度拟合特定的相机模型,展示了其在生成高质量室内场景重建方面的有效性。

🔬 方法详解

问题定义:现有基于辐射场的三维重建方法在处理缺乏纹理的平面区域时,由于光度重建目标的不适定性,容易产生伪影和半透明效果,导致重建质量下降。传统的表面重建方法虽然可以解决几何问题,但会牺牲视觉质量。

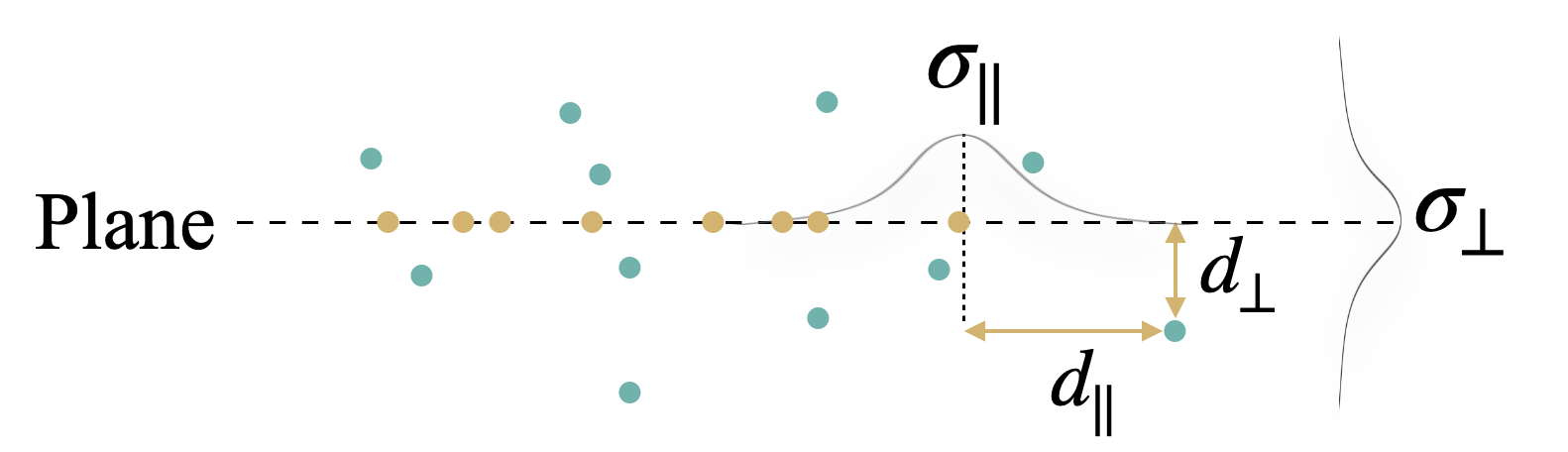

核心思路:论文的核心思路是将场景表示为平面高斯和自由形式3D高斯的混合体。对于检测到的平面区域,使用参数化的平面高斯进行建模,从而约束其几何形状,避免伪影。对于场景的其余部分,则使用自由形式的3D高斯进行建模,以保持视觉质量。

技术框架:该方法是一个端到端的优化框架,包含以下主要模块:1) 平面区域检测:使用图像特征和几何信息动态检测场景中的平面区域。2) 混合高斯表示:将场景表示为平面高斯和自由形式3D高斯的混合体。3) 联合优化:联合优化平面高斯和自由形式3D高斯的参数,以最小化重建误差。

关键创新:该方法最重要的技术创新点在于提出了混合2D/3D高斯表示,将平面约束引入到基于高斯的三维重建中。与现有方法相比,该方法能够更好地处理纹理缺失的平面区域,从而提高重建质量。

关键设计:平面区域检测模块利用图像梯度和深度信息来识别潜在的平面区域。平面高斯的参数包括平面方程和高斯分布的协方差矩阵。损失函数包括光度损失、深度损失和平滑损失,用于约束重建结果的视觉质量和几何精度。动态调整平面区域的权重,以平衡平面约束和自由形式建模。

🖼️ 关键图片

📊 实验亮点

该方法在ScanNet++和ScanNetv2数据集上取得了state-of-the-art的深度估计结果,显著优于现有方法。此外,该方法在网格提取方面表现出色,能够生成高质量的网格模型,且不易过拟合到特定的相机模型。实验结果表明,该方法在视觉保真度和几何精度方面均有显著提升。

🎯 应用场景

该研究成果可应用于室内场景的三维重建、虚拟现实、增强现实、机器人导航等领域。通过提高对平面和无纹理区域的重建质量,可以为这些应用提供更准确、更逼真的三维模型,从而提升用户体验和系统性能。未来,该方法可以扩展到室外场景,并与其他传感器数据融合,以实现更鲁棒的三维重建。

📄 摘要(原文)

Recent advances in radiance fields and novel view synthesis enable creation of realistic digital twins from photographs. However, current methods struggle with flat, texture-less surfaces, creating uneven and semi-transparent reconstructions, due to an ill-conditioned photometric reconstruction objective. Surface reconstruction methods solve this issue but sacrifice visual quality. We propose a novel hybrid 2D/3D representation that jointly optimizes constrained planar (2D) Gaussians for modeling flat surfaces and freeform (3D) Gaussians for the rest of the scene. Our end-to-end approach dynamically detects and refines planar regions, improving both visual fidelity and geometric accuracy. It achieves state-of-the-art depth estimation on ScanNet++ and ScanNetv2, and excels at mesh extraction without overfitting to a specific camera model, showing its effectiveness in producing high-quality reconstruction of indoor scenes.