Synthetic-to-Real Object Detection using YOLOv11 and Domain Randomization Strategies

作者: Luisa Torquato Niño, Hamza A. A. Gardi

分类: cs.CV, cs.LG

发布日期: 2025-09-18

💡 一句话要点

利用YOLOv11和域随机化策略实现从合成数据到真实场景的目标检测

🎯 匹配领域: 支柱一:机器人控制 (Robot Control)

关键词: 目标检测 域随机化 合成数据 YOLOv11 数据增强 域迁移 计算机视觉

📋 核心要点

- 现有目标检测方法在合成数据训练后迁移到真实场景时,面临严重的域差异问题,导致性能显著下降。

- 本文提出一种基于YOLOv11和域随机化的方法,仅使用合成数据训练模型,并通过增加数据多样性来缩小域差距。

- 实验结果表明,通过增加合成数据的视角和背景复杂性,并结合数据增强,最终在真实数据集上取得了显著的检测性能提升。

📝 摘要(中文)

本文探讨了目标检测中从合成数据到真实数据的域迁移问题,重点在于仅使用合成数据和域随机化策略训练YOLOv11模型来检测特定物体(汤罐)。该方法通过大量的数据增强、数据集构成和模型缩放实验进行验证。虽然合成验证指标始终很高,但它们被证明无法准确预测真实世界的性能。因此,模型还通过预测的可视化检查进行定性评估,并通过手动标记的真实世界测试集进行定量评估,以指导开发。最终的mAP@50分数由官方Kaggle竞赛提供。关键发现表明,增加合成数据集的多样性,特别是包括不同的视角和复杂的背景,结合精心调整的数据增强,对于弥合领域差距至关重要。最佳配置,即在扩展且多样化的数据集上训练的YOLOv11l模型,在竞赛的隐藏测试集上实现了0.910的mAP@50。这一结果证明了纯合成训练方法的潜力,同时也突出了完全捕捉真实世界可变性方面仍然存在的挑战。

🔬 方法详解

问题定义:论文旨在解决目标检测中,使用合成数据训练的模型在真实场景下性能不佳的问题。现有方法难以有效弥合合成数据和真实数据之间的域差异,导致模型泛化能力不足,无法适应真实场景中的光照、遮挡、背景等复杂因素。

核心思路:论文的核心思路是通过域随机化策略,在合成数据生成过程中引入尽可能多的随机变化,例如随机的视角、光照、背景、纹理等,从而使模型在训练过程中接触到各种各样的场景,提高其对真实场景的适应能力。这样做的目的是让模型学习到对各种变化不敏感的特征,从而提高其泛化能力。

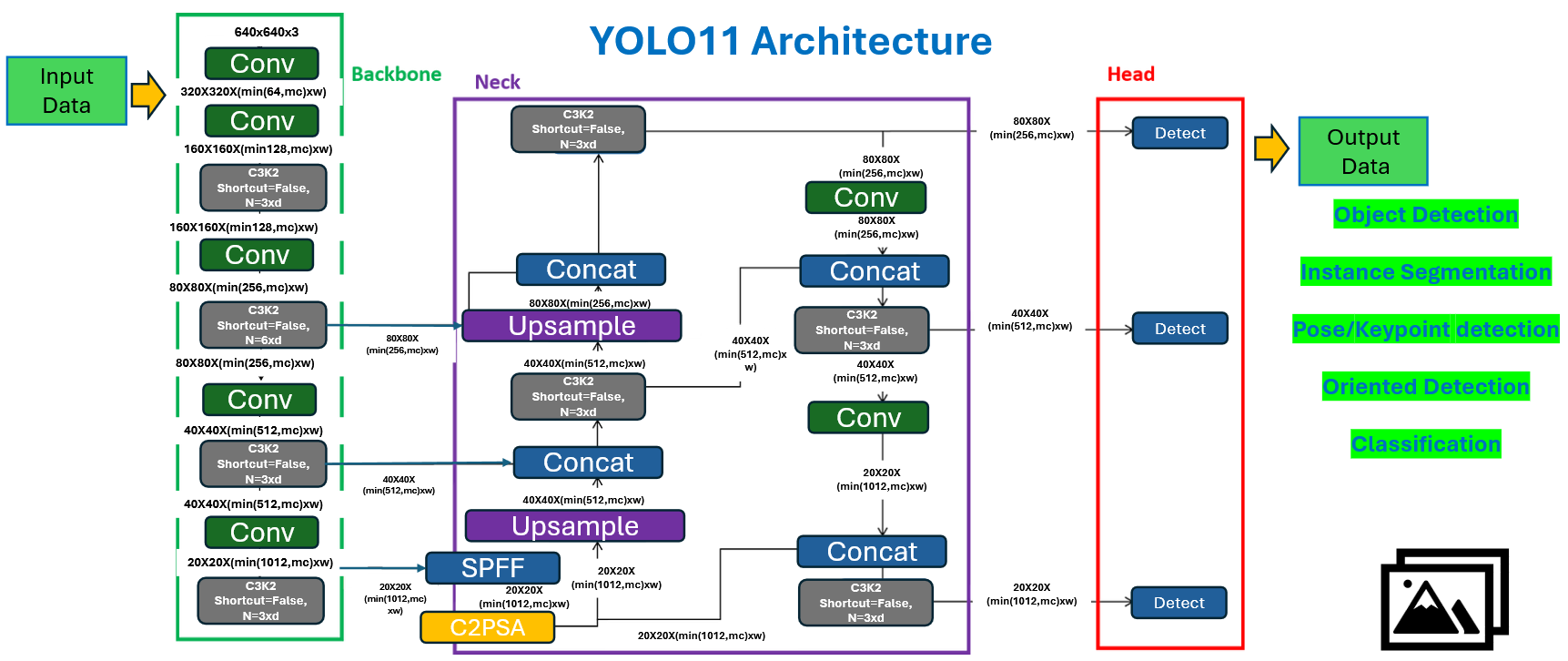

技术框架:整体流程包括以下几个主要步骤:1) 创建包含目标物体(汤罐)的3D模型;2) 使用3D模型生成大量的合成图像,并在生成过程中应用域随机化策略,例如随机改变视角、光照、背景等;3) 使用生成的合成数据集训练YOLOv11目标检测模型;4) 在真实的测试数据集上评估模型的性能。

关键创新:论文的关键创新在于强调了合成数据集多样性的重要性,并通过实验证明,增加合成数据的视角和背景复杂性,能够显著提高模型在真实场景下的检测性能。与以往侧重于特定数据增强方法或对抗训练的方法不同,本文更注重从数据生成的源头解决域差异问题。

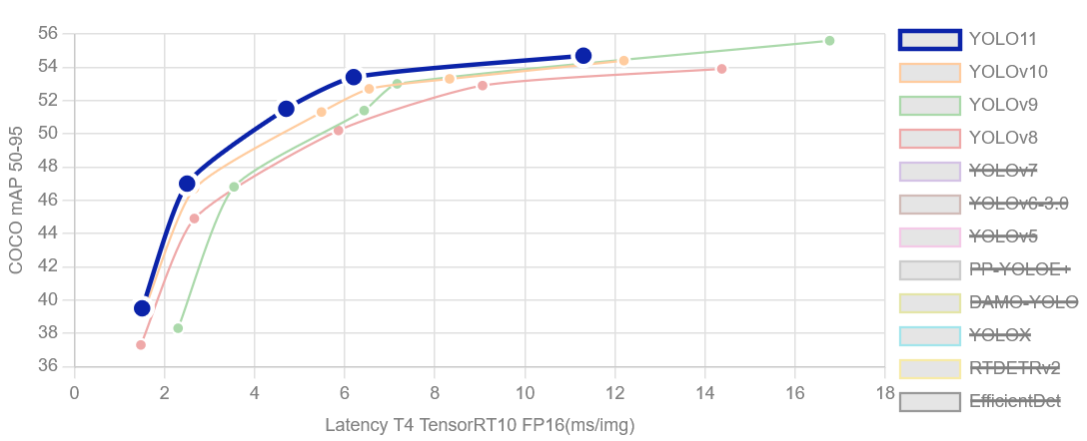

关键设计:论文使用了YOLOv11作为目标检测模型,并采用了YOLOv11l这种较大的模型规模。在数据增强方面,论文没有详细说明具体的数据增强方法,但强调了数据增强需要与数据集的多样性相结合,才能发挥更好的效果。损失函数方面,论文没有进行修改,仍然使用YOLOv11默认的损失函数。在训练过程中,论文通过监控验证集的性能来调整训练参数,例如学习率、batch size等。

🖼️ 关键图片

📊 实验亮点

实验结果表明,通过增加合成数据集的多样性,并结合数据增强,YOLOv11l模型在Kaggle竞赛的隐藏测试集上取得了0.910的mAP@50,证明了纯合成数据训练方法在目标检测领域的潜力。该结果表明,精心设计的合成数据可以有效弥合域差异,并为真实场景下的目标检测提供可靠的解决方案。

🎯 应用场景

该研究成果可应用于工业自动化、机器人导航、智能零售等领域。例如,在机器人分拣任务中,可以使用合成数据训练模型来识别不同种类的物体,从而降低数据采集和标注成本。此外,该方法还可以用于训练自动驾驶系统中的目标检测模块,提高其在复杂交通环境下的感知能力。

📄 摘要(原文)

This paper addresses the synthetic-to-real domain gap in object detection, focusing on training a YOLOv11 model to detect a specific object (a soup can) using only synthetic data and domain randomization strategies. The methodology involves extensive experimentation with data augmentation, dataset composition, and model scaling. While synthetic validation metrics were consistently high, they proved to be poor predictors of real-world performance. Consequently, models were also evaluated qualitatively, through visual inspection of predictions, and quantitatively, on a manually labeled real-world test set, to guide development. Final mAP@50 scores were provided by the official Kaggle competition. Key findings indicate that increasing synthetic dataset diversity, specifically by including varied perspectives and complex backgrounds, combined with carefully tuned data augmentation, were crucial in bridging the domain gap. The best performing configuration, a YOLOv11l model trained on an expanded and diverse dataset, achieved a final mAP@50 of 0.910 on the competition's hidden test set. This result demonstrates the potential of a synthetic-only training approach while also highlighting the remaining challenges in fully capturing real-world variability.