Beyond Frame-wise Tracking: A Trajectory-based Paradigm for Efficient Point Cloud Tracking

作者: BaiChen Fan, Sifan Zhou, Jian Li, Shibo Zhao, Muqing Cao, Qin Wang

分类: cs.CV, cs.AI, cs.RO

发布日期: 2025-09-14

备注: 9 pages, 7 figures

💡 一句话要点

提出基于轨迹的TrajTrack,提升LiDAR点云单目标跟踪效率与精度。

🎯 匹配领域: 支柱七:动作重定向 (Motion Retargeting) 支柱八:物理动画 (Physics-based Animation)

关键词: 3D单目标跟踪 LiDAR 轨迹预测 运动建模 自动驾驶

📋 核心要点

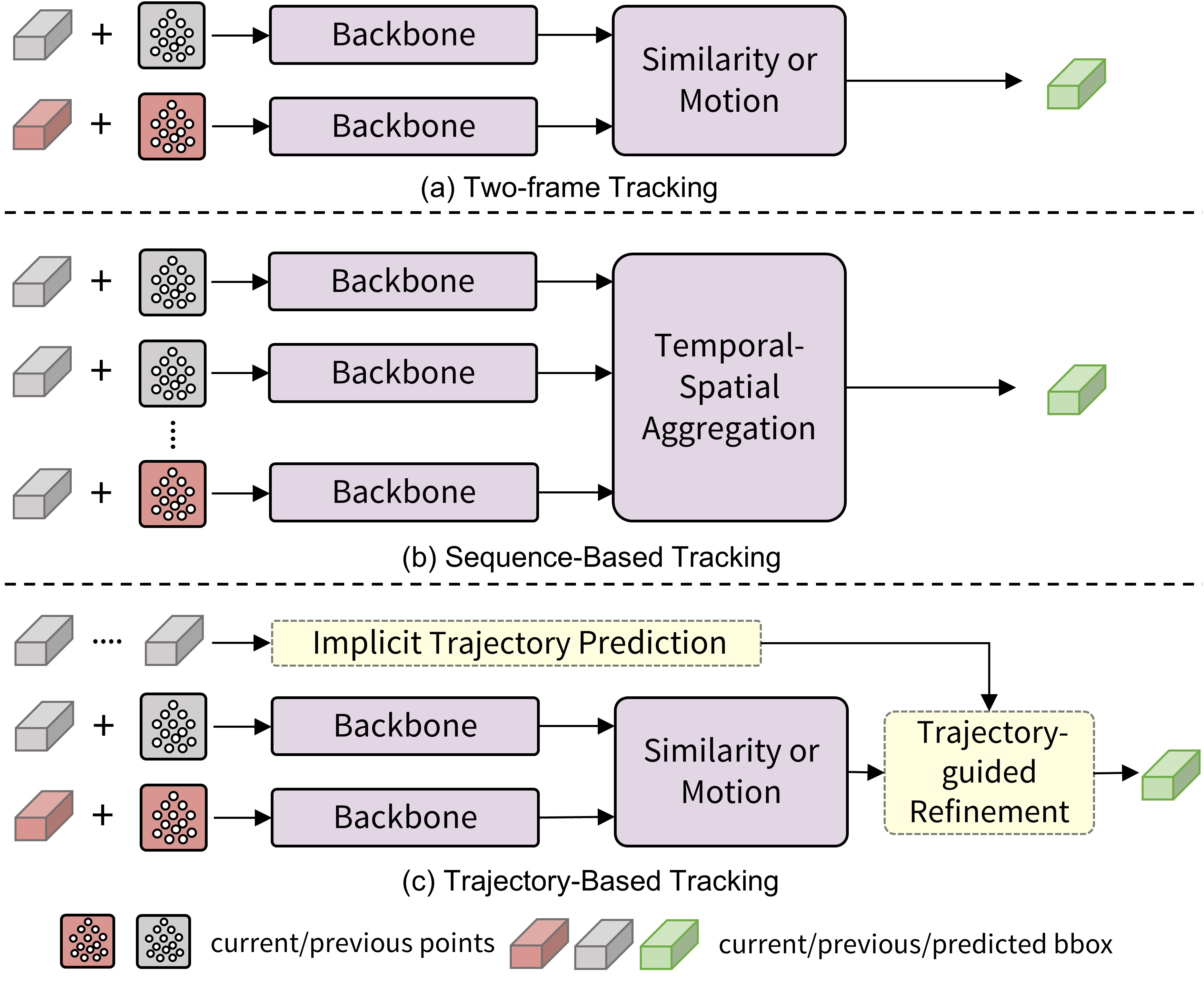

- 现有3D单目标跟踪方法在效率和鲁棒性之间存在trade-off,双帧方法效率高但易受遮挡影响,序列方法鲁棒但计算成本高。

- TrajTrack通过学习历史轨迹的运动连续性,隐式地建模目标运动,从而在不增加过多计算负担的情况下提升跟踪性能。

- TrajTrack在NuScenes数据集上取得了SOTA结果,相比于强基线,跟踪精度提升了4.48%,同时保持了56 FPS的运行速度。

📝 摘要(中文)

基于激光雷达的三维单目标跟踪(3D SOT)是机器人和自动驾驶系统中的关键任务。现有方法通常采用逐帧运动估计或基于序列的范式。然而,双帧方法虽然高效,但缺乏长期时间上下文,在稀疏或遮挡场景中容易失效;而处理多个点云的基于序列的方法虽然鲁棒性更强,但计算成本显著增加。为了解决这个难题,我们提出了一种新的基于轨迹的范式及其实现TrajTrack。TrajTrack是一个轻量级框架,通过仅从历史边界框轨迹中隐式地学习运动连续性来增强基础双帧跟踪器,而无需额外的、昂贵的点云输入。它首先生成一个快速、显式的运动提议,然后使用一个隐式运动建模模块来预测未来的轨迹,进而细化和校正初始提议。在大型NuScenes基准上的大量实验表明,TrajTrack实现了新的最先进的性能,在以56 FPS运行的同时,比强大的基线跟踪精度提高了4.48%。此外,我们还展示了TrajTrack在不同基础跟踪器上的强大泛化能力。

🔬 方法详解

问题定义:现有基于LiDAR的3D单目标跟踪方法,如双帧跟踪器,虽然计算效率高,但在遮挡或点云稀疏场景下性能较差,因为它们缺乏长期的时间上下文信息。而基于序列的跟踪器虽然考虑了多帧信息,但计算复杂度显著增加,难以满足实时性要求。因此,如何在效率和鲁棒性之间取得平衡是一个关键问题。

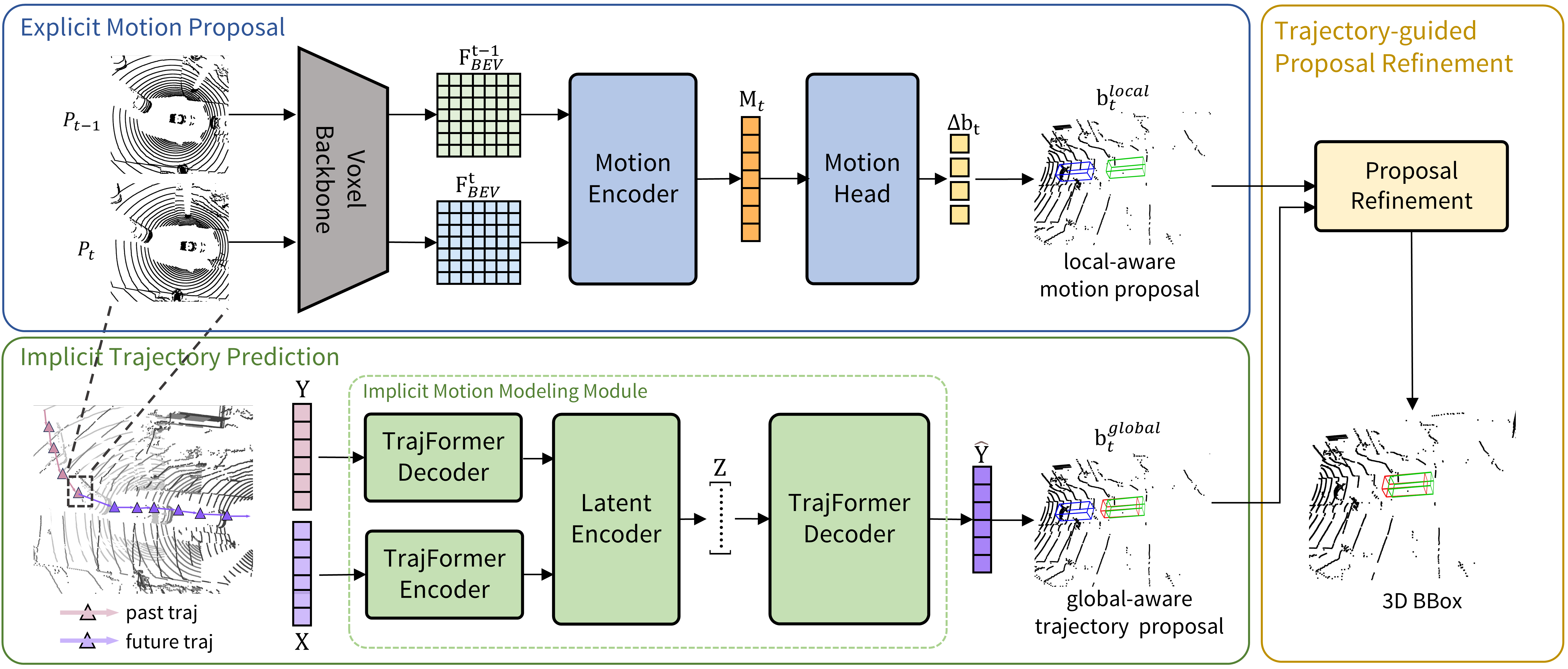

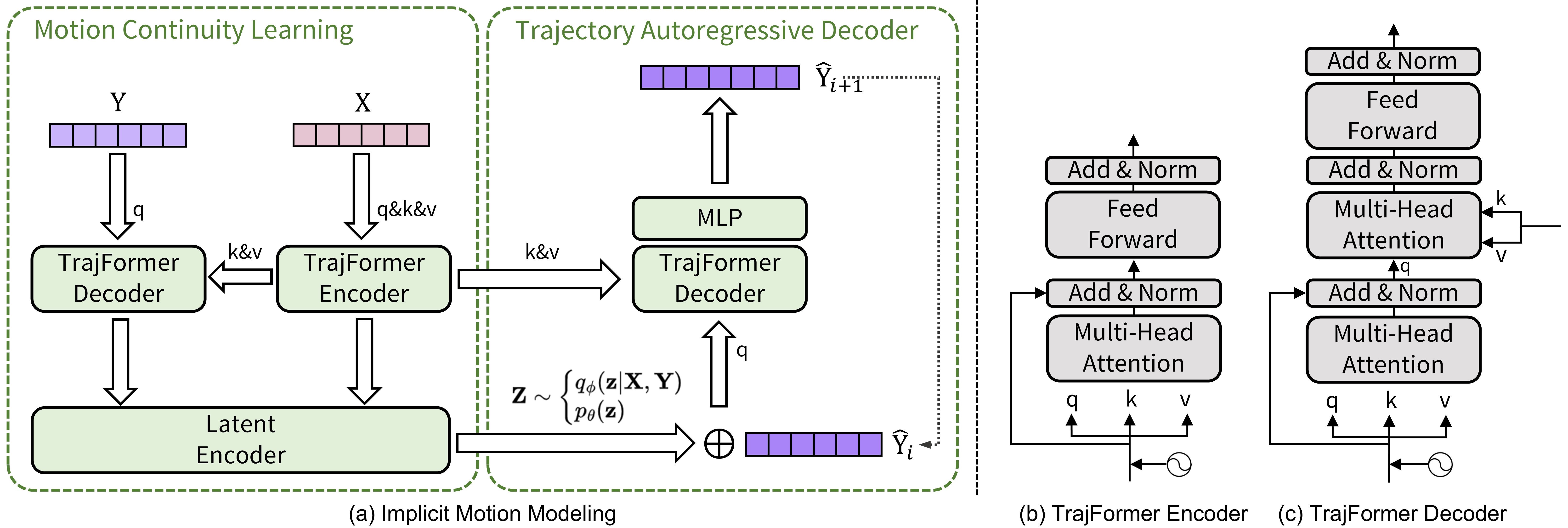

核心思路:TrajTrack的核心思路是利用目标的历史轨迹信息来预测其未来运动,从而增强跟踪器的鲁棒性。通过学习历史边界框轨迹的运动连续性,隐式地建模目标的运动模式,而无需直接处理额外的点云数据,从而在不显著增加计算负担的情况下提升跟踪性能。

技术框架:TrajTrack框架主要包含以下几个模块:1) 运动提议生成模块:基于当前帧的信息,快速生成一个初始的运动提议。2) 隐式运动建模模块:利用历史边界框轨迹,学习目标的运动模式,并预测未来的轨迹。3) 轨迹细化模块:利用预测的轨迹信息,对初始的运动提议进行细化和校正,得到最终的跟踪结果。整个框架以双帧跟踪器为基础,通过轨迹信息增强其性能。

关键创新:TrajTrack的关键创新在于提出了基于轨迹的跟踪范式,将历史轨迹信息融入到跟踪过程中,从而在不增加过多计算负担的情况下提升跟踪性能。与传统的双帧跟踪器相比,TrajTrack考虑了长期的时间上下文信息;与基于序列的跟踪器相比,TrajTrack避免了直接处理多帧点云数据,从而降低了计算复杂度。

关键设计:TrajTrack的关键设计包括:1) 轨迹表示:如何有效地表示历史轨迹信息,以便于运动建模。2) 隐式运动建模模块:如何设计该模块,使其能够有效地学习目标的运动模式。3) 轨迹细化模块:如何利用预测的轨迹信息,对初始的运动提议进行细化和校正。论文中可能使用了循环神经网络(RNN)或Transformer等序列模型来建模轨迹,并设计了相应的损失函数来训练模型。

🖼️ 关键图片

📊 实验亮点

TrajTrack在NuScenes数据集上取得了显著的性能提升。实验结果表明,TrajTrack在以56 FPS运行的同时,比强大的基线跟踪精度提高了4.48%,达到了新的SOTA水平。此外,TrajTrack还展示了其在不同基础跟踪器上的强大泛化能力,表明其具有良好的通用性和可扩展性。

🎯 应用场景

TrajTrack在自动驾驶、机器人导航、智能监控等领域具有广泛的应用前景。它可以提高这些系统在复杂环境下的目标跟踪精度和鲁棒性,例如在城市交通场景中跟踪车辆和行人,在仓库环境中跟踪机器人和货物,在安防监控场景中跟踪可疑人员。该研究有助于提升这些系统的智能化水平和安全性。

📄 摘要(原文)

LiDAR-based 3D single object tracking (3D SOT) is a critical task in robotics and autonomous systems. Existing methods typically follow frame-wise motion estimation or a sequence-based paradigm. However, the two-frame methods are efficient but lack long-term temporal context, making them vulnerable in sparse or occluded scenes, while sequence-based methods that process multiple point clouds gain robustness at a significant computational cost. To resolve this dilemma, we propose a novel trajectory-based paradigm and its instantiation, TrajTrack. TrajTrack is a lightweight framework that enhances a base two-frame tracker by implicitly learning motion continuity from historical bounding box trajectories alone-without requiring additional, costly point cloud inputs. It first generates a fast, explicit motion proposal and then uses an implicit motion modeling module to predict the future trajectory, which in turn refines and corrects the initial proposal. Extensive experiments on the large-scale NuScenes benchmark show that TrajTrack achieves new state-of-the-art performance, dramatically improving tracking precision by 4.48% over a strong baseline while running at 56 FPS. Besides, we also demonstrate the strong generalizability of TrajTrack across different base trackers. Video is available at https://www.bilibili.com/video/BV1ahYgzmEWP.