MIS-LSTM: Multichannel Image-Sequence LSTM for Sleep Quality and Stress Prediction

作者: Seongwan Park, Jieun Woo, Siheon Yang

分类: cs.CV, cs.AI

发布日期: 2025-09-14

备注: ICTC 2025

💡 一句话要点

提出MIS-LSTM模型,融合CNN与LSTM,用于睡眠质量和压力预测。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 多模态融合 时间序列预测 睡眠质量预测 压力预测 LSTM 卷积神经网络 注意力机制

📋 核心要点

- 现有方法难以有效融合多模态生活日志数据,并捕捉长期时序依赖关系,从而影响睡眠质量和压力预测的准确性。

- MIS-LSTM通过CNN编码多通道图像序列和离散事件,利用卷积块注意力融合模态信息,并使用LSTM建模长期时序依赖。

- 实验结果表明,MIS-LSTM在ETRI Lifelog Challenge数据集上优于LSTM、1D-CNN和CNN基线,并通过UALRE集成进一步提升性能。

📝 摘要(中文)

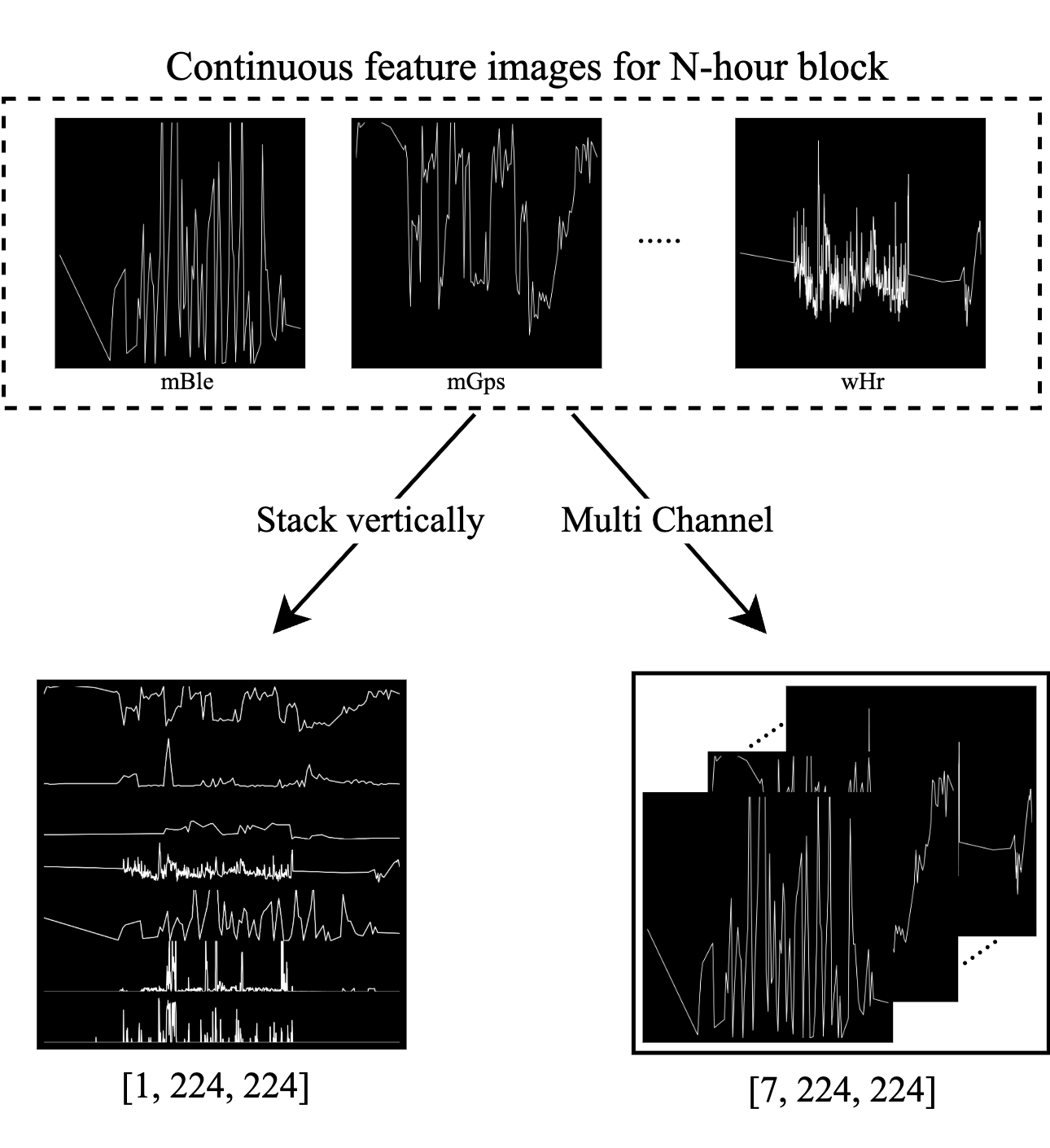

本文提出了一种混合框架MIS-LSTM,它将CNN编码器与LSTM序列模型相结合,用于从多模态生活日志数据中预测每日的睡眠质量和压力水平。首先,连续的传感器数据流被分割成N小时的块,并渲染成多通道图像,而稀疏的离散事件则使用专门的1D-CNN进行编码。卷积块注意力模块将这两种模态融合为精细的块嵌入,然后LSTM聚合这些嵌入以捕获长期的时序依赖关系。为了进一步提高鲁棒性,我们引入了UALRE,一种不确定性感知集成方法,它用高置信度的个体预测来覆盖低置信度的多数投票结果。在2025 ETRI Lifelog Challenge数据集上的实验表明,我们的基础MIS-LSTM实现了0.615的Macro-F1值;通过UALRE集成,该分数提高到0.647,优于强大的LSTM、1D-CNN和CNN基线。消融实验证实了(i)多通道成像优于堆叠垂直成像,(ii)4小时块粒度的优势,以及(iii)模态特定离散编码的有效性。

🔬 方法详解

问题定义:论文旨在解决利用多模态生活日志数据准确预测个人睡眠质量和压力水平的问题。现有方法在处理多模态数据融合和捕捉长期时序依赖关系方面存在不足,导致预测精度受限。特别是,如何有效利用连续传感器数据和离散事件数据,并将其融合以进行准确预测是一个挑战。

核心思路:论文的核心思路是将多模态生活日志数据转换为图像序列和离散事件编码,然后利用CNN提取特征,并使用LSTM建模长期时序依赖关系。通过这种方式,模型可以同时处理连续和离散数据,并捕捉它们之间的复杂关系。此外,引入卷积块注意力机制来融合不同模态的信息,并使用不确定性感知集成方法来提高模型的鲁棒性。

技术框架:MIS-LSTM框架包含以下主要模块:1) 数据预处理:将连续传感器数据分割成N小时的块,并渲染成多通道图像;使用1D-CNN对稀疏离散事件进行编码。2) 特征提取:使用CNN提取多通道图像的特征,并使用1D-CNN提取离散事件的特征。3) 模态融合:使用卷积块注意力模块将图像特征和离散事件特征融合为块嵌入。4) 时序建模:使用LSTM聚合块嵌入,以捕获长期的时序依赖关系。5) 预测:使用LSTM的输出进行睡眠质量和压力预测。6) UALRE集成:使用不确定性感知集成方法,结合多个模型的预测结果,提高鲁棒性。

关键创新:论文的关键创新点在于:1) 提出了一种多通道图像序列表示方法,用于编码连续传感器数据。2) 引入了卷积块注意力模块,用于融合多模态信息。3) 提出了一种不确定性感知集成方法,用于提高模型的鲁棒性。4) 针对离散事件数据,设计了专门的1D-CNN编码器。

关键设计:关键设计细节包括:1) 使用4小时的块粒度进行数据分割。2) 使用卷积块注意力模块来动态调整不同模态的权重。3) 使用交叉熵损失函数进行训练。4) UALRE集成的具体实现方式,包括如何计算不确定性以及如何根据不确定性进行预测融合。网络结构方面,CNN和LSTM的具体层数、滤波器大小、隐藏单元数等参数需要根据具体数据集进行调整。

🖼️ 关键图片

📊 实验亮点

MIS-LSTM在2025 ETRI Lifelog Challenge数据集上取得了显著的性能提升。基础MIS-LSTM模型实现了0.615的Macro-F1值,优于LSTM、1D-CNN和CNN基线。通过引入UALRE集成方法,Macro-F1值进一步提高到0.647,表明该方法具有良好的鲁棒性和泛化能力。消融实验验证了多通道成像、4小时块粒度和模态特定离散编码的有效性。

🎯 应用场景

该研究成果可应用于智能健康监测、个性化健康管理等领域。通过分析用户的多模态生活日志数据,可以预测其睡眠质量和压力水平,从而为用户提供个性化的健康建议和干预措施。此外,该方法还可以扩展到其他健康相关问题的预测,例如情绪识别、疾病风险评估等,具有广阔的应用前景。

📄 摘要(原文)

This paper presents MIS-LSTM, a hybrid framework that joins CNN encoders with an LSTM sequence model for sleep quality and stress prediction at the day level from multimodal lifelog data. Continuous sensor streams are first partitioned into N-hour blocks and rendered as multi-channel images, while sparse discrete events are encoded with a dedicated 1D-CNN. A Convolutional Block Attention Module fuses the two modalities into refined block embeddings, which an LSTM then aggregates to capture long-range temporal dependencies. To further boost robustness, we introduce UALRE, an uncertainty-aware ensemble that overrides lowconfidence majority votes with high-confidence individual predictions. Experiments on the 2025 ETRI Lifelog Challenge dataset show that Our base MISLSTM achieves Macro-F1 0.615; with the UALRE ensemble, the score improves to 0.647, outperforming strong LSTM, 1D-CNN, and CNN baselines. Ablations confirm (i) the superiority of multi-channel over stacked-vertical imaging, (ii) the benefit of a 4-hour block granularity, and (iii) the efficacy of modality-specific discrete encoding.