OpenUrban3D: Annotation-Free Open-Vocabulary Semantic Segmentation of Large-Scale Urban Point Clouds

作者: Chongyu Wang, Kunlei Jing, Jihua Zhu, Di Wang

分类: cs.CV

发布日期: 2025-09-13

💡 一句话要点

OpenUrban3D:无需标注的大规模城市点云开放词汇语义分割

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture) 支柱三:空间感知与语义 (Perception & Semantics)

关键词: 开放词汇语义分割 大规模点云 城市场景理解 多视角渲染 视觉-语言模型

📋 核心要点

- 现有方法在大规模城市点云的开放词汇语义分割中,面临缺乏高质量多视角图像和跨场景泛化能力差的挑战。

- OpenUrban3D通过多视角多粒度渲染、视觉-语言特征提取和样本平衡融合,直接从原始点云生成鲁棒的语义特征。

- 实验表明,OpenUrban3D在分割精度和跨场景泛化方面显著优于现有方法,为3D城市场景理解提供了一种灵活的解决方案。

📝 摘要(中文)

开放词汇语义分割使模型能够识别和分割来自任意自然语言描述的对象,从而能够灵活地处理超出固定标签集的新颖、细粒度或功能定义的类别。这种能力对于支持数字孪生、智慧城市管理和城市分析等应用的大规模城市点云至关重要,但该领域的研究仍然不足。主要障碍在于大规模城市点云数据集中经常缺乏高质量、良好对齐的多视角图像,以及现有三维(3D)分割管道在具有几何、尺度和外观显着差异的各种城市环境中的泛化能力较差。为了应对这些挑战,我们提出了OpenUrban3D,这是第一个用于大规模城市场景的3D开放词汇语义分割框架,它无需对齐的多视角图像、预训练的点云分割网络或手动注释。我们的方法通过多视角、多粒度渲染、掩码级视觉-语言特征提取和样本平衡融合,直接从原始点云生成鲁棒的语义特征,然后将其提炼到3D骨干模型中。这种设计能够对任意文本查询进行零样本分割,同时捕获语义丰富性和几何先验。在包括SensatUrban和SUM在内的大规模城市基准上的大量实验表明,OpenUrban3D在分割精度和跨场景泛化方面都优于现有方法,证明了其作为3D城市场景理解的灵活且可扩展的解决方案的潜力。

🔬 方法详解

问题定义:论文旨在解决大规模城市点云的开放词汇语义分割问题。现有方法依赖于高质量的多视角图像或预训练的点云分割网络,并且在不同城市环境下的泛化能力较差,难以适应真实场景的复杂性和多样性。缺乏人工标注也是一个关键痛点。

核心思路:论文的核心思路是通过多视角渲染和视觉-语言模型的结合,从原始点云中提取丰富的语义信息,并利用蒸馏学习将这些信息传递到3D骨干网络中。这种方法无需人工标注和预训练模型,并且能够有效利用几何先验和语义知识。

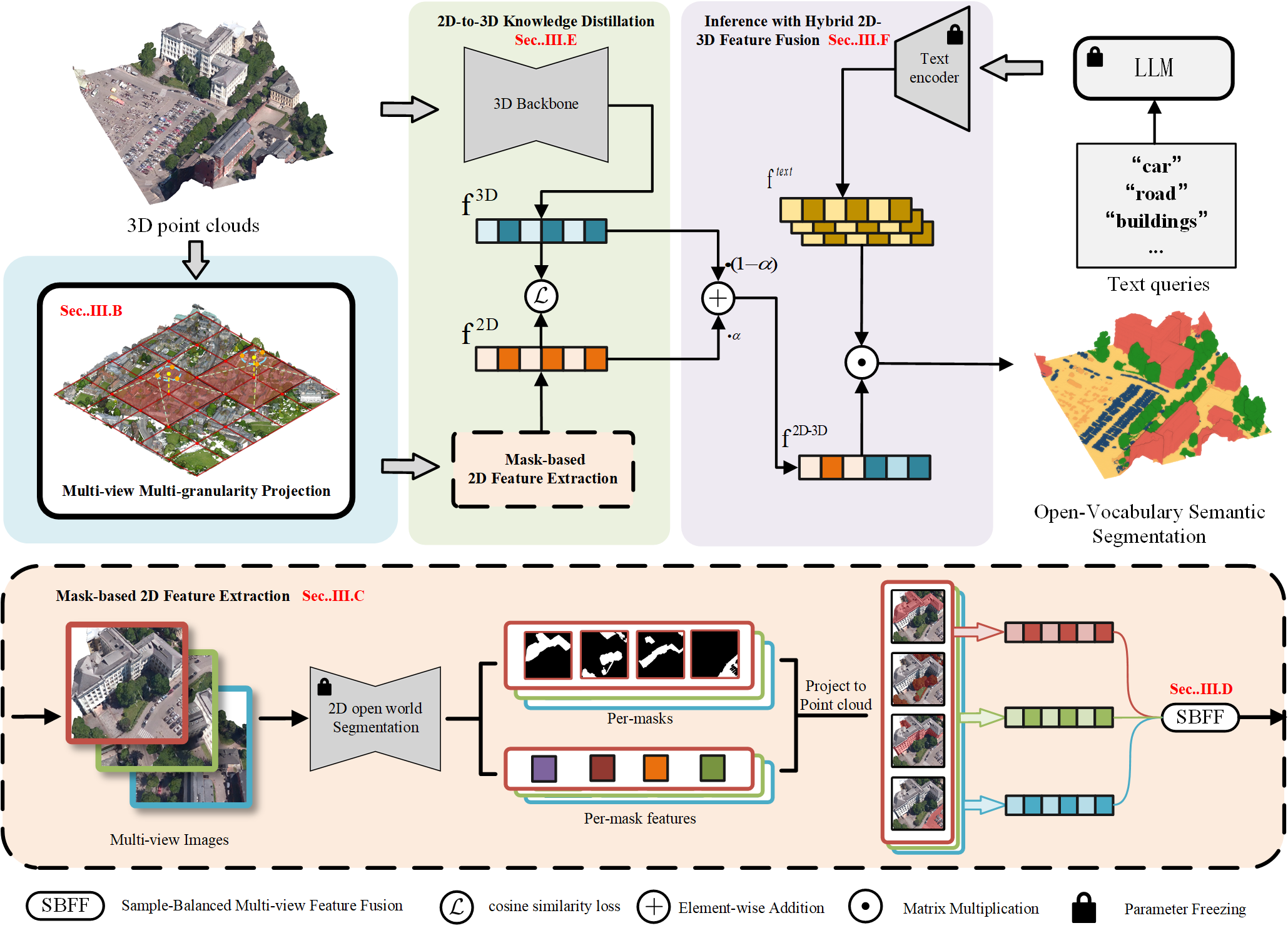

技术框架:OpenUrban3D框架主要包含以下几个阶段:1) 多视角、多粒度渲染:从不同视角渲染点云,生成多张图像;2) 掩码级视觉-语言特征提取:利用视觉-语言模型(如CLIP)提取渲染图像的语义特征,并与文本查询进行匹配;3) 样本平衡融合:对不同视角的特征进行融合,并进行样本平衡,以提高分割精度;4) 蒸馏学习:将提取的语义特征蒸馏到3D骨干网络中,使其具备开放词汇语义分割能力。

关键创新:该论文的关键创新在于提出了一种无需人工标注和预训练模型的开放词汇语义分割框架。通过多视角渲染和视觉-语言模型的结合,实现了对大规模城市点云的零样本分割。与现有方法相比,该方法具有更强的泛化能力和更高的效率。

关键设计:在多视角渲染中,采用了不同的视角和分辨率,以捕捉点云的不同几何细节。在视觉-语言特征提取中,使用了CLIP模型,并针对掩码级别的特征进行了优化。在样本平衡融合中,采用了加权融合策略,以平衡不同视角的贡献。在蒸馏学习中,使用了KL散度损失函数,以保证语义特征的有效传递。

🖼️ 关键图片

📊 实验亮点

OpenUrban3D在SensatUrban和SUM等大规模城市基准数据集上进行了广泛的实验,结果表明,该方法在分割精度和跨场景泛化能力方面均优于现有方法。具体而言,在零样本分割任务中,OpenUrban3D的平均IoU比现有方法提高了显著的百分比,证明了其有效性和优越性。

🎯 应用场景

OpenUrban3D在智慧城市建设、数字孪生、城市规划和自动驾驶等领域具有广泛的应用前景。它可以用于自动识别和分割城市中的各种物体,例如建筑物、道路、树木等,从而为城市管理和决策提供支持。此外,该方法还可以用于生成高精度的城市三维地图,为自动驾驶车辆提供环境感知能力。

📄 摘要(原文)

Open-vocabulary semantic segmentation enables models to recognize and segment objects from arbitrary natural language descriptions, offering the flexibility to handle novel, fine-grained, or functionally defined categories beyond fixed label sets. While this capability is crucial for large-scale urban point clouds that support applications such as digital twins, smart city management, and urban analytics, it remains largely unexplored in this domain. The main obstacles are the frequent absence of high-quality, well-aligned multi-view imagery in large-scale urban point cloud datasets and the poor generalization of existing three-dimensional (3D) segmentation pipelines across diverse urban environments with substantial variation in geometry, scale, and appearance. To address these challenges, we present OpenUrban3D, the first 3D open-vocabulary semantic segmentation framework for large-scale urban scenes that operates without aligned multi-view images, pre-trained point cloud segmentation networks, or manual annotations. Our approach generates robust semantic features directly from raw point clouds through multi-view, multi-granularity rendering, mask-level vision-language feature extraction, and sample-balanced fusion, followed by distillation into a 3D backbone model. This design enables zero-shot segmentation for arbitrary text queries while capturing both semantic richness and geometric priors. Extensive experiments on large-scale urban benchmarks, including SensatUrban and SUM, show that OpenUrban3D achieves significant improvements in both segmentation accuracy and cross-scene generalization over existing methods, demonstrating its potential as a flexible and scalable solution for 3D urban scene understanding.