InternScenes: A Large-scale Simulatable Indoor Scene Dataset with Realistic Layouts

作者: Weipeng Zhong, Peizhou Cao, Yichen Jin, Li Luo, Wenzhe Cai, Jingli Lin, Hanqing Wang, Zhaoyang Lyu, Tai Wang, Bo Dai, Xudong Xu, Jiangmiao Pang

分类: cs.CV, cs.RO

发布日期: 2025-09-13 (更新: 2025-10-14)

💡 一句话要点

InternScenes:一个具有真实布局的大规模可模拟室内场景数据集

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 室内场景数据集 具身智能 3D场景 场景生成 机器人导航

📋 核心要点

- 现有3D场景数据集在数据规模、多样性、布局真实性以及避免物体碰撞等方面存在局限性,难以满足具身智能研究的需求。

- InternScenes通过整合真实扫描、程序生成和人工设计三种场景,并保留大量小物件,构建了大规模、多样化且真实的室内场景数据集。

- 实验表明,InternScenes为场景布局生成和点目标导航带来了新的挑战,并为相关任务的模型训练提供了数据基础。

📝 摘要(中文)

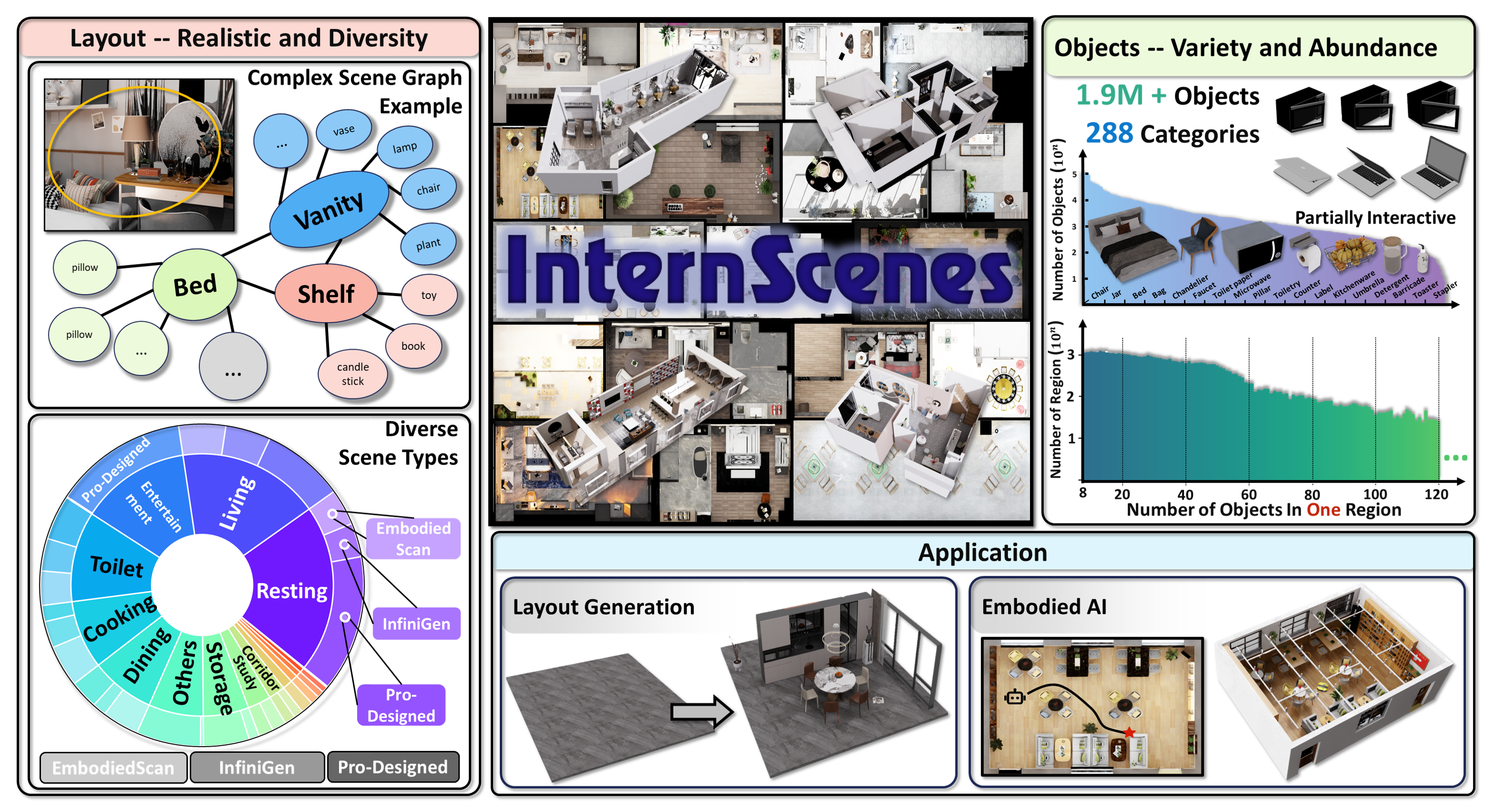

本文提出了InternScenes,一个新型的大规模可模拟室内场景数据集,包含约40,000个多样化的场景。该数据集整合了三种不同的场景来源:真实世界扫描、程序生成场景和设计师创建的场景,包括196万个3D对象,覆盖15种常见的场景类型和288个对象类别。特别地,该数据集保留了场景中大量的小物件,从而形成了具有真实感和复杂性的布局,平均每个区域包含41.5个对象。通过全面的数据处理流程,为真实世界扫描创建了真实到模拟的副本,通过将交互对象整合到这些场景中来增强交互性,并通过物理模拟来解决对象碰撞,从而确保了可模拟性。通过场景布局生成和点目标导航两个基准应用,验证了InternScenes的价值,并展示了复杂和真实的布局带来的新挑战。更重要的是,InternScenes为扩展模型训练提供了可能,使得在这种复杂场景中的生成和导航成为可能。该数据集、模型和基准测试将开源,以惠及整个社区。

🔬 方法详解

问题定义:现有具身智能研究严重依赖大规模可模拟的3D场景数据集,但现有数据集通常在数据规模、场景多样性、布局真实性(缺少小物件)以及物体碰撞等方面存在不足,限制了相关研究的进展。

核心思路:InternScenes的核心思路是整合多种来源的场景数据(真实扫描、程序生成、人工设计),并着重保留场景中的小物件,以构建一个大规模、多样化、布局真实的室内场景数据集。通过数据处理流程,确保场景的可模拟性、交互性,并解决物体碰撞问题。

技术框架:InternScenes的数据集构建流程主要包括以下几个阶段:1) 数据收集:整合真实世界扫描、程序生成场景和设计师创建的场景;2) 数据处理:为真实世界扫描创建真实到模拟的副本,将交互对象整合到场景中,并通过物理模拟解决对象碰撞问题;3) 数据集发布:开源数据集、模型和基准测试。

关键创新:InternScenes的关键创新在于:1) 整合了多种来源的场景数据,提高了数据集的多样性;2) 着重保留了场景中的小物件,提高了布局的真实性;3) 通过物理模拟解决了物体碰撞问题,保证了场景的可模拟性。

关键设计:InternScenes在数据处理过程中,使用了物理模拟引擎来解决物体碰撞问题。具体来说,首先检测场景中的物体碰撞,然后通过物理模拟引擎调整物体的位置,直到碰撞消除。此外,为了提高场景的交互性,还在场景中添加了可交互的对象,例如可打开的抽屉和可移动的物体。

🖼️ 关键图片

📊 实验亮点

通过在InternScenes上进行场景布局生成和点目标导航实验,验证了数据集的价值。实验结果表明,InternScenes的复杂和真实布局为现有算法带来了新的挑战。同时,该数据集也为扩展模型训练提供了可能,使得在这种复杂场景中的生成和导航成为可能。

🎯 应用场景

InternScenes数据集可广泛应用于具身智能领域,例如机器人导航、场景理解、物体操作等。该数据集的真实布局和大规模数据量,有助于训练更鲁棒、更智能的机器人模型。未来,InternScenes有望推动具身智能技术在家庭服务、医疗保健、工业自动化等领域的应用。

📄 摘要(原文)

The advancement of Embodied AI heavily relies on large-scale, simulatable 3D scene datasets characterized by scene diversity and realistic layouts. However, existing datasets typically suffer from limitations in data scale or diversity, sanitized layouts lacking small items, and severe object collisions. To address these shortcomings, we introduce \textbf{InternScenes}, a novel large-scale simulatable indoor scene dataset comprising approximately 40,000 diverse scenes by integrating three disparate scene sources, real-world scans, procedurally generated scenes, and designer-created scenes, including 1.96M 3D objects and covering 15 common scene types and 288 object classes. We particularly preserve massive small items in the scenes, resulting in realistic and complex layouts with an average of 41.5 objects per region. Our comprehensive data processing pipeline ensures simulatability by creating real-to-sim replicas for real-world scans, enhances interactivity by incorporating interactive objects into these scenes, and resolves object collisions by physical simulations. We demonstrate the value of InternScenes with two benchmark applications: scene layout generation and point-goal navigation. Both show the new challenges posed by the complex and realistic layouts. More importantly, InternScenes paves the way for scaling up the model training for both tasks, making the generation and navigation in such complex scenes possible. We commit to open-sourcing the data, models, and benchmarks to benefit the whole community.