SCOPE: Speech-guided COllaborative PErception Framework for Surgical Scene Segmentation

作者: Jecia Z. Y. Mao, Francis X Creighton, Russell H Taylor, Manish Sahu

分类: cs.CV

发布日期: 2025-09-12

💡 一句话要点

SCOPE框架:语音引导的协同感知手术场景分割

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 手术场景分割 语音引导 协同感知 大型语言模型 视觉基础模型 人机协作 术中辅助

📋 核心要点

- 现有手术场景分割方法依赖领域特定数据和标注,难以泛化到新场景和类别。

- SCOPE框架结合LLM推理能力和VFM感知能力,通过语音引导实现手术器械的即时分割和标注。

- 在Cataract1k和颅底数据集上的实验以及模拟实验验证了SCOPE框架在动态手术场景中的潜力。

📝 摘要(中文)

精确分割和跟踪手术场景中的相关元素对于实现上下文感知的术中辅助和决策至关重要。目前的解决方案依赖于特定领域的监督模型,这些模型依赖于标记数据,并且需要特定领域的数据来适应新的手术场景和超出预定义标签类别。提示驱动的视觉基础模型(VFM)的最新进展实现了跨异构医学图像的开放集、零样本分割。然而,这些模型对人工视觉或文本提示的依赖限制了它们在术中手术环境中的部署。我们引入了一种语音引导的协同感知(SCOPE)框架,该框架集成了大型语言模型(LLM)的推理能力和开放集VFM的感知能力,以支持术中视频流中手术器械和解剖结构的即时分割、标记和跟踪。该框架的一个关键组件是协同感知代理,它生成VFM生成的分割的顶级候选对象,并结合来自临床医生的直观语音反馈,以引导手术器械的分割,从而实现自然的人机协作模式。之后,器械本身充当交互式指针,以标记手术场景的其他元素。我们在公开的Cataract1k数据集的子集和内部的离体颅底数据集上评估了我们提出的框架,以证明其生成手术场景的即时分割和跟踪的潜力。此外,我们通过现场模拟离体实验展示了其动态能力。这种人机协作模式展示了开发适应性强、免手动、以外科医生为中心的动态手术室环境工具的潜力。

🔬 方法详解

问题定义:现有手术场景分割方法依赖于大量标注数据和领域知识,难以适应新的手术场景和未知的物体类别。此外,依赖人工视觉或文本提示的方式限制了其在术中环境中的应用,无法实现免手动操作。

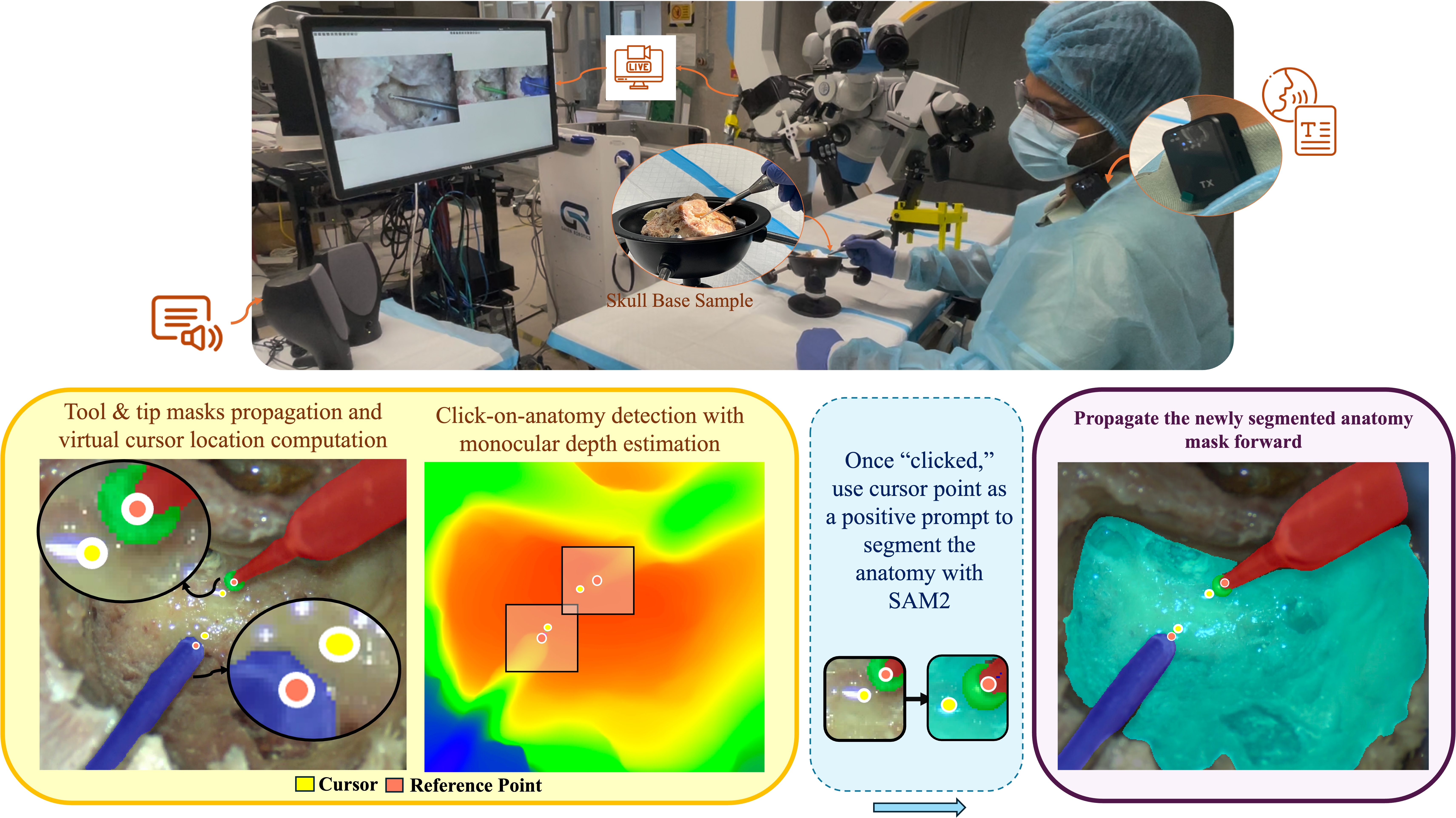

核心思路:利用大型语言模型(LLM)的推理能力和视觉基础模型(VFM)的开放集分割能力,构建一个语音引导的协同感知框架。通过语音指令,引导VFM进行分割,并利用分割结果进一步标注场景中的其他元素,实现人机协同的即时分割和标注。

技术框架:SCOPE框架包含以下主要模块:1) 语音输入模块:接收临床医生的语音指令。2) LLM推理模块:解析语音指令,生成VFM的分割提示。3) VFM分割模块:根据LLM生成的提示,对视频帧进行分割,生成候选分割结果。4) 协同感知代理:根据语音反馈和VFM分割结果,选择最佳分割结果,并利用分割结果作为指针,标注场景中的其他元素。5) 跟踪模块:对分割和标注结果进行跟踪,实现视频流中的持续感知。

关键创新:1) 提出了一种语音引导的协同感知框架,将LLM的推理能力和VFM的感知能力相结合,实现了手术场景的即时分割和标注。2) 设计了一个协同感知代理,通过语音反馈和VFM分割结果,实现人机协同的分割和标注。3) 利用分割结果作为指针,进一步标注场景中的其他元素,提高了标注效率。

关键设计:1) 使用预训练的LLM进行语音指令解析和提示生成。2) 使用开放集VFM进行分割,无需针对特定手术场景进行训练。3) 协同感知代理使用强化学习或监督学习方法,根据语音反馈和VFM分割结果,选择最佳分割结果。4) 跟踪模块使用卡尔曼滤波或深度学习方法,对分割和标注结果进行跟踪。

🖼️ 关键图片

📊 实验亮点

论文在Cataract1k数据集和内部颅底数据集上进行了评估,展示了SCOPE框架生成即时分割和跟踪的潜力。此外,通过模拟离体实验,验证了框架的动态能力和人机协作的有效性。虽然论文中没有给出具体的性能指标和对比基线,但实验结果表明,SCOPE框架能够根据语音指令,对手术场景进行有效的分割和标注。

🎯 应用场景

该研究成果可应用于开发免手动、以外科医生为中心的术中辅助工具,例如:术中导航、手术机器人控制、手术流程分析等。通过语音引导,医生可以方便地对手术场景进行分割和标注,从而提高手术效率和安全性。未来,该技术有望推广到其他医疗领域,例如:远程医疗、医学影像分析等。

📄 摘要(原文)

Accurate segmentation and tracking of relevant elements of the surgical scene is crucial to enable context-aware intraoperative assistance and decision making. Current solutions remain tethered to domain-specific, supervised models that rely on labeled data and required domain-specific data to adapt to new surgical scenarios and beyond predefined label categories. Recent advances in prompt-driven vision foundation models (VFM) have enabled open-set, zero-shot segmentation across heterogeneous medical images. However, dependence of these models on manual visual or textual cues restricts their deployment in introperative surgical settings. We introduce a speech-guided collaborative perception (SCOPE) framework that integrates reasoning capabilities of large language model (LLM) with perception capabilities of open-set VFMs to support on-the-fly segmentation, labeling and tracking of surgical instruments and anatomy in intraoperative video streams. A key component of this framework is a collaborative perception agent, which generates top candidates of VFM-generated segmentation and incorporates intuitive speech feedback from clinicians to guide the segmentation of surgical instruments in a natural human-machine collaboration paradigm. Afterwards, instruments themselves serve as interactive pointers to label additional elements of the surgical scene. We evaluated our proposed framework on a subset of publicly available Cataract1k dataset and an in-house ex-vivo skull-base dataset to demonstrate its potential to generate on-the-fly segmentation and tracking of surgical scene. Furthermore, we demonstrate its dynamic capabilities through a live mock ex-vivo experiment. This human-AI collaboration paradigm showcase the potential of developing adaptable, hands-free, surgeon-centric tools for dynamic operating-room environments.