GAMMA: Generalizable Alignment via Multi-task and Manipulation-Augmented Training for AI-Generated Image Detection

作者: Haozhen Yan, Yan Hong, Suning Lang, Jiahui Zhan, Yikun Ji, Yujie Gao, Huijia Zhu, Jun Lan, Jianfu Zhang

分类: cs.CV

发布日期: 2025-09-12 (更新: 2026-01-23)

💡 一句话要点

GAMMA:通过多任务和操纵增强训练实现AI生成图像检测的泛化对齐

🎯 匹配领域: 支柱一:机器人控制 (Robot Control)

关键词: AI生成图像检测 泛化能力 多任务学习 图像操纵 反向交叉注意力

📋 核心要点

- 现有AI生成图像检测器依赖于生成模型的特定伪影,泛化能力不足,难以应对不断涌现的新型生成模型。

- GAMMA框架通过引入多样化的操纵策略和多任务监督,减少领域偏差,增强语义对齐,从而提升模型的泛化能力。

- 实验结果表明,GAMMA在GenImage基准测试中取得了SOTA的泛化性能,并在GPT-4o等新模型上表现出强大的鲁棒性。

📝 摘要(中文)

随着生成模型变得越来越复杂和多样化,检测AI生成的图像变得越来越具有挑战性。现有的AI生成图像检测器在同分布的生成图像上取得了有希望的性能,但它们对未见过的生成模型的泛化能力仍然有限。这种局限性主要归因于它们对特定于生成的伪影的依赖,例如风格先验和压缩模式。为了解决这些局限性,我们提出了一种新的训练框架GAMMA,旨在减少领域偏差并增强语义对齐。GAMMA引入了多种操纵策略,例如基于修复的操纵和语义保持扰动,以确保操纵内容和真实内容之间的一致性。我们采用具有双分割头和分类头的多任务监督,从而能够在不同的生成域中进行像素级源属性归因。此外,还引入了一种反向交叉注意力机制,以允许分割头指导和纠正分类分支中的有偏表示。我们的方法在GenImage基准测试中实现了最先进的泛化性能,准确率提高了5.8%,并且在新发布的生成模型(如GPT-4o)上保持了强大的鲁棒性。

🔬 方法详解

问题定义:当前AI生成图像检测方法在面对未知的生成模型时,泛化能力较差。这是因为现有方法过度依赖于特定生成模型的风格先验和压缩模式等伪影,导致模型对训练数据过拟合,无法有效识别来自未知生成模型的图像。

核心思路:GAMMA的核心思路是通过减少模型对特定生成器伪影的依赖,增强模型对图像语义的理解,从而提高泛化能力。具体来说,通过引入多样化的图像操纵策略和多任务学习,迫使模型学习更鲁棒的特征表示。

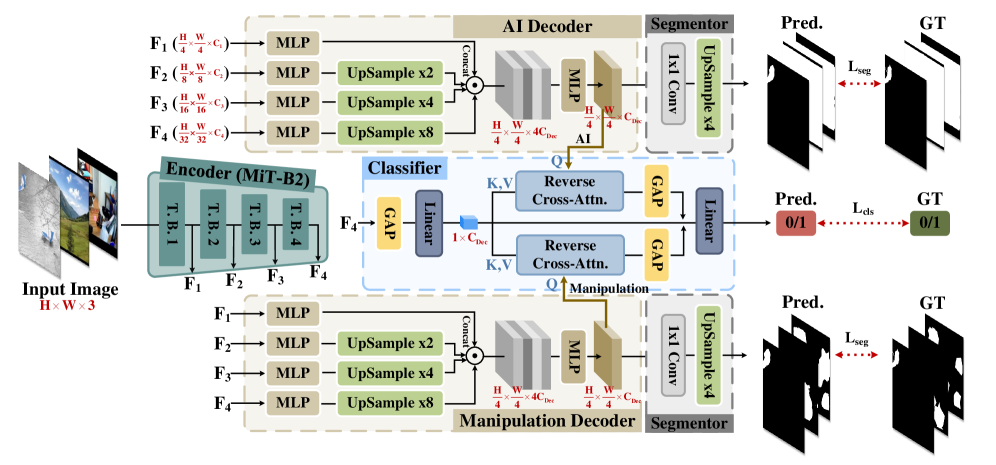

技术框架:GAMMA框架包含三个主要组成部分:图像操纵模块、多任务学习模块和反向交叉注意力模块。图像操纵模块负责生成各种被操纵的图像,包括基于修复的操纵和语义保持扰动。多任务学习模块包含一个分类头和两个分割头,分别用于图像真伪分类和像素级源属性归因。反向交叉注意力模块允许分割头指导和纠正分类分支中的有偏表示。

关键创新:GAMMA的关键创新在于其多任务学习框架和反向交叉注意力机制。多任务学习迫使模型同时学习图像的真伪和像素级的生成源信息,从而增强了模型对图像语义的理解。反向交叉注意力机制则允许分割头纠正分类分支中的有偏表示,进一步提高了模型的鲁棒性。

关键设计:图像操纵模块采用了多种操纵策略,包括随机擦除、图像修复和语义保持扰动。多任务学习模块使用了交叉熵损失函数和Dice损失函数来训练分类头和分割头。反向交叉注意力机制通过计算分割头和分类头之间的注意力权重,实现了分割头对分类分支的指导。

🖼️ 关键图片

📊 实验亮点

GAMMA在GenImage基准测试中取得了显著的性能提升,准确率提高了5.8%,达到了SOTA水平。此外,GAMMA还在新发布的生成模型(如GPT-4o)上表现出强大的鲁棒性,表明其具有良好的泛化能力。这些实验结果验证了GAMMA框架的有效性和优越性。

🎯 应用场景

GAMMA技术可应用于内容安全领域,用于检测和识别AI生成的虚假图像,防止恶意传播和信息操纵。此外,该技术还可以用于版权保护,帮助识别未经授权的AI生成图像,维护创作者的权益。未来,该技术有望集成到图像搜索引擎和社交媒体平台中,自动识别和标记AI生成的内容。

📄 摘要(原文)

With generative models becoming increasingly sophisticated and diverse, detecting AI-generated images has become increasingly challenging. While existing AI-genereted Image detectors achieve promising performance on in-distribution generated images, their generalization to unseen generative models remains limited. This limitation is largely attributed to their reliance on generation-specific artifacts, such as stylistic priors and compression patterns. To address these limitations, we propose GAMMA, a novel training framework designed to reduce domain bias and enhance semantic alignment. GAMMA introduces diverse manipulation strategies, such as inpainting-based manipulation and semantics-preserving perturbations, to ensure consistency between manipulated and authentic content. We employ multi-task supervision with dual segmentation heads and a classification head, enabling pixel-level source attribution across diverse generative domains. In addition, a reverse cross-attention mechanism is introduced to allow the segmentation heads to guide and correct biased representations in the classification branch. Our method achieves state-of-the-art generalization performance on the GenImage benchmark, imporving accuracy by 5.8%, but also maintains strong robustness on newly released generative model such as GPT-4o.