LaV-CoT: Language-Aware Visual CoT with Multi-Aspect Reward Optimization for Real-World Multilingual VQA

作者: Jing Huang, Zhiya Tan, Shutao Gong, Fanwei Zeng, Joey Tianyi Zhou, Changtao Miao, Huazhe Tan, Weibin Yao, Jianshu Li

分类: cs.CV

发布日期: 2025-09-12 (更新: 2025-10-10)

备注: 12 Pages, 12 Figures, 3 Tables

🔗 代码/项目: GITHUB

💡 一句话要点

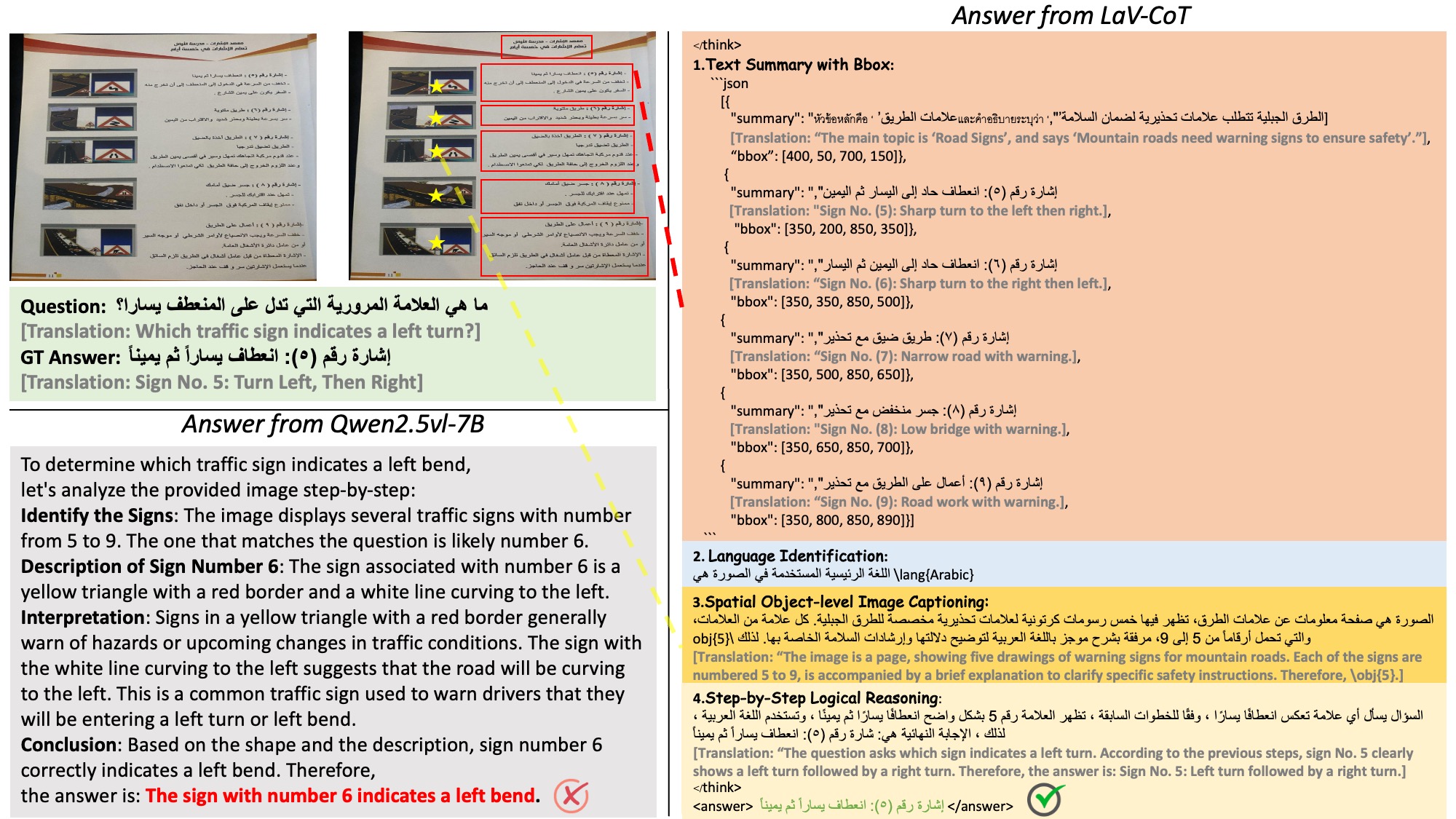

提出LaV-CoT框架,通过多方面奖励优化,解决真实世界多语言VQA问题。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 多语言视觉问答 思维链 视觉语言模型 多模态推理 奖励优化

📋 核心要点

- 现有mVQA方法主要依赖文本CoT,缺乏对多语言多模态推理的有效支持,限制了实际应用。

- LaV-CoT框架通过语言感知的视觉CoT,结合多阶段推理流程和多方面奖励优化,提升mVQA性能。

- 实验结果表明,LaV-CoT在多个数据集上显著优于现有模型,并在真实世界数据中验证了有效性。

📝 摘要(中文)

随着大型视觉语言模型(VLMs)的发展,它们在多语言视觉问答(mVQA)方面的能力得到了显著提高。思维链(CoT)推理已被证明可以增强可解释性和复杂推理。然而,大多数现有方法主要依赖于文本CoT,并且对多语言多模态推理的支持有限,从而限制了它们在实际应用中的部署。为了解决这一差距,我们引入了LaV-CoT,这是第一个具有多方面奖励优化的语言感知视觉CoT框架。LaV-CoT包含一个可解释的多阶段推理流程,包括带有边界框的文本摘要、语言识别、空间对象级描述和逐步逻辑推理。遵循此推理流程,我们设计了一种自动数据管理方法,该方法通过迭代生成、校正和细化来生成多语言CoT注释,从而实现可扩展的高质量训练数据。为了提高推理和泛化能力,LaV-CoT采用了一种两阶段训练范例,将监督微调(SFT)与语言感知组相对策略优化(GRPO)相结合,并以可验证的多方面奖励(包括语言一致性、结构准确性和语义对齐)为指导。在包括MMMB、Multilingual MMBench和MTVQA在内的公共数据集上的大量评估表明,LaV-CoT的准确率比类似规模的开源基线提高了高达~9.5%,甚至超过了规模大2倍的模型约~2.6%。此外,LaV-CoT的性能优于GPT-4o-0513和Gemini-2.5-flash等先进的专有模型。我们进一步进行了在线A/B测试,以验证我们的方法在真实世界数据上的有效性,突出了其在工业部署中的有效性。

🔬 方法详解

问题定义:论文旨在解决真实世界多语言视觉问答(mVQA)中,现有方法对多语言多模态推理支持不足的问题。现有方法主要依赖文本CoT,忽略了图像中的空间信息和多语言之间的复杂关系,导致推理能力受限。

核心思路:LaV-CoT的核心思路是引入语言感知的视觉CoT,通过多阶段推理流程,显式地建模图像中的空间关系和多语言信息。同时,利用多方面奖励优化,确保推理过程的语言一致性、结构准确性和语义对齐。

技术框架:LaV-CoT框架包含以下主要模块: 1. 文本摘要与边界框(BBox):提取图像相关文本信息,并定位关键对象。 2. 语言识别:识别输入问题的语言。 3. 空间对象级描述:生成图像中对象的空间关系描述。 4. 逐步逻辑推理:基于以上信息,进行逐步推理,生成答案。

框架采用两阶段训练范式: 1. 监督微调(SFT):使用自动生成的多语言CoT数据进行微调。 2. 语言感知组相对策略优化(GRPO):使用多方面奖励进行策略优化。

关键创新:LaV-CoT的关键创新在于: 1. 语言感知的视觉CoT:将视觉信息和语言信息显式地结合到CoT推理中。 2. 多方面奖励优化:利用语言一致性、结构准确性和语义对齐等多方面奖励,指导模型学习更有效的推理策略。 3. 自动多语言CoT数据生成:通过迭代生成、校正和细化,高效地生成高质量的多语言CoT数据。

关键设计: * 多方面奖励函数:综合考虑语言一致性、结构准确性和语义对齐,设计多方面奖励函数,用于指导GRPO训练。 * 语言感知组相对策略优化(GRPO):根据输入问题的语言,将样本分组,并进行相对策略优化,提高模型的泛化能力。 * 自动数据生成流程:设计迭代生成、校正和细化的流程,生成高质量的多语言CoT数据,降低人工标注成本。

🖼️ 关键图片

📊 实验亮点

LaV-CoT在MMMB、Multilingual MMBench和MTVQA等数据集上取得了显著的性能提升,相比同等规模的开源基线模型,准确率提升高达9.5%,甚至超越了规模大2倍的模型约2.6%。此外,LaV-CoT的性能优于GPT-4o-0513和Gemini-2.5-flash等先进的专有模型。在线A/B测试也验证了LaV-CoT在真实世界数据上的有效性。

🎯 应用场景

LaV-CoT框架可应用于多语言客服机器人、跨语言图像搜索、多语言教育辅助等领域。该研究有助于提升视觉语言模型在多语言环境下的理解和推理能力,具有重要的实际应用价值。未来可进一步探索更复杂的推理流程和更有效的奖励机制,以提升模型性能。

📄 摘要(原文)

As large vision language models (VLMs) advance, their capabilities in multilingual visual question answering (mVQA) have significantly improved. Chain-of-thought (CoT) reasoning has been proven to enhance interpretability and complex reasoning. However, most existing approaches rely primarily on textual CoT and provide limited support for multilingual multimodal reasoning, constraining their deployment in real-world applications. To address this gap, we introduce LaV-CoT, the first Language-aware Visual CoT framework with Multi-Aspect Reward Optimization. LaV-CoT incorporates an interpretable multi-stage reasoning pipeline consisting of Text Summary with Bounding Box (BBox), Language Identification, Spatial Object-level Captioning, and Step-by-step Logical Reasoning. Following this reasoning pipeline, we design an automated data curation method that generates multilingual CoT annotations through iterative generation, correction, and refinement, enabling scalable and high-quality training data. To improve reasoning and generalization, LaV-CoT adopts a two-stage training paradigm combining Supervised Fine-Tuning (SFT) with Language-aware Group Relative Policy Optimization (GRPO), guided by verifiable multi-aspect rewards including language consistency, structural accuracy, and semantic alignment. Extensive evaluations on public datasets including MMMB, Multilingual MMBench, and MTVQA show that LaV-CoT achieves up to ~9.5% accuracy improvements over open-source baselines of similar size and even surpasses models with 2$\times$ larger scales by ~2.6%. Moreover, LaV-CoT outperforms advanced proprietary models such as GPT-4o-0513 and Gemini-2.5-flash. We further conducted an online A/B test to validate our method on real-world data, highlighting its effectiveness for industrial deployment. Our code is available at this link: https://github.com/HJNVR/LaV-CoT