PeftCD: Leveraging Vision Foundation Models with Parameter-Efficient Fine-Tuning for Remote Sensing Change Detection

作者: Sijun Dong, Yuxuan Hu, LiBo Wang, Geng Chen, Xiaoliang Meng

分类: cs.CV

发布日期: 2025-09-11

🔗 代码/项目: GITHUB

💡 一句话要点

PeftCD:利用参数高效微调的视觉基础模型进行遥感变化检测

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 遥感变化检测 视觉基础模型 参数高效微调 Siamese网络 LoRA Adapter 自监督学习 伪变化抑制

📋 核心要点

- 遥感变化检测面临伪变化多、标注数据少和跨域泛化难等挑战,限制了现有方法的性能。

- PeftCD框架利用视觉基础模型(VFMs)和参数高效微调(PEFT),仅训练少量参数即可实现高效的任务适应。

- 实验结果表明,PeftCD在多个遥感数据集上取得了SOTA性能,并有效抑制了伪变化,提升了边界精度。

📝 摘要(中文)

为了解决多时相和多源遥感图像中普遍存在的伪变化、标记样本稀缺以及跨领域泛化困难等问题,我们提出了PeftCD,这是一个建立在视觉基础模型(VFMs)之上,并采用参数高效微调(PEFT)的变化检测框架。PeftCD的核心是采用一个由VFM衍生的权重共享的Siamese编码器,其中无缝集成了LoRA和Adapter模块。这种设计通过仅训练最少数量的额外参数来实现高效的任务适应。为了充分释放VFMs的潜力,我们研究了两个领先的骨干网络:以强大的分割先验而闻名的Segment Anything Model v2(SAM2)和最先进的自监督表征学习器DINOv3。该框架由一个精心设计的轻量级解码器补充,确保重点仍然放在来自骨干网络的强大特征表示上。大量实验表明,PeftCD在多个公共数据集上实现了最先进的性能,包括SYSU-CD(IoU 73.81%)、WHUCD(92.05%)、MSRSCD(64.07%)、MLCD(76.89%)、CDD(97.01%)、S2Looking(52.25%)和LEVIR-CD(85.62%),具有显著精确的边界描绘和对伪变化的强大抑制。总之,PeftCD在准确性、效率和泛化性之间实现了最佳平衡。它为将大规模VFMs应用于实际遥感变化检测应用提供了一个强大且可扩展的范例。代码和预训练模型将在https://github.com/dyzy41/PeftCD上发布。

🔬 方法详解

问题定义:遥感变化检测旨在识别不同时间点同一区域地物变化。现有方法在处理多时相、多源遥感数据时,容易受到光照、季节等因素影响,产生大量伪变化。此外,标注数据的稀缺性和跨领域泛化能力不足也限制了现有方法的性能。

核心思路:论文的核心思路是利用预训练的视觉基础模型(VFMs)强大的特征提取能力,并通过参数高效微调(PEFT)方法,仅训练少量参数即可将VFMs适应于遥感变化检测任务。这种方法既能利用VFMs的通用知识,又能避免从头训练带来的高成本和过拟合风险。

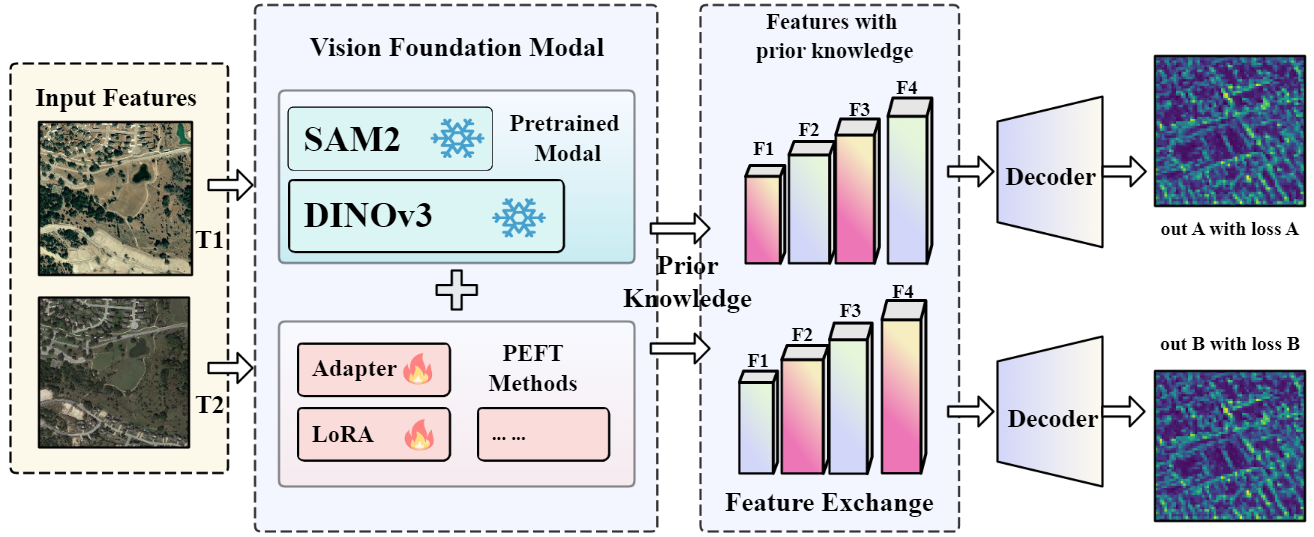

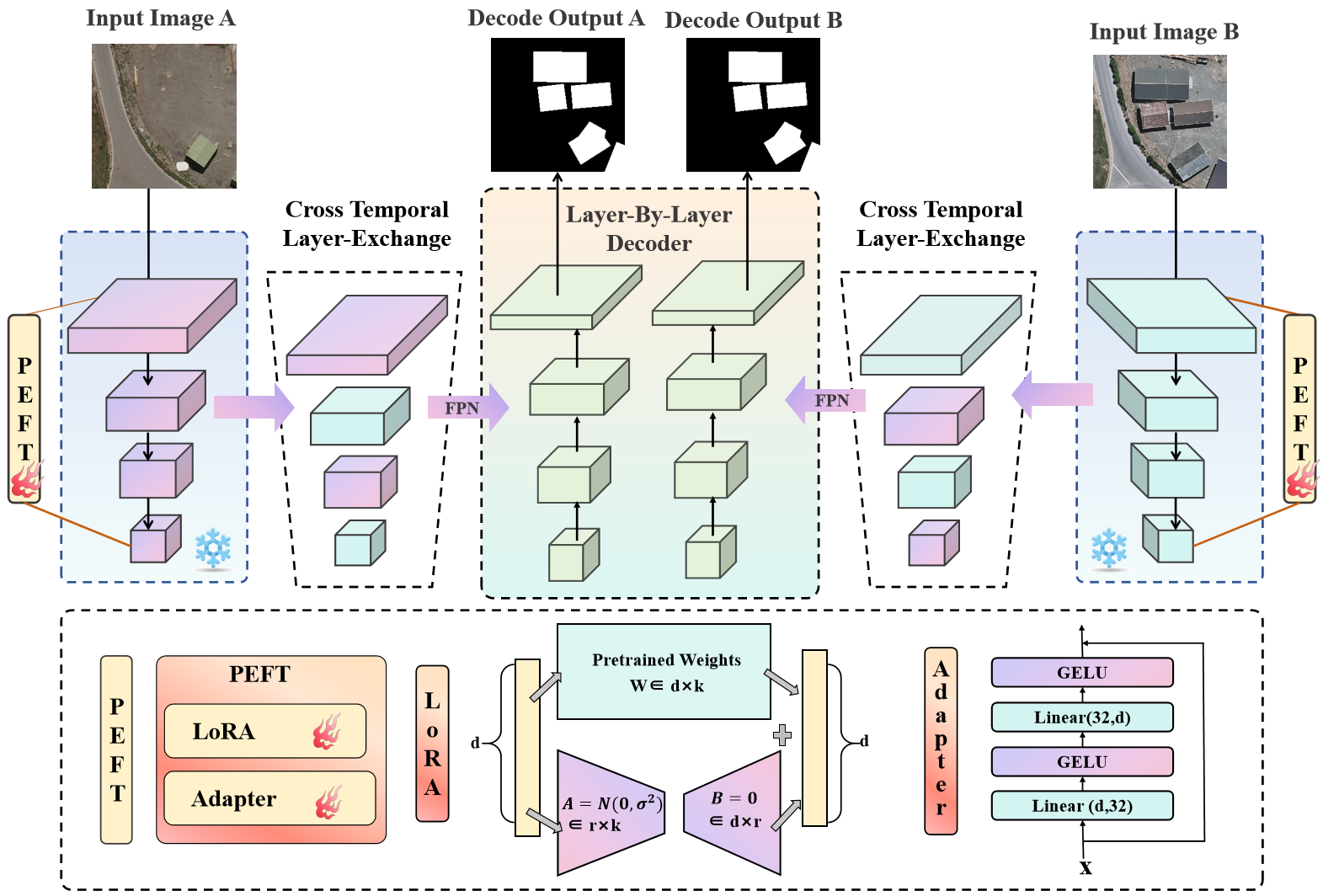

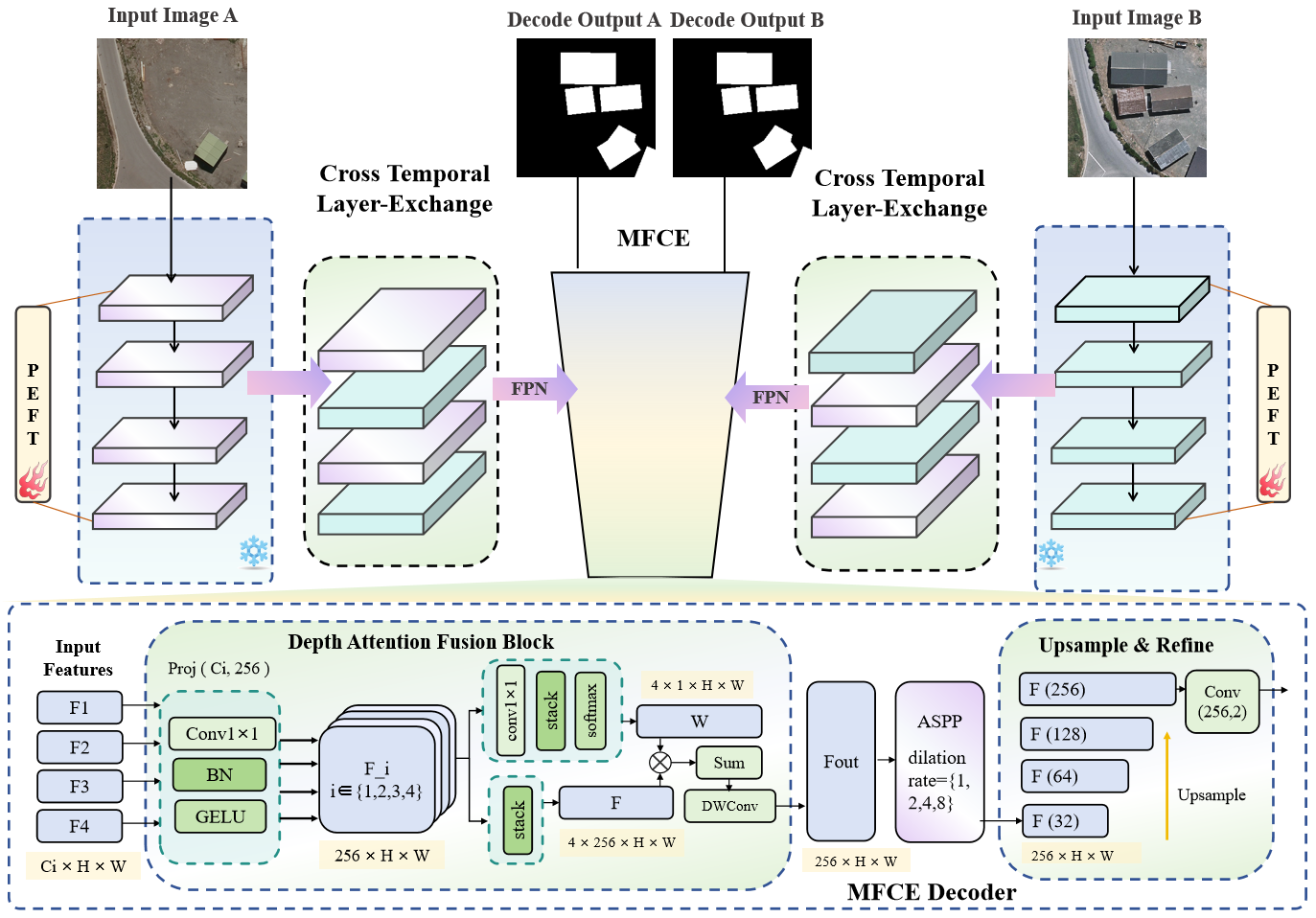

技术框架:PeftCD框架采用Siamese网络结构,包含两个共享权重的编码器和一个轻量级解码器。编码器基于VFM(SAM2或DINOv3),并集成LoRA和Adapter模块进行参数高效微调。两个时相的遥感图像分别输入到两个编码器中提取特征,然后将提取的特征输入到解码器中进行变化检测。解码器输出变化概率图,指示每个像素的变化情况。

关键创新:PeftCD的关键创新在于将视觉基础模型与参数高效微调相结合,用于遥感变化检测。通过LoRA和Adapter模块,仅需训练少量参数即可将VFM适应于特定任务,显著降低了训练成本,并提高了模型的泛化能力。此外,论文还探索了不同的VFM骨干网络(SAM2和DINOv3)对变化检测性能的影响。

关键设计:PeftCD的关键设计包括:1) 使用权重共享的Siamese网络结构,保证两个编码器提取的特征具有一致性;2) 集成LoRA和Adapter模块,实现参数高效微调;3) 设计轻量级解码器,避免解码器成为性能瓶颈;4) 采用交叉熵损失函数进行训练,优化变化概率图的预测。

🖼️ 关键图片

📊 实验亮点

PeftCD在多个公开遥感变化检测数据集上取得了SOTA性能,例如在SYSU-CD数据集上IoU达到73.81%,在WHUCD数据集上达到92.05%。与现有方法相比,PeftCD能够更精确地描绘变化边界,并有效抑制伪变化,显著提升了变化检测的准确性和可靠性。

🎯 应用场景

PeftCD在城市规划、灾害监测、农业管理和环境评估等领域具有广泛的应用前景。通过自动检测地物变化,可以为决策者提供及时准确的信息,辅助制定合理的规划和应对措施。该研究成果有助于提升遥感图像的应用价值,推动遥感技术在各行业的普及。

📄 摘要(原文)

To tackle the prevalence of pseudo changes, the scarcity of labeled samples, and the difficulty of cross-domain generalization in multi-temporal and multi-source remote sensing imagery, we propose PeftCD, a change detection framework built upon Vision Foundation Models (VFMs) with Parameter-Efficient Fine-Tuning (PEFT). At its core, PeftCD employs a weight-sharing Siamese encoder derived from a VFM, into which LoRA and Adapter modules are seamlessly integrated. This design enables highly efficient task adaptation by training only a minimal set of additional parameters. To fully unlock the potential of VFMs, we investigate two leading backbones: the Segment Anything Model v2 (SAM2), renowned for its strong segmentation priors, and DINOv3, a state-of-the-art self-supervised representation learner. The framework is complemented by a deliberately lightweight decoder, ensuring the focus remains on the powerful feature representations from the backbones. Extensive experiments demonstrate that PeftCD achieves state-of-the-art performance across multiple public datasets, including SYSU-CD (IoU 73.81%), WHUCD (92.05%), MSRSCD (64.07%), MLCD (76.89%), CDD (97.01%), S2Looking (52.25%) and LEVIR-CD (85.62%), with notably precise boundary delineation and strong suppression of pseudo-changes. In summary, PeftCD presents an optimal balance of accuracy, efficiency, and generalization. It offers a powerful and scalable paradigm for adapting large-scale VFMs to real-world remote sensing change detection applications. The code and pretrained models will be released at https://github.com/dyzy41/PeftCD.