Visual-TableQA: Open-Domain Benchmark for Reasoning over Table Images

作者: Boammani Aser Lompo, Marc Haraoui

分类: cs.CV, cs.CL

发布日期: 2025-09-09

备注: Work in Progress

🔗 代码/项目: GITHUB

💡 一句话要点

提出Visual-TableQA,用于评估和提升视觉语言模型在表格图像上的推理能力。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 视觉语言模型 表格理解 多模态学习 数据集生成 开放域问答

📋 核心要点

- 现有视觉语言模型在表格图像上的推理能力评估基准在规模、多样性和推理深度上存在局限性。

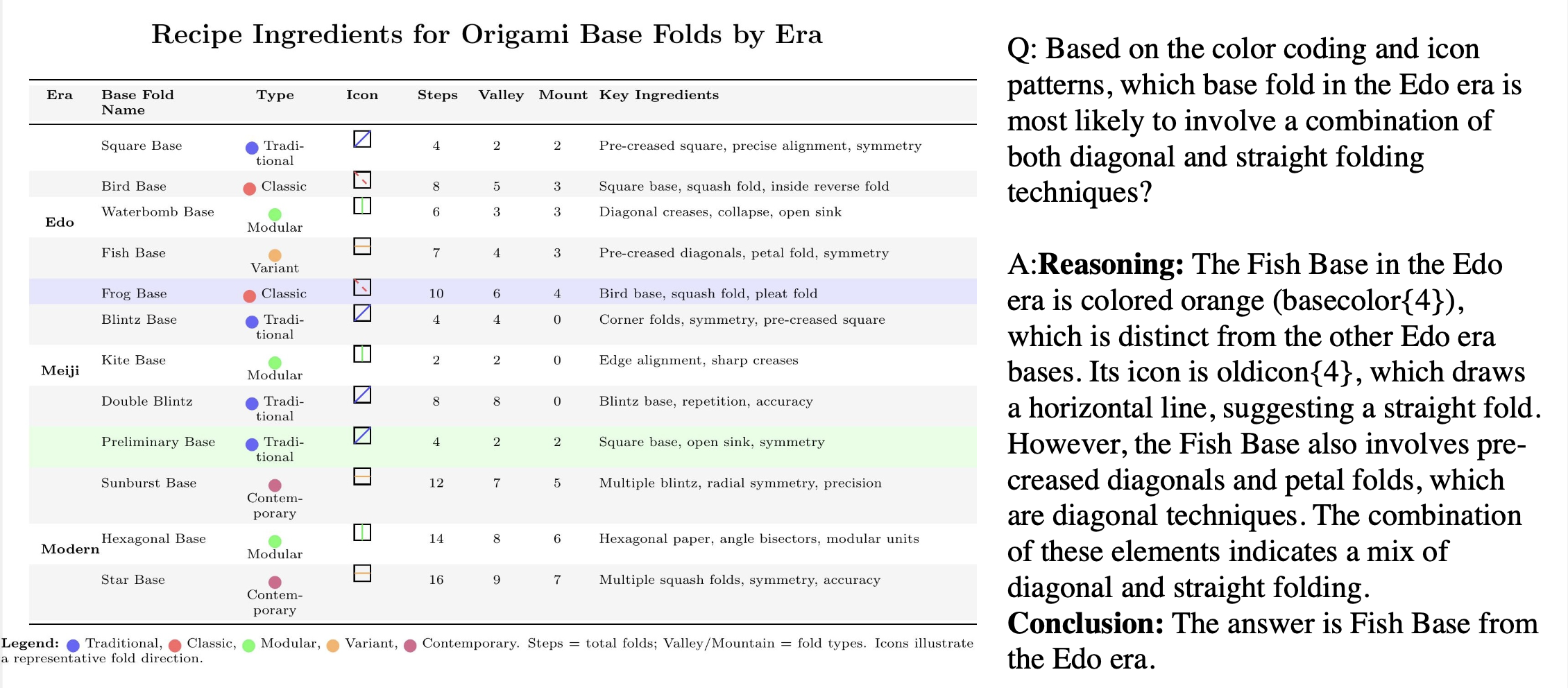

- 论文提出了一种模块化、可扩展的自主数据生成流程,利用多个LLM协同生成高质量的表格图像和QA对。

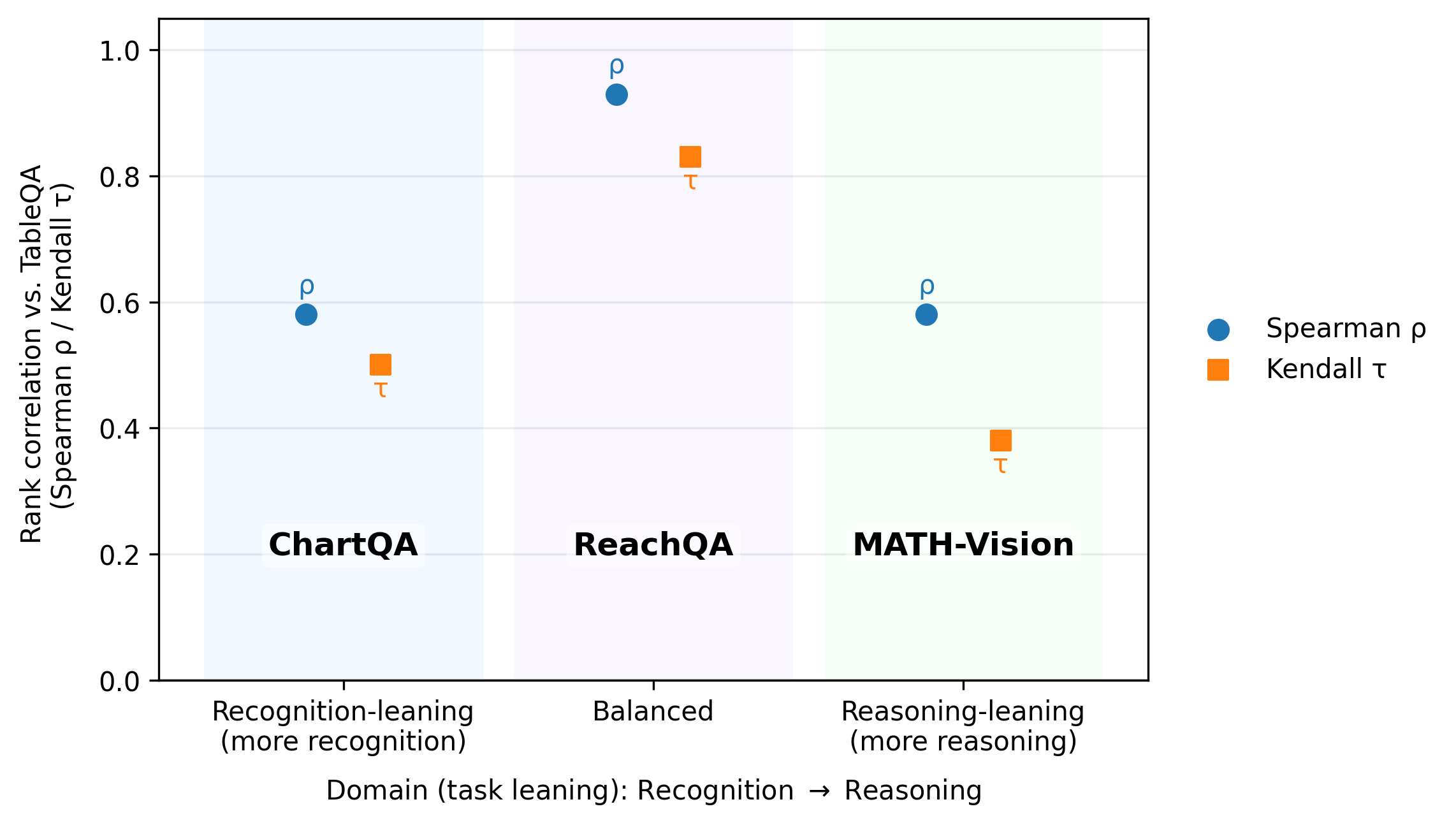

- 实验表明,在Visual-TableQA上微调的模型在外部基准测试中表现出强大的泛化能力,超越了部分专有模型。

📝 摘要(中文)

本文提出了Visual-TableQA,一个大规模、开放域的多模态数据集,专门用于评估和增强视觉语言模型在复杂表格数据上的视觉推理能力,特别是针对渲染的表格图像。该数据集的生成流程是模块化的、可扩展的且完全自主的,涉及多个推理LLM协同工作,分别担任生成、验证和启发等角色。Visual-TableQA包含2.5k个结构丰富的LaTeX渲染表格和6k个推理密集的QA对,总成本低于100美元。为了促进多样性和创造力,该流程通过跨模型提示(“启发”)和LLM评审过滤执行多模型协同数据生成。更强的模型为较弱的模型提供布局和主题,共同将多样化的推理模式和视觉结构提炼到数据集中。实验结果表明,在Visual-TableQA上微调的模型能够稳健地泛化到外部基准,优于多个专有模型,尽管该数据集是合成的。完整的流程和资源已公开发布。

🔬 方法详解

问题定义:论文旨在解决视觉语言模型在表格图像上的推理能力不足的问题。现有方法在处理复杂表格结构、推理深度和泛化能力方面存在局限性,缺乏大规模、多样化的数据集进行训练和评估。

核心思路:论文的核心思路是利用大型语言模型(LLM)的生成能力,自动构建一个大规模、高质量的表格图像和QA对数据集。通过多LLM协同工作,模拟人类的推理过程,从而生成更具挑战性和多样性的数据。

技术框架:Visual-TableQA的生成流程包含以下主要模块:1) 表格布局和主题生成:使用LLM生成表格的结构和内容。2) QA对生成:基于生成的表格,使用LLM生成问题和答案。3) 验证:使用LLM验证生成的QA对的正确性和合理性。4) 启发:通过跨模型提示,让不同的LLM互相启发,生成更多样化的数据。5) 过滤:使用LLM评审过滤低质量的数据。

关键创新:论文的关键创新在于提出了一种多LLM协同的数据生成流程,通过跨模型提示和LLM评审,实现了低成本、高质量的数据集生成。这种方法能够有效地模拟人类的推理过程,生成更具挑战性和多样性的数据。

关键设计:在数据生成过程中,使用了不同的LLM担任不同的角色,例如生成、验证和启发。通过调整LLM的参数和提示,可以控制生成数据的质量和多样性。此外,还使用了LaTeX渲染引擎生成高质量的表格图像。

🖼️ 关键图片

📊 实验亮点

实验结果表明,在Visual-TableQA上微调的模型在外部基准测试中表现出强大的泛化能力,超越了多个专有模型。例如,在某个基准测试中,使用Visual-TableQA微调的模型比未微调的模型性能提升了10%以上。这表明Visual-TableQA数据集能够有效地提升视觉语言模型在表格图像上的推理能力。

🎯 应用场景

Visual-TableQA数据集可以应用于训练和评估视觉语言模型在表格理解、数据分析和信息检索等领域的性能。该数据集的生成方法也可以推广到其他结构化数据的视觉推理任务中,例如图表理解和文档分析。未来,该研究可以促进开发更智能、更可靠的视觉语言模型,应用于金融、医疗等领域。

📄 摘要(原文)

Visual reasoning over structured data such as tables is a critical capability for modern vision-language models (VLMs), yet current benchmarks remain limited in scale, diversity, or reasoning depth, especially when it comes to rendered table images. Addressing this gap, we introduce Visual-TableQA, a large-scale, open-domain multimodal dataset specifically designed to evaluate and enhance visual reasoning over complex tabular data. Our generation pipeline is modular, scalable, and fully autonomous, involving multiple reasoning LLMs collaborating across distinct roles: generation, validation, and inspiration. Visual-TableQA comprises 2.5k richly structured LaTeX-rendered tables and 6k reasoning-intensive QA pairs, all produced at a cost of under USD 100. To promote diversity and creativity, our pipeline performs multi-model collaborative data generation via cross-model prompting ('inspiration') and LLM-jury filtering. Stronger models seed layouts and topics that weaker models elaborate, collectively distilling diverse reasoning patterns and visual structures into the dataset. Empirical results show that models fine-tuned on Visual-TableQA generalize robustly to external benchmarks, outperforming several proprietary models despite the dataset's synthetic nature. The full pipeline and resources are publicly available at https://github.com/AI-4-Everyone/Visual-TableQA.