WATCH: World-aware Allied Trajectory and pose reconstruction for Camera and Human

作者: Qijun Ying, Zhongyuan Hu, Rui Zhang, Ronghui Li, Yu Lu, Zijiao Zeng

分类: cs.CV

发布日期: 2025-09-04

💡 一句话要点

提出WATCH框架,解决单目视频中相机和人体全局运动轨迹精确重建问题

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture) 支柱七:动作重定向 (Motion Retargeting) 支柱八:物理动画 (Physics-based Animation)

关键词: 人体运动重建 相机姿态估计 单目视频 全局轨迹 世界模型

📋 核心要点

- 现有基于人体运动的方法在全局人体运动重建中,未能充分利用相机朝向信息,且相机平移信息的集成效果不佳。

- WATCH框架通过解析航向角分解技术提升效率和可扩展性,并设计相机轨迹集成机制有效利用相机平移信息。

- 在真实场景基准测试中,WATCH在端到端轨迹重建方面取得了state-of-the-art的性能,验证了方法的有效性。

📝 摘要(中文)

本文提出WATCH(World-aware Allied Trajectory and pose reconstruction for Camera and Human),一个统一的框架,用于解决从单目视频中进行全局人体运动重建的问题。该问题在VR、图形学和机器人等领域日益重要,但面临深度模糊、运动模糊以及相机和人体运动之间相互影响的挑战。现有方法虽然擅长保持运动细节和物理合理性,但未能充分利用相机朝向信息,且相机平移信息的集成效果不佳。WATCH引入了一种解析的航向角分解技术,与现有几何方法相比,具有更高的效率和可扩展性。此外,设计了一种受世界模型启发的相机轨迹集成机制,为利用相机平移信息提供了一种有效途径。在真实场景基准测试上的实验表明,WATCH在端到端轨迹重建方面实现了最先进的性能。该工作证明了联合建模相机-人体运动关系的有效性,并为解决全局人体运动重建中长期存在的相机平移集成挑战提供了新的见解。代码将公开。

🔬 方法详解

问题定义:论文旨在解决从单目视频中重建全局人体运动轨迹和相机姿态的问题。现有的方法,特别是那些以人为中心的运动重建方法,在利用相机方向信息和整合相机平移信息方面存在不足,导致重建的轨迹不准确。这些方法通常难以处理深度模糊、运动模糊以及相机和人体运动之间的复杂关系。

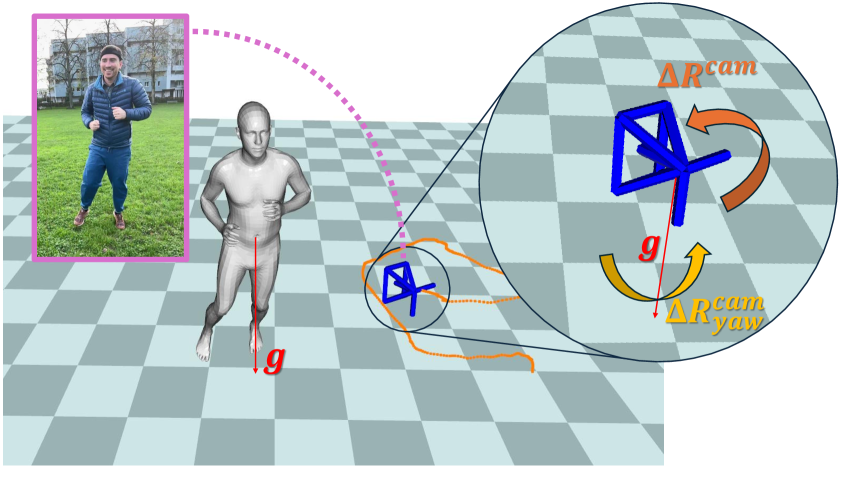

核心思路:论文的核心思路是联合建模相机和人体运动之间的关系,并设计更有效的机制来利用相机提供的运动信息。具体来说,通过引入解析的航向角分解技术来更精确地估计相机方向,并借鉴世界模型的思想,设计相机轨迹积分机制来有效整合相机平移信息。

技术框架:WATCH框架包含以下主要模块:1) 人体姿态估计模块,用于从单目视频中提取人体姿态信息;2) 相机航向角分解模块,使用解析方法分解相机航向角;3) 相机轨迹积分模块,利用世界模型思想整合相机平移信息,重建相机轨迹;4) 全局运动重建模块,将人体姿态和相机运动信息融合,重建全局人体运动轨迹。整体流程是从视频中提取人体姿态,然后分别估计相机方向和平移,最后将所有信息整合以重建全局运动。

关键创新:该论文的关键创新在于两个方面:一是提出了解析的航向角分解技术,该技术比现有的几何方法更有效且可扩展;二是设计了一种受世界模型启发的相机轨迹积分机制,该机制能够更有效地利用相机平移信息。这两个创新共同解决了现有方法在相机信息利用方面的不足。

关键设计:解析航向角分解的具体实现细节未知,但强调了其解析性和高效性。相机轨迹积分机制的关键在于如何借鉴世界模型的思想,可能是通过学习一个隐式的运动模型来预测相机在世界坐标系中的运动。损失函数的设计可能包括对重建的人体运动轨迹的物理合理性约束,以及对相机运动轨迹的平滑性约束。具体的网络结构未知,但可以推测会包含用于处理时间序列数据的循环神经网络或Transformer结构。

🖼️ 关键图片

📊 实验亮点

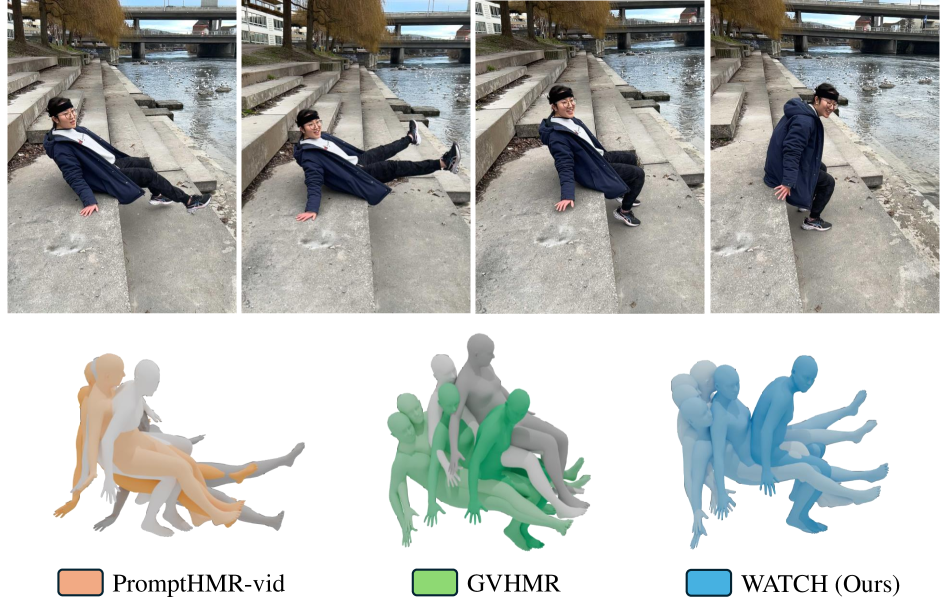

WATCH在真实场景基准测试中取得了state-of-the-art的性能,证明了其在全局人体运动轨迹重建方面的优越性。具体性能数据和对比基线未知,但摘要强调了其在端到端轨迹重建方面的显著提升,表明该方法在实际应用中具有很高的价值。

🎯 应用场景

该研究成果可广泛应用于虚拟现实(VR)、计算机图形学和机器人等领域。在VR中,可以实现更逼真的虚拟化身运动捕捉和交互。在图形学中,可以用于生成更自然的人体动画。在机器人领域,可以帮助机器人更好地理解和预测人类运动,从而实现更安全、更高效的人机协作。该技术还有潜力应用于运动分析、游戏开发等领域。

📄 摘要(原文)

Global human motion reconstruction from in-the-wild monocular videos is increasingly demanded across VR, graphics, and robotics applications, yet requires accurate mapping of human poses from camera to world coordinates-a task challenged by depth ambiguity, motion ambiguity, and the entanglement between camera and human movements. While human-motion-centric approaches excel in preserving motion details and physical plausibility, they suffer from two critical limitations: insufficient exploitation of camera orientation information and ineffective integration of camera translation cues. We present WATCH (World-aware Allied Trajectory and pose reconstruction for Camera and Human), a unified framework addressing both challenges. Our approach introduces an analytical heading angle decomposition technique that offers superior efficiency and extensibility compared to existing geometric methods. Additionally, we design a camera trajectory integration mechanism inspired by world models, providing an effective pathway for leveraging camera translation information beyond naive hard-decoding approaches. Through experiments on in-the-wild benchmarks, WATCH achieves state-of-the-art performance in end-to-end trajectory reconstruction. Our work demonstrates the effectiveness of jointly modeling camera-human motion relationships and offers new insights for addressing the long-standing challenge of camera translation integration in global human motion reconstruction. The code will be available publicly.