Skywork UniPic 2.0: Building Kontext Model with Online RL for Unified Multimodal Model

作者: Hongyang Wei, Baixin Xu, Hongbo Liu, Size Wu, Jie Liu, Yi Peng, Peiyu Wang, Zexiang Liu, Jingwen He, Yidan Xietian, Chuanxin Tang, Zidong Wang, Yichen Wei, Liang Hu, Boyi Jiang, Wei Li, Ying He, Yang Liu, Xuchen Song, Yangguang Li, Yahui Zhou

分类: cs.CV

发布日期: 2025-09-04 (更新: 2026-01-22)

💡 一句话要点

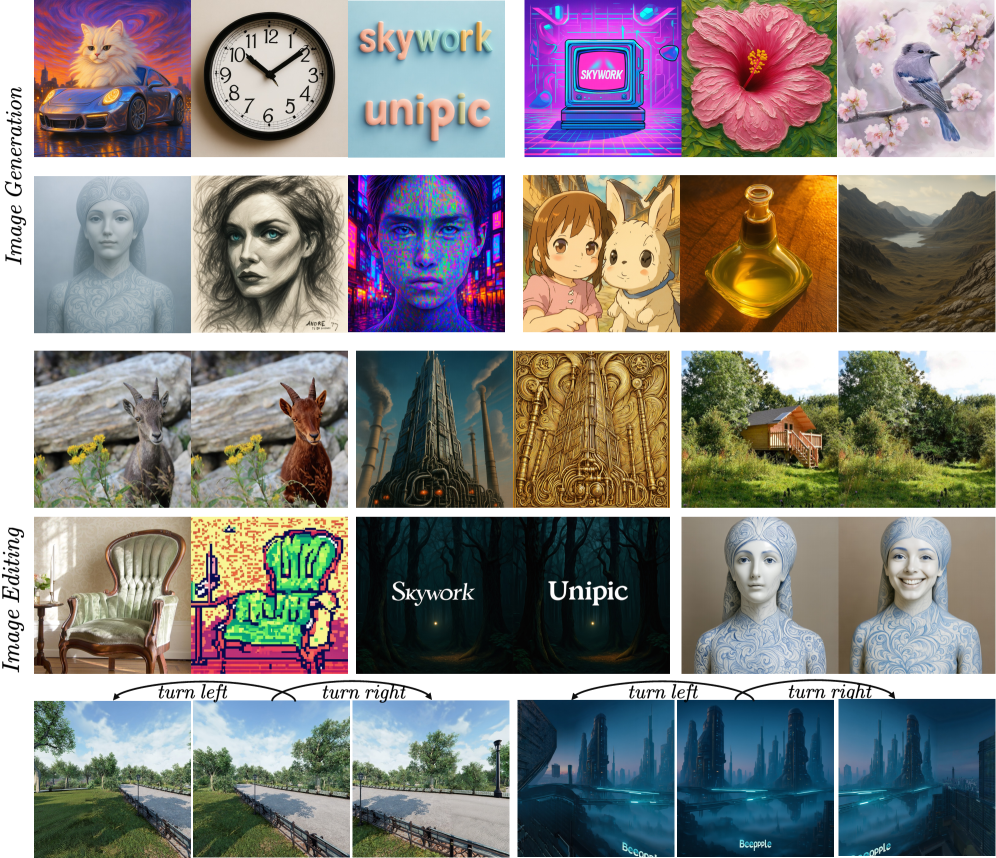

UniPic 2.0:通过在线强化学习构建Kontext模型,实现统一多模态图像生成与编辑

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 多模态模型 图像生成 图像编辑 强化学习 扩散模型 DiT模型 在线学习

📋 核心要点

- 现有开源多模态模型侧重于扩大模型参数,忽略了训练策略的优化,导致效率和性能受限。

- UniPic 2.0通过架构改进、大规模预训练和渐进式双任务强化学习,提升图像生成和编辑能力。

- UniPic2-SD3.5M-Kontext在图像生成和编辑方面优于参数量更大的模型,并成功扩展到统一多模态框架。

📝 摘要(中文)

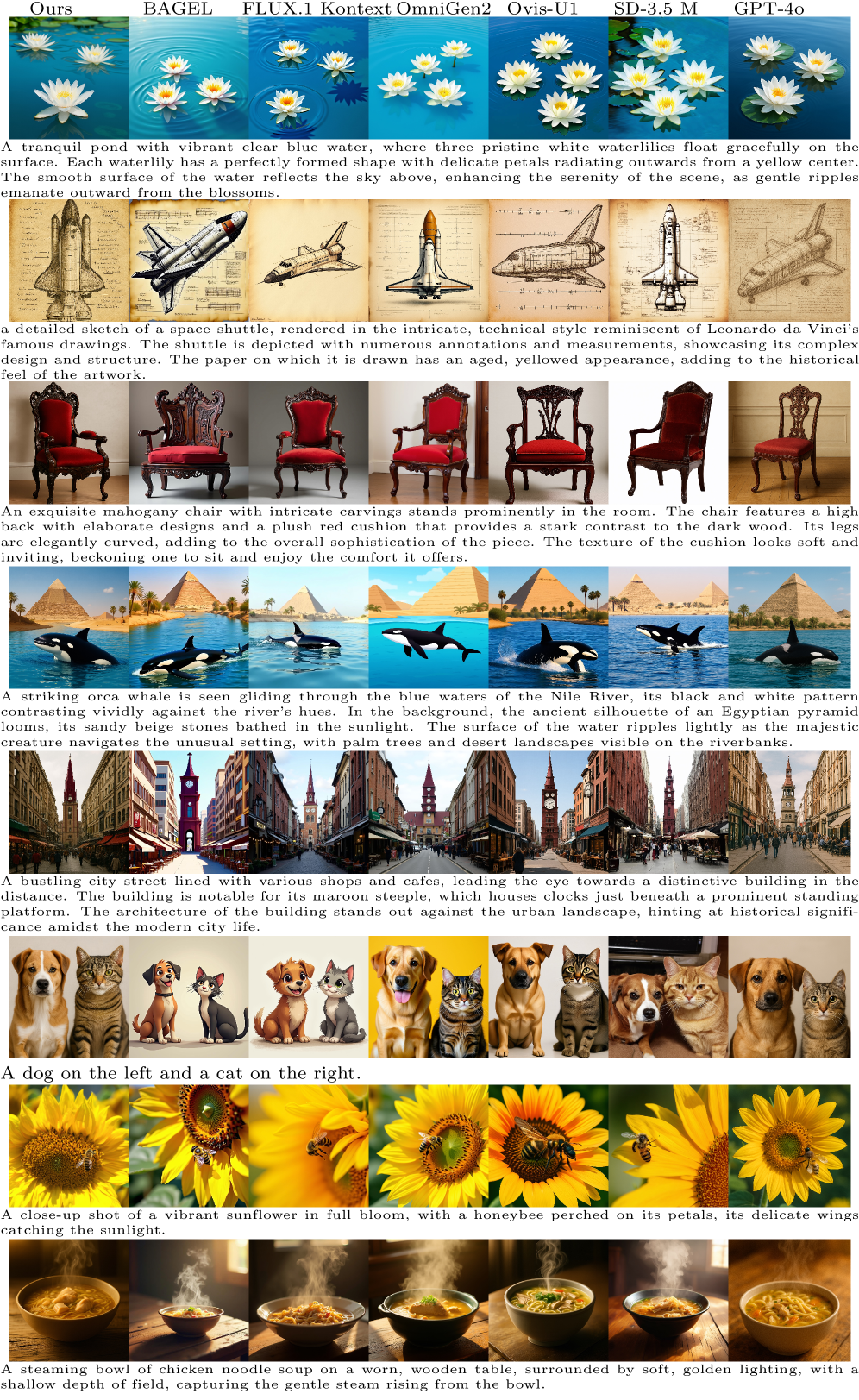

本文提出了UniPic2-SD3.5M-Kontext,一个基于SD3.5-Medium的20亿参数DiT模型,在图像生成和编辑方面达到了最先进的水平,并无缝扩展到统一的多模态框架中。该方法首先对SD3.5-Medium进行架构修改,并在高质量数据上进行大规模预训练,从而实现联合的文本到图像生成和编辑能力。为了增强指令遵循和编辑一致性,提出了一种新的渐进式双任务强化策略(PDTR),有效地分阶段加强两项任务。经验证表明,不同任务的强化阶段是互利的,不会引起负面干扰。经过预训练和强化策略后,UniPic2-SD3.5M-Kontext展示出比具有更大生成参数的模型(包括BAGEL (7B)和Flux-Kontext (12B))更强的图像生成和编辑能力。此外,遵循MetaQuery,通过连接器将UniPic2-SD3.5M-Kontext和Qwen2.5-VL-7B连接起来,并进行联合训练,推出了统一的多模态模型UniPic2-Metaquery。UniPic2-Metaquery集成了理解、生成和编辑,通过简单且可扩展的训练范式,在各种任务中实现了顶级的性能。这始终验证了所提出的训练范式的有效性和泛化性,并将其形式化为Skywork UniPic 2.0。

🔬 方法详解

问题定义:现有开源多模态模型通常优先考虑模型参数的规模,而忽略了训练策略的优化。这导致模型在效率和性能上存在瓶颈,难以在有限的计算资源下实现高质量的图像生成和编辑,尤其是在指令遵循和编辑一致性方面表现不足。

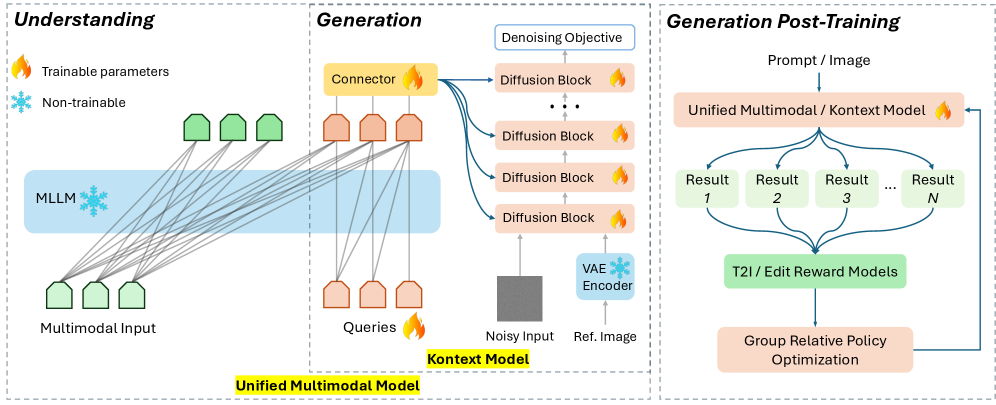

核心思路:UniPic 2.0的核心思路是通过优化训练策略,而非单纯增加模型参数,来提升多模态模型的性能。具体而言,它采用了渐进式双任务强化学习(PDTR)策略,分阶段地增强模型在文本到图像生成和编辑任务中的能力。这种方法旨在解决模型在指令遵循和编辑一致性方面的不足,同时避免不同任务之间的负面干扰。

技术框架:UniPic 2.0的技术框架主要包含以下几个阶段:1) 基于SD3.5-Medium进行架构修改,使其能够支持联合的文本到图像生成和编辑;2) 在高质量数据集上进行大规模预训练,为模型提供丰富的知识和能力;3) 采用PDTR策略进行强化学习,分阶段地提升模型在生成和编辑任务中的性能;4) 通过MetaQuery连接器将UniPic2-SD3.5M-Kontext和Qwen2.5-VL-7B连接起来,进行联合训练,构建统一的多模态模型UniPic2-Metaquery。

关键创新:UniPic 2.0最重要的技术创新点在于提出的渐进式双任务强化学习(PDTR)策略。PDTR通过分阶段地对生成和编辑任务进行强化学习,避免了不同任务之间的负面干扰,并实现了互利的提升效果。这种方法不同于传统的单任务强化学习或简单的多任务联合训练,能够更有效地提升模型在复杂多模态任务中的性能。

关键设计:PDTR策略的关键设计在于其渐进式的训练方式。它首先对一个任务进行强化学习,使其达到一定的性能水平,然后再对另一个任务进行强化学习。这种分阶段的训练方式可以避免两个任务之间的梯度冲突,并允许模型更好地学习每个任务的特定特征。此外,PDTR还采用了双任务的奖励函数,鼓励模型在生成和编辑任务中都表现出色。具体的参数设置和损失函数细节在论文中可能有所描述,但摘要中未明确提及。

🖼️ 关键图片

📊 实验亮点

UniPic2-SD3.5M-Kontext在图像生成和编辑方面优于参数量更大的模型,例如BAGEL (7B)和Flux-Kontext (12B)。UniPic2-Metaquery通过简单的训练范式,在各种多模态任务中实现了顶级的性能,验证了所提出的训练范式的有效性和泛化性。这些实验结果表明,优化训练策略比单纯增加模型参数更能有效地提升多模态模型的性能。

🎯 应用场景

UniPic 2.0在图像生成、图像编辑、多模态对话等领域具有广泛的应用前景。它可以用于创意设计、内容生成、虚拟现实、教育娱乐等多个行业,为用户提供更智能、更便捷的多模态交互体验。该研究的成果有助于推动多模态人工智能技术的发展,并为未来的智能应用提供更强大的技术支持。

📄 摘要(原文)

Recent advances in multimodal models have demonstrated impressive capabilities in unified image generation and editing. However, many prominent open-source models prioritize scaling model parameters over optimizing training strategies, limiting their efficiency and performance. In this work, we present UniPic2-SD3.5M-Kontext, a 2B-parameter DiT model based on SD3.5-Medium, which achieves state-of-the-art image generation and editing while extending seamlessly into a unified multimodal framework. Our approach begins with architectural modifications to SD3.5-Medium and large-scale pre-training on high-quality data, enabling joint text-to-image generation and editing capabilities. To enhance instruction following and editing consistency, we propose a novel Progressive Dual-Task Reinforcement strategy (PDTR), which effectively strengthens both tasks in a staged manner. We empirically validate that the reinforcement phases for different tasks are mutually beneficial and do not induce negative interference. After pre-training and reinforcement strategies, UniPic2-SD3.5M-Kontext demonstrates stronger image generation and editing capabilities than models with significantly larger generation parameters-including BAGEL (7B) and Flux-Kontext (12B). Furthermore, following the MetaQuery, we connect the UniPic2-SD3.5M-Kontext and Qwen2.5-VL-7B via a connector and perform joint training to launch a unified multimodal model UniPic2-Metaquery. UniPic2-Metaquery integrates understanding, generation, and editing, achieving top-tier performance across diverse tasks with a simple and scalable training paradigm. This consistently validates the effectiveness and generalizability of our proposed training paradigm, which we formalize as Skywork UniPic 2.0.