SSGaussian: Semantic-Aware and Structure-Preserving 3D Style Transfer

作者: Jimin Xu, Bosheng Qin, Tao Jin, Zhou Zhao, Zhenhui Ye, Jun Yu, Fei Wu

分类: cs.CV, cs.AI

发布日期: 2025-09-04

🔗 代码/项目: PROJECT_PAGE

💡 一句话要点

提出SSGaussian,通过语义感知和结构保持实现3D风格迁移

🎯 匹配领域: 支柱三:空间感知与语义 (Perception & Semantics)

关键词: 3D风格迁移 神经渲染 扩散模型 跨视角注意力 实例级风格迁移

📋 核心要点

- 现有3D风格迁移方法难以提取和迁移高层风格语义,且风格化结果缺乏结构清晰度,难以区分不同实例。

- SSGaussian利用预训练2D扩散模型的先验知识,通过跨视角风格对齐和实例级风格迁移,实现语义感知和结构保持的风格迁移。

- 实验结果表明,SSGaussian在各种场景中显著优于现有方法,尤其是在保持结构和语义一致性方面。

📝 摘要(中文)

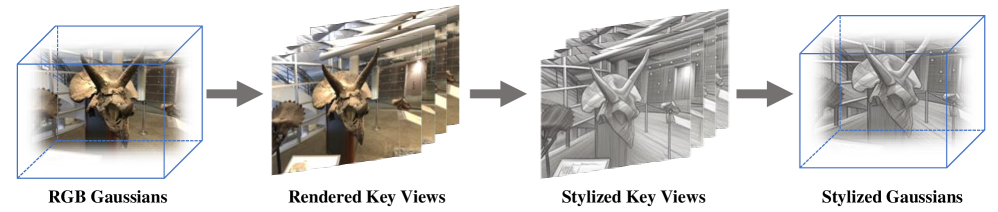

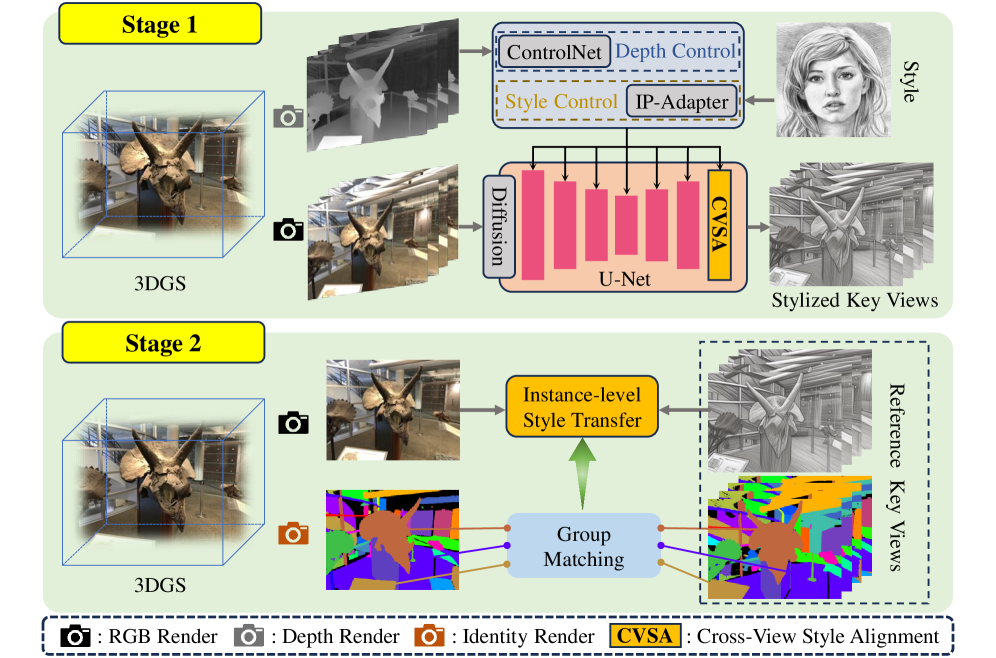

本文提出了一种新颖的3D风格迁移流程,旨在有效整合预训练2D扩散模型的先验知识。现有方法虽然能将风格模式迁移到3D一致的神经表示上,但难以有效提取和迁移参考风格图像中的高层风格语义,且风格化结果通常缺乏结构清晰度和分离度,难以区分3D场景中的不同实例或对象。该流程包含两个关键阶段:首先,利用扩散先验生成关键视角的风格化渲染图;然后,将风格化的关键视图迁移到3D表示上。该流程包含两个创新设计:跨视角风格对齐,通过在UNet的最后一个上采样块中插入跨视角注意力,实现多个关键视图之间的特征交互,确保扩散模型生成既保持风格保真度又保持实例级一致性的风格化关键视图;实例级风格迁移,有效利用风格化关键视图之间的实例级一致性,并将其迁移到3D表示上,从而产生更结构化、视觉连贯且具有艺术丰富性的风格化结果。大量定性和定量实验表明,该3D风格迁移流程在各种场景(从前向场景到具有挑战性的360度环境)中,显著优于最先进的方法。

🔬 方法详解

问题定义:现有3D风格迁移方法在提取和迁移高层风格语义方面存在困难,导致风格化结果缺乏结构清晰度和实例间的区分度。这些方法难以有效地将参考图像的风格语义融入到3D场景中,并且容易产生模糊或不自然的风格化效果。

核心思路:SSGaussian的核心思路是利用预训练的2D扩散模型作为先验知识,指导3D风格迁移过程。通过首先在2D关键视图上进行风格化,然后将这些风格化的视图投影到3D空间中,从而实现风格迁移。这种方法能够更好地利用2D扩散模型强大的风格生成能力,同时保持3D场景的结构一致性。

技术框架:SSGaussian的整体框架包含两个主要阶段:1) 风格化关键视图生成:利用预训练的2D扩散模型,对从3D场景中选取的关键视角进行风格化渲染。该阶段的关键在于跨视角风格对齐,以保证不同视角风格化结果的一致性。2) 风格迁移到3D表示:将风格化的关键视图信息迁移到3D Gaussian Splatting表示上,从而实现3D场景的风格化。该阶段的关键在于实例级风格迁移,以保证不同实例的风格一致性。

关键创新:SSGaussian的关键创新在于两个方面:一是跨视角风格对齐,通过在扩散模型的UNet结构中引入跨视角注意力机制,使得不同关键视图之间可以进行特征交互,从而保证风格化结果的视角一致性。二是实例级风格迁移,通过利用风格化关键视图之间的实例级一致性,将其迁移到3D表示上,从而保证3D场景中不同实例的风格一致性。

关键设计:在跨视角风格对齐方面,SSGaussian在UNet的最后一个上采样块中插入了跨视角注意力模块,该模块允许不同关键视图的特征进行交互,从而保证风格的一致性。在实例级风格迁移方面,SSGaussian利用了实例分割信息,将风格化的关键视图信息按照实例进行聚合,然后将其迁移到3D Gaussian Splatting表示上。具体的损失函数设计未知,但推测会包含风格损失、内容损失以及正则化项。

🖼️ 关键图片

📊 实验亮点

实验结果表明,SSGaussian在各种场景下均优于现有方法。定性结果显示,SSGaussian能够生成更具结构清晰度和语义一致性的风格化3D场景。定量结果未知,但摘要强调了其在各种场景(包括具有挑战性的360度环境)中的优越性,暗示了显著的性能提升。

🎯 应用场景

SSGaussian可应用于游戏、电影、广告等领域,实现3D场景的快速风格化,例如将照片风格迁移到3D模型上,或将3D场景渲染成特定艺术风格。该技术还可用于虚拟现实和增强现实应用,提升用户体验,创造更具艺术性和个性化的内容。未来,该技术有望扩展到动态3D场景的风格迁移,实现更复杂的视觉效果。

📄 摘要(原文)

Recent advancements in neural representations, such as Neural Radiance Fields and 3D Gaussian Splatting, have increased interest in applying style transfer to 3D scenes. While existing methods can transfer style patterns onto 3D-consistent neural representations, they struggle to effectively extract and transfer high-level style semantics from the reference style image. Additionally, the stylized results often lack structural clarity and separation, making it difficult to distinguish between different instances or objects within the 3D scene. To address these limitations, we propose a novel 3D style transfer pipeline that effectively integrates prior knowledge from pretrained 2D diffusion models. Our pipeline consists of two key stages: First, we leverage diffusion priors to generate stylized renderings of key viewpoints. Then, we transfer the stylized key views onto the 3D representation. This process incorporates two innovative designs. The first is cross-view style alignment, which inserts cross-view attention into the last upsampling block of the UNet, allowing feature interactions across multiple key views. This ensures that the diffusion model generates stylized key views that maintain both style fidelity and instance-level consistency. The second is instance-level style transfer, which effectively leverages instance-level consistency across stylized key views and transfers it onto the 3D representation. This results in a more structured, visually coherent, and artistically enriched stylization. Extensive qualitative and quantitative experiments demonstrate that our 3D style transfer pipeline significantly outperforms state-of-the-art methods across a wide range of scenes, from forward-facing to challenging 360-degree environments. Visit our project page https://jm-xu.github.io/SSGaussian for immersive visualization.