DVS-PedX: Synthetic-and-Real Event-Based Pedestrian Dataset

作者: Mustafa Sakhai, Kaung Sithu, Min Khant Soe Oke, Maciej Wielgosz

分类: cs.CV

发布日期: 2025-09-04

备注: 12 pages, 8 figures, 3 tables; dataset descriptor paper introducing DVS-PedX (synthetic-and-real event-based pedestrian dataset with baselines) External URL: https://doi.org/10.5281/zenodo.17030898

💡 一句话要点

DVS-PedX:用于事件相机行人检测与意图分析的合成与真实数据集

🎯 匹配领域: 支柱一:机器人控制 (Robot Control) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 事件相机 行人检测 意图分析 神经形态 合成数据

📋 核心要点

- 现有行人检测方法在低延迟、高动态范围和运动鲁棒性方面存在挑战,事件相机技术为此提供了新的解决方案。

- DVS-PedX数据集通过合成数据和真实数据结合的方式,为事件相机在行人检测和意图分析方面的研究提供了支持。

- 基线SNN实验揭示了合成数据与真实数据之间的差距,突出了领域自适应和多模态融合的重要性。

📝 摘要(中文)

DVS-PedX(动态视觉传感器行人探索)是一个神经形态数据集,专为行人检测和横穿意图分析而设计,适用于正常和恶劣天气条件。该数据集包含两个互补来源:(1)在CARLA模拟器中生成的合成事件流,用于模拟不同天气和光照下的受控“接近-横穿”场景;(2)使用v2e工具将真实世界的JAAD行车记录仪视频转换为事件流,保留了自然行为和背景。每个序列包括配对的RGB帧、逐帧DVS“事件帧”(33毫秒累积)和帧级标签(横穿 vs. 不横穿)。此外,还提供了原始AEDAT 2.0/AEDAT 4.0事件文件和AVI DVS视频文件以及元数据,以便灵活地重新处理。使用SpikingJelly的基线脉冲神经网络(SNN)验证了数据集的可用性,并揭示了模拟到真实的差距,从而激发了领域自适应和多模态融合的研究。DVS-PedX旨在加速基于事件的行人安全、意图预测和神经形态感知领域的研究。

🔬 方法详解

问题定义:论文旨在解决基于事件相机的行人检测和横穿意图分析问题。现有方法在恶劣天气、光照变化和快速运动等场景下表现不佳,并且缺乏大规模的事件相机行人数据集,限制了相关算法的开发和评估。

核心思路:论文的核心思路是构建一个包含合成数据和真实数据的混合数据集,以弥补真实事件相机数据稀缺的问题。合成数据可以提供大量的标注数据,而真实数据可以保证模型的泛化能力。通过领域自适应等技术,可以缩小合成数据和真实数据之间的差距。

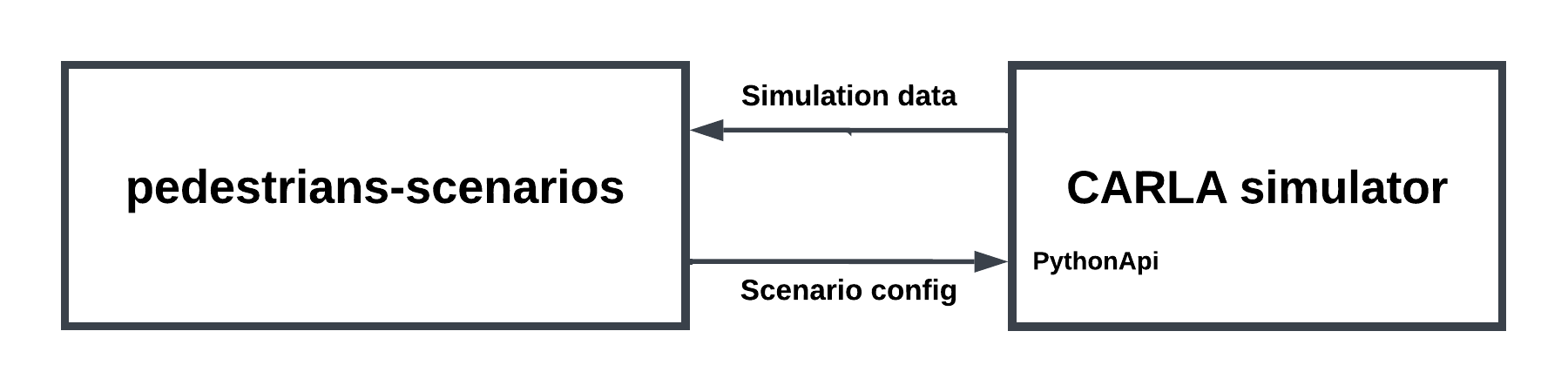

技术框架:DVS-PedX数据集的构建流程包括以下几个主要步骤:1) 使用CARLA模拟器生成合成事件流,模拟不同天气和光照条件下的行人接近和横穿场景。2) 使用v2e工具将真实世界的JAAD行车记录仪视频转换为事件流。3) 对合成数据和真实数据进行标注,包括行人边界框和横穿意图标签。4) 提供原始AEDAT事件文件、DVS视频文件和元数据,方便用户进行灵活的数据处理和算法开发。

关键创新:该论文的关键创新在于构建了一个大规模的、包含合成数据和真实数据的事件相机行人数据集。该数据集不仅提供了丰富的标注信息,还提供了多种数据格式,方便用户进行算法开发和评估。此外,该论文还通过基线SNN实验揭示了合成数据和真实数据之间的差距,为领域自适应研究提供了方向。

关键设计:合成数据生成方面,CARLA模拟器被用于创建各种天气和光照条件,并模拟行人的不同行为模式。真实数据转换方面,v2e工具被用于将RGB视频转换为事件流,并尽可能保留原始视频中的信息。数据集的标注包括行人边界框和横穿意图标签,这些标签可以用于训练和评估行人检测和意图分析算法。基线SNN模型使用SpikingJelly框架实现,并采用标准的脉冲神经网络结构。

🖼️ 关键图片

📊 实验亮点

论文通过在DVS-PedX数据集上进行基线SNN实验,验证了数据集的可用性。实验结果表明,SNN模型在合成数据上表现良好,但在真实数据上性能下降,揭示了模拟到真实的差距。这一发现强调了领域自适应技术在事件相机数据处理中的重要性,并为未来的研究方向提供了指导。

🎯 应用场景

DVS-PedX数据集可广泛应用于自动驾驶、智能监控、机器人导航等领域。通过利用事件相机的低延迟、高动态范围和运动鲁棒性,可以提高这些系统在复杂环境下的感知能力,从而提升安全性、可靠性和效率。该数据集的发布将促进基于事件相机的行人安全和意图预测技术的发展。

📄 摘要(原文)

Event cameras like Dynamic Vision Sensors (DVS) report micro-timed brightness changes instead of full frames, offering low latency, high dynamic range, and motion robustness. DVS-PedX (Dynamic Vision Sensor Pedestrian eXploration) is a neuromorphic dataset designed for pedestrian detection and crossing-intention analysis in normal and adverse weather conditions across two complementary sources: (1) synthetic event streams generated in the CARLA simulator for controlled "approach-cross" scenes under varied weather and lighting; and (2) real-world JAAD dash-cam videos converted to event streams using the v2e tool, preserving natural behaviors and backgrounds. Each sequence includes paired RGB frames, per-frame DVS "event frames" (33 ms accumulations), and frame-level labels (crossing vs. not crossing). We also provide raw AEDAT 2.0/AEDAT 4.0 event files and AVI DVS video files and metadata for flexible re-processing. Baseline spiking neural networks (SNNs) using SpikingJelly illustrate dataset usability and reveal a sim-to-real gap, motivating domain adaptation and multimodal fusion. DVS-PedX aims to accelerate research in event-based pedestrian safety, intention prediction, and neuromorphic perception.