LayoutGKN: Graph Similarity Learning of Floor Plans

作者: Casper van Engelenburg, Jan van Gemert, Seyran Khademi

分类: cs.CV

发布日期: 2025-09-03

备注: BMVC (2025)

🔗 代码/项目: GITHUB

💡 一句话要点

LayoutGKN:提出一种高效的楼层平面图图相似性学习方法

🎯 匹配领域: 支柱七:动作重定向 (Motion Retargeting)

关键词: 图神经网络 图相似性学习 楼层平面图 图核 建筑信息模型

📋 核心要点

- 现有图匹配网络在楼层平面图相似性比较中计算成本高昂,推理速度慢。

- LayoutGKN通过延迟跨图节点级交互,并使用可微图核来提高效率。

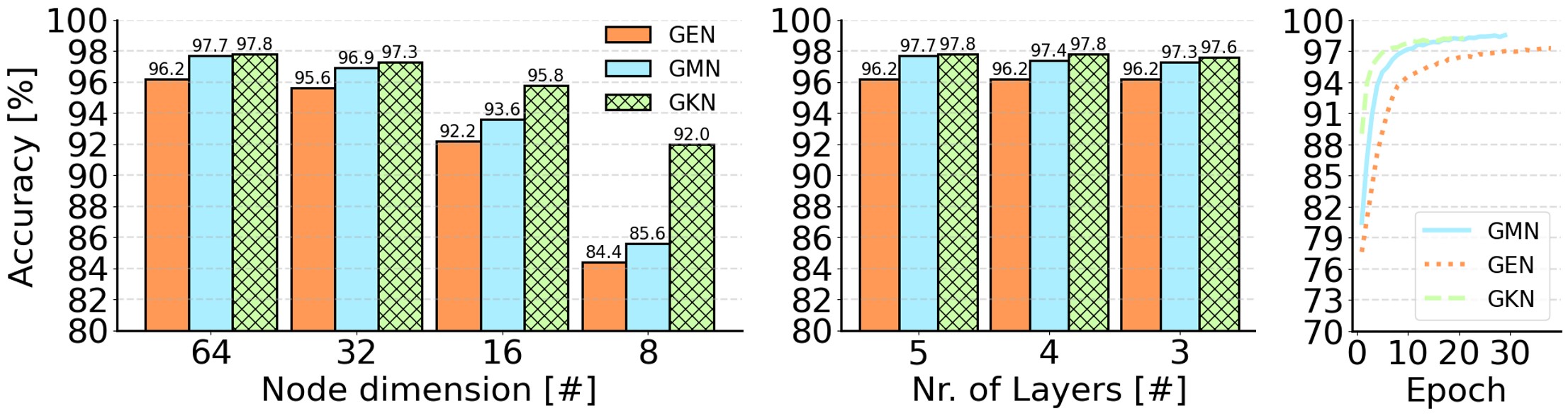

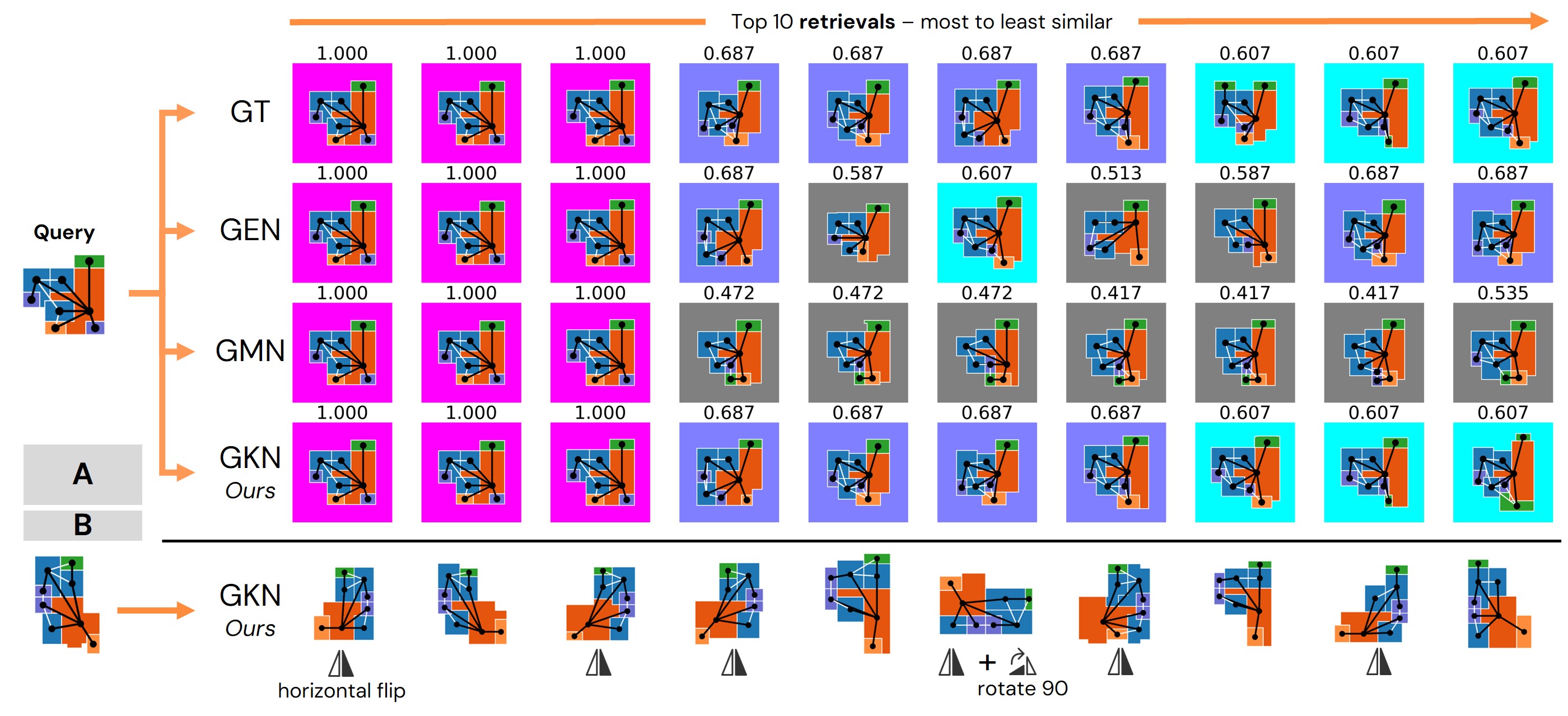

- 实验表明,LayoutGKN在相似性比较方面与图匹配网络相当或更好,同时显著提高了速度。

📝 摘要(中文)

楼层平面图描绘了建筑布局,通常表示为图以捕捉潜在的空间关系。比较这些图对于搜索、聚类和数据可视化等应用至关重要。目前最成功的图比较方法,即图匹配网络,依赖于代价高昂的中间跨图节点级交互,因此在推理时间上较慢。我们引入了LayoutGKN,这是一种更有效的方法,它将跨图节点级交互推迟到联合嵌入架构的末尾。我们通过使用可微图核作为最终学习的节点级嵌入上的距离函数来实现这一点。我们表明,LayoutGKN在显著提高速度的同时,计算出的相似度与图匹配网络相当或更好。代码和数据已开源。

🔬 方法详解

问题定义:论文旨在解决楼层平面图的图相似性比较问题。现有图匹配网络(GMN)方法在计算节点之间的跨图交互时,计算复杂度高,推理速度慢,难以满足实际应用的需求。

核心思路:LayoutGKN的核心思路是延迟跨图节点级交互,将节点嵌入学习和图相似性度量解耦。具体来说,先独立学习每个图的节点嵌入,然后在嵌入空间中使用可微图核函数来计算图之间的相似度。这样可以避免在早期进行昂贵的跨图节点匹配。

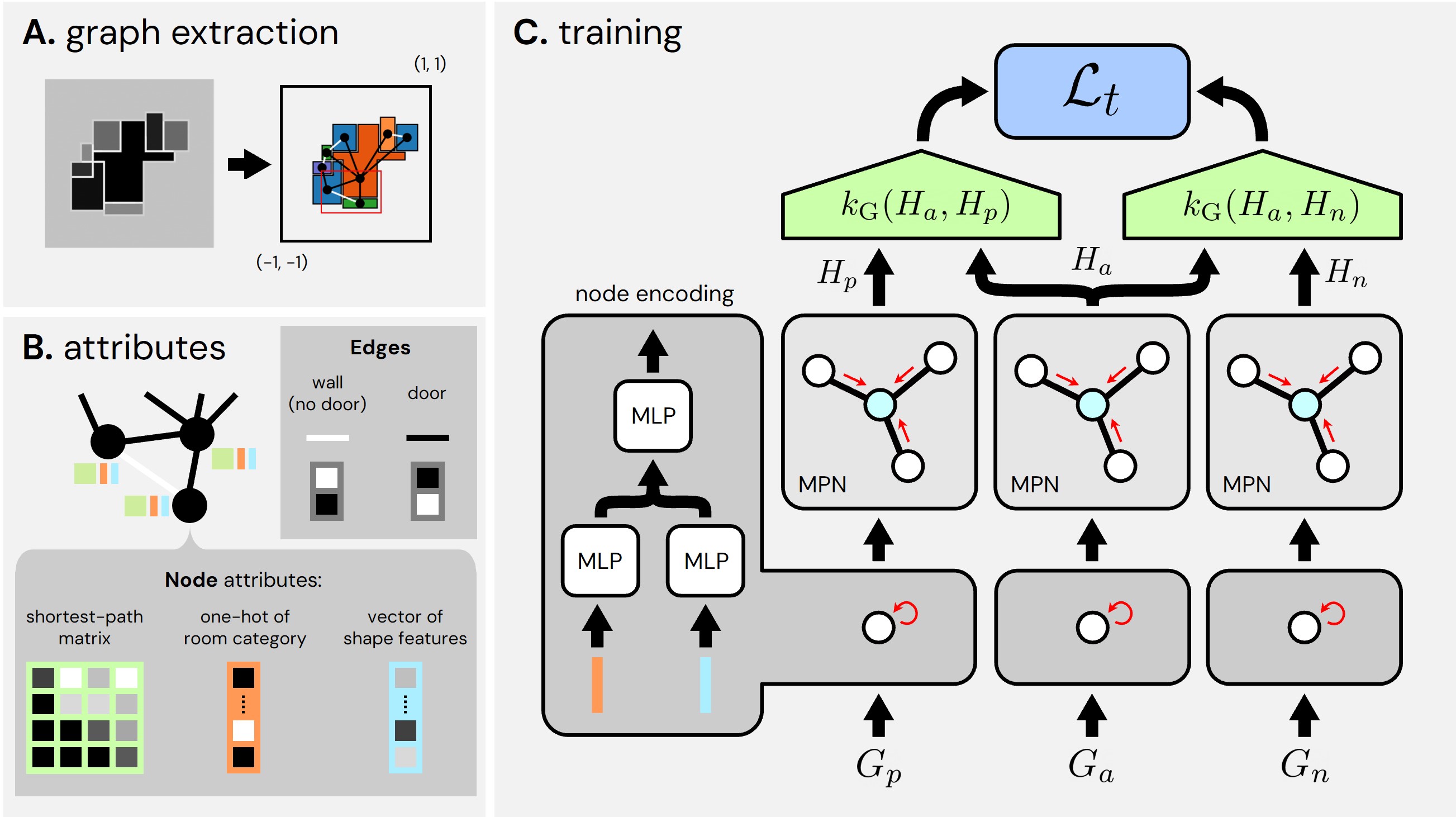

技术框架:LayoutGKN的整体框架包括以下几个主要步骤:1) 图表示:将楼层平面图表示为图结构,节点代表房间,边代表房间之间的连接关系。2) 节点嵌入:使用图神经网络(GNN)学习每个图中节点的嵌入表示。3) 图核计算:使用可微图核函数,例如高斯核或拉普拉斯核,计算两个图的节点嵌入之间的相似度矩阵。4) 相似度聚合:将相似度矩阵聚合为一个标量值,作为两个图的相似度得分。

关键创新:LayoutGKN的关键创新在于将跨图节点级交互延迟到节点嵌入学习之后,并使用可微图核函数来度量图之间的相似度。这种方法避免了在早期进行昂贵的跨图节点匹配,从而显著提高了计算效率。与传统的图匹配网络相比,LayoutGKN在保证相似性比较精度的同时,大大降低了推理时间。

关键设计:在节点嵌入阶段,可以使用各种图神经网络,例如GCN、GAT等。图核函数的选择也很重要,不同的核函数可能适用于不同的数据集。论文中可能使用了特定的损失函数来优化节点嵌入和图核函数的参数,例如对比损失或三元组损失。具体的网络结构和参数设置需要在论文中查找。

🖼️ 关键图片

📊 实验亮点

论文提出的LayoutGKN方法在楼层平面图相似性比较任务上取得了显著的性能提升。实验结果表明,LayoutGKN在保持与图匹配网络相当的相似性比较精度的同时,推理速度提高了多个数量级。具体的性能数据和对比基线需要在论文中查找。

🎯 应用场景

LayoutGKN可应用于建筑信息模型(BIM)的检索、聚类和可视化。例如,可以根据楼层平面图的相似性对建筑物进行分类,或者在数据库中搜索与给定平面图相似的建筑设计。此外,该方法还可以用于室内导航、机器人路径规划等领域,具有广泛的应用前景。

📄 摘要(原文)

Floor plans depict building layouts and are often represented as graphs to capture the underlying spatial relationships. Comparison of these graphs is critical for applications like search, clustering, and data visualization. The most successful methods to compare graphs \ie, graph matching networks, rely on costly intermediate cross-graph node-level interactions, therefore being slow in inference time. We introduce \textbf{LayoutGKN}, a more efficient approach that postpones the cross-graph node-level interactions to the end of the joint embedding architecture. We do so by using a differentiable graph kernel as a distance function on the final learned node-level embeddings. We show that LayoutGKN computes similarity comparably or better than graph matching networks while significantly increasing the speed. \href{https://github.com/caspervanengelenburg/LayoutGKN}{Code and data} are open.