Multi Attribute Bias Mitigation via Representation Learning

作者: Rajeev Ranjan Dwivedi, Ankur Kumar, Vinod K Kurmi

分类: cs.CV

发布日期: 2025-09-03

备注: ECAI 2025 (28th European Conference on Artificial Intelligence)

🔗 代码/项目: PROJECT_PAGE

💡 一句话要点

提出GMBM框架,通过表征学习缓解视觉模型中的多重属性偏见问题

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture)

关键词: 多属性偏见缓解 表征学习 公平性 鲁棒性 视觉识别 梯度抑制 自适应学习

📋 核心要点

- 现有视觉模型易受多种重叠偏见影响,单独缓解效果不佳,甚至可能加剧其他偏见。

- GMBM框架通过自适应学习和梯度抑制,使模型先识别偏见,再忽略偏见,从而缓解多重偏见。

- 实验表明,GMBM在多个数据集上提升了最差组准确率,降低了偏见放大,并提出了新的偏见度量指标SBA。

📝 摘要(中文)

真实世界的图像通常表现出多种重叠的偏见,包括纹理、水印、性别化的妆容、场景对象配对等。这些偏见共同损害了现代视觉模型的性能,削弱了它们的鲁棒性和公平性。单独解决这些偏见是不够的,因为减轻一种偏见通常会允许或加剧其他偏见。本文提出了广义多偏见缓解(GMBM),这是一个精简的两阶段框架,仅在训练时需要组标签,并在测试时最小化偏见。首先,自适应偏见集成学习(ABIL)通过训练每个属性的编码器并将其与主干网络集成,有意识地识别已知捷径的影响,迫使分类器明确识别这些偏见。然后,梯度抑制微调从主干网络的梯度中修剪掉这些偏见方向,留下一个忽略所有刚刚学会识别的捷径的紧凑网络。此外,本文发现现有的偏见指标在子组不平衡以及训练测试分布偏移下会失效,因此引入了缩放偏见放大(SBA):一种测试时度量,可将模型引起的偏见放大与分布差异分开。在FB CMNIST、CelebA和COCO上验证了GMBM,即使偏见复杂性和分布偏移加剧,也能提高最差组的准确率,将多属性偏见放大减半,并在SBA中创下新低,使GMBM成为第一个实用的端到端视觉识别多偏见解决方案。

🔬 方法详解

问题定义:论文旨在解决视觉模型中普遍存在的多重属性偏见问题。现有方法通常针对单一偏见进行缓解,但忽略了现实世界中偏见相互关联、相互影响的复杂性。简单地消除一种偏见可能会导致模型更加依赖其他偏见,甚至加剧其影响。此外,现有的偏见度量指标在面对子群体不平衡和训练/测试分布差异时表现不佳,难以准确评估模型的偏见程度。

核心思路:GMBM的核心思路是让模型首先显式地学习并识别各种偏见,然后再通过梯度抑制的方式,使模型在推理过程中忽略这些偏见。这种“先学习,后忽略”的策略能够有效地避免模型在消除一种偏见时,过度依赖其他偏见。同时,论文还提出了新的偏见度量指标SBA,以更准确地评估模型在复杂场景下的偏见程度。

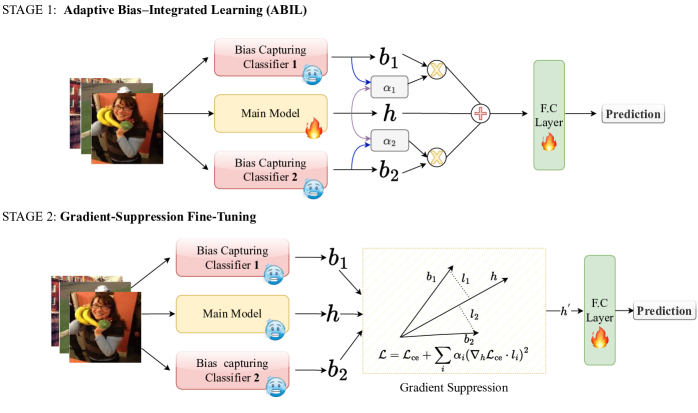

技术框架:GMBM框架包含两个主要阶段:自适应偏见集成学习(ABIL)和梯度抑制微调。在ABIL阶段,针对每个属性训练一个编码器,并将其与主干网络集成,迫使分类器学习识别这些偏见。在梯度抑制微调阶段,从主干网络的梯度中移除与偏见相关的方向,从而使模型忽略这些偏见。整个框架是一个端到端的训练流程,可以在训练过程中自动学习和缓解多重偏见。

关键创新:GMBM的关键创新在于其“先学习,后忽略”的偏见缓解策略,以及提出的新的偏见度量指标SBA。与现有方法相比,GMBM能够更有效地处理多重属性偏见问题,并且能够更准确地评估模型的偏见程度。SBA指标考虑了子群体不平衡和分布偏移的影响,能够更全面地反映模型的公平性。

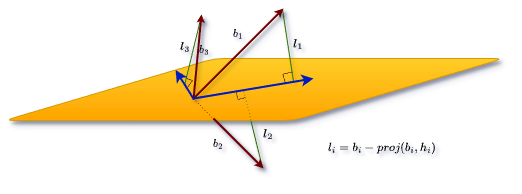

关键设计:ABIL阶段的关键设计在于如何有效地集成各个属性的编码器。论文采用了一种自适应的方式,根据每个属性的重要性动态地调整其在主干网络中的权重。梯度抑制微调阶段的关键设计在于如何准确地识别并移除与偏见相关的梯度方向。论文采用了一种基于梯度分解的方法,将梯度分解为与偏见相关的分量和与偏见无关的分量,然后只保留与偏见无关的分量。

🖼️ 关键图片

📊 实验亮点

实验结果表明,GMBM在FB CMNIST、CelebA和COCO数据集上均取得了显著的性能提升。在CelebA数据集上,GMBM将最差组的准确率提高了5%以上,并将多属性偏见放大减半。此外,GMBM在SBA指标上创下了新低,表明其能够有效地缓解模型中的偏见。这些结果表明,GMBM是第一个实用的端到端视觉识别多偏见解决方案。

🎯 应用场景

GMBM框架可应用于各种视觉识别任务,尤其是在公平性和鲁棒性要求较高的场景中,例如人脸识别、图像搜索、目标检测等。通过缓解模型中的多重属性偏见,可以提高模型在不同人群和场景下的泛化能力,避免歧视性结果,并提升用户体验。该研究对于推动人工智能技术的公平性和可靠性具有重要意义。

📄 摘要(原文)

Real world images frequently exhibit multiple overlapping biases, including textures, watermarks, gendered makeup, scene object pairings, etc. These biases collectively impair the performance of modern vision models, undermining both their robustness and fairness. Addressing these biases individually proves inadequate, as mitigating one bias often permits or intensifies others. We tackle this multi bias problem with Generalized Multi Bias Mitigation (GMBM), a lean two stage framework that needs group labels only while training and minimizes bias at test time. First, Adaptive Bias Integrated Learning (ABIL) deliberately identifies the influence of known shortcuts by training encoders for each attribute and integrating them with the main backbone, compelling the classifier to explicitly recognize these biases. Then Gradient Suppression Fine Tuning prunes those very bias directions from the backbone's gradients, leaving a single compact network that ignores all the shortcuts it just learned to recognize. Moreover we find that existing bias metrics break under subgroup imbalance and train test distribution shifts, so we introduce Scaled Bias Amplification (SBA): a test time measure that disentangles model induced bias amplification from distributional differences. We validate GMBM on FB CMNIST, CelebA, and COCO, where we boost worst group accuracy, halve multi attribute bias amplification, and set a new low in SBA even as bias complexity and distribution shifts intensify, making GMBM the first practical, end to end multibias solution for visual recognition. Project page: http://visdomlab.github.io/GMBM/