RTGMFF: Enhanced fMRI-based Brain Disorder Diagnosis via ROI-driven Text Generation and Multimodal Feature Fusion

作者: Junhao Jia, Yifei Sun, Yunyou Liu, Cheng Yang, Changmiao Wang, Feiwei Qin, Yong Peng, Wenwen Min

分类: cs.CV

发布日期: 2025-09-03

🔗 代码/项目: GITHUB

💡 一句话要点

RTGMFF:融合ROI文本生成与多模态特征,提升基于fMRI的脑部疾病诊断。

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: fMRI 脑部疾病诊断 多模态融合 文本生成 频率-空间编码

📋 核心要点

- 现有基于fMRI的脑部疾病诊断方法受限于fMRI信噪比低、个体差异大,且缺乏对频率信息的有效利用。

- RTGMFF通过ROI驱动的文本生成,将fMRI数据、年龄、性别等信息转化为文本标记,并结合多模态特征融合进行诊断。

- 在ADHD-200和ABIDE数据集上,RTGMFF显著提升了诊断准确率、灵敏度、特异性和ROC曲线下面积。

📝 摘要(中文)

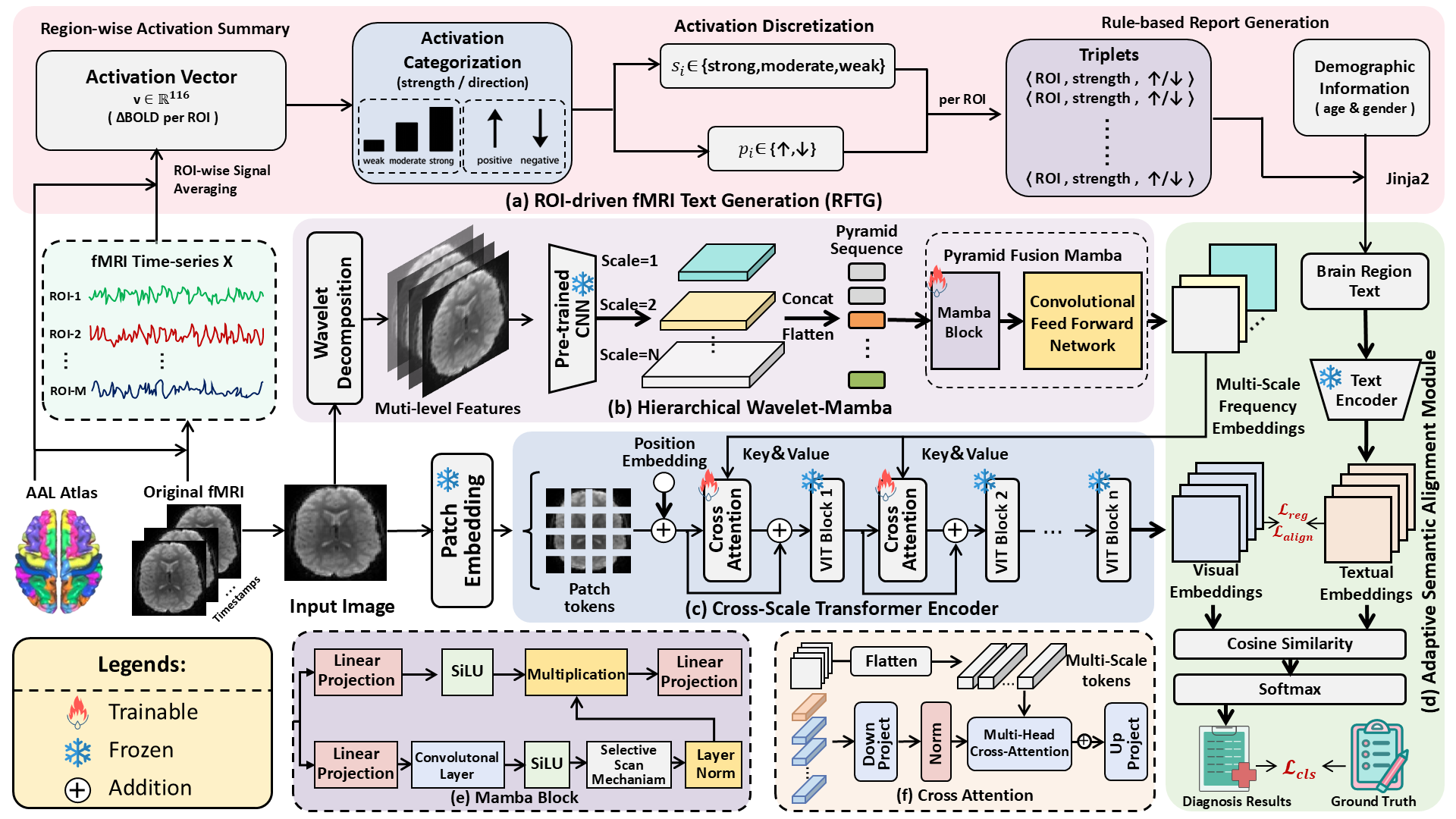

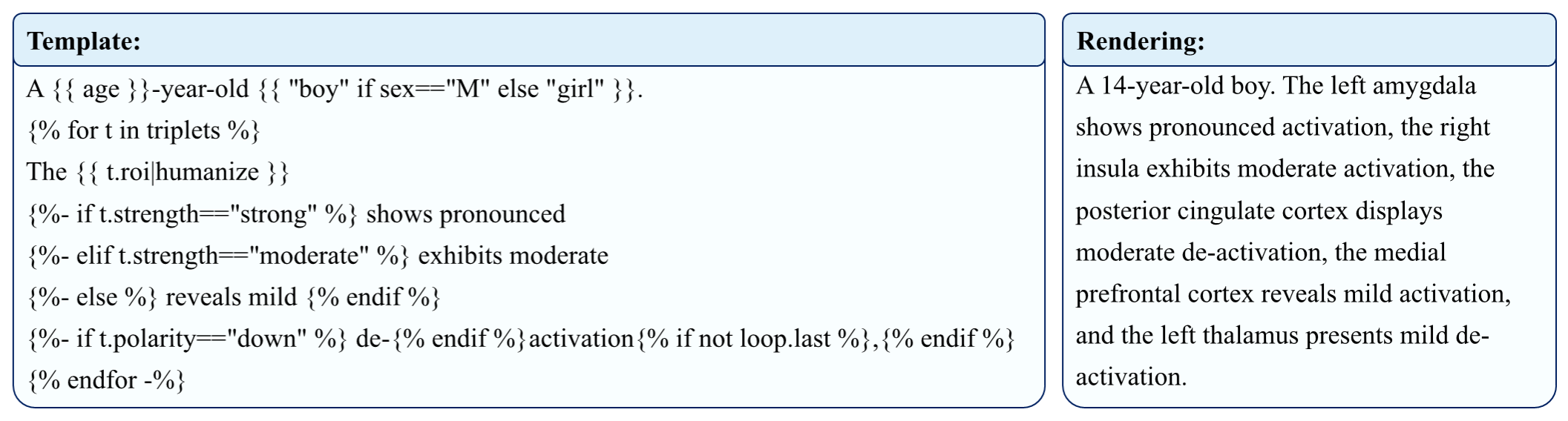

功能磁共振成像(fMRI)是研究大脑功能的强大工具,但由于信噪比低、个体差异大以及现有基于CNN和Transformer的模型对频率感知有限,可靠的临床诊断受到阻碍。此外,大多数fMRI数据集缺乏文本注释,无法提供区域激活和连接模式的背景信息。我们提出了RTGMFF,一个将自动ROI级别文本生成与多模态特征融合用于脑部疾病诊断的框架。RTGMFF包含三个组成部分:(i) ROI驱动的fMRI文本生成,确定性地将每个受试者的激活、连接、年龄和性别信息凝练成可复现的文本标记;(ii) 混合频率-空间编码器,融合了分层小波-Mamba分支与跨尺度Transformer编码器,以捕获频域结构以及长程空间依赖性;(iii) 自适应语义对齐模块,将ROI标记序列和视觉特征嵌入到共享空间中,使用正则化的余弦相似度损失来缩小模态差距。在ADHD-200和ABIDE基准上的大量实验表明,RTGMFF在诊断准确率方面超越了当前方法,在灵敏度、特异性和ROC曲线下面积方面取得了显著提升。

🔬 方法详解

问题定义:论文旨在解决基于fMRI的脑部疾病诊断问题。现有方法,特别是基于CNN和Transformer的模型,在处理fMRI数据时存在信噪比低、个体差异大、频率信息利用不足等问题。此外,缺乏文本注释使得模型难以理解区域激活和连接模式的上下文信息。

核心思路:论文的核心思路是将fMRI数据转化为文本信息,并结合多模态特征融合进行诊断。通过ROI驱动的文本生成,将fMRI激活、连接、年龄、性别等信息编码为文本标记,从而引入了上下文信息。同时,利用混合频率-空间编码器捕获fMRI数据的频率域和空间域特征,并通过自适应语义对齐模块缩小模态差距。

技术框架:RTGMFF框架包含三个主要模块:1) ROI驱动的fMRI文本生成模块,用于将fMRI数据转化为文本标记;2) 混合频率-空间编码器,包含分层小波-Mamba分支和跨尺度Transformer编码器,用于提取fMRI数据的频率域和空间域特征;3) 自适应语义对齐模块,用于将文本标记和视觉特征嵌入到共享空间中,并进行模态对齐。

关键创新:论文的关键创新在于:1) 提出了ROI驱动的fMRI文本生成方法,将fMRI数据转化为文本信息,从而引入了上下文信息;2) 设计了混合频率-空间编码器,能够同时捕获fMRI数据的频率域和空间域特征;3) 提出了自适应语义对齐模块,能够有效缩小文本和视觉特征之间的模态差距。与现有方法相比,RTGMFF能够更全面地利用fMRI数据的信息,从而提高诊断准确率。

关键设计:在ROI驱动的文本生成模块中,论文采用确定性的方法将fMRI激活、连接、年龄、性别等信息编码为文本标记,保证了可复现性。在混合频率-空间编码器中,分层小波变换用于提取fMRI数据的频率域特征,Mamba结构用于建模序列依赖关系,跨尺度Transformer编码器用于捕获长程空间依赖性。在自适应语义对齐模块中,论文使用正则化的余弦相似度损失来缩小模态差距,并采用自适应的方法调整对齐权重。

🖼️ 关键图片

📊 实验亮点

RTGMFF在ADHD-200和ABIDE数据集上取得了显著的性能提升。在ADHD-200数据集上,RTGMFF的诊断准确率、灵敏度、特异性和AUC均优于现有方法。例如,在ABIDE数据集上,RTGMFF相比于基线模型取得了显著的性能提升,证明了该方法的有效性。

🎯 应用场景

RTGMFF可应用于多种脑部疾病的辅助诊断,例如ADHD、自闭症等。该研究有助于提高诊断准确率,减少误诊率,并为个性化治疗方案的制定提供依据。未来,该方法可扩展到其他医学影像数据,并与其他临床信息相结合,实现更全面的疾病诊断。

📄 摘要(原文)

Functional magnetic resonance imaging (fMRI) is a powerful tool for probing brain function, yet reliable clinical diagnosis is hampered by low signal-to-noise ratios, inter-subject variability, and the limited frequency awareness of prevailing CNN- and Transformer-based models. Moreover, most fMRI datasets lack textual annotations that could contextualize regional activation and connectivity patterns. We introduce RTGMFF, a framework that unifies automatic ROI-level text generation with multimodal feature fusion for brain-disorder diagnosis. RTGMFF consists of three components: (i) ROI-driven fMRI text generation deterministically condenses each subject's activation, connectivity, age, and sex into reproducible text tokens; (ii) Hybrid frequency-spatial encoder fuses a hierarchical wavelet-mamba branch with a cross-scale Transformer encoder to capture frequency-domain structure alongside long-range spatial dependencies; and (iii) Adaptive semantic alignment module embeds the ROI token sequence and visual features in a shared space, using a regularized cosine-similarity loss to narrow the modality gap. Extensive experiments on the ADHD-200 and ABIDE benchmarks show that RTGMFF surpasses current methods in diagnostic accuracy, achieving notable gains in sensitivity, specificity, and area under the ROC curve. Code is available at https://github.com/BeistMedAI/RTGMFF.