SYNBUILD-3D: A large, multi-modal, and semantically rich synthetic dataset of 3D building models at Level of Detail 4

作者: Kevin Mayer, Alex Vesel, Xinyi Zhao, Martin Fischer

分类: cs.CV

发布日期: 2025-08-28

DOI: 10.25740/kz908vb7844

🔗 代码/项目: GITHUB

💡 一句话要点

SYNBUILD-3D:一个大规模、多模态、语义丰富的LoD4级别3D建筑模型合成数据集。

🎯 匹配领域: 支柱七:动作重定向 (Motion Retargeting)

关键词: 3D建筑模型 合成数据集 多模态学习 语义标注 LoD4 生成式AI 计算机视觉

📋 核心要点

- 现有3D建筑模型自动生成方法缺乏大规模带标注数据集,难以生成精确且语义丰富的模型。

- SYNBUILD-3D数据集提供三模态数据(线框图、平面图、点云),并包含详细的语义标注,促进生成式AI算法开发。

- 该数据集包含超过620万个LoD4级别的住宅建筑模型,为相关研究提供了充足的数据支持。

📝 摘要(中文)

本文提出了SYNBUILD-3D,一个大规模、多样化、多模态的合成3D住宅建筑数据集,包含超过620万个LoD4级别的建筑模型。每个建筑通过三种不同的模态表示:语义增强的LoD4级别3D线框图(模态I),对应的平面图图像(模态II),以及类似LiDAR的屋顶点云(模态III)。每个建筑线框的语义标注来源于对应的平面图图像,包括房间、门和窗户的信息。通过其三模态特性,未来的工作可以使用SYNBUILD-3D来开发新的生成式AI算法,以自动创建LoD4级别的3D建筑模型,并服从预定义的平面图布局和屋顶几何形状,同时强制执行语义-几何一致性。数据集和代码示例可在https://github.com/kdmayer/SYNBUILD-3D公开获取。

🔬 方法详解

问题定义:现有3D建筑模型自动生成方法面临的主要挑战是缺乏大规模、高质量、带语义标注的数据集。这限制了深度学习模型在建筑设计领域的应用,使得自动生成精确且语义一致的3D建筑模型变得困难。现有方法往往依赖于人工标注或小规模数据集,难以满足实际需求。

核心思路:本文的核心思路是利用合成数据生成技术,创建一个大规模、多模态、语义丰富的3D建筑模型数据集。通过程序化生成建筑结构,并自动标注语义信息,从而克服了数据获取的瓶颈。这种方法能够有效地降低数据标注成本,并提供多样化的建筑设计样本。

技术框架:SYNBUILD-3D数据集的生成流程主要包括以下几个阶段:1) 基于程序化规则生成建筑平面图;2) 从平面图提取房间、门、窗户等语义信息;3) 根据平面图和语义信息生成LoD4级别的3D线框图;4) 渲染平面图图像;5) 生成模拟LiDAR扫描的屋顶点云。这三种模态的数据共同构成了SYNBUILD-3D数据集。

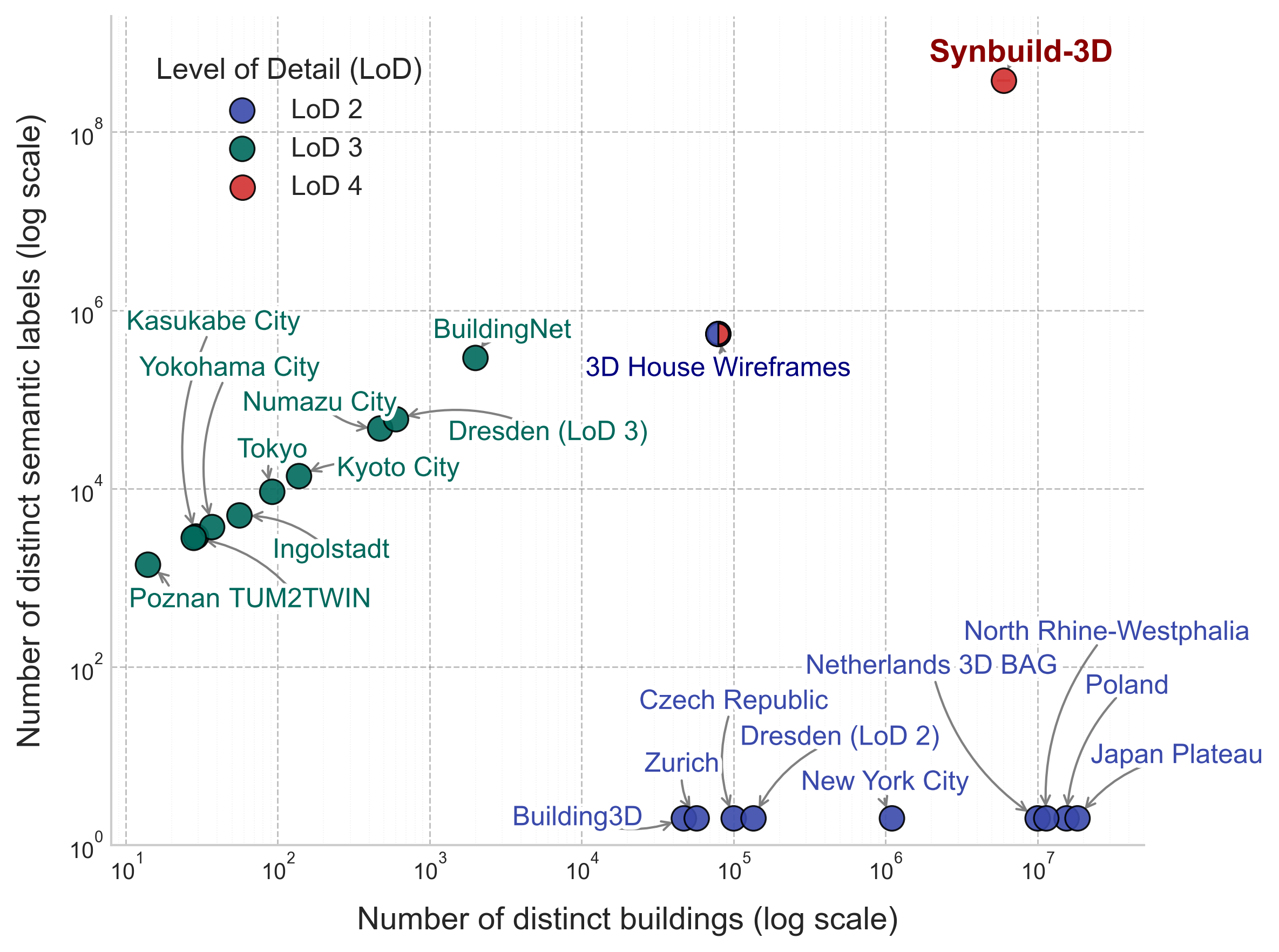

关键创新:该论文的关键创新在于构建了一个大规模、多模态的合成3D建筑模型数据集,并提供了详细的语义标注。与现有数据集相比,SYNBUILD-3D在数据规模、模态多样性和语义丰富度方面都具有显著优势。此外,该数据集的三模态特性为多模态学习和语义-几何一致性建模提供了新的机会。

关键设计:在数据集生成过程中,作者设计了一系列程序化规则来控制建筑结构的生成,例如房间大小、门窗位置等。为了保证语义标注的准确性,作者采用了基于平面图的自动标注方法。在生成屋顶点云时,作者模拟了LiDAR扫描过程,并添加了噪声以增加数据的真实感。数据集包含超过620万个建筑模型,涵盖了各种不同的建筑风格和布局。

🖼️ 关键图片

📊 实验亮点

SYNBUILD-3D数据集包含超过620万个LoD4级别的3D住宅建筑模型,规模远超现有公开数据集。该数据集提供三模态数据(线框图、平面图、点云)和详细的语义标注,为多模态学习和语义-几何一致性建模提供了新的机会。通过该数据集,研究人员可以开发更强大的3D建筑模型生成算法。

🎯 应用场景

SYNBUILD-3D数据集可广泛应用于建筑设计、城市规划、能源模拟和机器人导航等领域。它可以用于训练生成式AI模型,自动创建符合特定要求的3D建筑模型。此外,该数据集还可以用于研究多模态融合、语义场景理解和几何推理等问题,促进相关领域的发展。

📄 摘要(原文)

3D building models are critical for applications in architecture, energy simulation, and navigation. Yet, generating accurate and semantically rich 3D buildings automatically remains a major challenge due to the lack of large-scale annotated datasets in the public domain. Inspired by the success of synthetic data in computer vision, we introduce SYNBUILD-3D, a large, diverse, and multi-modal dataset of over 6.2 million synthetic 3D residential buildings at Level of Detail (LoD) 4. In the dataset, each building is represented through three distinct modalities: a semantically enriched 3D wireframe graph at LoD 4 (Modality I), the corresponding floor plan images (Modality II), and a LiDAR-like roof point cloud (Modality III). The semantic annotations for each building wireframe are derived from the corresponding floor plan images and include information on rooms, doors, and windows. Through its tri-modal nature, future work can use SYNBUILD-3D to develop novel generative AI algorithms that automate the creation of 3D building models at LoD 4, subject to predefined floor plan layouts and roof geometries, while enforcing semantic-geometric consistency. Dataset and code samples are publicly available at https://github.com/kdmayer/SYNBUILD-3D.