Realistic and Controllable 3D Gaussian-Guided Object Editing for Driving Video Generation

作者: Jiusi Li, Jackson Jiang, Jinyu Miao, Miao Long, Tuopu Wen, Peijin Jia, Shengxiang Liu, Chunlei Yu, Maolin Liu, Yuzhan Cai, Kun Jiang, Mengmeng Yang, Diange Yang

分类: cs.CV

发布日期: 2025-08-28

💡 一句话要点

提出G^2Editor,用于自动驾驶视频中逼真且可控的3D高斯引导物体编辑

🎯 匹配领域: 支柱三:空间感知与语义 (Perception & Semantics)

关键词: 自动驾驶 视频生成 物体编辑 3D高斯溅射 去噪扩散模型

📋 核心要点

- 自动驾驶系统训练和验证依赖corner case,但真实场景数据采集成本高且危险,因此需要高效的场景编辑方法。

- G^2Editor利用3D高斯表示作为先验,指导物体编辑过程,确保姿态控制精度和空间一致性,并重建遮挡区域。

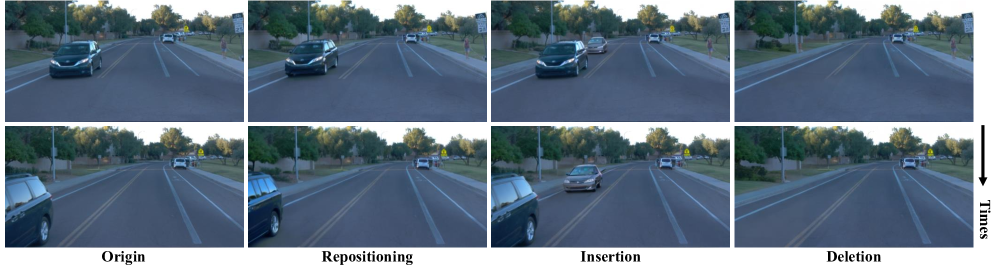

- 实验表明,G^2Editor在Waymo数据集上实现了物体重定位、插入和删除,并在姿态控制和视觉质量上超越现有方法。

📝 摘要(中文)

本文提出G^2Editor框架,旨在实现驾驶视频中逼真且精确的物体编辑。现有方法常受限于视觉保真度或姿态控制精度。该方法利用编辑对象的三维高斯表示作为密集先验,将其注入到去噪过程中,以确保精确的姿态控制和空间一致性。采用场景级三维边界框布局来重建非目标对象的遮挡区域。此外,为了引导编辑对象的外观细节,在生成过程中加入分层细粒度特征作为附加条件。在Waymo开放数据集上的实验表明,G^2Editor在一个统一的框架内有效地支持物体重定位、插入和删除,在姿态可控性和视觉质量方面优于现有方法,并且有益于下游数据驱动的任务。

🔬 方法详解

问题定义:现有基于3D高斯溅射或图像生成模型的物体编辑方法,在自动驾驶视频生成中存在视觉保真度有限和姿态控制不精确的问题。这些问题限制了生成多样化和高质量的自动驾驶场景的能力,阻碍了自动驾驶系统的训练和验证。

核心思路:G^2Editor的核心思路是将编辑对象的三维高斯表示作为密集先验,融入到图像生成模型的去噪过程中。通过这种方式,可以有效地约束编辑对象的姿态,保证其在场景中的空间一致性,并提高生成图像的视觉质量。同时,利用场景级三维边界框布局来重建被遮挡的非目标对象区域,进一步提升场景的真实感。

技术框架:G^2Editor框架主要包含以下几个关键模块:1) 3D高斯表示模块:用于将编辑对象表示为一组3D高斯分布,捕捉其几何和外观信息。2) 去噪扩散模型:作为图像生成的主体,负责生成最终的编辑后的图像。3) 先验注入模块:将3D高斯表示作为先验信息注入到去噪过程中,引导图像生成。4) 场景重建模块:利用场景级三维边界框布局重建被遮挡的非目标对象区域。5) 细粒度特征引导模块:通过分层细粒度特征引导编辑对象的外观细节生成。

关键创新:G^2Editor的关键创新在于将3D高斯表示与去噪扩散模型相结合,实现对编辑对象姿态的精确控制和视觉质量的提升。与现有方法相比,G^2Editor能够更有效地利用3D信息,生成更逼真、更可控的自动驾驶场景。此外,场景重建模块和细粒度特征引导模块进一步提升了场景的真实感和编辑对象的细节。

关键设计:在3D高斯表示模块中,使用了自适应密度控制策略,根据对象的复杂程度调整高斯分布的数量。在去噪扩散模型中,使用了U-Net结构,并引入了注意力机制以增强对局部细节的建模能力。在先验注入模块中,使用了交叉注意力机制,将3D高斯表示与图像特征进行融合。损失函数包括L1损失、L2损失和感知损失,以保证生成图像的视觉质量和空间一致性。具体参数设置未知。

🖼️ 关键图片

📊 实验亮点

实验结果表明,G^2Editor在Waymo开放数据集上实现了显著的性能提升。在物体重定位、插入和删除任务中,G^2Editor在姿态控制精度和视觉质量方面均优于现有方法。具体量化指标未知,但定性结果显示G^2Editor生成的图像更加逼真,编辑对象的姿态更加准确,与周围环境的融合更加自然。

🎯 应用场景

G^2Editor可应用于自动驾驶系统的训练数据生成、场景仿真和测试评估。通过编辑驾驶视频中的物体,可以生成各种corner case和罕见场景,从而提高自动驾驶系统的鲁棒性和安全性。此外,该方法还可以用于虚拟现实、游戏开发等领域,生成逼真且可控的3D场景。

📄 摘要(原文)

Corner cases are crucial for training and validating autonomous driving systems, yet collecting them from the real world is often costly and hazardous. Editing objects within captured sensor data offers an effective alternative for generating diverse scenarios, commonly achieved through 3D Gaussian Splatting or image generative models. However, these approaches often suffer from limited visual fidelity or imprecise pose control. To address these issues, we propose G^2Editor, a framework designed for photorealistic and precise object editing in driving videos. Our method leverages a 3D Gaussian representation of the edited object as a dense prior, injected into the denoising process to ensure accurate pose control and spatial consistency. A scene-level 3D bounding box layout is employed to reconstruct occluded areas of non-target objects. Furthermore, to guide the appearance details of the edited object, we incorporate hierarchical fine-grained features as additional conditions during generation. Experiments on the Waymo Open Dataset demonstrate that G^2Editor effectively supports object repositioning, insertion, and deletion within a unified framework, outperforming existing methods in both pose controllability and visual quality, while also benefiting downstream data-driven tasks.