MExECON: Multi-view Extended Explicit Clothed humans Optimized via Normal integration

作者: Fulden Ece Uğur, Rafael Redondo, Albert Barreiro, Stefan Hristov, Roger Marí

分类: cs.CV

发布日期: 2025-08-21

💡 一句话要点

MExECON:基于法线整合的多视角扩展显式服装人体优化

🎯 匹配领域: 支柱六:视频提取与匹配 (Video Extraction)

关键词: 服装人体重建 多视角重建 SMPL-X 法线贴图积分 三维重建

📋 核心要点

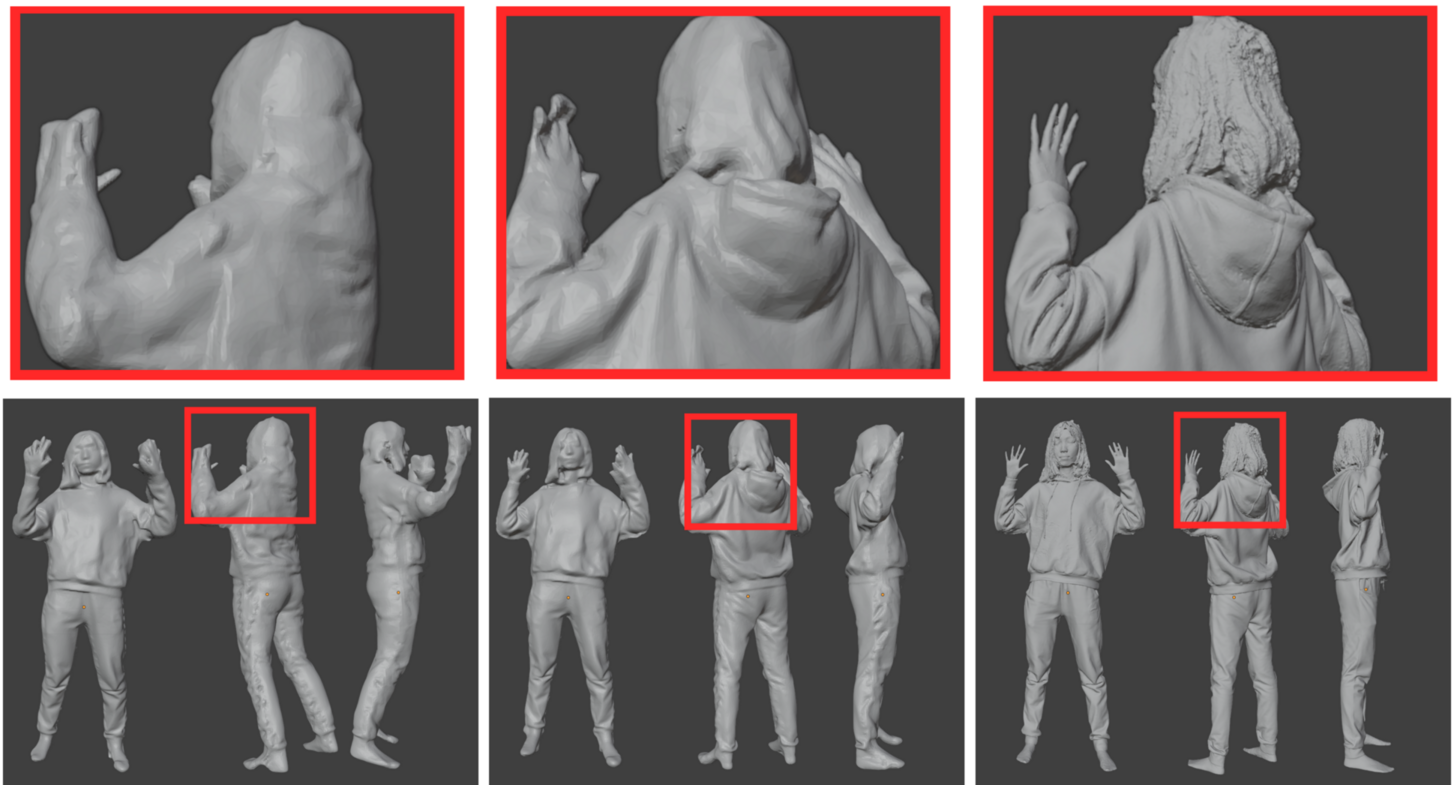

- 现有单视角服装人体重建方法难以准确捕捉复杂几何细节,且视角依赖性强。

- MExECON通过联合优化多视角信息,并结合法线贴图积分,提升重建质量和视角一致性。

- 实验表明,MExECON在服装人体重建的保真度上优于单视角基线,并达到与先进方法相当的水平。

📝 摘要(中文)

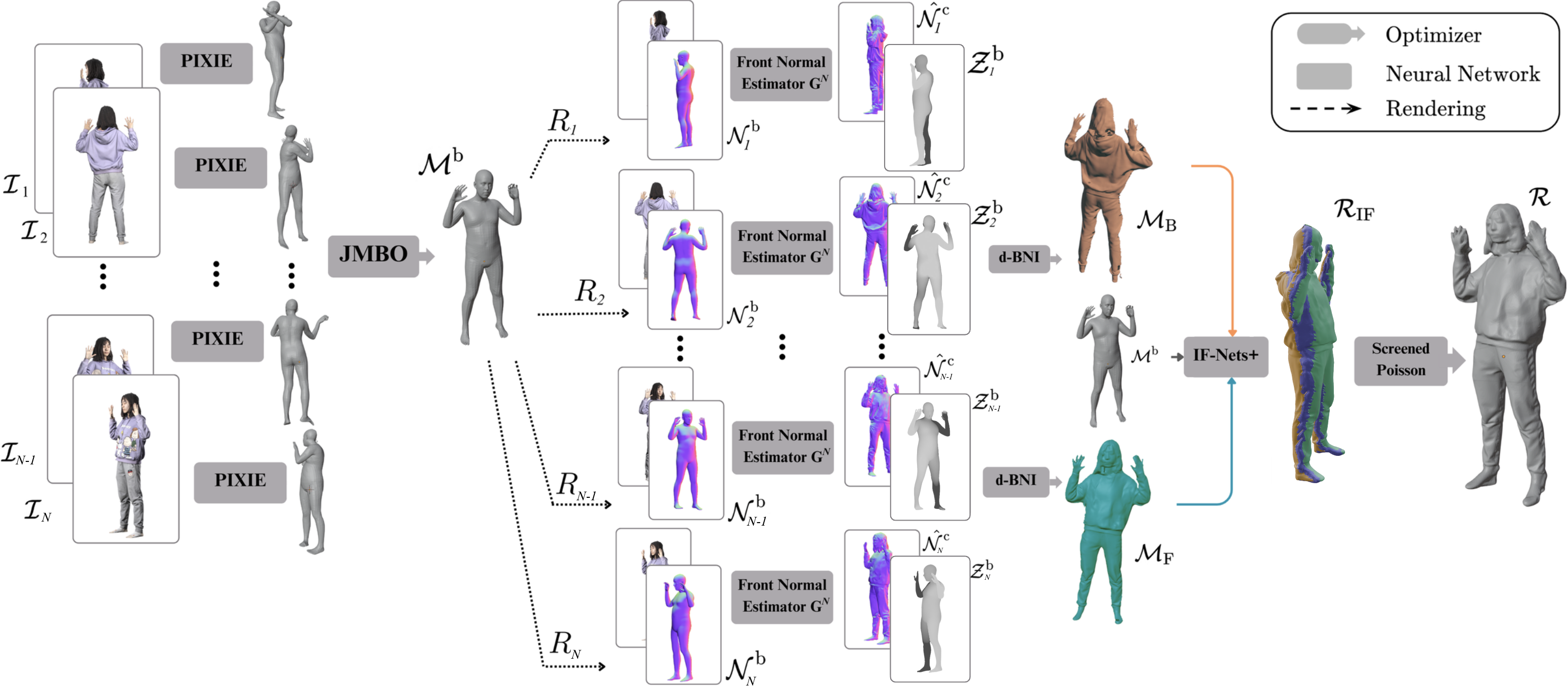

本文提出了一种名为MExECON的新型流程,用于从稀疏的多视角RGB图像中重建3D服装人体化身。MExECON构建于单视角方法ECON之上,扩展了其能力以利用多个视角,从而改进了几何形状和身体姿态估计。该流程的核心是提出的联合多视角身体优化(JMBO)算法,该算法在所有输入视图中联合拟合单个SMPL-X身体模型,从而强制执行多视角一致性。优化的身体模型充当低频先验,指导后续的表面重建,其中通过法线贴图积分添加几何细节。MExECON集成了来自正面和背面视图的法线贴图,以准确捕获细粒度的表面细节,例如服装褶皱和发型。所有多视角增益的实现都不需要任何网络重新训练。实验结果表明,MExECON始终优于单视角基线,并且与现代少样本3D重建方法相比,实现了具有竞争力的性能。

🔬 方法详解

问题定义:现有单视角服装人体重建方法在处理复杂服装褶皱和细节时,容易出现几何失真,且对视角变化敏感,难以保证重建结果的一致性。多视角重建可以提供更全面的信息,但如何有效融合多视角信息是一个挑战。

核心思路:MExECON的核心思路是利用多视角信息进行联合优化,首先通过联合多视角身体优化(JMBO)算法拟合一个全局一致的SMPL-X身体模型,然后利用该模型作为低频先验,指导后续的表面重建,并通过法线贴图积分添加高频细节。

技术框架:MExECON的整体框架包括以下几个主要阶段:1) 多视角图像输入;2) 联合多视角身体优化(JMBO):使用JMBO算法在所有输入视图中联合拟合SMPL-X模型,保证多视角一致性;3) 表面重建:利用优化的SMPL-X模型作为先验,进行表面重建;4) 法线贴图积分:集成来自正面和背面视图的法线贴图,以捕获细粒度的表面细节。

关键创新:MExECON的关键创新在于提出了联合多视角身体优化(JMBO)算法,该算法能够有效地融合多视角信息,保证重建结果的全局一致性。此外,通过集成来自正面和背面视图的法线贴图,能够更准确地捕获服装的细节信息。

关键设计:JMBO算法的具体实现细节未知,但可以推测其损失函数可能包含以下几个部分:1) 图像重投影误差:保证重建的3D模型能够准确地投影回各个输入视图;2) SMPL-X先验:约束重建的身体形状和姿态符合人体生理结构;3) 多视角一致性约束:保证不同视角下重建的身体形状和姿态尽可能一致。法线贴图积分的具体方法也未知,但可能采用泊松方程求解等方法。

🖼️ 关键图片

📊 实验亮点

实验结果表明,MExECON在服装人体重建的保真度上显著优于单视角基线ECON。与现有的少样本3D重建方法相比,MExECON也取得了具有竞争力的性能。具体性能数据未知,但摘要强调了在没有重新训练网络的情况下实现了多视角增益。

🎯 应用场景

MExECON技术可应用于虚拟现实、增强现实、游戏开发、电商试衣等领域。通过该技术,可以从少量图像中快速生成高质量的3D服装人体模型,为用户提供更逼真的虚拟体验。未来,该技术有望进一步应用于个性化服装定制、虚拟形象设计等领域。

📄 摘要(原文)

This work presents MExECON, a novel pipeline for 3D reconstruction of clothed human avatars from sparse multi-view RGB images. Building on the single-view method ECON, MExECON extends its capabilities to leverage multiple viewpoints, improving geometry and body pose estimation. At the core of the pipeline is the proposed Joint Multi-view Body Optimization (JMBO) algorithm, which fits a single SMPL-X body model jointly across all input views, enforcing multi-view consistency. The optimized body model serves as a low-frequency prior that guides the subsequent surface reconstruction, where geometric details are added via normal map integration. MExECON integrates normal maps from both front and back views to accurately capture fine-grained surface details such as clothing folds and hairstyles. All multi-view gains are achieved without requiring any network re-training. Experimental results show that MExECON consistently improves fidelity over the single-view baseline and achieves competitive performance compared to modern few-shot 3D reconstruction methods.